强化学习是什么:2026 年原理、算法演进与前沿应用全解析

一句话定义

强化学习(Reinforcement Learning, RL)是智能体通过与环境交互试错,依据奖励信号优化决策策略,以最大化长期累积回报的机器学习范式。

在人工智能的宏大版图中,如果说监督学习是“有老师带着做题”,无监督学习是“独自观察世界寻找规律”,那么强化学习就是“在实战中摸爬滚打,从成败中领悟生存之道”。它不仅是让 AlphaGo 战胜人类围棋冠军的幕后推手,更是未来机器人自主导航、自动驾驶汽车复杂路况决策以及大语言模型(LLM)对齐人类价值观的核心引擎。站在 2026 年的视角回望与前瞻,强化学习已从实验室的理论模型,演变为构建通用人工智能(AGI)不可或缺的基石。

技术原理:从试错到智慧的进化机制

强化学习的核心魅力在于其独特的学习机制:它不需要预先标注好的“标准答案”,而是通过不断的“尝试 - 反馈 - 调整”循环,在动态环境中自我进化。要深入理解这一过程,我们需要拆解其工作机制、关键组件,并厘清它与传统机器学习方法的本质区别。

1. 核心工作机制:马尔可夫决策过程的舞蹈

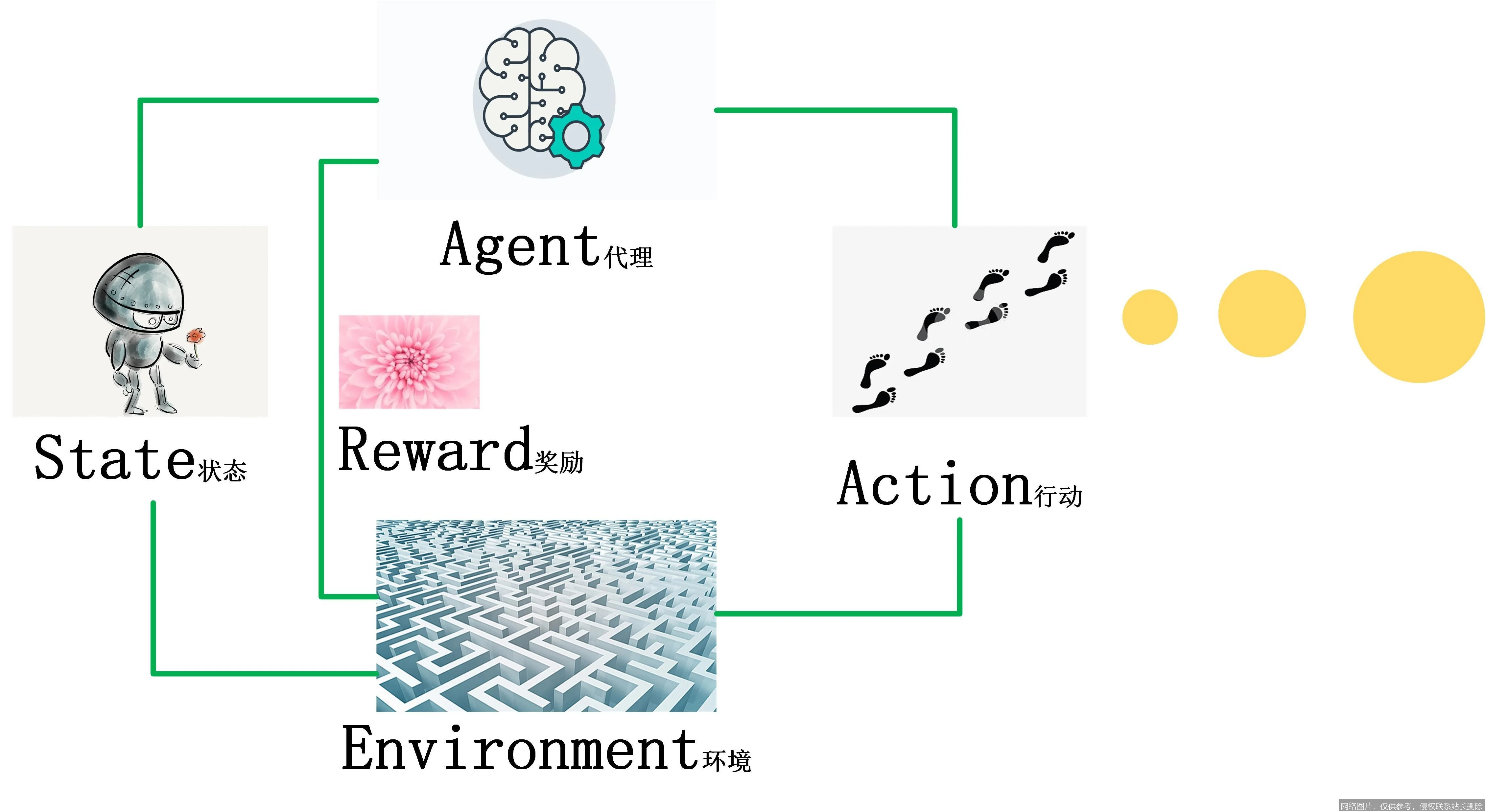

强化学习的数学基础通常建立在马尔可夫决策过程(Markov Decision Process, MDP)之上。这是一个描述智能体与环境交互的标准框架。在这个框架下,学习过程是一个连续的闭环:

- 感知状态(State, $S_t$):智能体在时刻 $t$ 观察到的环境信息。这可以是围棋棋盘上的棋子分布,也可以是机器人传感器读取的距离数据。

- 执行动作(Action, $A_t$):基于当前状态,智能体根据某种策略选择一个动作。例如,“落子在星位”或“向左转 30 度”。

- 接收反馈(Reward, $R_{t+1}$):环境对动作做出反应,转移到一个新状态 $S_{t+1}$,并给出一个标量奖励信号。这个信号告诉智能体刚才的动作是“好”还是“坏”。

- 更新策略(Policy Update):智能体根据获得的奖励和新状态,调整内部的决策逻辑,目的是在未来获得更高的总奖励。

这个过程周而复始,直到任务结束(如游戏通关或达到最大步数)。智能体的终极目标不是追求单步奖励的最大化,而是累积折扣回报(Cumulative Discounted Return)的最大化。这意味着它必须学会“延迟满足”,为了长远的大利益而牺牲眼前的微小诱惑。

2. 关键技术组件:大脑的解剖学

为了实现上述机制,强化学习系统由四个核心组件构成,它们共同协作形成了智能体的“大脑”:

- 策略(Policy, $\pi$):这是智能体的行为准则,定义了在给定状态下选择各个动作的概率。策略可以是确定性的(看到红灯一定停),也可以是随机性的(80% 概率停,20% 概率冲过去以探索未知)。在深度强化学习中,策略通常由深度神经网络参数化。

- 价值函数(Value Function, $V$ 或 $Q$):这是智能体的“预判能力”。它不直接告诉智能体该做什么,而是评估某个状态(或状态 - 动作对)在未来能带来多少回报。状态价值函数 $V(s)$ 评估处于状态 $s$ 的好坏;动作价值函数 $Q(s, a)$ 则评估在状态 $s$ 执行动作 $a$ 后的预期收益。它是智能体进行长远规划的依据。

- 模型(Model):这是对环境的模拟。如果智能体拥有模型,它就可以在不与实际环境交互的情况下,在脑海中进行“思想实验”或推演,预测下一步的状态和奖励。基于模型的方法(Model-based)通常样本效率更高,但构建精确模型极其困难;无模型方法(Model-free)则完全依赖真实交互,虽稳健但需要海量数据。

- 奖励信号(Reward Signal):这是学习的指挥棒。奖励函数的设计至关重要,它定义了任务的终极目标。错误的奖励设计会导致“奖励黑客(Reward Hacking)”现象,即智能体找到了刷分的捷径却未完成任务(例如:在一个赛车游戏中,智能体发现原地打转撞墙可以不断获得碰撞积分,从而不再跑完全程)。

3. 与传统方法的对比:为何它如此特殊?

为了更清晰地定位强化学习,我们可以将其与主流的监督学习(Supervised Learning)进行对比:

| 维度 | 监督学习 (Supervised Learning) | 强化学习 (Reinforcement Learning) |

|---|---|---|

| 数据来源 | 静态的、预先标注好的数据集(输入 - 输出对) | 动态的、通过与环境交互实时生成的序列数据 |

| 反馈形式 | 明确的正确答案(Label),告诉你是猫还是狗 | 稀疏的标量奖励(Scalar Reward),只告诉你做得好不好,不告诉怎么做才对 |

| 时间依赖性 | 通常假设样本独立同分布(IID),不考虑前后顺序 | 高度依赖时间序列,当前的动作会影响未来的状态和奖励 |

| 目标导向 | 最小化预测误差(如交叉熵、均方误差) | 最大化长期累积回报 |

| 典型类比 | 学生做有标准答案的习题集 | 学徒在师傅的指导下通过实际操作掌握手艺 |

这种差异决定了强化学习特别适合解决那些序列决策问题(Sequential Decision Making Problems),即在复杂、动态且不确定的环境中,需要做出一连串相互关联的决策才能达到目标的任务。

4. 形象类比:训练一只导盲犬

想象你在训练一只导盲犬(智能体)。

- 环境:是复杂的城市街道,充满行人、车辆和红绿灯。

- 状态:狗狗看到的景象(前方有人、红灯亮起)。

- 动作:停下、前进、左转、绕行。

- 奖励:如果你安全到达目的地,狗狗得到一大块肉干(正奖励);如果它带你闯红灯差点被撞,你会严厉斥责甚至轻拍它的鼻子(负奖励)。

- 学习过程:起初,狗狗会随机乱走,经常挨骂。但随着次数增多,它开始建立联系:“看到红灯停下”虽然暂时不能前进(牺牲短期速度),但能避免挨骂并最终吃到肉干(获得长期回报)。久而久之,它形成了一套完美的导航策略。

在这个过程中,没有人拿着教科书告诉狗狗“红灯意味着波长 700nm 的光,此时应停止肌肉收缩”。它完全是通过后果(奖励/惩罚)来反推行为的正确性。这就是强化学习的精髓。

核心概念:构建认知地图的关键术语

深入强化学习的世界,必须掌握一套专门的术语体系。这些概念不仅构成了算法的骨架,也是理解前沿论文和技术突破的钥匙。

1. 关键术语详解

- 探索与利用(Exploration vs. Exploitation):这是强化学习中最经典的困境。利用是指智能体根据已有的知识,选择当前认为最好的动作以获取稳定奖励;探索则是指尝试未知的动作,以期发现可能更好的策略。过于侧重利用会导致陷入局部最优(井底之蛙),过于侧重探索则会导致效率低下且无法收敛。优秀的算法(如 $\epsilon$-greedy, UCB, Thompson Sampling)都在寻求这两者的最佳平衡点。

- 轨迹(Trajectory/Episode):指智能体从初始状态开始,经过一系列状态、动作、奖励,直到终止状态的一条完整路径。强化学习的数据往往是以轨迹为单位进行采集和分析的。

- 信用分配问题(Credit Assignment Problem):当一个任务完成后(比如赢了棋局),我们如何判断是哪一步棋起了决定性作用?是最后的绝杀,还是开局布局的深远影响?将最终的奖励合理地分配给序列中的每一个动作,是强化学习算法设计的难点之一。

- 同策略与异策略(On-Policy vs. Off-Policy):

- On-Policy:学习评估和改进的策略,正是当前用来生成数据的策略(如 SARSA, PPO)。优点是稳定,缺点是样本利用率低,因为旧数据不能复用。

- Off-Policy:学习的策略与生成数据的策略可以不同(如 Q-Learning, DQN, SAC)。允许利用历史经验回放池(Replay Buffer)中的数据,大大提高了样本效率,但训练稳定性较难控制。

- 奖励塑形(Reward Shaping):由于原始环境的奖励往往非常稀疏(只有赢或输才有分数,中间过程没有反馈),导致学习极慢。奖励塑形是通过人为添加一些辅助的中间奖励(如“靠近目标给小分”),来引导智能体更快学习的技术。但这需要极高的技巧,否则容易引入偏差。

2. 概念关系图谱

在强化学习的生态系统中,各概念并非孤立存在,而是紧密交织:

MDP 框架提供了舞台,智能体在其中通过策略行动。行动产生轨迹,轨迹中包含状态、动作和奖励。智能体利用这些数据更新价值函数以解决信用分配问题,并在探索与利用的博弈中不断迭代策略。根据是否使用模型以及是否遵循同策略,衍生出了两大类算法流派:基于价值的(Value-based,如 DQN)、基于策略的(Policy-based,如 REINFORCE)以及结合两者优势的演员 - 评论家(Actor-Critic)架构。

3. 常见误解澄清

- 误解一:“强化学习就是深度学习的一部分。”

澄清:不完全准确。强化学习是一种学习范式(如何学习),而深度学习是一种工具(用什么函数拟合)。两者结合产生了深度强化学习(Deep RL),即用深度神经网络来表示策略或价值函数。传统的表格型强化学习(Tabular RL)不需要深度学习也能工作,只是处理能力有限。 - 误解二:“只要给够奖励,智能体就能学会任何事。”

澄清:奖励函数的设计是一门艺术,甚至被称为“对齐难题”。如果奖励定义稍有偏差,智能体往往会找到人类意想不到的漏洞(Reward Hacking)来刷分,而不是真正完成任务。此外,稀疏奖励和高维状态空间也会导致“维数灾难”,使得学习几乎不可能。 - 误解三:“强化学习样本效率很高。”

澄清:恰恰相反,大多数现代深度强化学习算法的样本效率极低。AlphaGo 需要自我对弈数千万局,机器人可能需要数小时的物理试错才能学会走路。这也是目前限制其在现实世界大规模应用的主要瓶颈之一,因此“样本高效强化学习(Sample-Efficient RL)”是 2026 年的研究热点。

实际应用:从虚拟博弈到现实世界的跨越

截至 2026 年,强化学习已走出学术象牙塔,深刻改变了多个行业的运作模式。从虚拟世界的超级玩家,到物理世界的自动化专家,再到数字内容的创造者,其应用场景正呈指数级扩张。

1. 典型应用场景

- 游戏与电子竞技:这是强化学习的“练兵场”。从围棋、星际争霸到 Dota 2,AI 已经证明了其在超复杂策略空间中的统治力。现在的 RL 不仅用于开发无敌的 NPC,更用于游戏测试(自动寻找 Bug)、平衡性调整以及为玩家提供个性化的陪练对手。

- 机器人与自动控制:这是最具挑战也最具价值的领域。四足机器人(如机器狗)如何在崎岖地形保持平衡?机械臂如何灵巧地抓取不规则物体?无人机如何在强风中编队飞行?强化学习让机器人能够通过大量的模拟训练(Sim-to-Real 迁移技术),掌握复杂的运动控制技能,适应从未见过的动态环境。

- 推荐系统与广告投放:传统的推荐系统多基于静态点击率预测,而引入 RL 后,系统开始考虑用户的长期满意度(Long-term Engagement)。算法不再仅仅推送当下最可能点击的内容,而是规划一条内容消费路径,防止用户审美疲劳,最大化用户的生命周期价值(LTV)。

- 大语言模型对齐(RLHF/RLAIF):这是 2024-2026 年间最耀眼的应用。为了让大模型输出的内容符合人类的价值观、有用且无害,研究者利用基于人类反馈的强化学习(Reinforcement Learning from Human Feedback, RLHF)及其进阶版基于 AI 反馈的强化学习(RLAIF)。通过将人类偏好转化为奖励模型,指导大模型微调其生成策略,使其从“能说会道”变得“懂事得体”。

- 资源调度与金融交易:在数据中心冷却系统节能、电网负载平衡、高频交易策略制定等方面,RL 能够处理多变量、非线性的动态优化问题,实现比传统规则系统更高效的全局资源配置。

2. 代表性产品与项目案例

- AlphaGo / AlphaZero 系列:DeepMind 的杰作,标志着深度强化学习在完美信息博弈中的成熟。AlphaZero 更是证明了单一算法可以通吃围棋、国际象棋和日本将棋。

- Tesla FSD (Full Self-Driving):虽然特斯拉的具体技术栈保密,但其端到端的神经网络决策系统中,强化学习思想被广泛用于处理复杂的路口通行、变道博弈等长尾场景。

- Google Data Center Cooling:Google 利用 DeepMind 的 RL 算法控制数据中心的风扇和冷却系统,成功降低了 40% 的能耗,展示了工业级节能潜力。

- InstructGPT / ChatGPT:OpenAI 通过 RLHF 技术,将原本仅仅是“文本补全器”的 GPT 模型,转化为了能够遵循指令、进行多轮对话的智能助手,开启了生成式 AI 的新纪元。

- NVIDIA Isaac Gym:一个大规模并行化的机器人训练平台,允许同时在数千个虚拟环境中训练机器人策略,极大地加速了 Sim-to-Real 的落地进程。

3. 使用门槛与现实条件

尽管前景广阔,但在 2026 年,部署强化学习系统仍面临显著门槛:

- 高昂的计算成本:训练高性能的 RL 代理通常需要成千上万个 GPU 小时,尤其是在涉及高维视觉输入或复杂物理模拟时。

- 仿真环境的依赖性:在现实世界直接试错成本太高(如撞坏机器人、造成交通事故)。因此,构建高保真的仿真环境(Digital Twin)成为前置条件,而仿真与现实的差距(Reality Gap)依然是技术难点。

- 奖励工程的专业性:设计一个既能引导正确行为又不会被钻空子的奖励函数,需要领域专家和算法工程师的深度协作,难以完全自动化。

- 安全性与可解释性:在医疗、金融等高风险领域,黑盒式的 RL 决策难以被信任。如何保证策略的安全边界(Safe RL)以及如何解释其决策逻辑,是商业化落地的关键制约。

延伸阅读:通往精通之路

强化学习是一个深不见底的海洋,对于希望进一步探索的学习者和从业者,以下路径和资源将助你扬帆起航。

1. 相关概念推荐

在学习强化学习的同时,建议同步关注以下交叉领域,它们共同构成了现代 AI 的拼图:

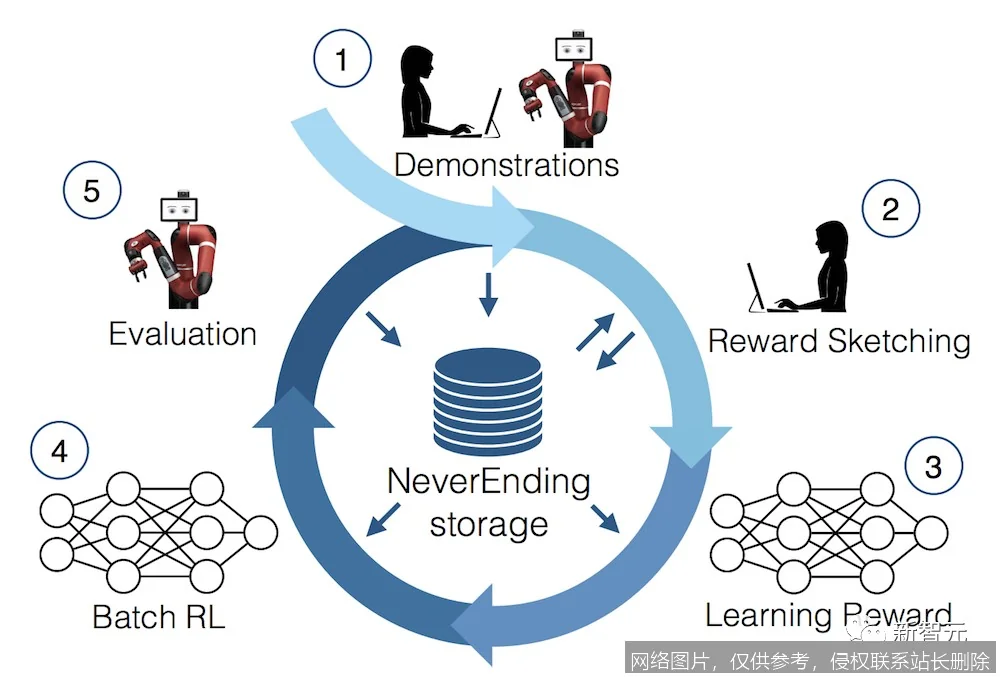

- 模仿学习(Imitation Learning):通过专家演示数据来初始化策略,解决冷启动问题,常与 RL 结合使用。

- 元强化学习(Meta-Reinforcement Learning):旨在让智能体学会“如何快速学习”,使其在面对新任务时仅需少量样本即可适应。

- 多智能体强化学习(Multi-Agent RL, MARL):研究多个智能体在同一个环境中如何协作或竞争,适用于交通流控制、群体机器人等场景。

- 因果推断(Causal Inference):结合因果关系的强化学习,旨在让智能体理解动作与结果之间的因果机制,而非仅仅是相关性,从而提高泛化能力。

2. 进阶学习路径

建议按照以下阶段循序渐进:

- 基础阶段:掌握概率论、马尔可夫链基础。阅读经典教材《Reinforcement Learning: An Introduction》(Sutton & Barto 著),这是该领域的“圣经”。

- 算法实践:学习 Python 及主流深度学习框架(PyTorch/TensorFlow)。使用 Gymnasium(原 OpenAI Gym)库复现经典算法(DQN, A2C, PPO, SAC)。

- 深度进阶:研读顶级会议论文(NeurIPS, ICML, ICLR, CoRL)。关注稀疏奖励、离线强化学习(Offline RL)、世界模型(World Models)等前沿方向。

- 领域应用:选择一个垂直领域(如机器人、游戏、量化交易),尝试解决具体的实际问题,积累工程经验。

3. 推荐资源与文献

- 经典书籍:

- Reinforcement Learning: An Introduction (Richard S. Sutton, Andrew G. Barto) - 必读基础。

- Deep Reinforcement Learning Hands-On (Maxim Lapan) - 适合代码实践者。

- 在线课程:

- David Silver (DeepMind) 的 UCL 强化学习课程视频(经典中的经典)。

- Berkeley CS285: Deep Reinforcement Learning (Sergey Levine) - 偏向最新研究进展。

- 李宏毅老师的强化学习教程(中文讲解,通俗易懂)。

- 开源社区与工具:

- Hugging Face:现在也包含了大量预训练的 RL 模型和数据集。

- Stable Baselines3:高质量的 PyTorch 版 RL 算法库,适合快速原型开发。

- Ray RLLib:可扩展的工业级强化学习库,支持分布式训练。

- 关键论文:

- "Human-level control through deep reinforcement learning" (Nature, 2015) - DQN 开山之作。

- "Proximal Policy Optimization Algorithms" (2017) - PPO 算法,目前最流行的基准算法之一。

- "Mastering Chess and Shogi by Self-Play with a General Reinforcement Learning Algorithm" (2017) - AlphaZero。

强化学习正处于从“专用智能”向“通用智能”跨越的关键节点。随着算法效率的提升、算力的增长以及与大型基础模型的深度融合,我们有理由相信,未来的智能系统将不仅仅是被动地响应指令,而是能够主动地规划、探索并创造价值。理解强化学习,就是理解未来智能社会的底层逻辑。