【AI词典】评估基准 - 衡量AI模型性能的标准测试集

AI词典2026-04-24 23:00:00

评估基准:衡量AI模型性能的标尺

评估基准(Benchmark)是人工智能领域用于系统化衡量、比较和排名AI模型性能的一套标准化测试集、任务和评价指标。它为模型能力提供了客观、可复现的量化标尺。

原理:如何构建公平的“竞技场”

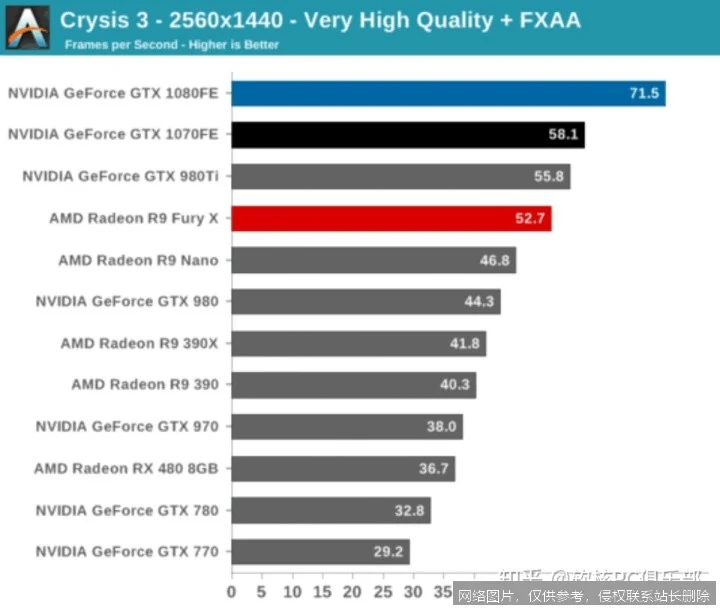

评估基准的工作原理,可以类比为学生的标准化考试。首先,组织者会设计一套覆盖特定能力(如阅读理解、图像识别)的“考题”(测试数据集),这些数据通常包含输入问题和标准答案。然后,不同的AI模型作为“考生”在相同的环境下(相同的硬件、软件配置)独立完成这些考题。最后,根据预设的、统一的评分标准(如准确率、F1分数、推理速度)对模型的答案进行打分和排名。一个优秀的评估基准必须具备代表性(任务反映现实需求)、公平性(排除无关干扰)和可复现性(他人可验证结果)三大核心原则,从而确保比较结果的公信力。

应用场景:从学术研究到产业落地

- 学术研究与竞赛:如ImageNet挑战赛推动了计算机视觉的突破,GLUE和SuperGLUE基准引领了自然语言理解的发展。研究人员通过在这些公认的“擂台”上刷新分数,来证明新模型或算法的有效性。

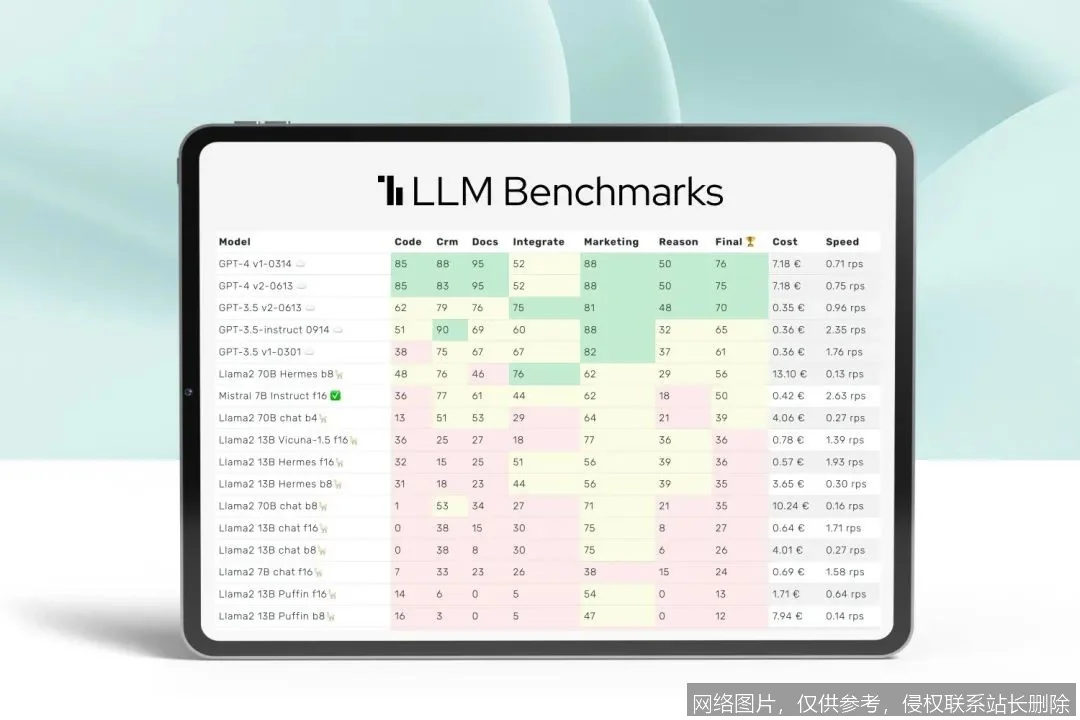

- 工业界模型选型:当企业需要为特定任务(如客服聊天、内容审核)选择AI模型时,会参考相关领域的权威评估基准结果。例如,比较不同大语言模型在MMLU(大规模多任务语言理解)基准上的表现,以评估其综合知识水平。

- 技术发展与风向标:评估基准的演变本身反映了AI领域的关注点变迁。从早期关注单一任务精度,到如今重视模型的鲁棒性、公平性、推理效率和跨任务泛化能力(如Big-Bench),基准驱动着技术向更全面、更实用的方向发展。

相关术语

理解评估基准,还需了解以下紧密关联的概念:测试集、评价指标(如准确率、召回率)、过拟合、SOTA(当前最优结果)以及基准测试。

延伸阅读

若想深入了解,可关注斯坦福大学的“HELM”全栈评估框架、中文领域的CLUE基准,以及论文《Beyond the Imitation Game: Quantifying and extrapolating the capabilities of language models》,它们深入探讨了评估基准的设计哲学、局限性与未来挑战。