【AI词典】推理 - 模型根据输入生成预测或决策的过程

AI词典2026-04-24 20:12:00

推理(Inference):模型从已知到未知的思维过程

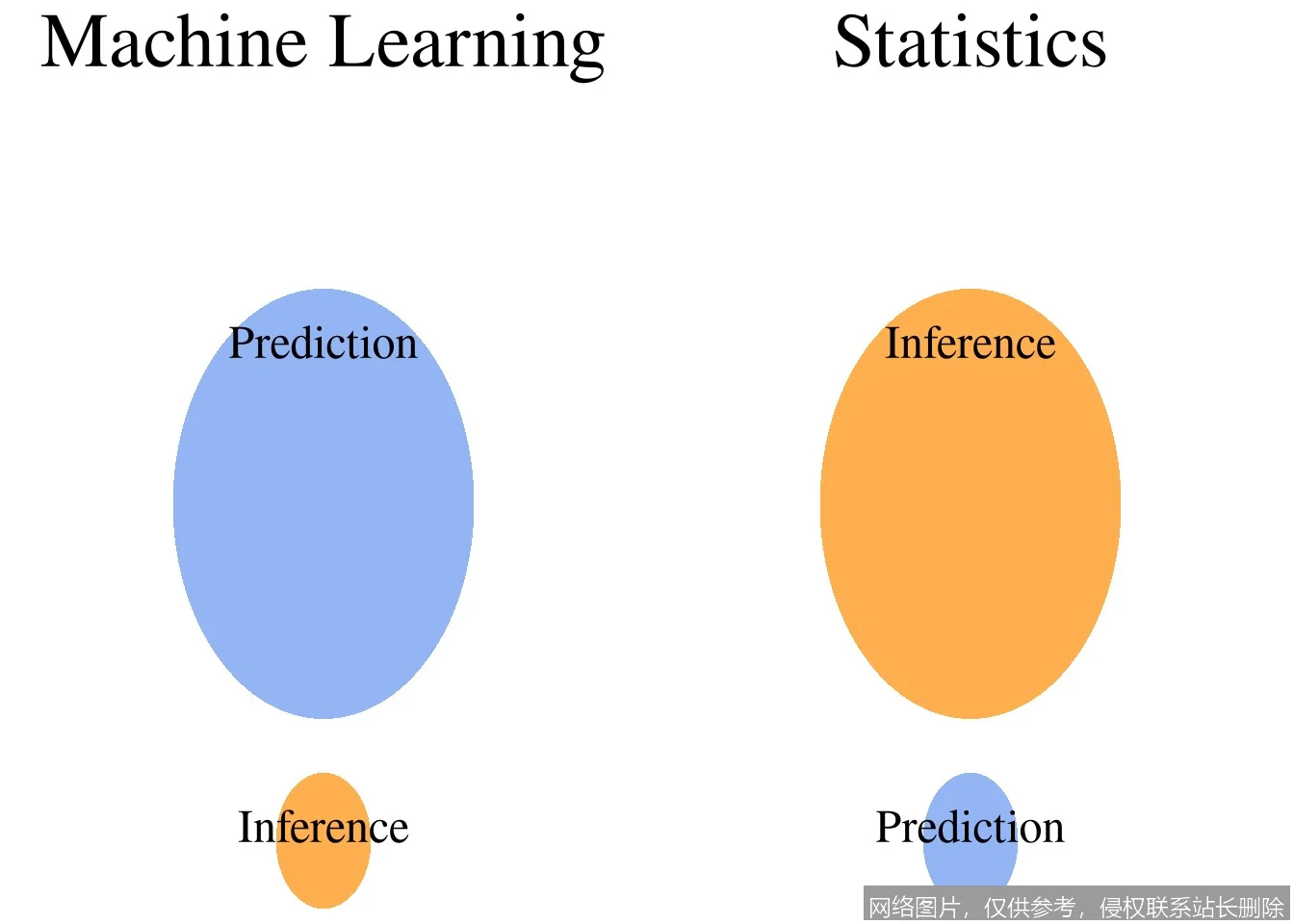

推理(Inference),在人工智能领域,特指训练完成的机器学习模型接收新输入数据,并基于其已学习的模式和参数,生成预测、分类或决策输出的计算过程。它是将静态知识转化为动态智能行动的关键步骤,标志着模型从“学习阶段”进入“应用阶段”。

原理:模型如何“思考”

可以将推理过程类比于人脑解答考题。模型在训练阶段如同学生通过大量习题(训练数据)学习知识(调整模型参数),掌握了内在规律(数据分布)。在推理阶段,当面对一道新题目(输入数据)时,学生无需重新学习,而是直接运用已掌握的知识体系,快速推导出答案(输出结果)。

从技术实现看,推理本质上是数学计算。以深度神经网络为例,输入数据(如图像像素、文本词向量)从网络输入层进入,依次通过多个隐藏层,每一层都执行一系列加权求和与非线性激活函数的运算。这些运算将原始输入逐步转化为高层抽象特征,最终在输出层产生一个概率分布(如图像属于“猫”的概率为95%)或一个具体的值(如下一个最可能出现的词)。整个过程是前向传播,不涉及模型参数的更新。

应用场景

- 实时交互应用:智能语音助手(如语音转文字、语义理解)、实时翻译软件、在线推荐系统(根据当前点击即时推荐商品或内容)。这些场景要求模型在极短时间内(毫秒级)完成推理,以提供流畅的用户体验。

- 内容分析与生成:垃圾邮件过滤、新闻情感分析、AI绘画与文本生成。模型对输入内容进行深度分析或从随机噪声中推理出符合描述的图像与文本,创造新的内容。

- 复杂决策与感知:自动驾驶汽车的实时环境感知(识别行人、车辆、交通标志)与路径规划,工业质检中的缺陷检测。模型需要从传感器获取的海量数据中快速推理出对环境的理解并做出安全决策。

相关术语

理解推理,常需关联以下概念:训练、前向传播、模型部署、延迟、吞吐量、在线推理与批量推理。

延伸阅读

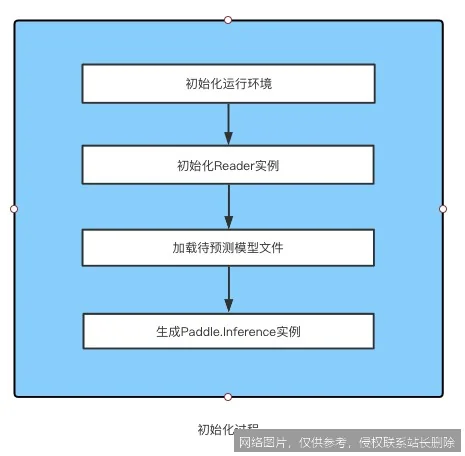

若想深入了解推理环节的工程优化,可探索“模型压缩”(如知识蒸馏、剪枝、量化)和“推理引擎”(如TensorRT、ONNX Runtime)相关技术,它们旨在降低模型计算量与存储需求,提升推理速度和能效,是AI技术落地生产的核心技术栈。