【AI词典】VAE变分自编码器 - 结合概率模型的生成式神经网络

AI词典2026-04-21 20:12:00

VAE变分自编码器:定义

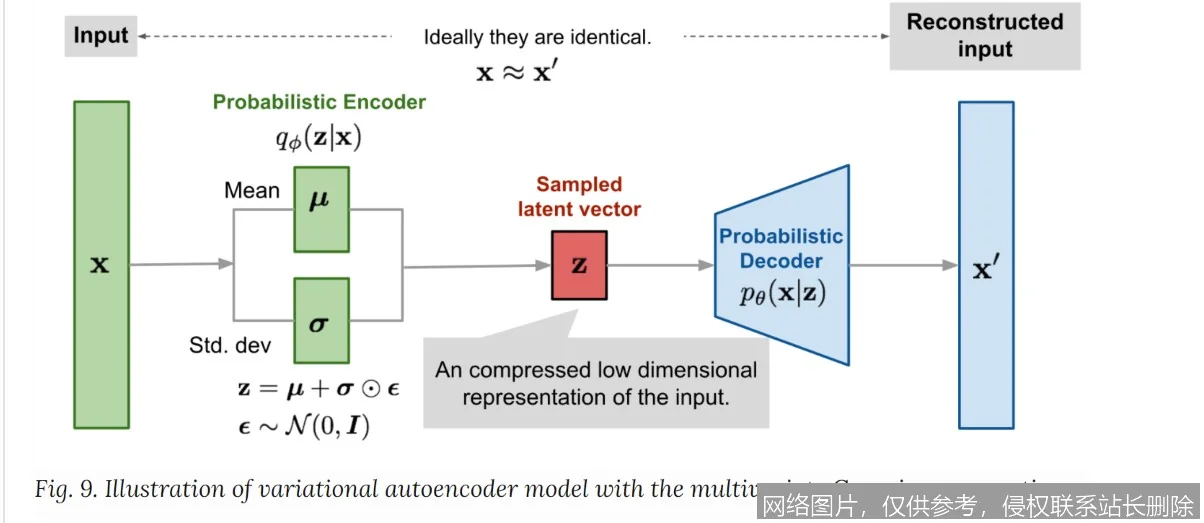

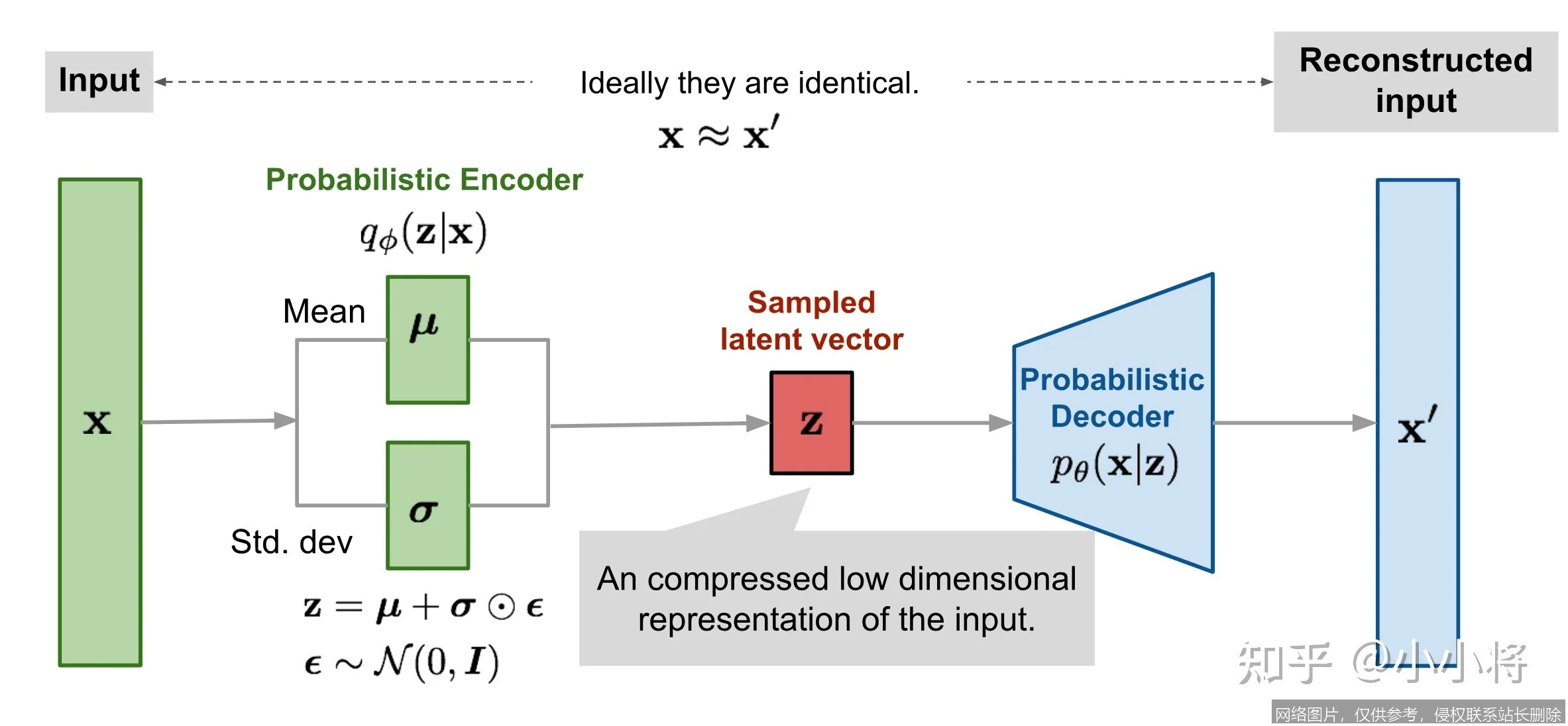

VAE(变分自编码器)是一种结合了深度神经网络与概率图模型的生成式架构,其核心目标是通过学习输入数据的潜在概率分布,实现对数据的高效表征、压缩与生成。它不仅是编码器-解码器结构,更是一个严谨的生成模型,能够从学习到的连续潜在空间中采样并合成新的数据样本。

VAE变分自编码器的工作原理

理解VAE可以借助一个“画家学画”的类比。假设我们让一位画家(解码器)学习画各种猫。传统自编码器只是让画家记住每张猫图的具体像素,而VAE则要求画家理解猫的“本质特征”——例如脸型、毛色、姿态等抽象概念,这些概念构成一个连续的“概念空间”(潜在空间)。

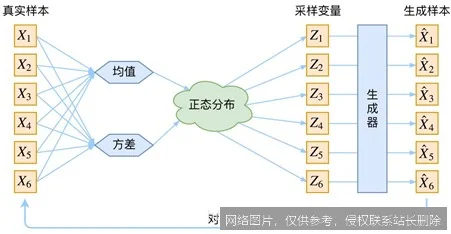

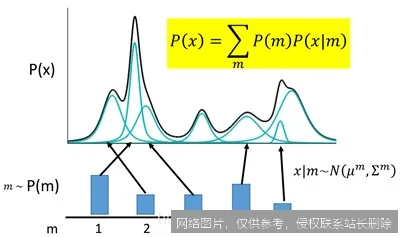

具体工作分为三步:首先,编码器将输入图像(如一张猫图)分析为一系列特征分布的参数(均值和方差),而非一个固定点。其次,VAE从该分布中随机采样一个点,这个采样过程引入了关键的正则化约束,迫使整个潜在空间变得连续且规则。最后,解码器将这个采样点“翻译”回图像,努力重建原始的猫。通过反复训练,模型学会构建一个平滑、结构化的潜在空间,使得空间中的每一个点都对应一张有意义的、合理的猫图,从而实现从任意点采样并生成新图像。

VAE变分自编码器的应用场景

- 数据生成与增强:在图像、音频或文本领域,VAE可以生成与训练数据相似但全新的样本。例如,在药物研发中,用于生成具有特定属性的新分子结构;在游戏开发中,生成多样的纹理或角色面部。

- 数据降维与可视化:VAE学习的连续低维潜在空间,比传统PCA等方法更能捕捉数据的非线性特征,常用于将高维数据(如基因序列、用户行为)降维至二维或三维进行可视化分析。

- 异常检测与数据清洗:由于VAE擅长学习正常数据的概率分布,对于难以重建的输入数据(重建误差高),可以判定其偏离正常模式,从而应用于工业缺陷检测或金融欺诈识别。

相关术语

若想深入理解VAE变分自编码器,可关联学习以下概念:自编码器、生成对抗网络、概率图模型、KL散度、重参数化技巧以及更广泛的生成模型领域。

延伸阅读

建议从原始论文《Auto-Encoding Variational Bayes》入手,这是理解其理论根基的关键。此外,可以查阅关于“证据下界”的教程,以深入掌握其优化目标。在实践中,通过开源框架(如PyTorch、TensorFlow)的VAE实现代码进行调试与实验,能直观感受潜在空间的构建与采样生成过程。

相关推荐

- 【AI词典】ControlNet - 精准控制图像生成的神经网络模型

- 【AI词典】VAE变分自编码器 - 结合概率模型的生成式神经网络

- 【AI词典】GAN生成对抗网络 - 通过对抗训练生成数据的深度学习模型

- 【AI词典】扩散模型 - 一种生成式人工智能算法

- 【AI词典】视觉语言模型VLM - 能同时理解图像与文本的AI模型

- 视频扩散是什么:2026 原理、应用与实战全面解析

- 【AI词典】多模态模型 - 能处理多种类型信息的AI模型

- 【AI词典】对比学习 - 通过对比样本学习表征的自监督方法

- 【AI词典】强化学习 - 通过试错与环境交互的学习方法

- 【AI词典】无监督学习 - 从无标签数据中发现模式的机器学习方法