【AI词典】RAG检索增强生成 - 结合检索与生成的AI技术

AI词典2026-04-19 23:00:00

RAG检索增强生成:定义

RAG(Retrieval-Augmented Generation,检索增强生成)是一种将信息检索系统与大型语言模型(LLM)生成能力相结合的AI技术框架。其核心在于,模型在生成答案前,会先从外部知识库中实时检索相关文档作为依据,从而提升生成内容的准确性、时效性与事实可靠性。

RAG检索增强生成的工作原理

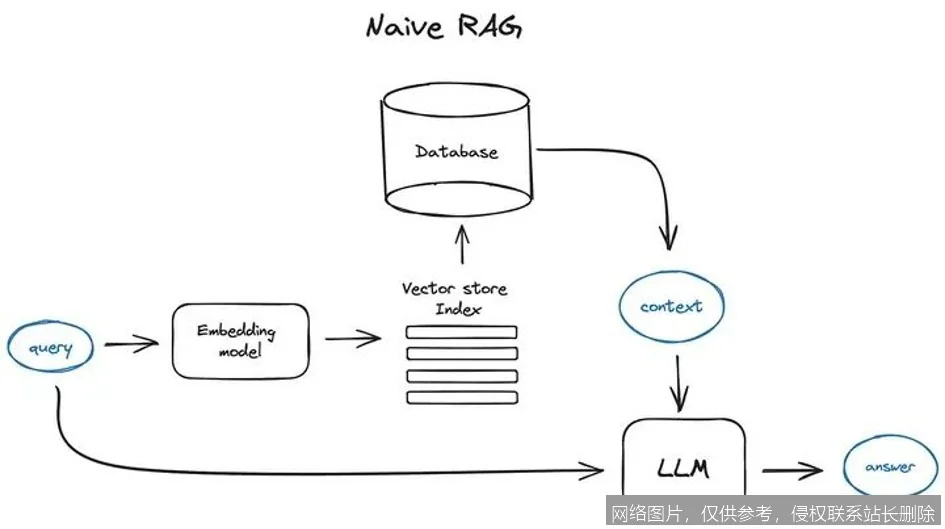

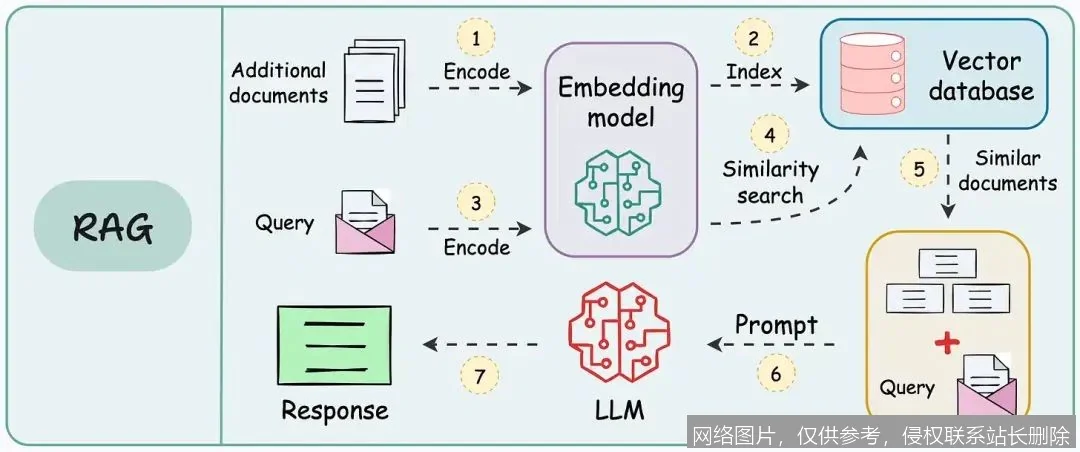

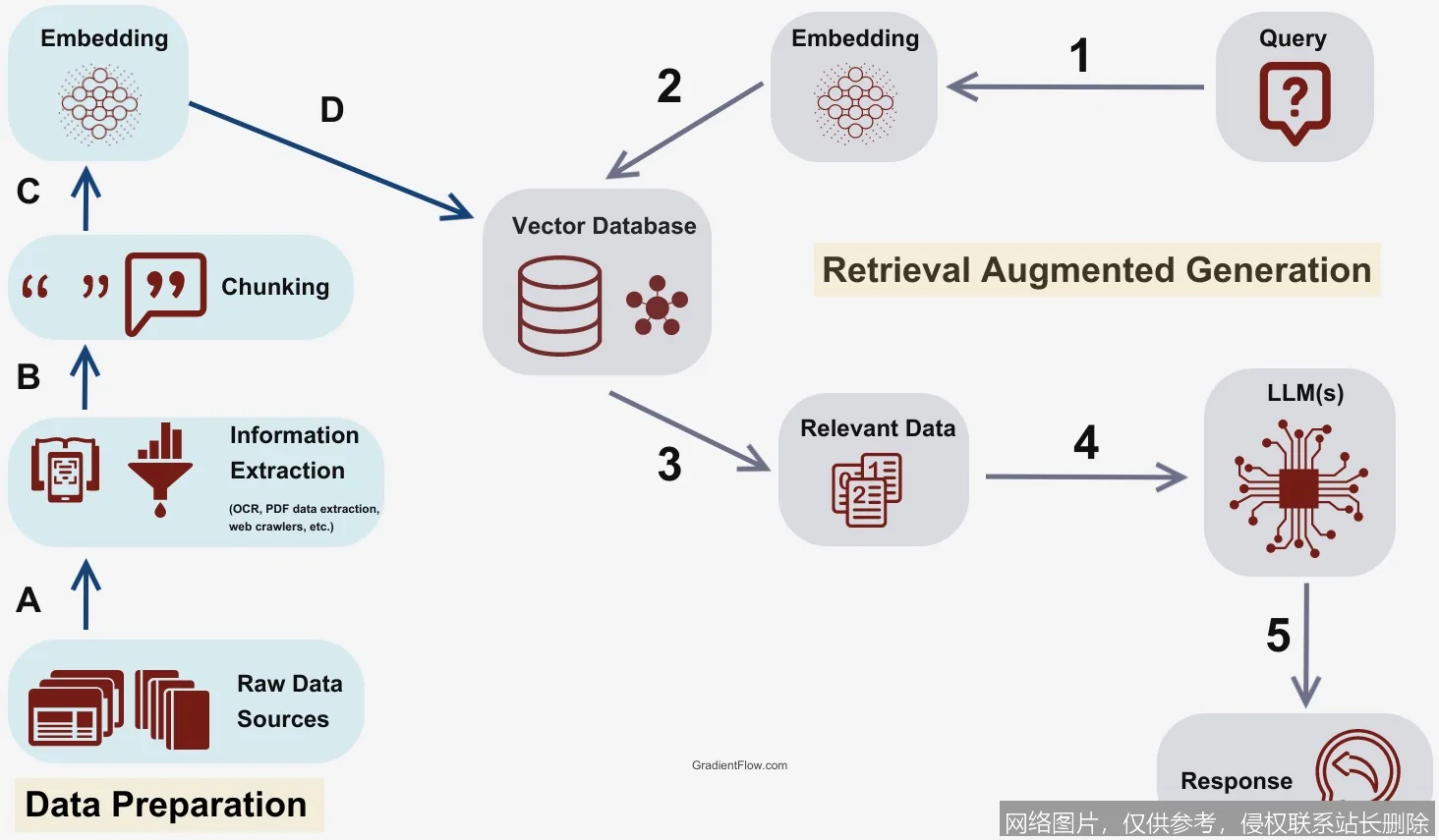

可以将RAG的工作流程类比为一位严谨的学者撰写论文。首先,当用户提出一个问题(查询)时,RAG系统不会直接依赖模型内部记忆“凭空想象”,而是立即启动一个“检索”步骤。系统将用户问题转化为可搜索的格式,在一个庞大的、可更新的外部知识库(如公司文档、专业数据库或最新网页)中进行查找,筛选出与问题最相关的若干文档片段。

随后,这些检索到的权威文档片段,与用户的原始问题一起,被精心组织成一份“上下文提示”,共同输入给大型语言模型。模型的任务转变为:基于这份提供的、最新的、具体的参考资料,进行综合、分析与总结,最终生成一个直接回应问题的答案。这个过程有效分离了“知识存储”(在外部知识库)和“知识运用与表达”(由LLM负责),使得生成结果既具备LLM的流畅与逻辑,又大幅减少了“幻觉”(即编造信息)的风险。

RAG检索增强生成的应用场景

- 智能客服与问答系统:企业可部署RAG系统,将其内部产品手册、技术文档和常见问题解答(FAQ)作为知识库。当客户咨询时,系统能精准检索相关条款和解决方案,生成准确、一致且个性化的回答,极大提升客服效率与专业性。

- 专业研究与内容分析:研究人员或分析师可以向RAG系统输入一个复杂的研究主题。系统能够从海量的学术论文、行业报告或新闻数据库中检索最新信息,并生成包含关键发现、数据对比和引用来源的综合摘要,辅助决策与洞察。

- 个性化内容创作与知识管理:个人或团队可以构建专属知识库(如笔记、项目档案)。RAG能充当一个智能助手,根据自然语言指令(如“总结上周项目会议的要点和待办事项”),快速检索分散信息并生成结构清晰的报告、邮件或方案草案。

相关术语

理解RAG检索增强生成,可关联以下概念:大型语言模型(LLM)、向量数据库、提示工程、幻觉、微调。

延伸阅读

若想深入了解RAG检索增强生成的技术细节与发展前沿,建议查阅相关AI研究机构(如Meta AI,其于2020年提出了经典的RAG论文架构)发布的原始论文,以及关注主流云服务商(如AWS、Azure、Google Cloud)关于构建RAG应用的最佳实践指南。开源框架如LangChain和LlamaIndex也提供了丰富的RAG实现工具与教程,是动手实践的优秀起点。

相关推荐

- 【AI词典】Agent智能体 - 能感知环境并自主行动的智能实体

- 【AI词典】RAG检索增强生成 - 结合检索与生成的AI技术

- 【AI词典】Chain-of-Thought思维链 - 分步推理的提示方法

- 【AI词典】Zero-shot学习 - 无需样本即可识别新类别的机器学习方法

- 生成式AI:颠覆内容创作的智能革命与未来展望

- 【AI词典】Few-shot学习 - 小样本快速适应新任务

- 【AI词典】提示工程 - 优化AI交互的指令设计与调试方法

- 【AI词典】RLHF强化学习 - 基于人类反馈的强化学习方法

- Fine-tuning 微调全面解析:从核心原理到 2026 大模型实战应用

- 【AI词典】Fine-tuning微调 - 预训练模型的针对性优化