【AI词典】Few-shot学习 - 小样本快速适应新任务

Few-shot学习:小样本快速适应新任务

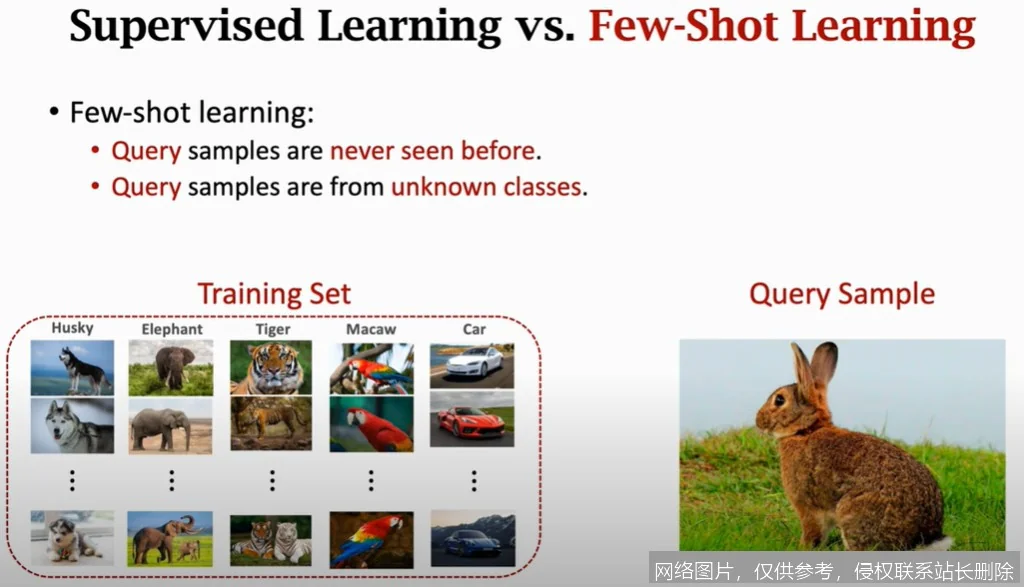

Few-shot学习(Few-shot Learning)是机器学习的一个分支,其核心目标是让模型在仅接触极少量(通常为几个到几十个)新任务样本的情况下,快速学习并完成该任务。它旨在模拟人类从少量示例中举一反三、快速学习新概念的能力,是解决传统深度学习模型依赖海量标注数据这一瓶颈的关键技术方向。

原理:从“知识库”到“快速类比”

Few-shot学习的工作原理可以类比为一个经验丰富的语言学家学习一门新语言。这位语言学家已经掌握了数十种语言的语法和词汇(即“先验知识”)。当他拿到一本新语言的、只有几个例句的短语手册(即“支持集”)时,他不会从零开始,而是迅速将新语言的句子结构与已知语言进行对比和匹配,找出规律,从而快速理解并生成新的句子(即“查询集”的预测)。

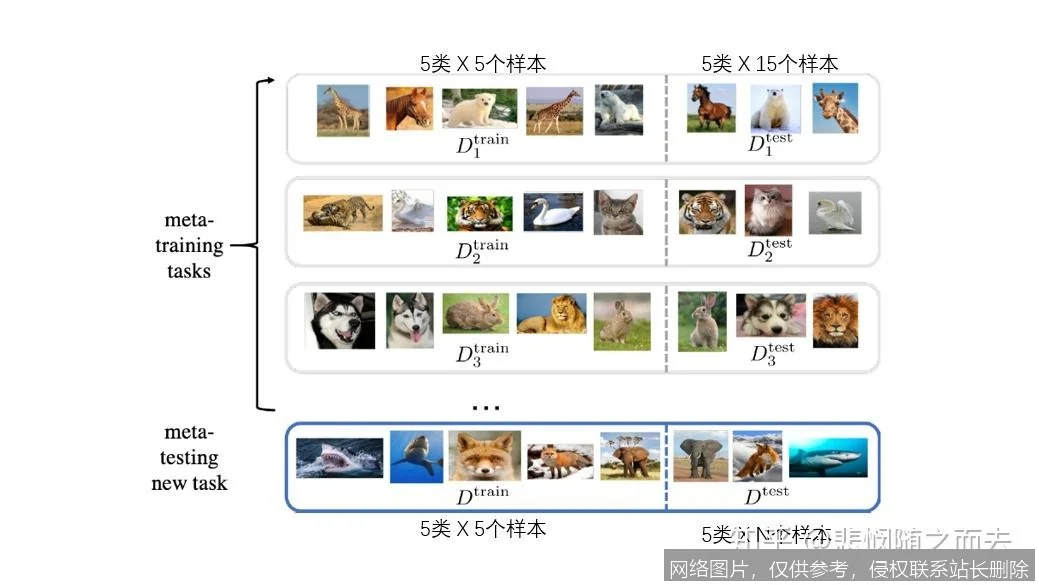

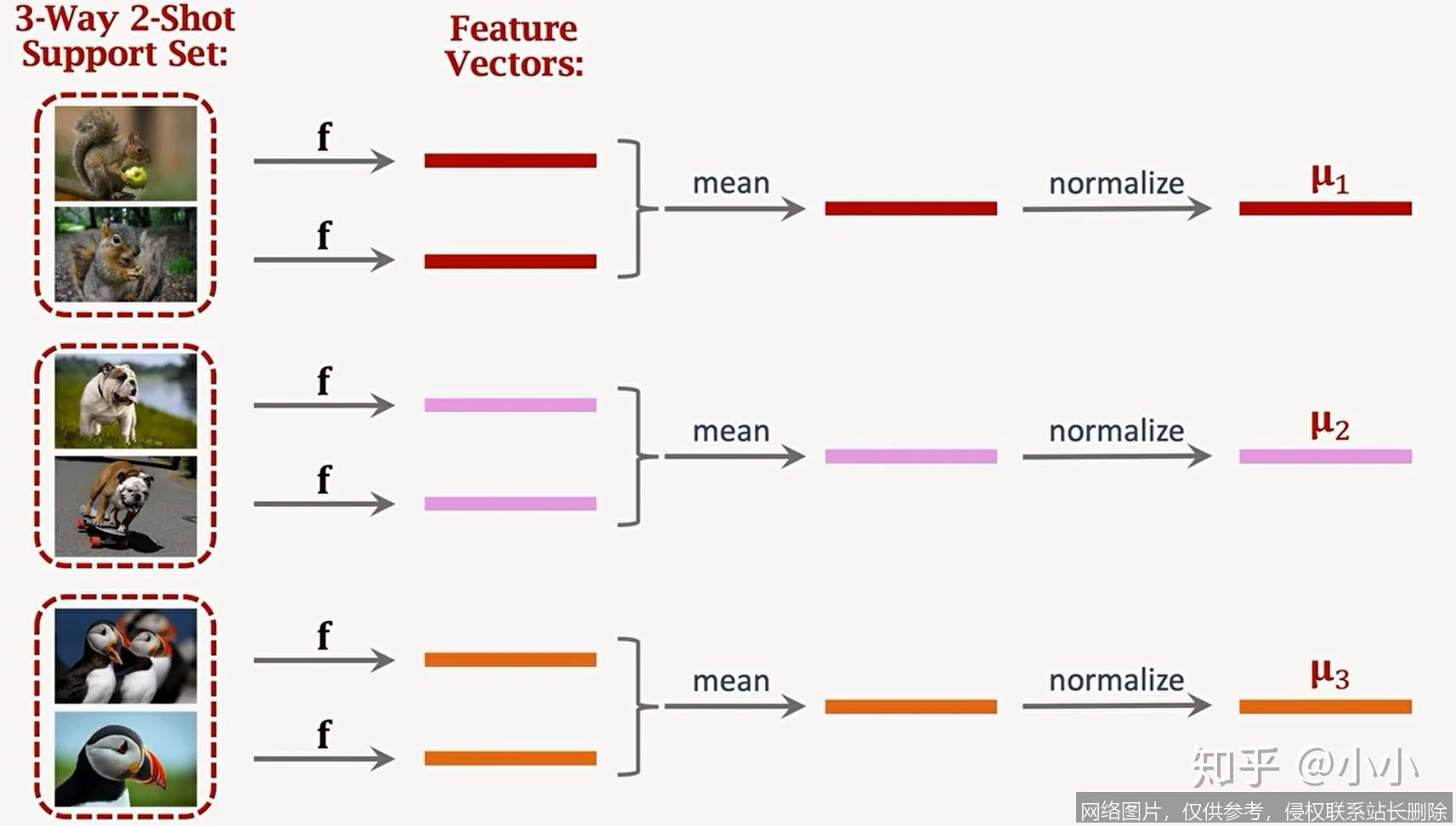

技术上,这一过程通常通过“元学习”框架实现。模型在训练阶段并非学习解决某个具体任务,而是学习“如何快速学习”。它会在大量不同的“小任务”上进行演练,每个小任务都模拟了Few-shot场景。通过这种方式,模型学会提取对任务迁移至关重要的通用特征和比较方法,从而在面对全新的、样本极少的具体任务时,能通过计算新样本与少数示例之间的相似度或快速微调少量参数来做出准确判断。

应用场景

- 图像分类与识别:在工业质检中,针对新出现的、难以收集大量缺陷样本的瑕疵类型,只需提供几张瑕疵图片,Few-shot学习模型就能快速学会识别该新缺陷。同样适用于稀有物种识别、个性化商品识别等场景。

- 自然语言处理:用于快速构建面向特定领域的对话系统或文本分类器。例如,为客服机器人添加处理“国际快递索赔”这一新意图时,只需提供几个该意图的示例对话,模型即可理解并扩展到相似的用户问法,无需标注成千上万条数据。

- 药物发现与生物信息学:针对某些罕见病或新型病原体,已知的有效化合物数据极少。Few-shot学习能够利用已知药物和靶点关系的丰富知识,预测哪些分子可能对新的疾病靶点产生作用,极大加速早期药物筛选过程。

相关术语

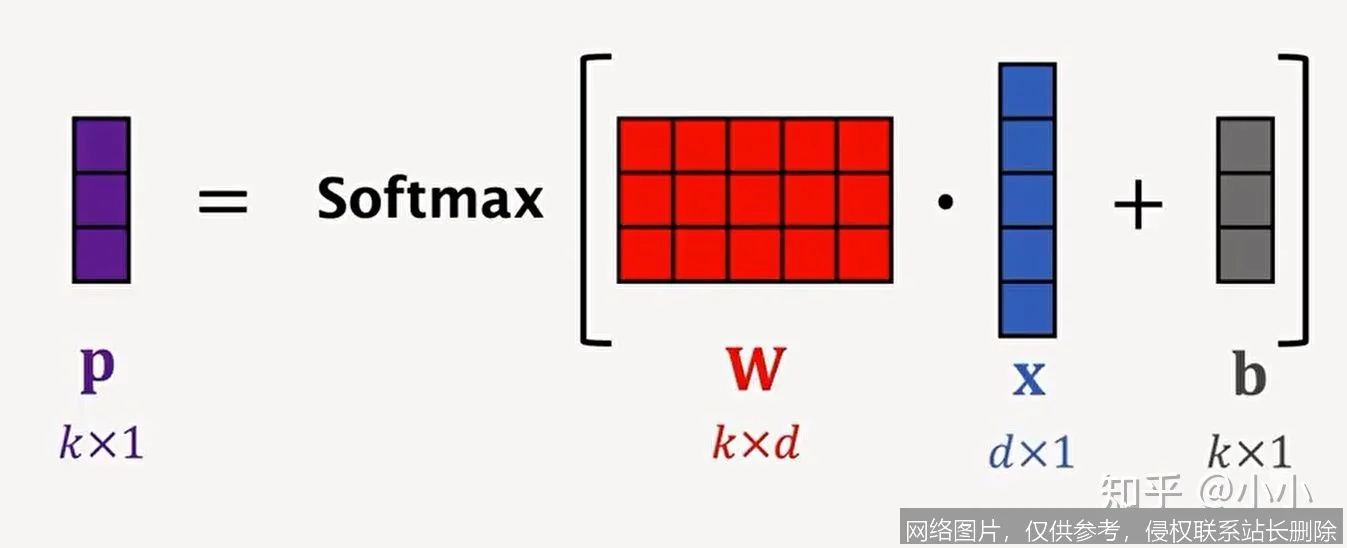

理解Few-shot学习,可关联以下概念:其更极端的形态是 Zero-shot学习(无需任何示例)和 One-shot学习(仅需一个示例);其背后的核心方法论常是 元学习;而与之相对的传统范式则是 监督学习。实现Few-shot学习的一种常见技术路径是 度量学习。

延伸阅读

若想深入了解,建议从经典论文《Model-Agnostic Meta-Learning for Fast Adaptation of Deep Networks》入手,了解元学习如何赋能Few-shot学习。同时,可以关注对比学习、提示学习等新兴技术与Few-shot学习的结合,这些是当前提升小样本泛化能力的研究热点。

相关推荐

- 【AI词典】Chain-of-Thought思维链 - 分步推理的提示方法

- 【AI词典】Zero-shot学习 - 无需样本即可识别新类别的机器学习方法

- 生成式AI:颠覆内容创作的智能革命与未来展望

- 【AI词典】Few-shot学习 - 小样本快速适应新任务

- 【AI词典】提示工程 - 优化AI交互的指令设计与调试方法

- 【AI词典】RLHF强化学习 - 基于人类反馈的强化学习方法

- Fine-tuning 微调全面解析:从核心原理到 2026 大模型实战应用

- 【AI词典】Fine-tuning微调 - 预训练模型的针对性优化

- 【AI词典】Embedding - 将数据映射为低维向量的技术

- 【AI词典】Token - 文本处理的基本语义单元