Token 是什么:从“词元”定义到 2026 年智能时代价值锚点全面解析

一句话定义

Token(词元)是人工智能处理语言的最小计算单元,它将人类自然语言转化为机器可量化、可计算的数字向量,是连接人类思维与硅基智能的通用货币。

技术原理:从字符到向量的数字化跃迁

要真正理解"Token 是什么”,我们必须深入大语言模型(LLM)的“消化系统”。如果把大模型比作一个超级大脑,那么 Token 就是它咀嚼和吞咽的“食物颗粒”。人类习惯于以“字”或“词”为单位进行交流,但计算机本质上只认识数字。Tokenization(分词)技术,正是完成这一跨物种翻译的核心机制。

1. 核心工作机制:破碎与重组的艺术

在传统的编程世界中,代码是以严格的语法结构存在的,编译器能精确识别每一个指令。但在自然语言处理(NLP)领域,情况要复杂得多。人类的语言充满了歧义、缩写、新造词以及多变的语境。为了让模型理解这些内容,工程师们设计了一套精密的“切割”规则。

当一段文本输入到模型中时,首先会经过一个名为 Tokenizer(分词器) 的预处理模块。这个模块并不只是简单地按空格切分单词(这在中文里完全行不通),而是基于统计概率和字典规则,将文本拆解成一个个 Token。这个过程通常遵循以下逻辑:

- 字节对编码(Byte Pair Encoding, BPE):这是目前最主流的分词算法之一(如 GPT 系列所用)。它的原理类似于压缩算法,最初将文本视为单个字符,然后反复合并出现频率最高的字符对,形成新的子词单元。例如,"unbelievable"可能被拆分为 "un"、"believ"、"able"三个 Token,而不是作为一个整体,也不是拆成单个字母。

- WordPiece:Google 的 BERT 模型采用的技术,逻辑与 BPE 类似,但在合并策略上略有不同,更倾向于保留完整的常用词,将生僻词拆解为常见子词。

- Unigram LM:另一种基于概率模型的分词方式,旨在最小化信息的损失。

一旦文本被切分为 Token 序列,分词器会将每个 Token 映射为一个唯一的整数 ID(索引)。例如,在某个特定的词表中,“苹果”可能对应 ID 5023,“手机”对应 ID 8912。随后,这些整数 ID 会被送入模型的嵌入层(Embedding Layer),转化为高维空间中的向量(Vector)。至此,原本感性的语言文字,彻底变成了机器可以进行矩阵运算的数学对象。

2. 关键技术组件:词表与上下文窗口

理解 Token 的运作,离不开两个关键组件:词表(Vocabulary)和上下文窗口(Context Window)。

词表是分词器的“字典”,它定义了模型认识的所有基本单元。不同的模型拥有不同大小的词表。例如,Llama 3 的词表大小约为 128,000,而早期的 GPT-3 约为 50,000。词表越大,模型能用更少的 Token 表示相同的概念,效率越高;但词表过大也会增加模型参数量和推理难度。值得注意的是,词表不仅包含单词和子词,还包含标点符号、特殊控制符(如换行符、结束符)甚至多种语言的字符。

上下文窗口则限制了模型一次能“吃下”多少 Token。这就像人的短期记忆容量。如果模型的上下文窗口是 8,000 Tokens,意味着它一次最多只能处理约 6,000 个英文单词或 3,000-4,000 个汉字(因为中文通常比英文更占 Token)。超过这个长度的内容,模型就会“遗忘”最早输入的部分。这就是为什么在处理长文档时,我们需要滑动窗口或特殊的长文本架构。

3. 与传统方法的对比:为何不再使用“词”?

在深度学习爆发之前,早期的 NLP 研究常以“词(Word)”为基本单位。这种方法存在明显的缺陷,即未登录词(Out-of-Vocabulary, OOV)问题。如果遇到一个词表中没有的新词(比如刚诞生的网络流行语"YYDS"或某个专业术语),传统模型就无法处理,只能将其标记为未知(<UNK>),导致信息丢失。

Token 机制通过引入“子词(Subword)”概念完美解决了这一问题。即使模型从未见过"Transformer 架构”这个词组,它也能通过识别"Trans"、"form"、"er"、“架构”等已知子词单元,推断出其大致含义。这种机制赋予了模型极强的泛化能力和对新词的适应性,是大模型能够理解海量动态知识的基础。

4. 形象类比:乐高积木与分子式

为了更直观地理解,我们可以将 Token 比作乐高积木。人类语言是一座宏伟的城堡,直接搬运整座城堡(整句或整段)对机器来说太重且难以解析。于是,我们将城堡拆解成一块块标准的乐高积木(Token)。机器不需要知道城堡的全貌,它只需要理解每一块积木的形状(向量表示)以及积木之间的拼接逻辑(注意力机制),就能重新搭建出城堡,甚至创造出前所未有的新建筑。

另一个类比是化学中的分子式。水(H₂O)是由氢原子和氧原子组成的。在 AI 眼中,句子就是分子,Token 就是原子。不同的排列组合形成了性质迥异的物质(语义)。改变一个 Token,就像在化学方程式中替换一个元素,可能会让整句话的意思发生翻天覆地的变化,甚至产生“毒性”(有害输出)。

核心概念:构建认知图谱

在掌握了 Token 的基本原理后,我们需要厘清围绕它的一系列核心概念。这些术语构成了理解现代 AI 系统的基石,同时也往往是初学者容易混淆的地方。

1. 关键术语解析

- Tokenization(分词):将原始文本转换为 Token 序列的过程。它是模型推理的第一步,也是数据预处理中最关键的环节。

- Vocabulary Size(词表大小):模型所能识别的不同 Token 的总数。词表大小直接影响模型的压缩率和多语言能力。

- Embedding(嵌入):将离散的 Token ID 映射为连续的稠密向量的过程。在这个高维空间中,语义相似的词(如“国王”和“王后”)其向量距离会更近。

- Context Length / Context Window(上下文长度/窗口):模型单次处理所能容纳的最大 Token 数量。它是衡量模型“记忆力”的核心指标。

- Throughput(吞吐量):通常以 Tokens per Second (TPS) 为单位,衡量模型生成或处理文字的速度。

2. 概念关系图谱

Token 在整个 AI 流水线中处于承上启下的位置:

原始文本 (Raw Text) → [Tokenizer] → Token 序列 (IDs) → [Embedding Layer] → 向量矩阵 (Vectors) → [Transformer Layers] → 预测下一个 Token 的概率分布 → [Sampling] → 输出文本

可以看到,Token 是连接非结构化数据(文本)与结构化计算(矩阵运算)的唯一桥梁。没有 Token,大模型就无法启动。

3. 常见误解澄清

误解一:"1 个 Token 等于 1 个汉字”或"1 个 Token 等于 1 个英文单词”。

事实并非如此简单。对于英文,1 个 Token 平均约等于 4 个字符或 0.75 个单词。对于中文,由于汉字本身信息密度高,分词策略各异,通常 1 个汉字可能对应 1 个 Token,但也可能两个常用字合并为 1 个 Token,或者生僻字被拆解。因此,粗略估算时,中文环境下 1000 Tokens 大约对应 600-800 个汉字,而英文 1000 Tokens 大约对应 750 个单词。

误解二:"Token 越多,模型越聪明”。

Token 数量仅代表信息的粒度或长度,并不直接等同于智能程度。模型的智能取决于其参数规模、训练数据的质量以及架构设计。不过,更多的上下文 Token(长窗口)确实能让模型在处理长文档时表现更好,因为它能“记住”更多前文信息。

误解三:“所有模型的分词方式都一样”。

完全不同。GPT-4、Claude 3、Llama 3 以及国产的大模型(如通义千问、文心一言)都使用各自独立的词表和分词算法。这意味着同一段话,在不同模型眼中,其 Token 数量和具体的 ID 序列是完全不同的。这也是为什么在不同平台测试同样长度的提示词(Prompt),消耗的额度或速度会有差异的原因。

实际应用:从成本核算到智能体经济

Token 不仅仅是一个技术概念,它在实际的 AI 应用开发、商业计费以及未来的经济体系中扮演着至关重要的角色。理解 Token 的运作规律,是高效使用 AI 工具的前提。

1. 典型应用场景

A. API 计费与成本控制

目前绝大多数大模型服务商(如 OpenAI、Anthropic、百度智能云等)均采用“按 Token 计费”的模式。费用通常分为两部分:Input Tokens(输入令牌)和Output Tokens(输出令牌)。通常情况下,生成内容的成本高于阅读内容的成本。开发者必须精确计算应用的 Token 消耗,以优化运营成本。例如,在一个客服机器人场景中,如果历史对话记录过长,会导致每次请求的 Input Tokens 激增,此时就需要采用“摘要压缩”或“滑动窗口”策略来剔除冗余 Token,从而降低成本。

B. 提示词工程(Prompt Engineering)

高质量的 Prompt 往往需要精准控制 Token。由于上下文窗口有限,用户必须学会用最少、最精准的 Token 传达最丰富的指令。这包括去除废话、使用结构化表达、利用少样本学习(Few-Shot Learning)时的案例选择等。懂得“节省 Token"的提示词,不仅能省钱,往往还能提高模型的响应速度和准确率,因为噪声信息减少了。

C. 长文档分析与 RAG(检索增强生成)

在处理法律合同、学术论文或长篇代码库时,如何让模型理解全部内容?这就需要利用长上下文模型的能力。通过将长文档切分成多个 Chunk(片段),每个片段控制在模型窗口允许的 Token 范围内,再进行向量化存储和检索。这里的切分粒度(Chunk Size)直接以 Token 数为单位进行设定,是 RAG 系统性能调优的关键参数。

2. 代表性产品与项目案例

- OpenAI GPT 系列:作为行业标杆,其计费系统清晰地展示了 Input/Output Token 的价格差异。其 Cl100k_base 分词器对代码和多语言的支持极为出色,使得 GPT-4 在编程辅助场景中表现卓越。

- LangChain / LlamaIndex:这些流行的 AI 应用开发框架,内置了复杂的 Token 管理模块。它们能自动计算 Prompt 长度,判断是否超出窗口限制,并自动执行截断或摘要策略,极大地降低了开发者的门槛。

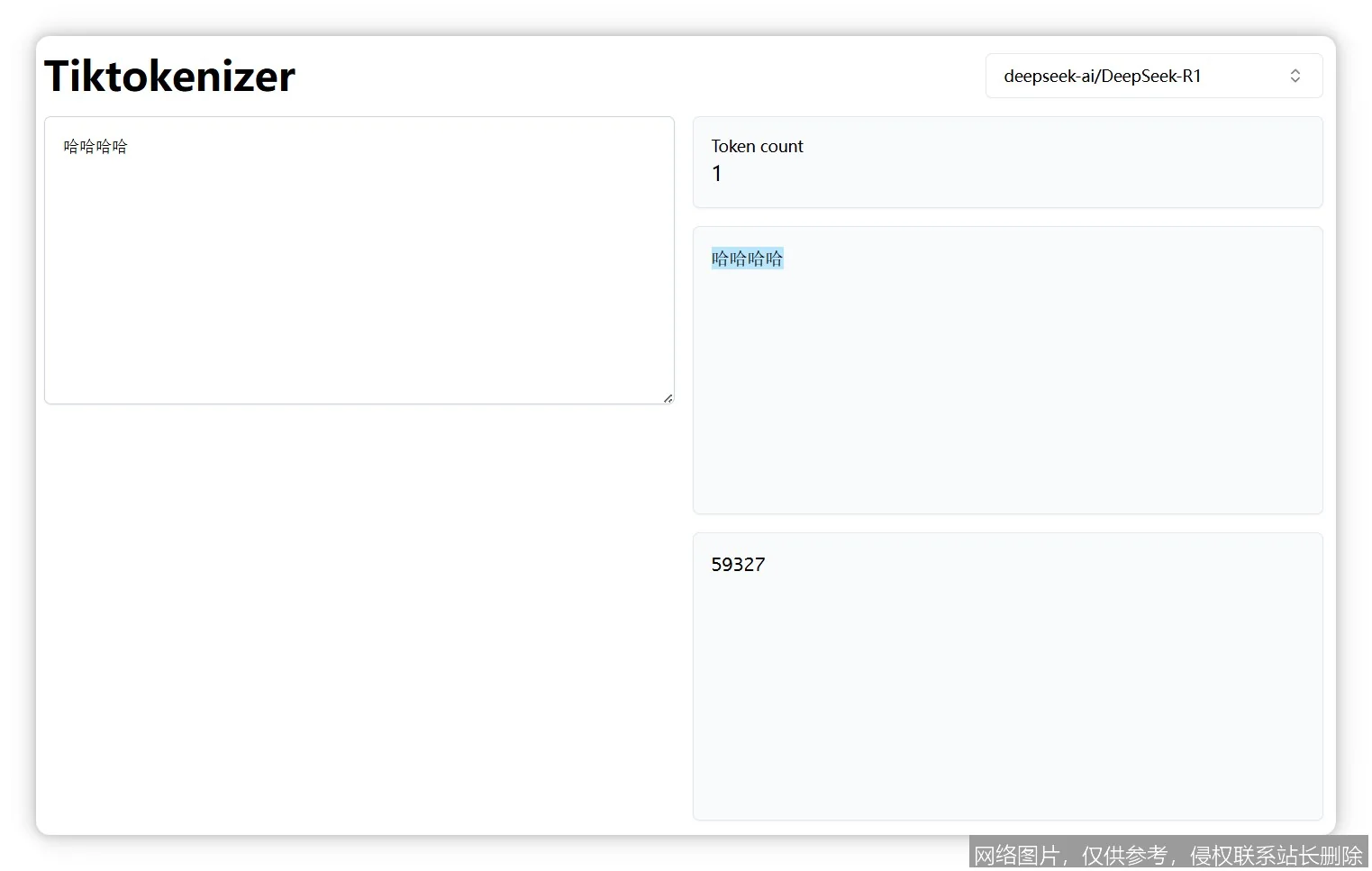

- Tiktoken:OpenAI 开源的快速分词库,允许开发者在本地精确预估任何文本在 GPT 模型中的 Token 数量,是进行成本预算的必备工具。

3. 使用门槛与条件

对于普通用户而言,Token 是透明的,只需关注输入输出的流畅度。但对于开发者和企业用户,掌握 Token 规律有几项硬性条件:

- 估算能力:必须具备将自然语言快速转化为 Token 数量的直觉或工具使用能力,以避免运行时错误(Context Window Exceeded)。

- 多语言敏感度:需意识到不同语言(如中文 vs 英文 vs 代码)在 Token 消耗上的巨大差异,针对目标语言优化数据结构。

- 缓存策略:在高频调用场景下,利用 Prefix Caching(前缀缓存)技术,复用已计算过的 Input Tokens 状态,可大幅降低延迟和成本。

延伸阅读:通向 2026 智能时代的价值锚点

当我们站在 2024 年展望 2026 年,Token 的定义正在发生深刻的演变。它正从一个单纯的技术计量单位,逐渐演变为智能时代的“价值锚点”乃至“通用货币”。

1. 相关概念推荐

若想进一步深入研究,建议关注以下前沿概念:

- Mixture of Experts (MoE):稀疏混合专家模型。这种架构允许模型在处理不同 Token 时动态激活不同的参数子集,极大地提高了计算效率,是未来超大模型的主流方向。

- Speculative Decoding(投机解码):一种加速推理的技术,用小模型先预测几个 Token,大模型再进行验证,从而提升 TPS(每秒 Token 数)。

- World Models(世界模型):超越文本 Token,将视频、动作、物理规律也离散化为 Token,让 AI 像人类一样通过“想象”来规划行动。

2. 进阶学习路径

对于希望从应用层走向底层的研究者,建议的学习路径如下:

- 基础阶段:熟练掌握 Python 及 Hugging Face Transformers 库,动手实践不同分词器(BPE, WordPiece)的代码实现。

- 进阶阶段:研读《Attention Is All You Need》原文,深入理解 Transformer 架构中 Embedding 层与 Positional Encoding 的数学原理。

- 专家阶段:关注顶级会议(NeurIPS, ICML, ACL)关于高效分词、多模态 Token 化以及无限上下文窗口的最新论文。

3. 2026 展望:Token 作为价值锚点

展望未来两年,随着 AI Agent(智能体)的普及,Token 的内涵将发生质变。

首先,多模态融合将使 Token 不再局限于文本。图像将被切割为 Visual Tokens,音频被转化为 Audio Tokens,视频则是时空 Token 的集合。所有的感官体验都将被统一在同一套 Token 体系下,实现真正的“万物皆可 Token 化”。

其次,经济属性的凸显。在去中心化的 AI 网络中,Token 可能直接与算力消耗、知识产权贡献挂钩。每一次模型的推理、每一次数据的训练,都以 Token 为最小结算单位。未来的互联网经济,可能是一种基于"Proof of Token"的微支付体系。用户不再为软件付费,而是为消耗的 Intelligence(智能量,以 Token 计量)付费。

最后,语义压缩的极限突破。随着算法的进化,单个 Token 所承载的信息密度将大幅提升。也许在 2026 年,一个 Token 就能代表一个复杂的逻辑推理链条或一段完整的情感体验。那时的 AI,将以更少的计算资源,涌现出更接近人类甚至超越人类的智慧。

综上所述,Token 虽小,却蕴含着撬动整个智能时代的杠杆力量。它是机器理解世界的起点,也是我们衡量智能价值的标尺。深入理解 Token,就是掌握了通往未来人机协作社会的钥匙。

4. 推荐资源与文献

- 官方文档:OpenAI Tokenizer Guide, Hugging Face Tokenizers Documentation.

- 经典论文:"Neural Machine Translation of Rare Words with Subword Units" (Sennrich et al., 2015) - BPE 的奠基之作。

- 工具库:Tiktoken (Python), SentencePiece (Google).

- 深度解读:Andrej Karpathy 的博客及视频教程(特别是关于 LLM 底层原理的系列讲解)。