交叉验证是什么:原理、算法演进与 2026 年实战应用全面解析

一句话定义

交叉验证(Cross-Validation)是一种通过将数据集多次划分为训练集与验证集,以评估模型泛化能力并优化超参数的统计学方法。

在人工智能与机器学习的宏大叙事中,我们往往沉迷于构建更深的神经网络、设计更复杂的算法架构,却容易忽视一个最朴素却至关重要的问题:“这个模型真的学会了吗?还是仅仅背下了答案?”交叉验证,正是为了解决这一核心痛点而诞生的“试金石”。它不仅仅是一个技术步骤,更是连接理论模型与现实世界不确定性的桥梁。本文将深入剖析交叉验证的本质,从其在 20 世纪 70 年代的统计学起源,到 2026 年大模型时代的演化应用,为您呈现一份关于模型评估的终极指南。

技术原理:从“一次性赌博”到“多重保险”

要理解交叉验证(Cross-Validation, CV)的核心工作机制,我们首先需要回顾传统的模型评估方法,并看清其致命的缺陷。

1. 传统方法的困境:Holdout 法的局限

在机器学习早期,最直观的评估方式是“留出法”(Holdout Method)。我们将手头的数据简单粗暴地切分为两部分:比如 70% 作为训练集(Training Set),用来教模型;30% 作为测试集(Test Set),用来考模型。这听起来很合理,就像学生平时做题(训练)和期末考试(测试)。

然而,这种方法存在两个巨大的隐患:

- 数据划分的偶然性(Variance due to Splitting):如果那 30% 的测试集恰好全是简单样本,模型得分会虚高;反之,如果全是难样本,模型会被误判为无能。这种评估结果高度依赖于“运气”,缺乏稳定性。

- 数据浪费(Data Wastage):在数据稀缺的年代(如医疗影像、罕见故障检测),保留 30% 的数据仅用于测试而不参与训练,是对宝贵信息的极大浪费,可能导致模型因训练不足而无法收敛。

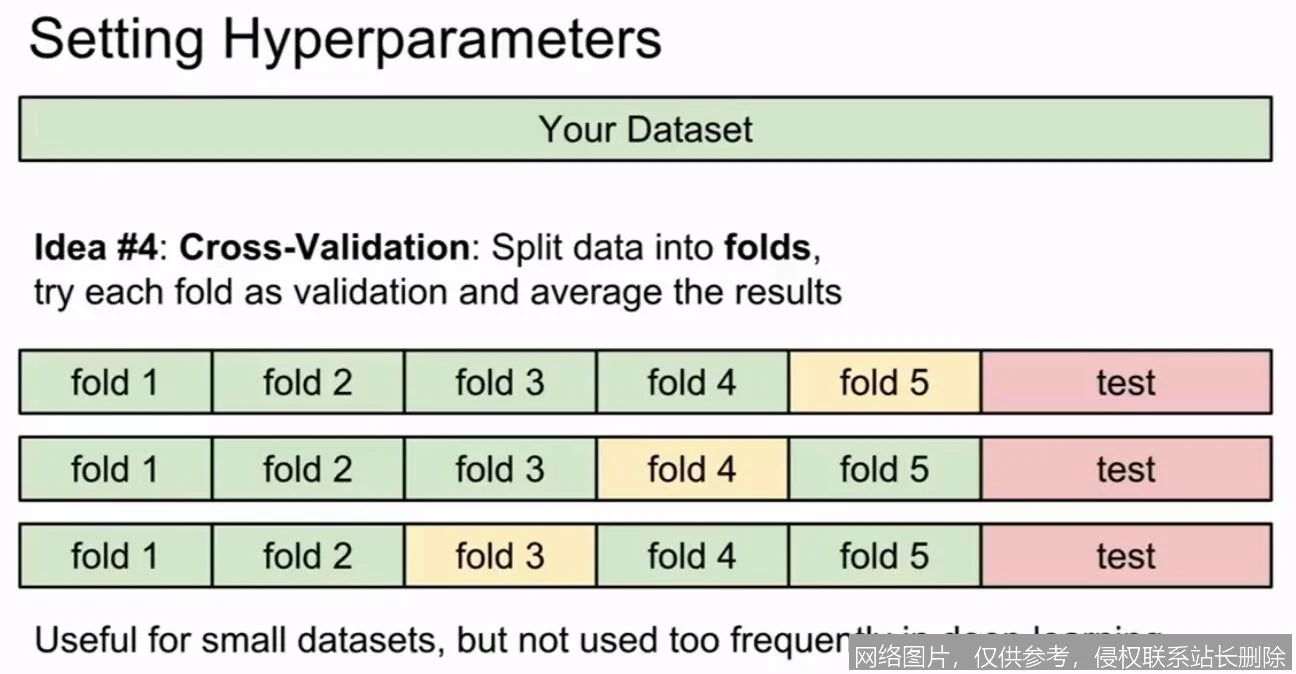

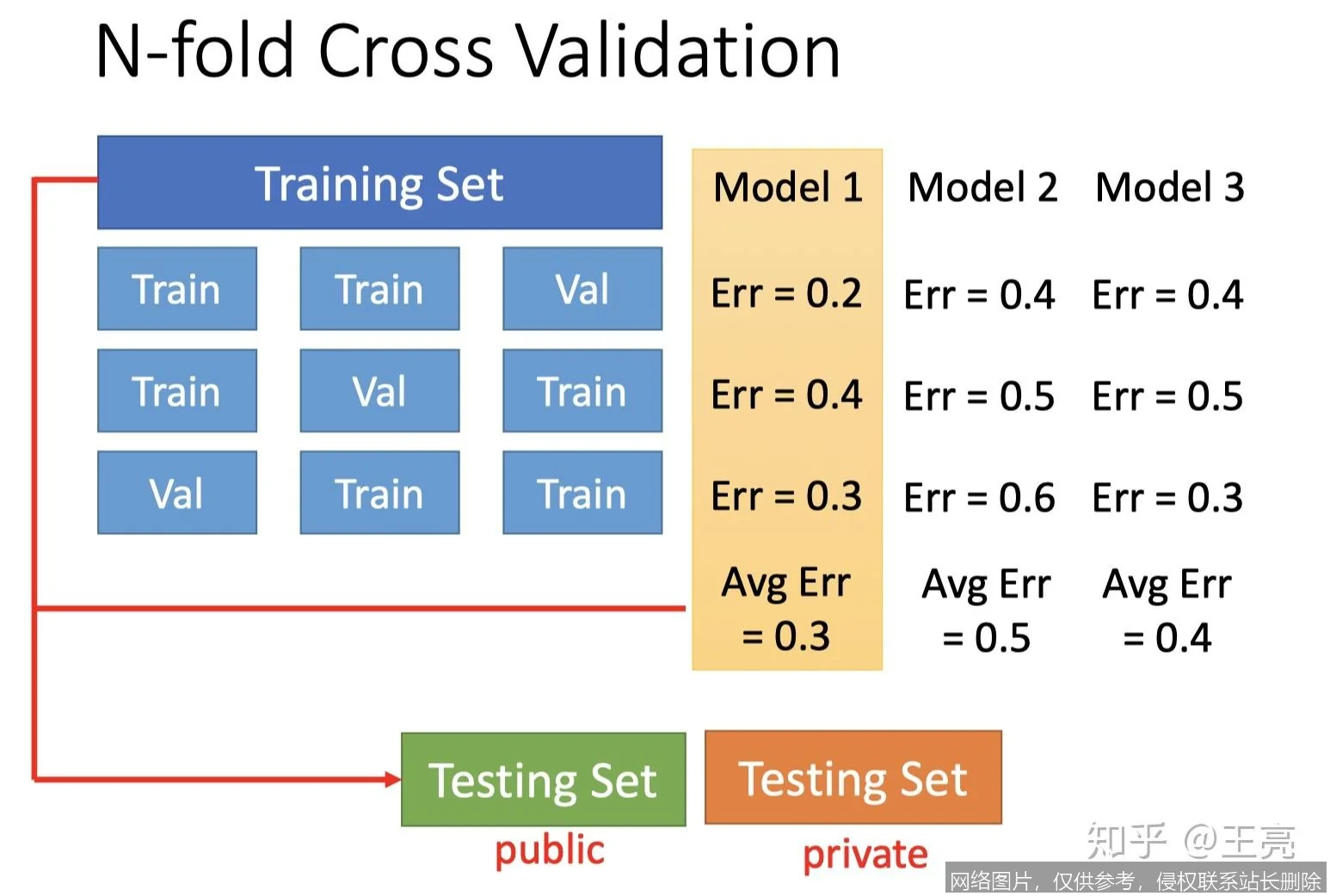

2. 核心机制:K 折交叉验证(K-Fold Cross-Validation)

为了解决上述问题,统计学家提出了交叉验证的思想,其中最具代表性的是K 折交叉验证。其工作流程可以形象地比喻为“轮值考官制度”:

- 数据分桶:将整个数据集 $D$ 随机均匀地划分为 $K$ 个互斥的子集(称为“折”,Folds),记为 $D_1, D_2, ..., D_K$。通常 $K$ 取 5 或 10。

- 轮转训练与验证:进行 $K$ 轮实验。在第 $i$ 轮中:

- 选取 $D_i$ 作为验证集(Validation Set),充当“考官”。

- 将其余 $K-1$ 个子集合并作为训练集(Training Set),用来“教学”。

- 训练模型后,在 $D_i$ 上进行评估,得到性能指标 $Acc_i$。

- 结果聚合:重复上述过程 $K$ 次,确保每个子集都做过一次“考官”。最终模型的评估结果是这 $K$ 次指标的算术平均值:

$$ Acc_{CV} = \frac{1}{K} \sum_{i=1}^{K} Acc_i $$ - 分层采样(Stratified Sampling):在处理分类问题时,简单的随机划分可能导致某一折中某些类别的样本极少甚至缺失(例如在欺诈检测中,黑样本本身就少)。分层 K 折交叉验证(Stratified K-Fold)强制要求每一折中的类别比例与原始数据集保持一致,确保评估的公正性。

- 随机种子(Random Seed):为了保证实验的可复现性(Reproducibility),在打乱数据顺序时必须固定随机种子。否则,不同的运行次数可能会得到略有差异的 CV 分数。

- 嵌套交叉验证(Nested Cross-Validation):当我们需要同时选择模型和优化超参数时,单层 CV 会导致“数据泄露”(Data Leakage)。嵌套 CV 使用外层循环评估模型性能,内层循环进行超参数搜索,是获取无偏估计的金标准。

- 泛化误差(Generalization Error):这是交叉验证试图估算的核心目标。它指模型在未见过的全新数据上的表现误差。训练误差低不代表泛化误差低(即过拟合),交叉验证提供的就是泛化误差的无偏估计。

- 偏差 - 方差权衡(Bias-Variance Tradeoff):

- 偏差(Bias):模型预测值与真实值的偏离程度。$K$ 值越大(如留一法 LOOCV),训练集越接近全集,偏差越小。

- 方差(Variance):模型对训练数据变动的敏感程度。$K$ 值越大,各折之间的训练集重叠度越高,导致评估结果的方差可能增大(因为各次实验相关性高)。

选择合适的 $K$ 值(通常 5 或 10)就是在偏差和方差之间寻找最佳平衡点。

- 超参数(Hyperparameters):模型训练前需设定的参数(如决策树的深度、神经网络的层数、学习率)。交叉验证是寻找最优超参数组合的主要手段,常与网格搜索(Grid Search)或贝叶斯优化结合使用。

- 数据泄露(Data Leakage):指验证集的信息“偷跑”到了训练过程中。例如,如果在做交叉验证前先对整个数据集进行了归一化(计算了全局均值和方差),那么验证集的统计特征就已经被训练集“知晓”了,导致评估结果过于乐观。正确的做法是在每一折的训练过程中,仅基于当前训练集计算统计量。

- 小样本医疗诊断:在罕见病识别中,数据量可能仅有几百例。此时,10 折甚至留一法交叉验证是唯一可行的评估手段,以确保每一例病患数据都被充分利用于训练和验证,避免模型因数据匮乏而失效。

- 金融风控建模:银行在构建信用评分卡时,必须使用分层交叉验证(Stratified K-Fold),因为违约用户(负样本)占比极低。若不分层,某些折中可能完全没有违约样本,导致模型无法学习风险特征。

- 时间序列预测:股票价格、销量预测等场景不能使用随机 K 折,因为这会破坏时间因果性(用未来的数据预测过去)。此时需采用滚动窗口交叉验证(Rolling Window CV)或扩展窗口法(Expanding Window CV),严格保证训练集时间在验证集之前。

- 基于代理模型的快速筛选(Proxy-based Screening):在大规模超参数搜索初期,不再直接对全量大模型进行 CV。而是先在小型代理模型(如蒸馏后的小模型或少量 Epoch 的模型)上进行快速的 5 折交叉验证,筛选出有潜力的超参数组合,再在全量大模型上进行单次验证。

- 提示工程中的交叉验证(Prompt CV):在 RAG(检索增强生成)和 Agent 应用中,"模型"往往变成了"提示词模板 + 检索策略"。开发者会将测试问题集划分为 $K$ 份,轮流验证不同的 Prompt 版本和检索库配置。这种"Prompt 交叉验证”成为了优化 LLM 应用稳定性的标准动作,用于评估模型在不同问题分布下的鲁棒性,防止过拟合特定的提问方式。

- 联邦学习中的跨设备验证(Cross-Device Validation):在隐私计算和联邦学习场景下,数据分散在成千上万个用户设备上。2026 年的交叉验证演变为“跨客户端验证”:选取一部分客户端作为验证节点,其余作为训练节点,轮转进行。这不仅能评估模型的泛化能力,还能检测设备间的数据异构性(Non-I.I.D.)对模型的影响。

- 自动化机器学习(AutoML)的内核:现代 AutoML 平台(如 2026 版的 H2O.ai, DataRobot 或云厂商内置工具)已将嵌套交叉验证封装为默认配置。用户无需手动编写循环,系统自动在后台并行执行数百种模型配置的 CV 评估,并利用早停机制(Early Stopping)剪枝劣质方案,极大地降低了使用门槛。

- 自助法(Bootstrapping):另一种重采样技术,通过有放回抽样构建多个训练集,常用于估计统计量的置信区间,与交叉验证互为补充。

- 混淆矩阵(Confusion Matrix)与 ROC 曲线:交叉验证给出的是一个平均分数,而深入分析每一折的混淆矩阵和 AUC 值,能帮你发现模型在特定类别上的短板。

- 贝叶斯优化(Bayesian Optimization):比网格搜索更高效的超参数调优方法,常与交叉验证配合使用,以更少的试验次数找到全局最优解。

- 基础阶段:熟练掌握 Python 的

scikit-learn库,动手实现cross_val_score,GridSearchCV等函数,理解cv参数的各种设置。 - 进阶阶段:研究时间序列交叉验证(

TimeSeriesSplit)和分组交叉验证(GroupKFold)的代码实现,阅读关于偏差 - 方差分解的数学推导。 - 高阶阶段:探索嵌套交叉验证在复杂 Pipeline 中的应用,研究在分布式训练框架(如 PyTorch Distributed, TensorFlow Strategy)下如何高效并行化交叉验证过程。

- 经典论文:Geisser, S. (1975). "The Predictive Sample Reuse Method with Applications". Journal of the American Statistical Association. 这是交叉验证理论的奠基之作。

- 权威教材:The Elements of Statistical Learning (Hastie, Tibshirani, Friedman). 第 7 章详细论述了模型评估与选择的理论,是每一位数据科学家的必读圣经。

- 实战文档:Scikit-learn 官方文档中的 "Cross-validation: evaluating estimator performance" 章节,提供了最规范的代码示例和陷阱警示。

- 前沿博客:关注 Towards Data Science 或 Medium 上关于 "LLM Evaluation" 和 "Robustness in AI" 的最新文章,了解 2026 年大模型评估的新趋势。

通过这种机制,每一个数据点既参与了训练,也参与了一次验证。这不仅消除了单次划分的偶然性,还最大限度地利用了所有数据。

3. 关键技术组件解析

在深入算法演进之前,我们需要明确支撑交叉验证运行的几个关键组件:

4. 类比理解:美食家的品鉴之道

想象你是一位美食评论家,需要评价一位厨师的水平。

Holdout 法相当于只让厨师做一道菜给你吃。如果他今天状态好,或者刚好做了你爱吃的菜,你会给他高分;反之则低分。这显然不公平。

K 折交叉验证则是让厨师连续做 $K$ 顿饭,每顿饭的食材组合不同(训练集不同),且每顿饭你都会品尝其中的一道特色菜(验证集)。最后,你根据这 $K$ 顿饭的平均表现来给厨师打分。这样,无论食材如何变化,无论哪道菜被抽查,都能真实反映厨师的综合实力。

核心概念:构建评估体系的认知地图

掌握交叉验证,不仅需要知道怎么做,更需要理解其背后的概念网络。以下是该领域必须厘清的关键术语及其相互关系。

1. 关键术语详解

2. 概念关系图谱

我们可以将交叉验证视为一个枢纽,连接着数据、模型与评估:

[原始数据] --> (划分策略:K-Fold/LOOCV/TimeSeries) --> [训练集 + 验证集]

|

v

[模型架构] + [超参数空间] --(网格搜索/随机搜索)--> [训练过程] --> [性能指标均值]

^

|

(防止数据泄露)

在这个链条中,交叉验证不仅是评估工具,更是模型选择(Model Selection)的决策依据。

3. 常见误解澄清

误解一:“交叉验证分数越高,模型上线效果一定越好。”

澄清:不一定。如果数据分布随时间变化(非平稳分布),或者线上环境与离线数据存在域偏移(Domain Shift),即使 CV 分数很高,上线后也可能崩塌。交叉验证假设训练数据和测试数据服从独立同分布(I.I.D.),这一假设在现实世界中常被打破。

误解二:"K 值越大越好,留一法(LOOCV)最准确。”

澄清:留一法(Leave-One-Out, $K=N$)虽然偏差最小,但计算成本极高(需训练 $N$ 次模型),且由于各次训练集高度重合,评估结果的方差反而可能很大。对于大数据集,LOOCV 既不经济也不必要。

误解三:“交叉验证可以替代独立的测试集。”

澄清:绝对不能。交叉验证用于模型选择和调参,在这个过程中,模型已经间接“看到”了验证集的信息。因此,最终必须保留一个完全未参与的“独立测试集”(Hold-out Test Set),用于在模型定型后进行最后一次“盲测”,以模拟真实的上线环境。

实际应用:从经典机器学习到 2026 年前沿实战

交叉验证的应用场景随着 AI 技术的发展不断演变。从传统的表格数据挖掘到 2026 年的大模型微调,其形态虽有所调整,但核心逻辑依然坚挺。

1. 典型应用场景

2. 2026 年实战演进:大模型时代的交叉验证

进入 2026 年,随着大语言模型(LLM)和多模态模型成为主流,交叉验证的应用形式发生了深刻变化,但其精神内核并未消失,而是融入了新的工作流中。

挑战:传统的 K 折交叉验证在千亿参数模型面前显得力不从心。训练一个大模型可能需要数周时间和数百万美元算力,重复训练 $K$ 次在经济和时间上都是不可接受的。

2026 年新范式:

3. 代表性案例:某自动驾驶感知系统的迭代

2025 年,某头部自动驾驶公司在升级其雨雪天气感知算法时,面临极端天气数据稀缺的问题。团队采用了加权分层 K 折交叉验证。

实施细节:他们将罕见的“暴雪”场景样本权重调高,并在划分折时强制保证每折包含相同比例的极端天气帧。同时,结合仿真引擎生成的合成数据进行混合验证。

成效:通过这种方式,团队在未增加实车采集成本的前提下,将模型在极端天气下的误检率降低了 40%,且确保了模型不会过度拟合合成数据的纹理特征。这一案例证明了在数据分布不均的高阶场景中,定制化交叉验证策略的决定性作用。

4. 使用门槛与条件

尽管交叉验证功能强大,但在实际落地中仍需满足以下条件:

计算资源:对于深度学习模型,需具备分布式训练能力以并行处理 $K$ 个任务,否则时间成本过高。

数据独立性:必须确保样本间相互独立。若数据存在群组效应(如来自同一患者的多张切片),必须进行“组级交叉验证”(Group K-Fold),防止同一组数据既在训练集又在验证集,造成严重的评估虚高。

代码规范:需严格遵循 Scikit-learn 等主流库的最佳实践,避免在预处理阶段发生数据泄露。

延伸阅读:通往专家之路

交叉验证只是模型评估体系中的一环。若想在这一领域达到精通,建议沿着以下路径深入学习。

1. 相关概念推荐

2. 进阶学习路径

3. 推荐资源与文献

结语:在人工智能飞速迭代的今天,算法层出不穷,架构日新月异。但无论技术如何演进,“诚实评估”始终是构建可靠 AI 系统的基石。交叉验证,作为这一基石上的核心工艺,提醒我们保持谦逊与严谨——只有在多重考验下依然稳健的模型,才配得上走向真实世界的广阔舞台。