LMSYS Chatbot Arena 是什么?全球最强大模型竞技场一文搞懂:从评测原理到实战用法

LMSYS Chatbot Arena 已成为全球人工智能领域最权威的“试金石”。在 2026 年的今天,当各大科技巨头争相发布新一代大语言模型(LLM)时,开发者、企业决策者乃至普通用户,第一反应不再是查看枯燥的静态基准测试分数,而是直奔 LMSYS Chatbot Arena(现常被称为 LMArena),查看其实时动态排行榜。这个由加州大学伯克利分校、加州大学圣地亚哥分校和卡内基梅隆大学研究人员共同创立的平台,究竟有何魔力?它如何从一个小众学术项目成长为估值 17 亿美元的独角兽?本文将深度解析其评测原理、最新生态变化、实战用法以及背后的技术架构,带你一文搞懂这个全球最强大的模型竞技场。

一、什么是 LMSYS Chatbot Arena?AI 界的“罗马斗兽场”

LMSYS Chatbot Arena 是一个基于众包(Crowdsourcing)机制的大语言模型评估平台。与传统通过固定题库(如 MMLU、GSM8K)进行“考试式”评分不同,Arena 采用的是“擂台式”真人 PK 模式。

在这个平台上,用户输入一个提示词(Prompt),系统会随机调用两个匿名的模型生成回答。用户在不知道模型身份的情况下,对两个回答进行投票,选择更符合自己偏好的那个。投票结束后,模型的真实身份才会揭晓。这种双盲测试(Double-Blind Test)机制,极大地消除了品牌偏见和位置偏见,确保了评估的客观性。

自 2023 年 5 月诞生以来,LMArena 已经彻底改变了 AI 行业的评估标准。截至 2026 年初,该平台已累计评估超过 400 个模型,收集了数千万次人类偏好投票。就在 2026 年开年,运营该平台的团队正式宣布完成 1.5 亿美元的 A 轮融资,估值飙升至 17 亿美元,标志着其从开源项目成功转型为具有巨大商业价值的行业基础设施。

1.1 为什么传统基准测试“失效”了?

在 Chatbot Arena 出现之前,业界主要依赖静态数据集来评估模型能力。然而,随着大模型能力的爆发,这些传统测试逐渐暴露出严重缺陷:

- 数据污染(Data Contamination): 许多模型在训练阶段就已经“背过”了测试题的答案,导致分数虚高,无法反映真实推理能力。

- 缺乏多样性: 静态题库难以覆盖真实世界中千变万化的用户指令,尤其是创意写作、复杂逻辑推理和多轮对话场景。

- 与人类偏好脱节: 一个模型可能在数学题上得满分,但在对话中显得生硬、啰嗦甚至带有攻击性,这在静态测试中无法体现。

LMSYS Chatbot Arena 的核心价值在于它直接测量人类偏好(Human Preference)。正如前特斯拉 AI 总监 Andrej Karpathy 在 2023 年底所推崇的,这是少数值得信任的 LLM 评测方式之一,因为它反映了模型在“野外的真实表现”(In the Wild)。

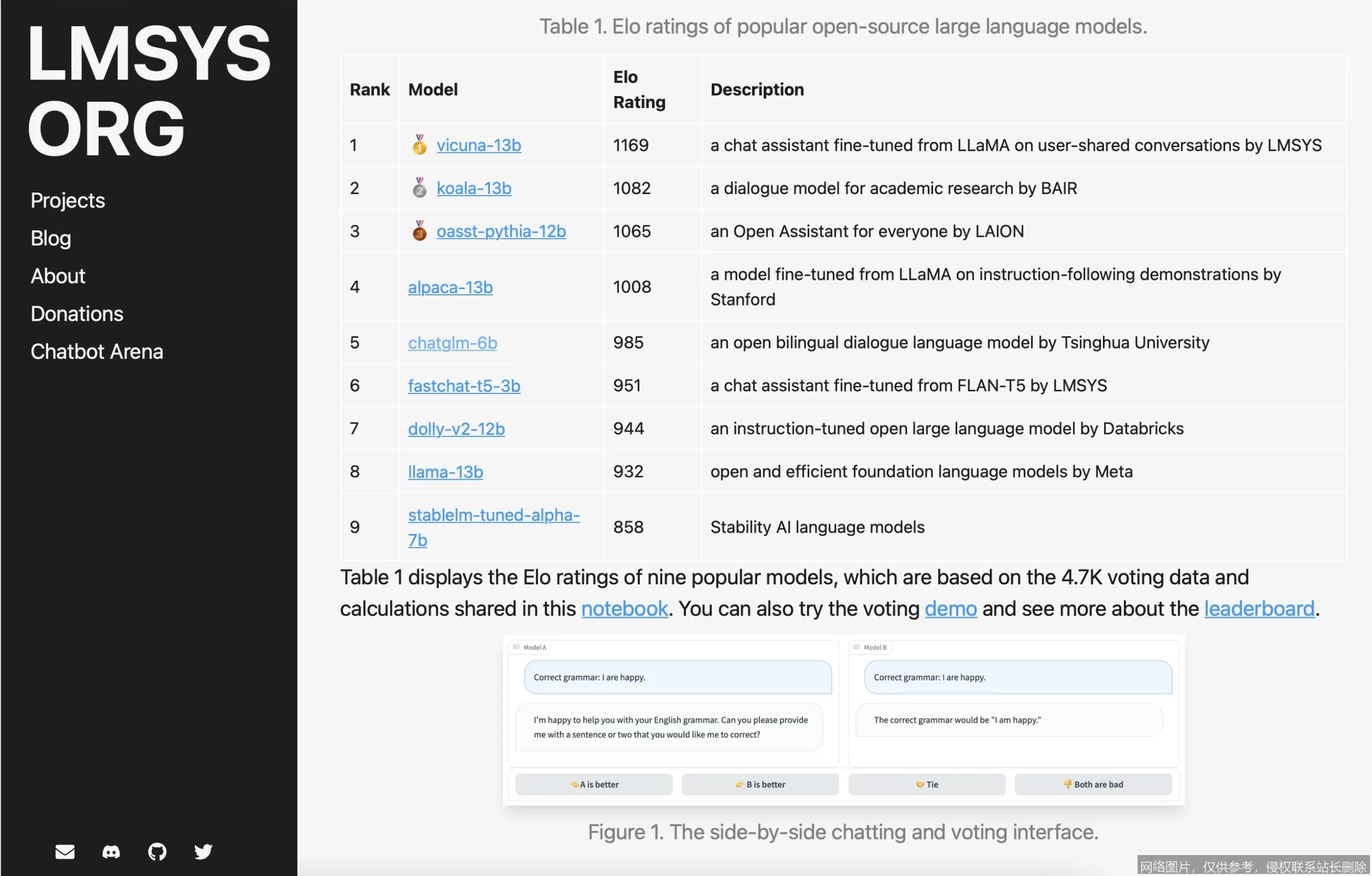

二、核心评测机制:Elo 评分系统与 Bradley-Terry 模型

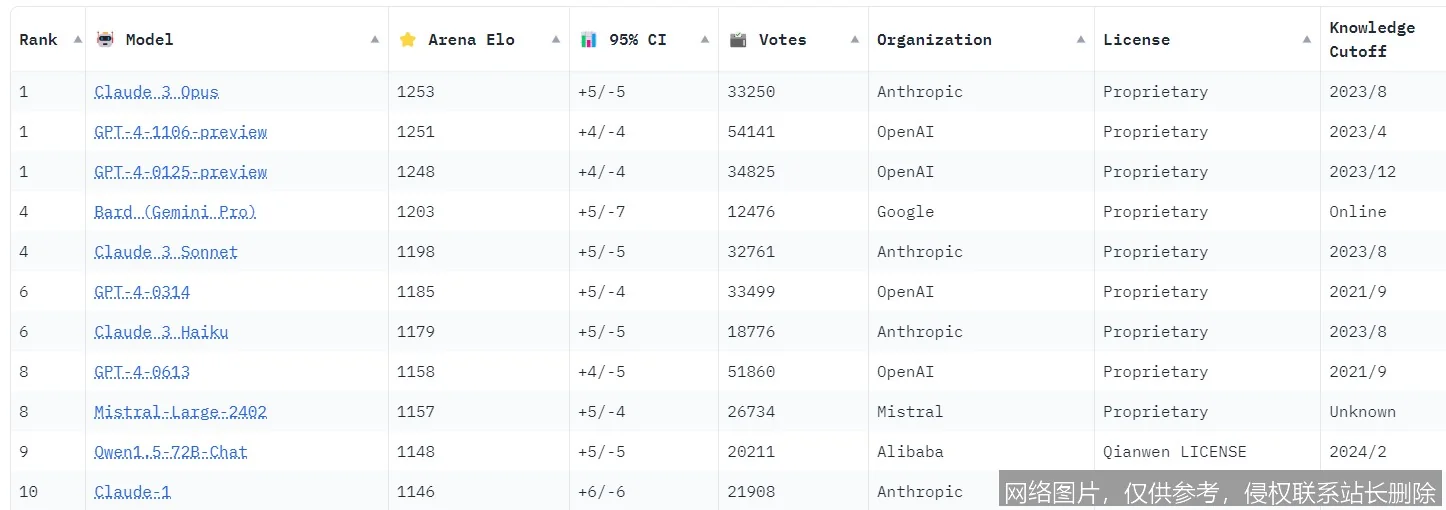

LMArena 之所以能生成令人信服的排行榜,关键在于其科学的评分算法。平台并非简单计算胜率,而是采用了国际象棋界通用的 Elo 等级分系统,并结合了 Bradley-Terry 模型 来处理成对比较数据。

2.1 动态排名的奥秘

在 Elo 系统中,每个模型都有一个初始分数。当两个模型对战时:

- 如果高分模型战胜低分模型,得分增加较少;

- 如果低分模型爆冷战胜高分模型,得分将大幅增加;

- 若平局,则根据双方预期胜率微调分数。

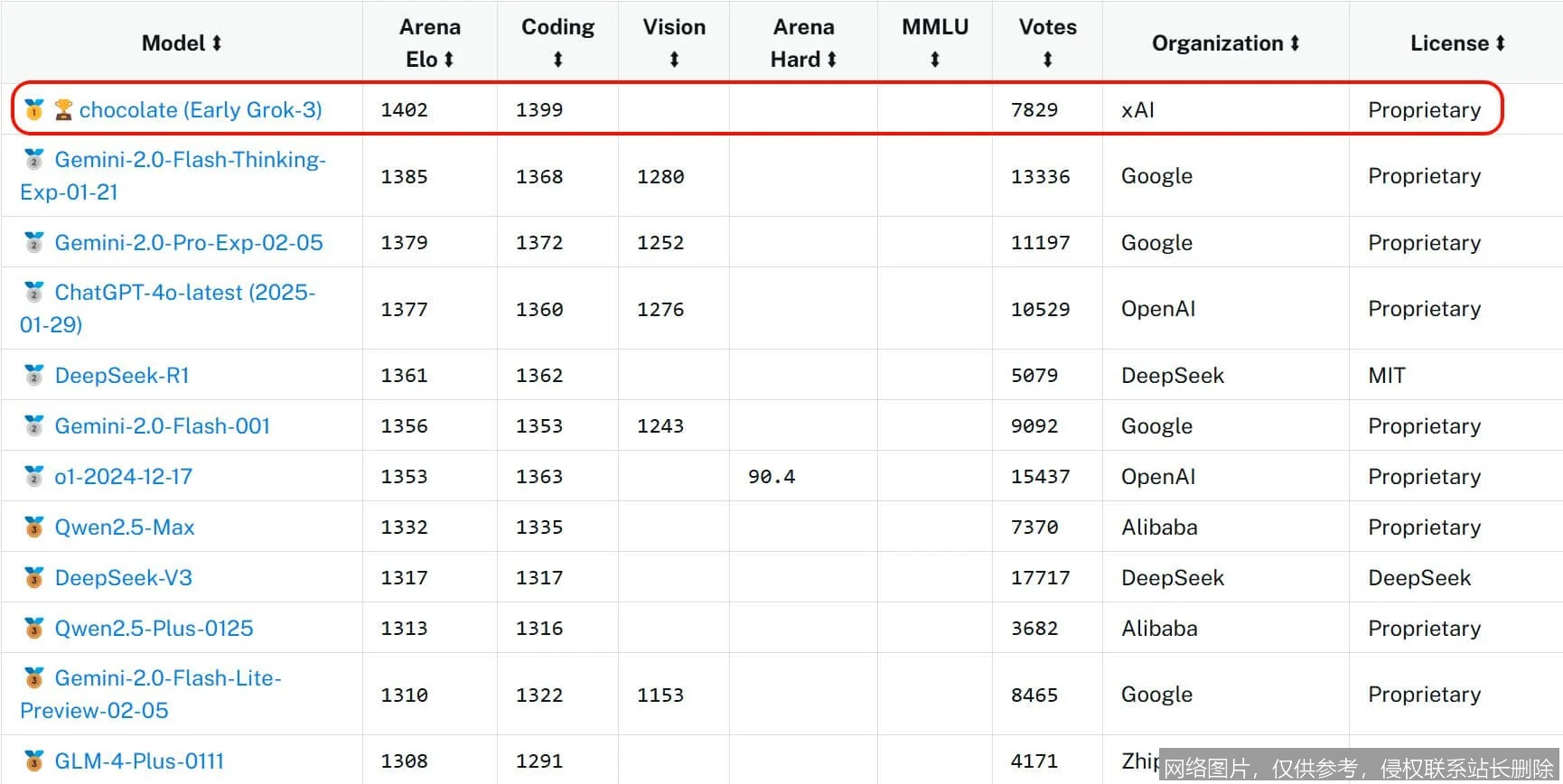

这种机制确保了排行榜的动态实时性。新发布的模型只要实力足够强,只需经过少量对战就能迅速冲榜;而一旦后续版本出现退化,分数也会立即下降。截至 2024 年 5 月,榜单榜首曾长期被 GPT-4o 占据,但随着 2025 年至 2026 年间 Claude 4.6、Qwen3.5 等旗舰模型的发布,榜首位置竞争愈发激烈,充分体现了竞技场的公平性。

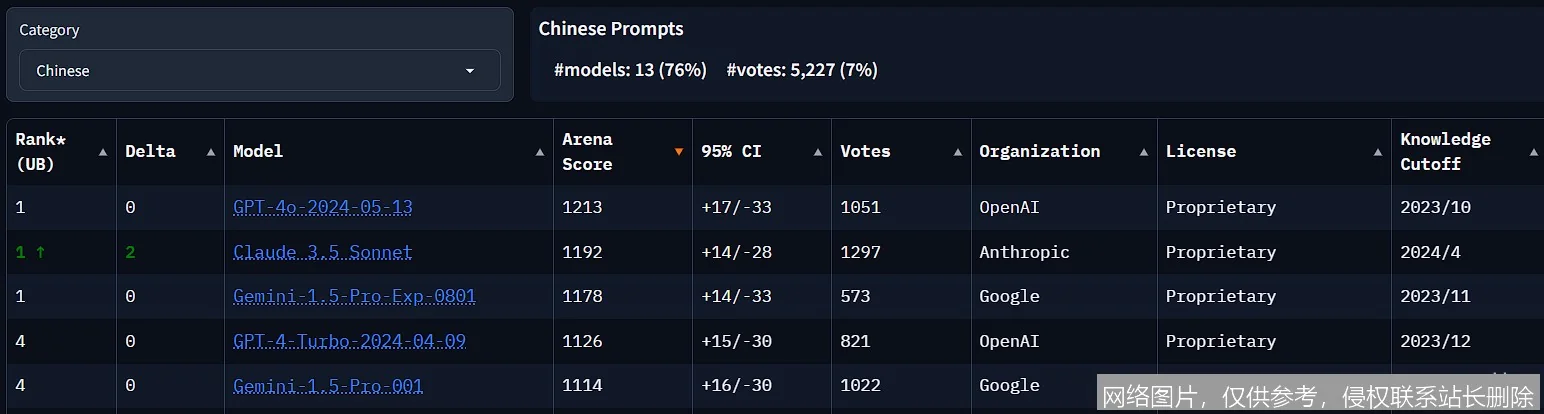

2.2 细粒度能力评估

除了综合排行榜,LMArena 还引入了细粒度的维度评估。平台将用户提示词分类为:编程开发、数学推理、创意写作、知识问答、多模态理解等多个类别。用户可以查看特定模型在某一领域的具体表现。例如,某些模型可能在代码生成上遥遥领先,但在长文本总结上表现平平。这种多维度的画像,帮助开发者更精准地选择适合特定任务的模型。

三、2026 年最新生态:从文本到全模态的进化

进入 2026 年,LMSYS Chatbot Arena 已不再局限于纯文本对话。随着多模态大模型的爆发,平台功能经历了重大升级,成为了真正的“全能竞技场”。

3.1 多模态评测的全面支持

根据 2026 年初的最新动态,LMArena 已全面支持视觉、图像生成、视频理解等多模态评测。用户现在可以上传一张复杂的图表或一段视频,让模型进行分析,或者直接要求模型生成图像并与其他模型的作品进行对比。这一更新使得平台能够评估像 GPT-4o、Claude 4.6 Sonnet 以及国内最新的 Qwen3.5 等具备强大视觉能力的模型。

特别是在计算机操作(Computer Use)领域,随着 Claude 4.6 等模型展现出拟人化的屏幕操作能力,LMArena 也引入了相关的基准测试,评估模型在“导航复杂电子表格”、“填写多步骤网页表单”等真实场景中的执行力。

3.2 代码与长上下文的专项竞技场

针对开发者群体,平台新增了专门的代码生成竞技场和长上下文处理竞技场。在代码区,模型不仅要写出可运行的代码,还要通过单元测试的验证。在长上下文区,模型需要处理数十万甚至上百万 token 的文档,考察其信息检索和逻辑连贯性。这些专项赛道为垂直领域的应用选型提供了极具价值的参考。

3.3 社区与竞赛生态

LMSYS 不仅是一个评测平台,更是一个活跃的研究社区。2024 年举办的"Chatbot Arena Human Preference Predictions"竞赛,吸引了全球机器学习专家参与,旨在构建更精准的奖励模型(Reward Models)。通过利用平台积累的海量真实对话数据,研究者们致力于解决位置偏见、啰嗦偏见等问题,推动 RLHF(基于人类反馈的强化学习)技术的进一步发展。

四、实战指南:如何免费使用全球顶尖大模型?

对于普通用户和开发者而言,LMSYS Chatbot Arena 最大的吸引力在于它是一个免费体验全球最先进大模型的平台。无需支付昂贵的 API 费用,也无需复杂的配置,即可并行对比多个顶级模型。

4.1 注册与入门

访问 LMSYS Org 主页(lmsys.org),点击导航栏中的"Chatbot Arena"。目前平台支持多种对战模式:

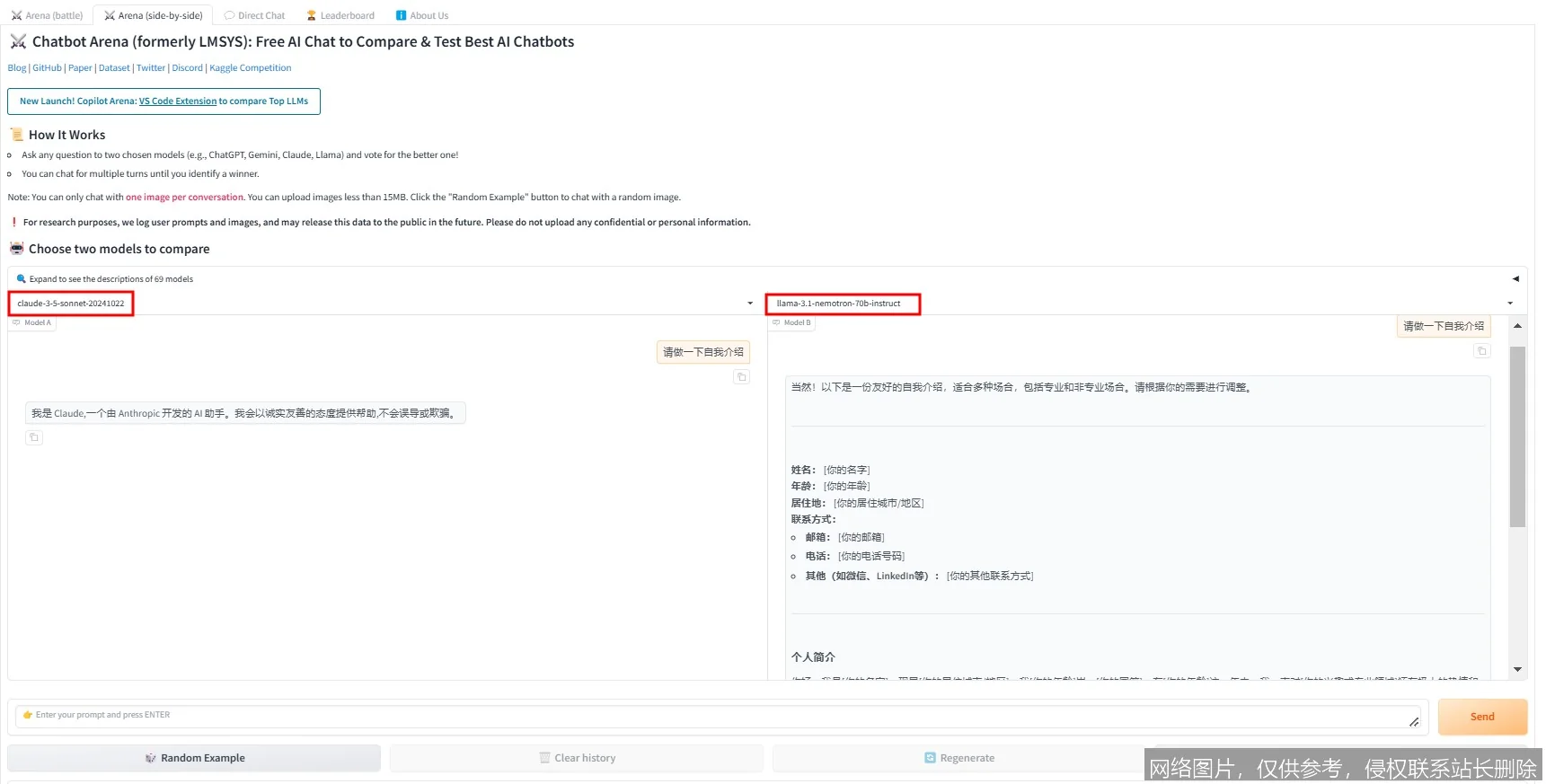

- Arena (Side-by-Side): 最经典的模式。输入问题,两个匿名模型同时回答,你投票后揭晓身份。

- Arena (Battle): 快速PK模式,适合快速测试模型反应。

- Direct Chat: 部分模型开放了直接对话模式,你可以指定与某个特定模型(如 Claude 3.5 Sonnet, GPT-4o, Qwen-Max 等)进行单轮或多轮对话。

4.2 高效使用技巧

为了获得最佳的测试效果,建议遵循以下策略:

- 构造多样化 Prompt: 不要只问“你好”,尝试提出复杂的逻辑题、要求生成特定风格的代码、或者让其分析上传的图片。

- 关注“平局”情况: 如果两个模型回答难分伯仲,选择“平局(Tie)”也是重要的数据贡献,这有助于算法更准确地校准分数。

- 利用侧边栏筛选: 在 Direct Chat 模式中,利用筛选功能找到你最关心的模型类别,比如专门测试开源模型或最新闭源模型的表现。

- 参与投票即贡献: 你的每一次投票都在为构建更公平的 AI 评估体系做贡献。平台明确感谢社区提供的数千万张投票,正是这些数据支撑了其商业价值。

4.3 注意事项

虽然平台免费,但由于算力成本高昂,通常会有频率限制(Rate Limit)。此外,由于是匿名对战,你在投票前无法知道具体是哪个模型,这正是保证公平性的关键。如果你需要稳定的生产环境调用,仍需通过官方 API 渠道付费使用。

五、技术深潜:支撑亿级流量的架构设计

随着用户量的激增,尤其是新模型发布时的流量洪峰,LMSYS Chatbot Arena 的后端架构面临着巨大的挑战。从早期的简单同步架构到如今的高可用分布式系统,其技术演进堪称教科书级别的案例。

5.1 从同步到异步解耦

在早期,系统采用同步架构:用户请求直接触发模型推理,导致在高并发下响应延迟从 1 秒恶化至 10 秒以上,甚至引发服务雪崩。为解决这一痛点,团队进行了彻底的架构重构:

- 任务队列引入: 采用 Celery + Redis 构建分布式任务队列。用户请求被快速接收并存入队列,后端的工作进程(Worker)按需消费任务进行推理。这种“削峰填谷”的机制有效平滑了流量波动。

- 计算与 IO 分离: 将计算密集型的模型推理与 IO 密集型的请求响应完全解耦。Web 服务器只负责轻量级的交互,繁重的推理任务交给专门的 GPU 集群处理。

5.2 缓存策略优化

为了进一步提升效率,系统实施了多层缓存策略:

- 模型权重缓存: 在服务进程内存中缓存已加载的模型实例,避免重复从磁盘加载,显著降低了冷启动时间。

- 上下文缓存: 对于多轮对话,利用缓存机制复用之前的计算结果,减少重复推理开销。

这些优化措施使得 LMArena 能够在保持低延迟的同时,支撑起全球数百万用户的实时对战需求,也为其他构建大规模 AI 应用的公司提供了宝贵的经验参考。

六、行业影响与未来展望

LMSYS Chatbot Arena 的成功不仅仅是一个技术产品的胜利,更是开源社区协作模式的胜利。它证明了基于人类偏好的众包评估是衡量 AI 智能水平的“黄金标准”。

6.1 商业化的成功路径

从大学实验室的开源项目到估值 17 亿美元的独角兽,LMArena 走出了一条独特的商业化道路。其核心价值在于掌握了最真实的用户偏好数据。在 2026 年完成的 1.5 亿美元 A 轮融资中,Felicis、UC Investments、a16z 等顶级机构的加入,表明资本市场对其作为"AI 行业基础设施”地位的高度认可。这笔资金将用于进一步扩展多模态评测能力、提升自动化评估工具的效率,以及探索更多细粒度的评估维度。

6.2 未来的挑战与方向

尽管成绩斐然,LMArena 仍面临挑战。随着模型越来越强,人类评判的难度也在增加,尤其是在细微差别上的区分。未来,平台可能会更多地结合自动化评估工具与人类投票,形成混合评估体系。此外,如何防止恶意刷票、如何应对模型针对评测数据的过拟合(Goodhart's Law),也是团队需要持续解决的问题。

展望未来,随着 Qwen3.5、Claude 4.6 等新一代模型的不断涌现,以及多模态、Agent 能力的深度融合,LMSYS Chatbot Arena 将继续扮演“裁判员”和“加速器”的双重角色,推动整个人工智能行业向着更对齐人类价值观、更实用、更高效的方向发展。

结语

LMSYS Chatbot Arena 已经超越了单纯的排行榜意义,它成为了连接模型开发者、研究者和最终用户的桥梁。无论你是想寻找最适合编程的助手,还是想体验最新的多模态黑科技,亦或是想为 AI 的未来发展贡献一份力量,这里都是你的首选之地。在 AI 技术日新月异的 2026 年,记住:看模型强弱,别只看论文,要去竞技场里“打一架”才知道!

参考资料与信息源

- LMSYS Org Official Website & Chatbot Arena: https://lmsys.org/

- LMSYS Chatbot Arena Leaderboard & Mechanism: https://chat.lmsys.org/

- Kaggle Competition - LMSYS Chatbot Arena Human Preference Predictions: https://www.kaggle.com/competitions/lmsys-chatbot-arena-human-preference-predictions

- TechCrunch/Felicis News on LMArena Series A Funding (Jan 2026): https://techcrunch.com/ (Search: LMArena funding)

- Andrej Karpathy's Recommendation on X (Twitter): https://twitter.com/karpathy

- Research Paper: "Chatbot Arena: An Open Platform for Evaluating LLMs by Human Preference" (ArXiv): https://arxiv.org/

- Claude 4.6 Release Notes & Capabilities (Anthropic Blog): https://www.anthropic.com/

- System Architecture Insights based on public technical discussions regarding LMSYS scaling: https://lmsys.org/blog/

相关推荐

- 预训练是什么:2026 大模型基石原理、技术演进与实战应用全面解析

- 什么是知识库?2026 年最新定义、技术原理与实战应用全面解析

- 语义搜索是什么:2026 年原理、技术演进与全场景应用详解

- 什么是自监督学习?2026 原理、应用与实战全面解析

- ONNX 是什么:2026 跨框架模型标准详解,从原理到实战应用

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用