Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

一句话定义

Agent 协作是指多个具备感知、规划与执行能力的智能体,通过通信协议分工配合,共同解决单一模型无法完成的复杂任务。

技术原理:从“单兵作战”到“集团军协同”

要理解 Agent 协作(Agent Collaboration) 的技术原理,我们首先需要打破对传统大语言模型(LLM)的刻板印象。传统的 LLM 更像是一个博学但被动的“图书馆管理员”,你问它答,它没有记忆长流程的能力,也无法主动调用外部工具去改变世界。而 Agent 协作,则是将多个这样的“管理员”组织成一个拥有不同专长、能够互相沟通、甚至互相监督的“特种部队”。

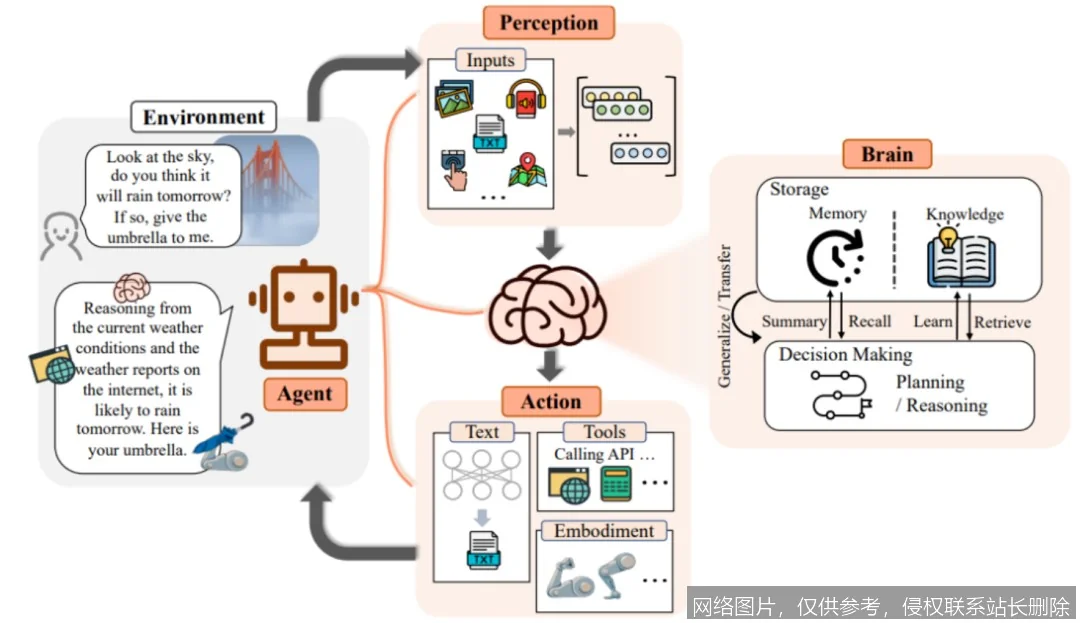

1. 核心工作机制:感知 - 规划 - 行动 - 反思的循环放大

在单智能体(Single Agent)模式下,一个模型试图独立完成从理解用户意图、拆解步骤、调用工具到最终输出的全过程。这往往导致“上下文窗口爆炸”或“逻辑链断裂”。Agent 协作的核心机制在于将这一长链条打散,分配给不同的节点。

其工作流程通常遵循 SOAR 或 ReAct 模式的分布式变体:

- 任务分解(Decomposition): 主智能体(Manager/Orchestrator)接收复杂指令,将其拆解为子任务。例如,“开发一个网页游戏”被拆解为“设计数据库”、“编写后端逻辑”、“构建前端界面”和“测试部署”。

- 角色路由(Role Routing): 系统根据子任务的性质,将其分发给具有特定人设(Persona)和工具权限的子智能体。比如,代码任务发给"Coder Agent",文档任务发给"Writer Agent"。

- 并行执行与通信(Parallel Execution & Communication): 子智能体各自利用专属工具集(如搜索引擎、代码解释器、数据库)完成任务。关键在于它们之间建立了通信信道,可以通过共享内存(Shared Memory)或消息队列(Message Queue)交换中间结果。

- 共识与整合(Consensus & Integration): 当出现分歧或需要汇总时,引入“裁判智能体”(Critic/Reviewer)进行质量评估,或由主智能体进行最终整合,形成闭环。

2. 关键技术组件:构建协作的基石

实现高效的 Agent 协作,离不开以下四大技术支柱的支撑:

- 编排框架(Orchestration Frameworks): 这是协作的“指挥部”。如 LangChain、AutoGen、CrewAI 等框架,定义了智能体如何创建、如何交互以及工作流的状态机管理。它们解决了“谁在什么时候说什么话”的问题。

- 共享状态管理(Shared State Management): 协作的前提是信息同步。通过向量数据库(Vector DB)作为长期记忆,或通过全局变量池,确保 Agent A 生成的数据能被 Agent B 无缝读取,避免“信息孤岛”。

- 通信协议(Communication Protocols): 智能体之间的对话不是随意的闲聊,而是结构化的数据交换。常见的模式包括:

点对点(Peer-to-Peer): 两个专家直接协商;

发布/订阅(Pub/Sub): 一个代理发布成果,其他感兴趣的代理订阅;

层级汇报(Hierarchical): 下级向上级汇报,上级向下级指派。 - 工具互操作性(Tool Interoperability): 每个 Agent 必须标准化其工具调用接口(如 OpenAPI 标准),使得不同厂商或不同模型开发的 Agent 能够互相调用对方的能力,形成生态合力。

3. 与传统方法的对比:量变引起质变

为了更直观地理解,我们可以将 传统单体模型 比作一位“全才通识者”,而 Agent 协作系统 则是一个“专业项目组”。

| 维度 | 传统单体模型 (Monolithic LLM) | Agent 协作系统 (Multi-Agent System) |

|---|---|---|

| 问题解决深度 | 擅长通用回答,但在多步推理长链条中容易迷失(幻觉累积)。 | 通过分工将长链条截断,每个环节由专精模型处理,显著降低错误率。 |

| 容错性 | 一旦中间步骤出错,整个输出失效,缺乏自我修正机制。 | 引入“审查员”角色,可发现并纠正其他 Agent 的错误,具备鲁棒性。 |

| 扩展性 | 受限于单个模型的上下文窗口和计算资源,难以横向扩展。 | 可动态增加新角色的 Agent,像搭积木一样无限扩展系统能力。 |

| 类比 | 一个天才学生在考场上独自完成所有科目试卷。 | 一个由各科状元组成的团队,分工合作完成一份综合研究报告。 |

从技术演进来看,Agent 协作标志着 AI 从“概率预测下一个字”向“基于目标的自主行动系统”的范式转移。它不再仅仅依赖模型参数的规模(Scaling Law),而是依赖系统架构的涌现能力(Emergent Abilities)。

核心概念:解构协作生态的术语图谱

深入理解 Agent 协作,需要掌握一系列关键术语。这些概念构成了多智能体系统的语义网络,厘清它们有助于避免常见的认知误区。

1. 关键术语解析

- 智能体(Agent): 指能够感知环境、进行决策并执行动作以达成目标的实体。在 LLM 语境下,它是被赋予了特定人设(System Prompt)、记忆模块和工具集的大模型实例。

- 编排器(Orchestrator): 协作系统中的“大脑”或“项目经理”。它不负责具体执行,而是负责任务拆解、分配、监控进度和处理异常。常见的策略包括静态工作流(Static Workflow)和动态规划(Dynamic Planning)。

- 人设(Persona): 赋予 Agent 的特定角色身份,如“资深 Python 工程师”或“挑剔的市场分析师”。人设通过提示词工程(Prompt Engineering)固化,决定了 Agent 的思维模式和输出风格。

- 共享记忆(Shared Memory): 所有 Agent 可访问的公共知识库。它通常由向量数据库实现,存储历史对话、任务状态和领域知识,确保协作的连续性。

- 涌现(Emergence): 指多个简单 Agent 协作后,表现出单个 Agent 不具备的复杂解决问题的能力。这是多智能体系统追求的最高境界。

- 博弈与协商(Game Theory & Negotiation): 当不同 Agent 目标冲突时(例如成本控制 Agent vs 质量保证 Agent),系统采用的协商机制,以达成全局最优解。

2. 概念关系图谱

在 Agent 协作的生态中,各概念并非孤立存在,而是形成一个有机的整体:

用户意图 输入给 编排器 -> 编排器依据 任务拓扑 拆解任务 -> 分发至不同 角色化 Agent -> Agent 利用 工具集 执行并写入 共享记忆 -> 审查员 Agent 读取记忆进行评估 -> 反馈回路调整策略 -> 最终输出。

在这个链条中,通信协议 是连接各节点的血管,安全护栏(Safety Guardrails) 则是包裹在整个系统外层的免疫系统,防止恶意指令或危险操作。

3. 常见误解澄清

误解一:"Agent 协作就是开多个聊天窗口。”

澄清: 简单的多窗口并行不是协作。真正的协作包含状态的共享、逻辑的依赖和结果的整合。如果 Agent A 的输出不能自动成为 Agent B 的输入,那只是并发处理,而非协作系统。

误解二:“模型越强,就不需要多 Agent 了。”

澄清: 即使模型能力再强,受限于注意力机制(Attention Mechanism)的物理极限,处理超长上下文和极复杂逻辑时依然会衰退。多 Agent 通过“分而治之”降低了单个模型的认知负荷,这是一种架构上的优化,而非单纯弥补模型缺陷。

误解三:"Agent 协作完全是自动化的,无需人工干预。”

澄清: 目前的“人机回环”(Human-in-the-loop)依然至关重要。在关键决策点、伦理判断或高风险操作中,人类专家的介入是确保系统可靠性的必要手段。完全自治(Autonomous)仍是长远目标,当前多为辅助自治。

实际应用:从实验室走向 2026 企业实战

Agent 协作并非纸上谈兵,它正在迅速重塑软件工程和业务流程。展望 2026 年,我们将看到从“玩具演示”到“核心生产力”的全面跨越。

1. 典型应用场景

- 软件工程全生命周期(SDLC): 这是目前最成熟的场景。

场景描述: 产品经理 Agent 撰写需求文档 -> 架构师 Agent 设计数据库 schema -> 编码 Agent 生成代码 -> 测试 Agent 编写单元测试并运行 -> 修复 Agent 根据报错修改代码。

价值: 将原本数周的开发周期缩短至数小时,且代码规范性显著提升。 - 复杂数据分析与商业洞察:

场景描述: 数据提取 Agent 从 ERP/CRM 拉取数据 -> 清洗 Agent 处理缺失值 -> 分析 Agent 运行统计模型 -> 可视化 Agent 生成图表 -> 报告 Agent 撰写自然语言结论。

价值: 让非技术人员也能通过自然语言指令完成深度的数据挖掘,打破数据孤岛。 - 个性化客户服务与销售:

场景描述: 接待 Agent 初步分流 -> 情感分析 Agent 判断客户情绪 -> 专家 Agent 提供解决方案 -> 谈判 Agent 处理价格异议 -> 订单 Agent 完成交易。

价值: 提供 7x24 小时具备“同理心”和“专业知识”的千人千面服务,转化率远超传统规则机器人。 - 科研辅助与新药研发:

场景描述: 文献检索 Agent 综述最新论文 -> 假设生成 Agent 提出实验猜想 -> 模拟仿真 Agent 运行分子动力学模拟 -> 验证 Agent 评估结果可行性。

价值: 加速科学发现过程,降低试错成本。

2. 代表性产品与项目案例

- Microsoft AutoGen / Copilot Studio: 微软推出的框架允许开发者轻松创建能相互对话的 Agent。在企业实践中,已被用于构建自动化的 IT 运维系统和财务审计助手。

- CrewAI: 一个专注于角色扮演的开源框架,强调“过程驱动”(Process-Driven)。它让定义 Agent 的角色、目标和协作流程变得像写剧本一样简单,广泛应用于内容营销自动化。

- Devika: 一个开源的高水平软件工程 Agent,能够理解人类指令,搜索网络,编写代码,并在沙盒环境中运行和调试,展示了单一大任务被拆解为多步协作的潜力。

- MetaGPT: 创新性地将软件公司的标准作业程序(SOP)编码进多智能体系统中,使得输入一行需求,即可输出完整的产品文档、架构图和可运行代码。

3. 使用门槛与落地条件

尽管前景广阔,但企业在 2024-2026 年间落地 Agent 协作仍面临挑战:

- 算力成本: 多 Agent 意味着多次 API 调用或本地多模型推理,Token 消耗量和显存需求呈倍数增长。企业需要权衡性能提升与成本投入。

- 一致性控制: 随着 Agent 数量增加,系统可能出现“死循环”对话或目标漂移。需要设计精妙的终止条件和奖励函数(Reward Function)来约束行为。

- 数据安全与隐私: 多个 Agent 共享数据增加了泄露风险。企业必须建立严格的数据访问权限控制和审计日志。

- 人才缺口: 未来的开发者不仅需要懂编程,更需要懂“提示词工程”和“系统编排”。懂得如何设计 Agent 交互流程将成为新的核心竞争力。

延伸阅读:构建你的多智能体知识体系

Agent 协作是通往通用人工智能(AGI)的重要路径之一。为了帮助读者进一步探索这一前沿领域,以下整理了进阶学习路径和资源推荐。

1. 相关概念推荐

若想深入研究,建议同时关注以下关联概念:

- 群体智能(Swarm Intelligence): 受生物界(如蚁群、蜂群)启发的去中心化协作算法,是多 Agent 系统的理论基础之一。

- 神经符号人工智能(Neuro-Symbolic AI): 结合深度学习感知能力与符号逻辑推理能力的混合架构,能进一步提升 Agent 协作的逻辑严谨性。

- 大模型代理基准测试(LLM Agent Benchmarks): 如 AgentBench、WebArena,用于评估多智能体系统在真实环境中的表现。

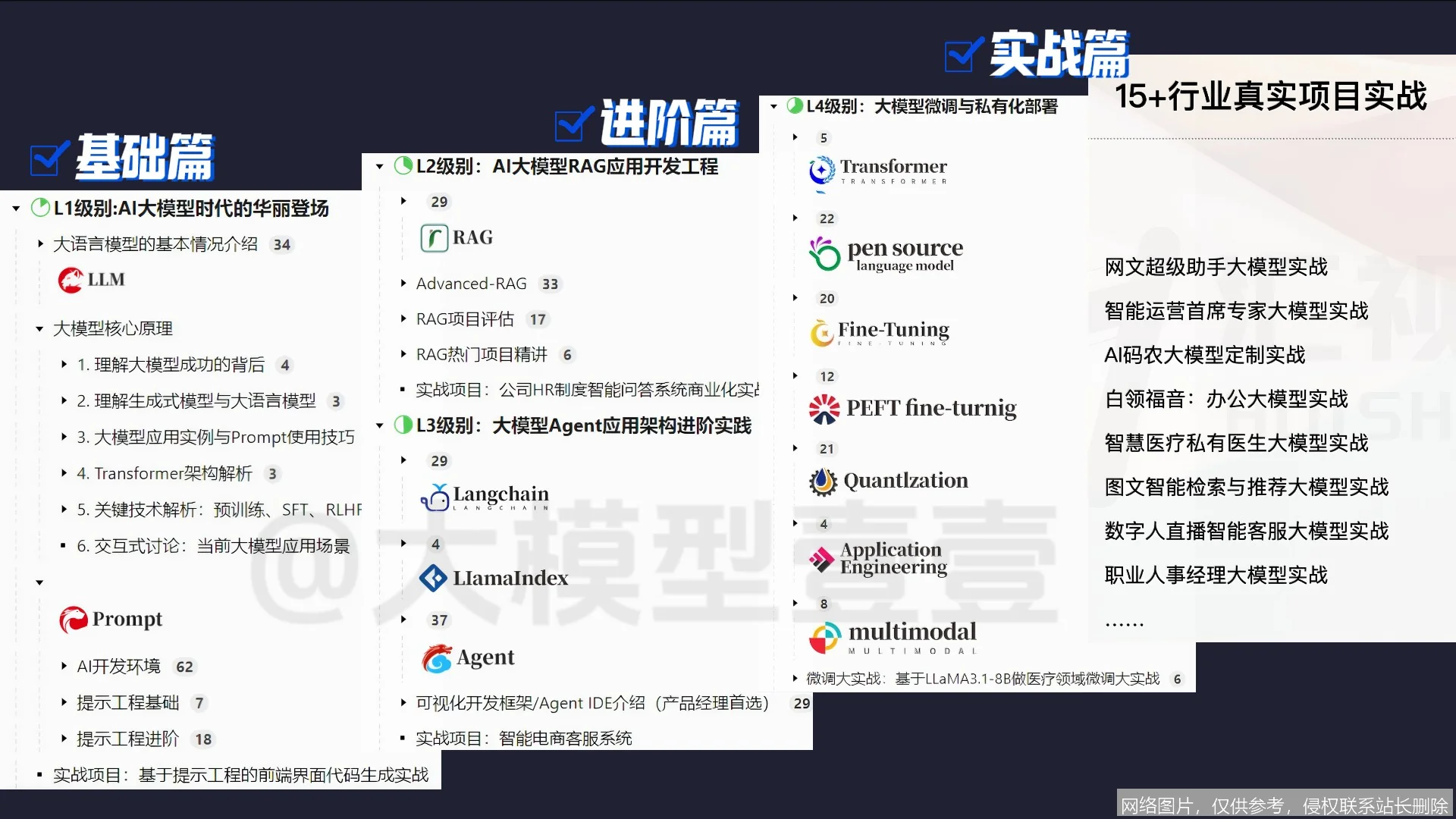

2. 进阶学习路径

- 入门阶段: 熟悉 LangChain 或 LlamaIndex 基础,尝试构建一个简单的“搜索 + 总结”双 Agent 流程。

- 进阶阶段: 深入学习 AutoGen 或 CrewAI 框架,实践角色扮演和多轮对话机制,理解状态管理和记忆存储。

- 高阶阶段: 研究多智能体强化学习(MARL),探索如何让 Agent 在动态环境中通过自我博弈进化策略;参与开源项目,贡献复杂的协作模式。

3. 推荐资源与文献

- 经典论文:

- "Generative Agents: Interactive Simulacra of Human Behavior" (Stanford & Google, 2023) - 奠定了虚拟社会模拟的基础。

- "AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation" (Microsoft, 2023) - 多智能体对话框架的奠基之作。

- "MetaGPT: Meta Programming for A Multi-Agent Collaborative Framework" (2023) - 展示了 SOP 在多 Agent 中的应用。

- 开源社区: 关注 GitHub 上的

langchain-ai,microsoft/autogen,joaomdmoura/crewAI仓库,获取最新代码示例。 - 行业报告: 查阅 Gartner 关于"Agentic AI"的趋势报告,以及 Andreessen Horowitz (a16z) 发布的关于 AI Agent 经济学的深度文章。

结语:Agent 协作不仅仅是技术的堆叠,更是生产关系的重构。从 2024 年的概念爆发到 2026 年的全面实战,我们将见证 AI 从“工具”演变为“同事”。对于每一位技术从业者和企业决策者而言,现在正是理解并布局这一变革的最佳时机。

已是最新文章

相关推荐

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用

- 什么是 LangChain?2026 最新定义、核心原理与 Agent 实战详解

- 什么是 Llama 3?2026 最新架构原理、性能评测与实战应用全解析

- 什么是 Midjourney?2026 版原理、技术演进与商业应用全解析

- 什么是 AI 伦理?2026 数智时代核心原则、技术挑战与应用范式全面解析

- KLING AI(可灵)详解:3.0 模型原理、智能分镜与影视级应用实战

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析