Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

一句话定义

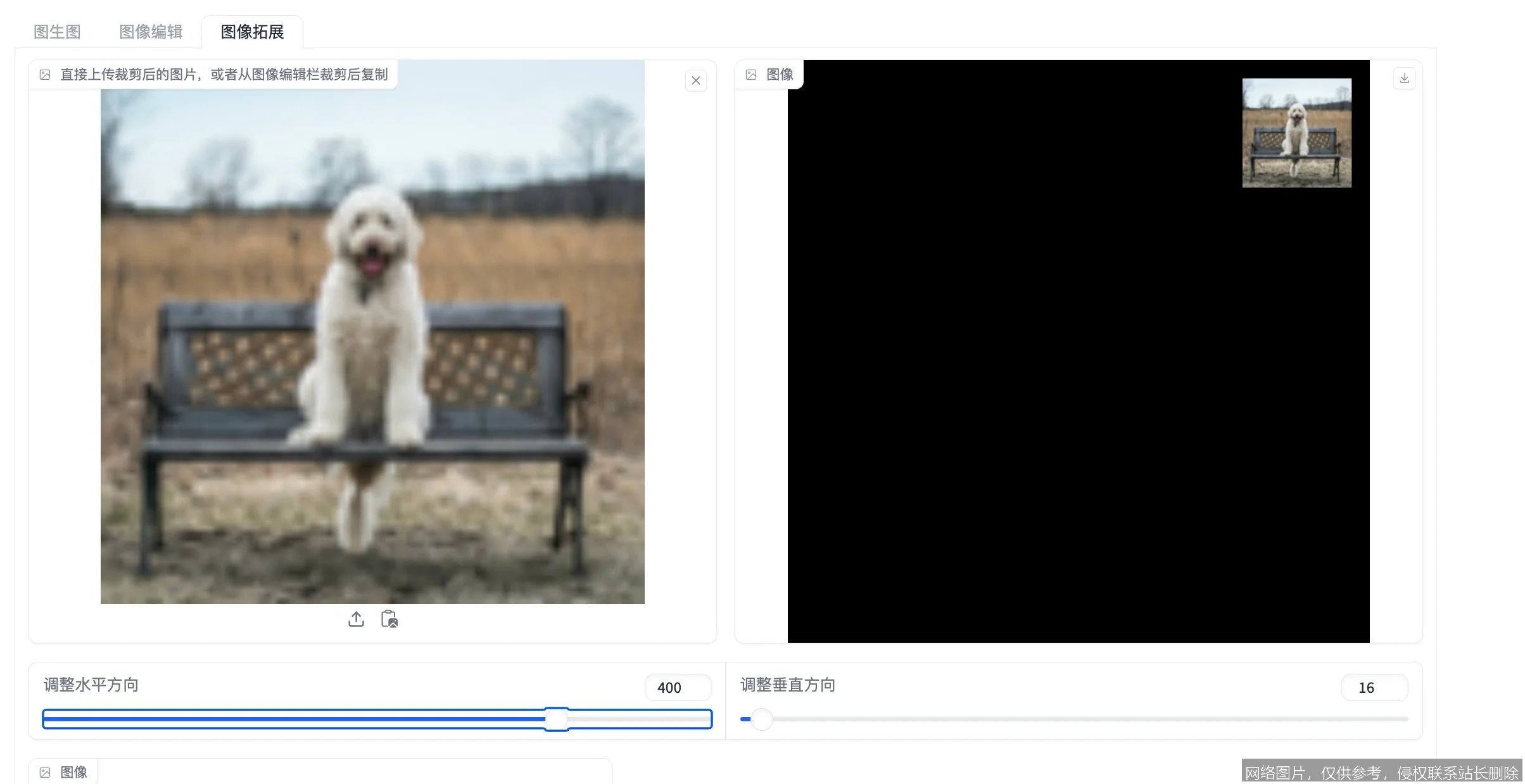

Outpainting(图像扩展)是一种利用生成式人工智能,基于现有图像内容与语义逻辑,向画布边界外智能填充并延伸新像素的技术。

在数字图像处理的浩瀚星图中,如果说“修图”是对既有画面的修补与美化,那么"Outpainting"则是一场关于想象力的无限突围。它不再局限于矩形画框的束缚,而是让 AI 充当一位拥有无穷创意的画家,根据画面中已有的光影、纹理、透视关系以及语义内容,大胆地向画布之外延伸,创造出原本不存在的视觉世界。从 2024 年的初步探索到 2026 年的成熟应用,这项技术已经彻底改变了我们创作、编辑和消费视觉内容的方式。

技术原理:从“猜谜”到“构建”的智能跃迁

要理解 Outpainting(图像扩展)的工作原理,我们需要深入生成式人工智能(Generative AI)的核心腹地。简而言之,这是一个让模型学会“合理猜测”的过程。如果把 Inpainting(图像修复)比作是在一幅名画上填补一个破洞,要求填补的内容必须与周围完美融合;那么 Outpainting 就是在这幅名画的边缘继续作画,要求新画出的部分不仅要风格一致,还要在逻辑上延续原图的叙事。

核心工作机制:扩散模型的逆向演绎

截至 2026 年,主流的 Outpainting 技术主要建立在潜空间扩散模型(Latent Diffusion Models, LDMs)及其演进版本之上。其核心机制可以拆解为三个关键步骤:

1. 编码与上下文理解(Encoding & Context Understanding)

首先,系统会将输入的原始图像通过变分自编码器(Variational Autoencoder, VAE)压缩到一个低维的“潜空间”(Latent Space)。在这个空间中,图像不再是一个个像素点,而是一组代表语义特征、纹理风格和结构信息的向量数据。与此同时,模型会读取用户提供的提示词(Prompt),将文本信息转化为对应的嵌入向量(Text Embeddings)。此时,AI 不仅“看”到了图片长什么样,还“读”懂了图片里有什么(例如:海边、夕阳、孤独的人)。

2. 噪声引导的渐进生成(Noise-Guided Progressive Generation)

这是最魔幻的一步。系统在原始图像周围的空白区域(即需要扩展的区域)填充随机高斯噪声。接着,扩散模型开始执行“去噪”过程。与传统生成全新图像不同,这里的去噪过程受到严格约束:原始图像区域的潜变量被锁定(Masked/Fixed),保持不变;而空白区域的潜变量则在文本提示词和原始图像边缘特征的联合引导下,逐步从混乱的噪声中“浮现”出合理的图像内容。

这个过程就像是在迷雾中雕刻。起初,扩展区域只是一片混沌的噪点,但随着迭代步数(Steps)的增加,模型会根据原图边缘的海浪线条,推断出远处应该有延续的海岸线;根据天空的渐变色,推算出更远处的云层形态。每一次迭代,都是对“接下来应该是什么”的一次概率修正。

3. 解码与无缝融合(Decoding & Seamless Blending)

当去噪过程完成后,生成的潜变量再次通过 VAE 的解码器还原为像素图像。为了确保新生成区域与原图在色彩、光照和纹理上没有割裂感,先进的算法会引入注意力机制(Attention Mechanism)的跨区域交互,强制让新生成部分的边缘像素与原图边缘进行平滑过渡,最终输出一张分辨率更高、视野更广的完整图像。

关键技术组件解析

在 2026 年的技术栈中,以下几个组件是 Outpainting 得以高质量实现的基石:

- 可控注意力机制(Controllable Attention):这是解决“逻辑断裂”的关键。传统的注意力机制可能只关注局部,导致扩展出来的物体比例失调。新一代模型引入了长程注意力(Long-range Attention),能让模型在生成远处的山脉时,依然参考近处人物的视角和透视消失点,确保几何结构的正确性。

- 多模态对齐模块(Multimodal Alignment Module):它负责将文本提示词(如“赛博朋克风格的街道”)精准地映射到图像生成的特定区域。如果没有这个模块,AI 可能会把“赛博朋克”的元素错误地添加到原本写实的人物脸上,造成风格冲突。

- 自适应分块策略(Adaptive Tiling Strategy):面对超大幅面的扩展需求,显存往往成为瓶颈。该技术将扩展任务分解为多个重叠的小块(Tiles),逐块生成并利用重叠区进行加权平均融合,从而实现了理论上无限大的画布扩展,同时保持了细节的一致性。

与传统方法的对比:从“复制粘贴”到“无中生有”

在深度学习爆发之前,图像处理软件中的“内容感知填充”(Content-Aware Fill)是扩展图像的主要手段。那种传统方法本质上是基于统计学的“复制粘贴”。它会分析边缘的像素模式,然后从图像的其他部分寻找相似的纹理块进行拼接。这种方法在处理简单的草地、天空或墙壁时效果尚可,但一旦遇到复杂的物体结构(如延伸的手臂、完整的建筑、连贯的故事场景),就会显得捉襟见肘,产生明显的重复纹理或逻辑谬误。

相比之下,基于扩散模型的 Outpainting 是真正的“生成”。它不是从图库里找素材拼凑,而是根据对世界的认知(训练数据中学到的物理规律、物体结构、光影逻辑)重新“画”出新的内容。传统方法是基于样本的插值(Interpolation based on samples),而现代 Outpainting 是基于分布的采样(Sampling from distribution)。前者只能重复过去,后者可以创造未来。

类比理解:

如果把图像扩展比作写小说续集。传统方法就像是把前文出现过的句子打乱重组,强行接在后面,虽然词汇一样,但情节往往不通顺;而 Outpainting 则像是一位熟读了原著的作家,理解了人物性格和世界观后,顺势创作出合乎逻辑的全新章节。

核心概念:构建认知的术语图谱

要真正掌握 Outpainting,必须厘清其与相关概念的边界与联系。以下是该领域的关键术语解析及概念关系梳理。

关键术语解释

1. Outpainting(图像扩展)vs. Inpainting(图像修复)

这是最容易混淆的一对概念。

Inpainting:目标是“填补空缺”。用户在图像内部划定一个掩码(Mask),遮盖住不需要的物体或缺损部分,AI 负责根据周围环境填补这个洞。重点在于“还原”或“移除”。

Outpainting:目标是“拓展边界”。用户在图像外部扩大画布,AI 负责根据现有内容向外延伸。重点在于“创造”和“延续”。

两者在底层算法上高度同源,主要区别在于掩码的位置(内部 vs 外部)以及生成时的约束条件(封闭环境 vs 开放环境)。

2. Prompt Engineering(提示词工程)

在 Outpainting 中,提示词的作用至关重要。由于扩展区域没有原始像素作为参考,AI 极度依赖文本指令来推断扩展内容的方向。例如,仅输入“森林”,AI 可能随机生成任何类型的森林;但如果输入“茂密的针叶林,冬季,大雪纷飞,延续左侧的雪松纹理”,生成的准确性和连贯性将大幅提升。

3. Latent Space(潜空间)

这是 AI 理解图像的“抽象思维空间”。在这个高维数学空间中,相似的概念(如“猫”和“老虎”)距离较近,不同的风格(如“油画”和“照片”)分布在不同的区域。Outpainting 的本质就是在潜空间中,沿着原图特征的向量方向,继续向前行走一段距离,然后再映射回像素空间。

4. Consistency Decay(一致性衰减)

这是一个常见的技术挑战术语。指随着扩展次数或距离的增加,生成内容与原始图像的风格、色调或主体特征逐渐偏离的现象。例如,连续向右扩展五次后,原本晴朗的天空可能变成了阴天,或者人物的脸部特征发生了微调。2026 年的新技术致力于通过全局记忆模块来抑制这种衰减。

概念关系图谱

为了更直观地理解,我们可以构建如下的逻辑关系:

- 父集:Generative AI(生成式人工智能)

- 子集:Image Synthesis(图像合成)

- 分支 A:Text-to-Image(文生图):从零开始,完全由文本驱动。

- 分支 B:Image-to-Image(图生图):基于原图进行变换。

- 场景 1:Style Transfer(风格迁移):内容不变,风格变。

- 场景 2:Editing(编辑):

- Inpainting:向内修补(做减法或替换)。

- Outpainting:向外扩展(做加法)。

- 子集:Image Synthesis(图像合成)

从这个图谱可以看出,Outpainting 是图生图技术的一个特例,它介于“完全受控的编辑”和“自由发散的创作”之间。

常见误解澄清

误解一:"Outpainting 只是简单的拉伸放大。”

澄清:绝对不是。拉伸放大(Upscaling/Stretching)只是机械地增加像素,会导致图像模糊或变形,且不会产生新的细节。Outpainting 会生成原本不存在的新物体、新背景和新细节,信息量是实质性增加的。

误解二:“只要画布够大,就能无限扩展出完美的世界。”

澄清:虽然技术上支持无限扩展,但在实际应用中,随着扩展范围的增大,累积误差(Cumulative Error)会导致逻辑崩坏。例如,扩展太远后,原本的建筑结构可能变得不符合物理规律,或者故事主题发生漂移。目前的解决方案通常是分段生成并人工干预,而非全自动无限延伸。

误解三:"Outpainting 不需要提示词,全靠 AI 自动脑补。”

澄清:虽然 AI 具备一定的自动补全能力(Auto-completion),但在复杂场景下,缺乏提示词引导的自动扩展往往充满随机性,难以满足专业创作需求。高质量的 Outpainting 几乎总是伴随着精细的提示词控制。

实际应用:打破画框的创意革命

Outpainting 技术的成熟,标志着数字内容创作从“裁剪时代”迈入了“扩张时代”。在 2026 年,这项技术已深深嵌入到各行各业的工作流中。

典型应用场景

1. 影视与广告海报的自适应重构

在流媒体时代,同一部电影的海报需要适配手机竖屏、电脑横屏、户外巨幕等多种比例。传统做法是重新设计或粗暴裁剪,导致构图失衡。利用 Outpainting,设计师只需制作一个核心版本,即可一键将其扩展为任意宽高比。例如,将一张 16:9 的电影剧照无损扩展为 9:16 的抖音封面,AI 会自动补全上下方的天空、地面或背景建筑,保持主角居中且构图完美。

2. 沉浸式艺术与全景体验

艺术家可以利用 Outpainting 将小幅画作扩展为巨幅壁画,甚至生成 360 度的全景图(Panorama),用于 VR(虚拟现实)展览。通过将一张普通的风景照向四周无限延伸,观众戴上 VR 设备后,仿佛真正置身于那个世界,获得前所未有的沉浸感。

3. 老照片修复与历史重现

许多珍贵的历史老照片由于拍摄设备限制,往往构图局促或边缘破损。修复师利用 Outpainting,不仅可以修复破损处,还能根据当时的历史背景资料(作为 Prompt),合理推测并扩展出照片之外的街道景象、人群活动,让静止的历史瞬间变得更加丰满和生动。

4. 游戏开发与资产生成

在游戏制作中,创建无缝的大地图纹理是一项繁重的工作。开发者可以使用 Outpainting 将小块的地面纹理、墙面贴图扩展为超大尺寸的无缝纹理,大大减少了美术资源的制作时间。此外,还可以用于快速生成游戏场景的概念草图,帮助策划人员验证关卡设计的可行性。

代表性产品与项目案例(2026 视角)

- Adobe Photoshop (Generative Expand):作为行业标杆,Photoshop 已将 Outpainting 深度集成到“裁剪工具”中。用户拖动画布边缘,系统即刻生成扩展内容,并允许用户通过滑块调整“创意程度”。其优势在于与图层、蒙版等传统工具的无缝协作。

- Midjourney (Zoom Out & Pan):这款以艺术性著称的工具,提供了极具创意的"Zoom Out"功能。它不仅能向外扩展,还能在扩展的同时自动调整整体构图,使画面呈现出电影般的宏大叙事感,深受概念艺术家喜爱。

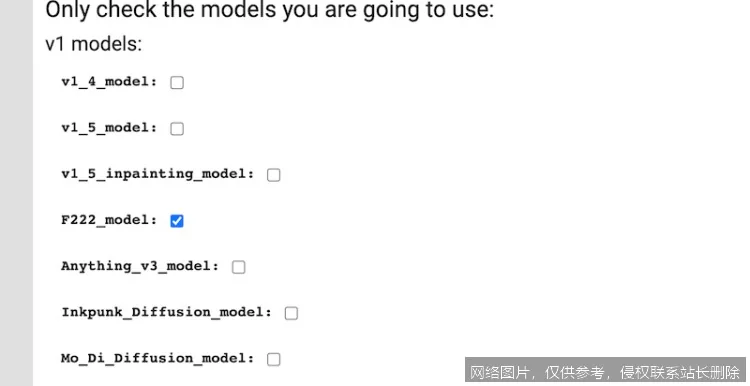

- Stable Diffusion WebUI (ControlNet + Tiling):对于极客和专业开发者,开源的 Stable Diffusion 配合 ControlNet 插件,提供了最精细的控制权。用户可以精确指定扩展区域的边缘强度、透视方向,甚至结合 Depth Map(深度图)来控制三维空间的延伸逻辑,是实现定制化工作流的首选。

使用门槛与条件

尽管技术日益强大,但要获得理想的 Outpainting 效果,仍需满足一定条件:

- 算力基础:高质量的实时扩展需要强大的 GPU 支持。虽然云端服务降低了本地硬件门槛,但对于高分辨率、大批量的处理任务,显存容量依然是关键瓶颈。

- 提示词技巧:用户需要具备一定的“提示词工程”能力,能够准确描述希望扩展的内容风格、光影氛围和具体元素。模糊的指令往往导致不可控的结果。

- 审美判断:AI 生成的内容可能存在细微的逻辑瑕疵(如多出的手指、奇怪的建筑结构)。使用者必须具备敏锐的审美和判断力,进行必要的人工筛选和二次修饰(Inpainting 微调)。

延伸阅读:通往未来的进阶之路

Outpainting 只是生成式视觉技术冰山一角。想要系统掌握这一领域,建议从以下维度进行深入探索。

相关概念推荐

- Inpainting(图像修复):Outpainting 的孪生兄弟,掌握它是理解掩码机制的基础。

- Super-Resolution(超分辨率):关注如何在扩展画面的同时提升清晰度,两者常结合使用。

- Video Outpainting(视频扩展):这是 2026 年的前沿热点。如何将静态图像的扩展逻辑应用到动态视频中,保证帧间的时间一致性(Temporal Consistency),是当前的研究高地。

- 3D Gaussian Splatting:一种新兴的 3D 场景表示方法,结合 Outpainting 可实现从 2D 图片直接生成可漫游的 3D 空间。

进阶学习路径

第一阶段:基础操作

熟悉主流工具(Photoshop Generative Fill, Midjourney, Stable Diffusion WebUI)的基本操作流程。尝试对不同风格的照片进行简单的画布扩展,观察 AI 的反应。

第二阶段:提示词与控制

深入学习 Prompt Engineering。研究如何使用负向提示词(Negative Prompts)避免错误生成,如何利用 ControlNet 的 Canny、Depth、Pose 等预处理器来严格控制扩展的结构和透视。

第三阶段:原理与调优

阅读扩散模型相关论文,理解 U-Net 架构、Attention 机制和 VAE 原理。尝试在本地部署开源模型,调整采样器(Sampler)、步数(Steps)和 CFG Scale 等参数,探究其对生成质量的影响。

第四阶段:工作流整合

将 Outpainting 融入实际生产管线。例如,结合 ComfyUI 搭建自动化节点流,实现“输入小图->自动扩展->自动超分->自动上色”的一站式处理流程。

推荐资源与文献

- 经典论文:

- "High-Resolution Image Synthesis with Latent Diffusion Models" (Rombach et al., CVPR 2022) - 奠基之作,必读。

- "Expanding Natural Images with Large Diffusion Models" - 专门探讨 Outpainting 策略的后续研究。

- 在线社区:

- Civitai:全球最大的开源模型分享站,可下载针对特定风格优化的 Outpainting 模型(Checkpoints)和 LoRA。

- Hugging Face:获取最新的代码实现、Demo 和技术报告。

- Reddit r/StableDiffusion:活跃的技术讨论区,常有高手分享复杂的节点工作流和故障排除方案。

- 实践平台:

- RunwayML:提供基于浏览器的专业级视频和图像生成工具,适合初学者快速上手。

- Leonardo.ai:专注于游戏资产生成的平台,其 Canvas 编辑器对 Outpainting 有极好的可视化支持。

结语:

Outpainting 不仅仅是一项技术,它是一种新的视觉思维方式。它告诉我们,画面的边界不再是创作的终点,而是想象的起点。随着 2026 年及未来算法的不断进化,我们有理由相信,人类与 AI 协作创造的视觉奇迹,将远远超出我们今天的认知边界。无论你是设计师、开发者还是艺术爱好者,掌握 Outpainting,都意味着你握住了一把开启无限视觉宇宙的钥匙。

已是最新文章

相关推荐

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用

- 什么是 LangChain?2026 最新定义、核心原理与 Agent 实战详解

- 什么是 Llama 3?2026 最新架构原理、性能评测与实战应用全解析

- 什么是 Midjourney?2026 版原理、技术演进与商业应用全解析

- 什么是 AI 伦理?2026 数智时代核心原则、技术挑战与应用范式全面解析

- KLING AI(可灵)详解:3.0 模型原理、智能分镜与影视级应用实战