GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用

一句话定义

GPU(图形处理器)是一种专为并行计算设计的芯片,已从图形渲染引擎进化为驱动人工智能与智算中心的核心算力基石。

技术原理:从像素绘制到矩阵运算的进化

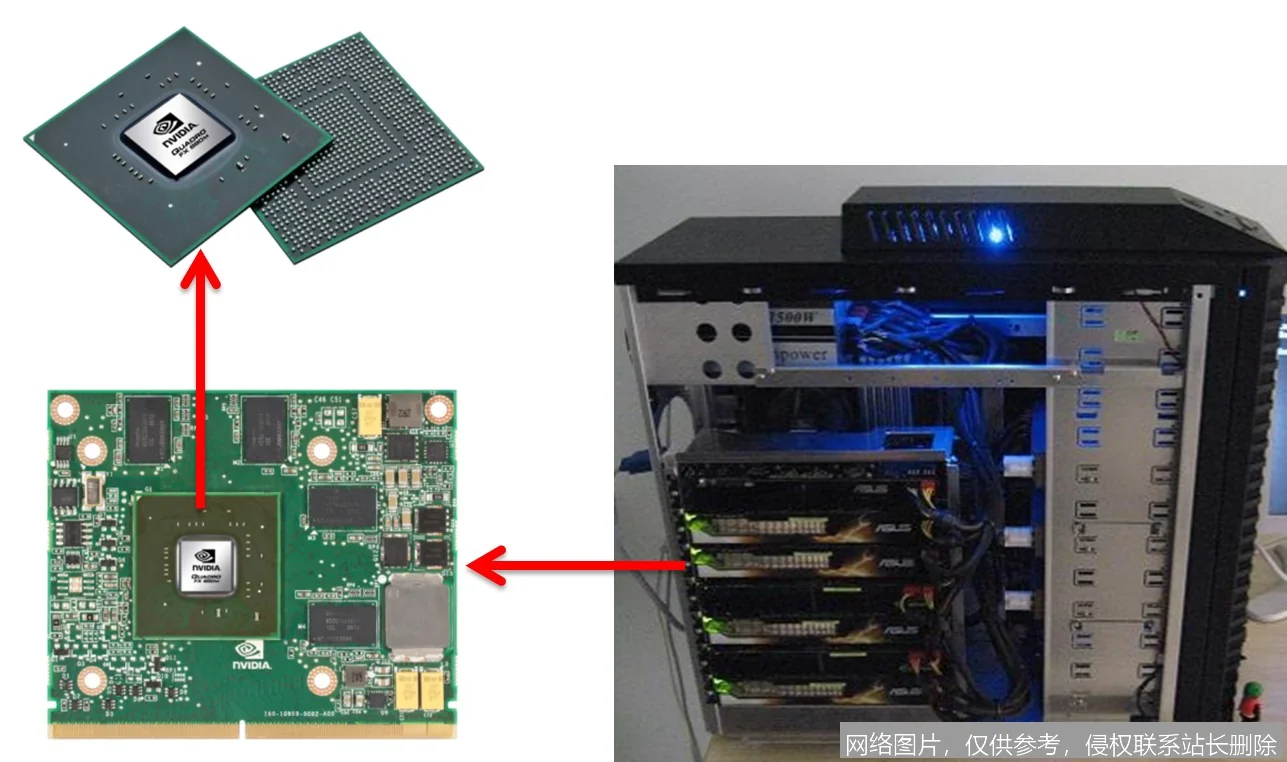

要真正理解"GPU 是什么”,我们不能仅停留在“显卡”这个消费级标签上,而必须深入其架构设计的底层逻辑。GPU 的全称是 Graphics Processing Unit(图形处理器),它的诞生初衷是为了加速计算机图形的渲染,但在今天,它已成为人工智能时代的“发动机”。

1. 核心工作机制:串行与并行的哲学分野

理解 GPU 的关键,在于理解它与 CPU(中央处理器)在处理任务时的根本差异。如果把计算任务比作“挖土”,那么 CPU 就像是一位拥有极强逻辑判断能力的“超级工头”,他手持一把锋利的铁锹,擅长处理复杂的、需要频繁决策的任务(如操作系统调度、逻辑分支判断),但他一次只能挖一个坑;而 GPU 则像是一支由成千上万名普通工人组成的“大军”,每个人手中只有一把小铲子,虽然单兵作战能力不如工头,但他们可以同时挖掘成千上万个简单的坑。

在技术术语中,这被称为**串行处理**(Serial Processing)与**并行处理**(Parallel Processing)的区别。

* **CPU 架构**:拥有少量的核心(Core),通常只有几个到几十个,每个核心拥有巨大的缓存(Cache)和复杂的控制单元,旨在最小化单次任务的延迟(Latency)。

* **GPU 架构**:拥有数以千计甚至上万个小核心(在 NVIDIA 架构中称为 CUDA Cores,在 AMD 中称为 Stream Processors)。这些核心结构简单,没有复杂的分支预测逻辑,但吞吐量(Throughput)极大,旨在单位时间内处理尽可能多的数据。

这种架构差异决定了 GPU 在处理大规模矩阵运算时的绝对优势。深度学习(Deep Learning)的本质,就是海量的矩阵乘法(Matrix Multiplication)和卷积运算(Convolution)。当训练一个大型语言模型(LLM)时,我们需要同时对数亿个参数进行更新,这种“简单但重复”的计算模式,正是 GPU 的“舒适区”。

2. 关键技术组件解析

现代高性能 GPU(如 NVIDIA H100 或 AMD MI300)内部结构极其复杂,主要包含以下几个关键组件,它们共同协作实现了惊人的算力:

* **流多处理器**(Streaming Multiprocessor, SM):这是 GPU 的基本计算单元集合。一个高端 GPU 可能包含上百个 SM,每个 SM 内部又包含数十个 CUDA 核心、寄存器文件和共享内存(Shared Memory)。SM 负责调度和执行线程束(Warp),即一组同时执行的线程。

* **高带宽内存**(High Bandwidth Memory, HBM):这是智算中心时代的关键瓶颈突破点。传统显存(GDDR6)虽然速度快,但在面对万亿参数模型时,数据传输速度成为了限制算力的短板。HBM 通过 3D 堆叠技术,将内存颗粒垂直堆叠在 GPU 芯片旁边,通过硅通孔(TSV)连接,提供了极高的内存带宽(例如 H100 的带宽可达 3.35 TB/s)。这就好比给那支“工人军队”修建了超高速的传送带,确保原材料(数据)能源源不断地送到工人手中,避免停工待料。

* **张量核心**(Tensor Cores):这是专为深度学习设计的特殊硬件单元。传统的 CUDA 核心处理的是标量或向量运算,而 Tensor Core 可以直接在一个时钟周期内完成整个矩阵块的乘法累加运算(例如 4x4 矩阵乘法)。这使得在进行混合精度训练(Mixed Precision Training,使用 FP16 或 BF16 格式)时,算力可以提升数倍甚至十倍。

* **高速互联接口**(NVLink/NVSwitch):在智算中心场景中,单张显卡的显存往往不足以容纳巨大的模型。因此,需要将多张 GPU 连接起来协同工作。NVLink 提供了远超 PCIe 总线的数据传输速度,使得多卡之间可以像访问本地显存一样访问彼此的显存,构建出逻辑上的“超级显卡”。

3. 与传统方法的对比:为何 AI 非 GPU 不可?

在 GPU 普及之前,科学家曾尝试用 CPU 集群甚至 FPGA(现场可编程门阵列)来运行神经网络算法。然而,效果并不理想。

* **能效比**(Performance per Watt):完成相同的矩阵运算任务,GPU 的能耗通常仅为 CPU 的十分之一甚至更低。在电费高昂的智算中心,这意味着运营成本的巨大差异。

* **开发生态**:NVIDIA 推出的**CUDA**(Compute Unified Device Architecture)平台,提供了一套完整的编程模型和库(如 cuDNN, cuBLAS),让开发者能够轻松调用 GPU 的并行能力。相比之下,其他方案的软件栈成熟度较低,迁移成本高。

* **扩展性**:随着模型参数从亿级增长到万亿级,GPU 集群可以通过高速网络线性扩展算力,而 CPU 集群由于通信开销大,扩展效率急剧下降。

简而言之,GPU 之所以成为 AI 的代名词,是因为它在物理架构上完美契合了深度学习算法的数学特征,并在软件工程上建立了难以撼动的生态壁垒。

核心概念:构建认知图谱

在深入探讨"GPU 是什么”之后,我们需要厘清一系列与之紧密相关的关键术语。这些概念构成了理解现代算力体系的基石。

1. 关键术语解释

* **CUDA **(Compute Unified Device Architecture):

由 NVIDIA 推出的并行计算平台和编程模型。它允许软件开发者直接使用 C/C++ 等语言编写代码,直接控制 GPU 的硬件资源。可以说,没有 CUDA,就没有今天的 AI 繁荣。它是连接算法工程师与硬件底层的桥梁。

* **FLOPS **(Floating Point Operations Per Second):

每秒浮点运算次数,衡量计算机计算能力的核心指标。在 AI 领域,我们常看到 TFLOPS(万亿次)、PFLOPS(千万亿次)甚至 EFLOPS(百亿亿次)。值得注意的是,不同精度的 FLOPS 数值差异巨大,例如 FP32(单精度)与 FP8(8 位浮点)的算力数值可能相差几十倍,因此在比较 GPU 性能时必须指明精度格式。

* **显存带宽**(Memory Bandwidth):

指 GPU 显存与核心之间数据传输的速度,单位通常为 GB/s 或 TB/s。对于大模型推理而言,显存带宽往往比峰值算力更重要,因为模型加载和中间激活值的传输速度决定了生成文本的快慢(Tokens per second)。

* **异构计算**(Heterogeneous Computing):

指系统中同时使用不同类型的处理器(如 CPU + GPU + DPU)来协同完成任务。CPU 负责逻辑控制和数据预处理,GPU 负责繁重的数值计算,这种分工合作模式是现代智算中心的标准配置。

* **Chiplet 与先进封装**:

随着摩尔定律放缓,单一芯片的面积制造难度和成本激增。新一代 GPU(如 AMD MI300 系列)开始采用 Chiplet(小芯片)技术,将计算核心、显存控制器、I/O 接口分别制造,再通过 2.5D/3D 封装技术整合在一起。这不仅是制造工艺的革新,更是提升良率和降低成本的关键策略。

2. 概念关系图谱

为了更直观地理解这些概念,我们可以构建如下的逻辑关系:

* **硬件层**:GPU 芯片(包含 Tensor Cores, SMs) + HBM 显存 + 散热系统。

* **互联层**:NVLink/PCIe(卡间通信) + InfiniBand/RoCE(节点间通信)。

* **软件层**:驱动程序 -> CUDA Toolkit -> 深度学习框架(PyTorch/TensorFlow) -> 应用模型(LLM/CV)。

* **场景层**:训练(Training,侧重算力和显存容量)vs 推理(Inference,侧重延迟和带宽)。

在这个链条中,任何一环的短板都会导致“木桶效应”。例如,即使拥有最强的 GPU 核心,如果显存带宽不足,算力也会闲置;如果软件框架优化不当,硬件性能也无法释放。

3. 常见误解澄清

* **误解一:"GPU 就是用来打游戏的。”**

* **真相**:虽然游戏是 GPU 的起源,但目前全球约 70%-80% 的高端 GPU 产能被数据中心和 AI 训练消耗。游戏卡(如 GeForce 系列)与计算卡(如 A100/H100 系列)在稳定性、显存纠错(ECC)、互联速度和驱动支持上有着本质区别。

* **误解二:“显存越大越好,不用管带宽。”**

* **真相**:显存容量决定了你能“装下”多大的模型,而显存带宽决定了模型“跑”得有多快。对于实时交互的 AI 应用,低带宽会导致严重的响应延迟,用户体验极差。

* **误解三:"GPU 可以完全替代 CPU。”**

* **真相**:GPU 不擅长处理复杂的逻辑跳转、中断处理和串行任务。在现代系统中,GPU 始终是作为 CPU 的协处理器存在的,两者是互补而非替代关系。

实际应用:从实验室到 2026 智算中心

理解了原理和概念后,我们来看看"GPU 是什么”在现实世界中的具体投射。从早期的图像识别到如今的大语言模型,再到未来的智算中心,应用场景正在发生深刻的变革。

1. 典型应用场景

* **大语言模型训练与微调**(LLM Training & Fine-tuning):

这是当前最核心的应用。训练一个类似 GPT-4 的模型,需要数千张 H100 GPU 连续运行数月。在这个过程中,GPU 集群需要进行海量的前向传播和反向传播计算。此外,企业利用少量 GPU 对开源模型进行垂直领域微调(Fine-tuning),已成为行业标配。

* **科学计算与仿真**(HPC for Science):

在药物研发中,GPU 用于模拟蛋白质折叠过程(如 AlphaFold);在气象预报中,用于求解流体力学方程;在核聚变研究中,用于等离子体模拟。GPU 将这些原本需要超级计算机才能完成的任務,带入了普通研究机构的视野。

* **自动驾驶与机器人**:

车载 GPU(如 NVIDIA Orin)负责实时处理激光雷达、摄像头的传感器数据,进行感知、规划和决策。这不仅要求高算力,还要求极高的能效比和安全性(功能安全等级 ISO 26262)。

* **AIGC 内容生成**:

从 Stable Diffusion 生成图像,到 Sora 生成视频,背后都是 GPU 在进行复杂的去噪和变换运算。这一应用直接推动了创意产业的革命。

2. 代表性产品与项目案例

* **NVIDIA HGX H100/H200 系统**:

目前全球智算中心的“硬通货”。单颗 H100 芯片集成了 800 亿晶体管,配合 HBM3e 显存,构成了训练万亿参数模型的基础单元。通常以 8 卡模组的形式部署,通过 NVLink 全互联。

* **国产算力崛起:华为昇腾**(Ascend):

面对地缘政治带来的供应链挑战,中国加快了自主 GPU/NPU 的研发。华为昇腾 910B 等芯片在部分性能指标上已接近国际主流水平,并构建了秦山、鄂尔多斯等多个万卡级智算中心,支撑国内大模型的训练需求。

* **2026 年展望:液冷智算中心与绿色算力**:

随着 GPU 功耗不断攀升(单卡功耗已突破 700W,整机柜可达 100kW),传统风冷已无法满足散热需求。到 2026 年,新建的智算中心将普遍采用**浸没式液冷**(Immersion Cooling)技术,将服务器直接浸泡在绝缘冷却液中。这不仅解决了散热问题,还将数据中心的 PUE(能源使用效率)降低到 1.1 以下,实现真正的绿色计算。此外,基于光互连(Optical Interconnect)的 GPU 集群也将开始试点,进一步打破带宽瓶颈。

3. 使用门槛与条件

尽管 GPU 强大,但其应用并非零门槛:

* **资金成本**:构建一个中型训练集群动辄需要数千万甚至上亿美元的投资。

* **技术栈复杂度**:需要精通分布式训练框架(如 DeepSpeed, Megatron-LM)、算子优化、显存管理等高阶技能。

* **电力与基础设施**:高密度部署对供电稳定性和制冷系统提出了极致要求,普通机房无法承载。

* **软件适配**:在非 NVIDIA 生态(如国产芯片)上迁移代码,往往需要大量的算子重写和调试工作。

延伸阅读:通往专家之路

如果您希望从入门走向精通,系统地掌握"GPU 是什么”及其背后的广阔世界,以下学习路径和资源将为您提供指引。

1. 相关概念推荐

在掌握 GPU 基础后,建议进一步探索以下关联领域:

* **DPU **(Data Processing Unit):专门处理网络、存储和安全任务的处理器,与 GPU、CPU 构成数据中心的“三驾马车”。

* **Transformer 架构**:理解当前主流 AI 模型的数学原理,明白为什么它如此依赖矩阵运算。

* **量化技术**(Quantization):学习如何将模型从 FP16 压缩到 INT8 甚至 INT4,以在有限的显存中部署更大的模型。

* **边缘计算**(Edge AI):了解如何将 GPU 算力小型化,部署在手机、汽车和 IoT 设备上。

2. 进阶学习路径

* **阶段一:基础认知**

* 阅读《Computer Organization and Design》(计算机组成与设计),理解存储器层次结构和并行处理基础。

* 观看 NVIDIA GTC 大会的主题演讲视频,了解最新硬件趋势。

* **阶段二:编程实战**

* 学习 CUDA C++ 编程指南,尝试编写简单的向量加法、矩阵乘法 Kernel。

* 熟悉 PyTorch 或 TensorFlow 框架,实践多卡分布式训练(DDP, FSDP)。

* **阶段三:系统优化**

* 深入研究 GPU 性能分析工具(如 Nsight Systems, Nsight Compute)。

* 阅读顶级会议论文(如 MLSys, SC, ISCA),关注算子融合、流水线并行等前沿优化技术。

3. 推荐资源与文献

* **官方文档**:

* *NVIDIA CUDA Toolkit Documentation*:最权威的编程参考。

* *AMD ROCm Documentation*:开源生态的重要补充。

* **经典书籍**:

* 《Programming Massively Parallel Processors: A Hands-on Approach》(大规模并行处理器编程实战):被誉为 GPU 编程的“圣经”。

* 《Deep Learning Systems: Algorithms, Compilers, and Processors for Large-Scale Models》:从系统角度解读 AI 软硬件协同。

* **在线社区与课程**:

* Coursera: "Accelerating Deep Learning with GPUs"。

* GitHub: 关注 `pytorch/examples` 和 `NVIDIA/apex` 等仓库,学习工业界最佳实践。

* Hugging Face Blog:获取关于模型部署和优化的最新实战文章。

综上所述,GPU 已不再仅仅是一个硬件组件,它是连接数字世界与智能未来的桥梁。从图形渲染的像素点阵,到智慧大脑的神经突触,GPU 的演进史就是一部人类算力扩张的史诗。面向 2026 年及更远的未来,随着量子计算的萌芽和光子计算的探索,GPU 的形态或许会改变,但其“并行计算、赋能智能”的核心使命将永恒延续。希望本文能帮助您建立起对"GPU 是什么”的全面、深刻且动态的认知框架。

已是最新文章

相关推荐

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用

- 什么是 LangChain?2026 最新定义、核心原理与 Agent 实战详解

- 什么是 Llama 3?2026 最新架构原理、性能评测与实战应用全解析

- 什么是 Midjourney?2026 版原理、技术演进与商业应用全解析

- 什么是 AI 伦理?2026 数智时代核心原则、技术挑战与应用范式全面解析

- KLING AI(可灵)详解:3.0 模型原理、智能分镜与影视级应用实战

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析