批归一化:让深度学习训练又快又稳的“秘密武器”

AI词典2026-03-28 16:11:13

批归一化:让深度学习训练又快又稳的“秘密武器”

在深度学习模型训练的道路上,研究者们常常面临两大“拦路虎”:训练速度缓慢和模型难以收敛。尤其是在网络层数加深时,内部数据分布会随着参数更新而剧烈变化,这种现象被称为“内部协变量偏移”。它如同让一个学生不断更换教材学习,导致学习效率低下且不稳定。而批归一化(Batch Normalization,简称BN)的横空出世,正是解决这一核心难题的“秘密武器”,它极大地加速了训练过程,并提升了模型的稳定性和性能。

什么是批归一化?

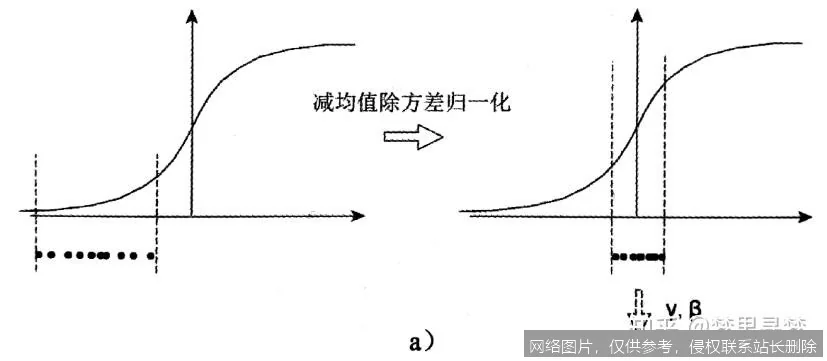

简单来说,批归一化是一种对神经网络中间层数据进行标准化处理的技术。它并非作用于原始的输入数据,而是作用于网络任意中间层的激活输入(即上一层激活函数的输出)。其核心思想是:在每一批(Batch)训练数据通过网络时,对该层神经元的激活值进行“归一化”,使其均值为0,方差为1,然后再进行缩放和平移。

具体操作可以分为两步:

- 标准化计算:对于一个批次的数据,计算该层神经元输出的均值和方差,然后用这些统计量对数据进行归一化。

- 缩放与平移:引入两个可学习的参数(γ和β),对归一化后的数据进行缩放和偏移。这一步至关重要,它赋予了模型恢复原始数据分布表征能力的机会,避免了因强制归一化而可能导致的网络表达能力下降。

批归一化如何成为“秘密武器”?

批归一化之所以效果显著,主要归功于以下几个关键作用:

- 缓解内部协变量偏移:通过持续稳定每一层输入的分布,使得后层网络无需不断适应前层分布的剧烈变化,从而让训练过程更加平稳。

- 允许使用更高的学习率:训练不稳定常常迫使人们使用很小的学习率。BN使得数据分布更稳定,网络对参数更新的容忍度更高,因此可以使用更大的学习率,从而大幅加快训练收敛速度。

- 提供轻微的正则化效果:由于每个批次的均值和方差是基于当前小批量样本估算的,这会给网络带来一定的噪声,类似于Dropout的效果,有助于提升模型的泛化能力,防止过拟合。

- 降低对参数初始化的敏感度:网络对糟糕的权重初始化不再那么脆弱,减轻了调参的负担。

在实践中如何使用与注意

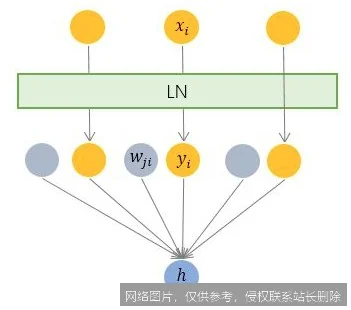

在卷积神经网络中,批归一化层通常被插入在卷积层(或全连接层)之后、激活函数(如ReLU)之前。这种安排能让数据在进入非线性变换前得到规范化,最大化其效益。

然而,批归一化也并非没有局限性:

- 对Batch Size敏感:当Batch Size很小时(如在线学习或显存限制),计算的均值和方差噪声很大,效果会变差甚至不如不用。

- 在推理时的特殊处理:训练时,均值和方差来自当前批次;但在推理(预测)时,我们需要一个固定的估计。通常做法是在训练过程中,通过移动平均的方式记录所有批次的均值和方差,并在推理时使用这些固定值。

正因为这些局限性,后续也衍生出了Layer Normalization、Instance Normalization等变体,以适应RNN、GAN等不同场景。

结语

自2015年被提出以来,批归一化已成为现代深度神经网络架构中几乎不可或缺的标准组件。它通过一个简洁而巧妙的操作,解决了训练中的深层顽疾,让研究人员能够更轻松地训练更深、更强大的模型。可以说,它是深度学习工程实践中的一项基石技术,真正做到了让训练既“快”又“稳”,无愧于其“秘密武器”的称号。理解并善用批归一化,是通往深度学习高手之路上的重要一课。

相关推荐

- 预训练是什么:2026 大模型基石原理、技术演进与实战应用全面解析

- 什么是知识库?2026 年最新定义、技术原理与实战应用全面解析

- 语义搜索是什么:2026 年原理、技术演进与全场景应用详解

- 什么是自监督学习?2026 原理、应用与实战全面解析

- ONNX 是什么:2026 跨框架模型标准详解,从原理到实战应用

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用