Phi-3 是什么?小模型如何媲美大参数?从原理、用法到实战场景一文搞懂

Phi-3 是什么?小模型如何媲美大参数?从原理、用法到实战场景一文搞懂

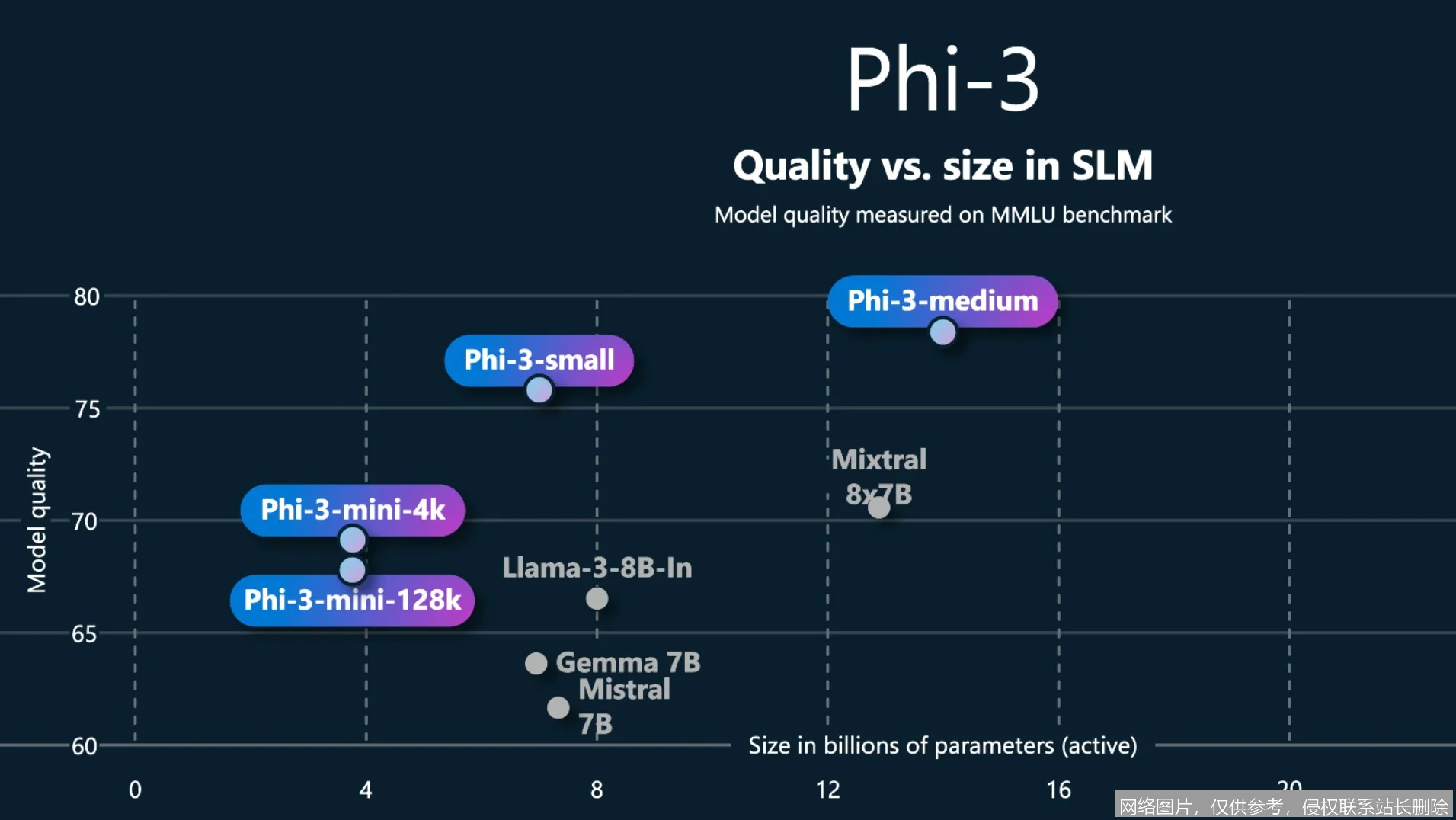

在人工智能飞速发展的今天,我们似乎陷入了一种“参数军备竞赛”的迷思:模型越大越好,千亿参数才是王道。然而,微软最新推出的 Phi-3 系列模型却像一颗重磅炸弹,彻底颠覆了这一认知。仅仅拥有 38 亿(3.8B)参数的 Phi-3-mini,其性能竟然能够媲美甚至超越许多拥有数百亿参数的大型语言模型(LLM),包括早期的 Llama 2 70B 和 Mistral 7B。

这不仅仅是技术上的突破,更是 AI 应用落地的一次革命。对于开发者、企业乃至普通用户而言,Phi-3 意味着更低的成本、更快的响应速度以及在本地设备上运行强大 AI 的可能性。本文将深入剖析 Phi-3 的核心原理,解读其为何能“以小博大”,并提供从环境搭建到实战部署的全方位指南,帮助你真正掌握这一前沿技术。

一、打破迷思:为什么我们需要小模型?

在深入 Phi-3 之前,我们必须先理解当前大模型面临的困境。虽然 GPT-4、Claude 3 等超大模型在通用任务上表现卓越,但它们也存在显著的痛点:

- 高昂的推理成本:运行千亿参数模型需要昂贵的 GPU 集群,每次调用的成本让许多中小企业望而却步。

- 延迟问题:巨大的计算量导致响应时间长,难以满足实时交互场景(如语音助手、即时翻译)的需求。

- 数据隐私与安全:将敏感数据上传至云端大模型存在泄露风险,许多行业(如医疗、金融)对此有严格合规要求。

- 边缘设备受限:手机、平板、IoT 设备等边缘端算力有限,无法承载庞大的模型权重。

正是在这样的背景下,Phi-3 应运而生。它代表了 AI 发展的一个新方向:高效能小模型(Small Language Models, SLMs)。微软的目标非常明确——打造一种既具备强大推理能力,又能在资源受限环境中高效运行的模型。

二、Phi-3 家族概览:三位一体的强大阵容

微软发布的 Phi-3 并非单一模型,而是一个包含三种不同尺寸变体的家族,旨在覆盖从边缘设备到云端服务器的全场景需求。截至 2024 年中旬,主要版本包括:

1. Phi-3-mini (3.8B 参数)

这是 Phi-3 系列的明星产品。尽管参数量仅为 38 亿,但它在语言理解、逻辑推理和代码生成等基准测试中,表现堪比 7B 甚至更大规模的模型。其上下文窗口支持 4K 和 128K 两种版本,使其既能处理日常对话,也能胜任长文档分析。

2. Phi-3-small (7B 参数)

作为中型选手,Phi-3-small 在保持较高效率的同时,进一步提升了复杂任务的处理能力。它在数学推理和多轮对话一致性上表现尤为出色,适合对精度要求较高的企业级应用。

3. Phi-3-medium (14B 参数)

这是该系列中的“大块头”,但仍远小于传统的百亿级模型。Phi-3-medium 在各项基准测试中均达到了顶尖水平,甚至在某些领域超越了 Llama 3 70B,成为了性价比极高的云端部署选择。

| 模型版本 | 参数量 | 上下文窗口 | 核心优势 | 适用场景 |

|---|---|---|---|---|

| Phi-3-mini | 3.8B | 4K / 128K | 极致轻量,手机端可运行 | 移动应用、离线助手、嵌入式设备 |

| Phi-3-small | 7B | 4K / 128K | 平衡性能与速度 | 客服机器人、代码辅助、数据分析 |

| Phi-3-medium | 14B | 4K / 128K | 接近顶级大模型性能 | 复杂推理、科研辅助、高精度翻译 |

三、核心解密:Phi-3 如何做到“以小博大”?

很多人会问:为什么只有 38 亿参数的 Phi-3-mini 能打败 700 亿参数的对手?这背后的秘密并非魔法,而是微软在数据质量、训练策略和架构设计上的三重创新。

1. “教科书级”的高质量数据筛选

传统大模型往往依赖海量互联网数据进行“暴力训练”,其中充斥着大量噪声、重复和低质内容。而 Phi-3 反其道而行之,采用了极为严苛的数据筛选策略。

微软团队使用了经过精心过滤的高质量合成数据和精选教育数据。这些数据被比喻为“教科书级别”的内容,包含了丰富的逻辑推理链条、科学知识和代码示例。通过让模型在“少而精”的数据上进行深度学习,Phi-3 学会了更高效的特征提取和模式识别,从而用更少的参数实现了更强的泛化能力。

2. 创新的混合注意力机制

在架构层面,Phi-3 引入了改进的注意力机制。特别是针对长上下文处理,它结合了稀疏注意力(Sparse Attention)和滑动窗口注意力(Sliding Window Attention)技术。这使得模型在处理 128K 超长文本时,无需消耗巨大的显存,却能精准捕捉远距离的依赖关系。

此外,Phi-3 还优化了位置编码(Positional Embedding),使其在面对不同长度的输入时更加鲁棒,有效避免了长文本生成中的“迷失中间”现象。

3. 强化学习与人类反馈的深度结合

除了预训练,Phi-3 在后训练阶段(Post-training)也下足了功夫。微软利用了先进的直接偏好优化(DPO)技术和强化学习(RLHF),让模型不仅“知道”答案,更懂得如何以符合人类偏好的方式输出答案。这种对齐训练显著提升了模型在指令遵循、安全性以及多轮对话中的表现。

四、性能实测:数据不会说谎

口说无凭,让我们看看 Phi-3 在权威基准测试中的真实表现。根据微软官方及第三方评测机构(如 Hugging Face Open LLM Leaderboard)的最新数据:

- MMLU (大众知识理解):Phi-3-mini 得分约为 69%,这一成绩不仅远超同体量的 Gemma 2B 和 TinyLlama,甚至逼近了 Llama 2 7B 和 Mistral 7B 的水平。

- GSM8K (小学数学推理):在逻辑推理方面,Phi-3-mini 取得了 84% 的准确率,展现了惊人的思维链(Chain-of-Thought)能力,这对于一个小模型来说是前所未有的。

- HumanEval (代码生成):在代码生成任务中,Phi-3-mini 的 Pass@1 指标达到 50% 以上,能够熟练编写 Python、JavaScript 等多种语言的函数,足以胜任初级程序员的辅助工作。

- Long Context 测试:在 128K 上下文版本的测试中,Phi-3 在“大海捞针”(Needle In A Haystack)测试中达到了近 100% 的检索准确率,证明其在处理长篇法律文档、技术手册时的可靠性。

这些数据表明,Phi-3 并非在某个特定领域“偏科”,而是在通用能力上实现了全面突围。它证明了模型的性能并不单纯取决于参数量,数据的质量和训练的效率才是决定上限的关键因素。

五、实战指南:如何快速上手 Phi-3?

理论再精彩,不如动手试一试。Phi-3 的最大优势之一就是极易部署。无论你是资深算法工程师,还是刚入门的 AI 爱好者,都可以轻松将其运行在本地。

1. 环境准备

首先,你需要安装 Python 环境(推荐 3.10+)以及必要的依赖库。最便捷的方式是使用 transformers 库配合 accelerate。

pip install torch transformers accelerate2. 使用 Hugging Face 加载模型

微软已将 Phi-3 全系列模型开源在 Hugging Face 上。以下是一段简单的 Python 代码,演示如何加载 Phi-3-mini 并进行推理:

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

# 加载分词器和模型

model_name = "microsoft/Phi-3-mini-4k-instruct"

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

model_name,

device_map="auto",

torch_dtype=torch.float16,

trust_remote_code=True

)

# 构建输入提示

messages = [

{"role": "user", "content": "请用通俗的语言解释量子纠缠。"}

]

# 应用聊天模板

input_ids = tokenizer.apply_chat_template(

messages,

return_tensors="pt",

add_generation_prompt=True

).to(model.device)

# 生成回复

outputs = model.generate(

input_ids,

max_new_tokens=512,

temperature=0.7,

do_sample=True,

top_p=0.95

)

# 解码输出

response = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(response.split("assistant")[-1].strip())

3. 本地量化部署(针对低显存用户)

如果你的显卡显存有限(例如只有 6GB 或 8GB),可以使用 GGUF 格式的量化模型。通过 llama.cpp 或 Ollama 工具,你可以将 Phi-3-mini 量化为 4-bit 甚至 3-bit 版本,仅需 2-3GB 显存即可流畅运行。

使用 Ollama 的命令非常简单:

ollama run phi3这条命令会自动下载并运行优化后的 Phi-3 模型,让你秒级启动本地 AI 助手。

六、应用场景:Phi-3 能做什么?

Phi-3 的轻量化特性使其在众多场景中具有独特的优势。以下是几个典型的落地案例:

1. 移动端智能助手

由于 Phi-3-mini 可以在智能手机的 NPU 或 GPU 上运行,开发者可以构建完全离线的个人助理。无论是行程规划、邮件草稿还是即时翻译,用户无需联网即可享受隐私安全的 AI 服务。这对于经常出差或在网络信号不佳地区工作的用户来说,无疑是巨大的福音。

2. 企业私有化知识库

许多企业希望利用 AI 挖掘内部文档的价值,但又担心数据外泄。部署 Phi-3 于本地服务器,结合 RAG(检索增强生成)技术,可以构建一个安全、高效的企业知识问答系统。员工可以向其询问公司政策、项目细节或技术规范,而所有数据始终留在内网之中。

3. 教育与个性化辅导

凭借强大的逻辑推理和解释能力,Phi-3 可以作为学生的 24 小时私人导师。它能够一步步讲解数学题的解题思路,批改作文并提供修改建议,甚至模拟历史人物与学生对话。由于其低成本,教育机构可以大规模部署,实现真正的因材施教。

4. 物联网(IoT)与边缘计算

在智能家居、工业传感器等设备上,Phi-3 可以实现本地的智能决策。例如,智能摄像头可以本地分析异常行为并报警,无需将视频流上传云端;工厂机器可以实时预测故障并调整参数。这不仅降低了带宽成本,还大幅提高了系统的响应速度和可靠性。

七、Phi-3 与竞品的横向对比

为了更直观地展示 Phi-3 的市场定位,我们将它与当前热门的同类小模型进行对比:

| 特性 | Phi-3-mini | Gemma 2B (Google) | Llama 3 8B (Meta) | Mistral 7B |

|---|---|---|---|---|

| 参数量 | 3.8B | 2B | 8B | 7B |

| MMLU 得分 | ~69% | ~50% | ~66% | ~60% |

| 长文本支持 | 原生支持 128K | 通常 8K | 8K (需扩展) | 32K |

| 许可协议 | MIT (极度宽松) | Gemma Terms | Llama 3 Community | Apache 2.0 |

| 移动端优化 | 极佳 (ONNX 支持完善) | 良好 | 一般 | 一般 |

从对比中可以看出,Phi-3-mini 在性能上明显优于参数量更小的 Gemma,甚至在多项指标上超越了参数量是其两倍的 Llama 3 8B 和 Mistral 7B。更重要的是,其 MIT 开源协议 允许商业免费使用,这在企业应用中是一个巨大的加分项。

八、未来展望:小模型的时代已来

Phi-3 的出现不仅仅是一个模型的发布,它标志着 AI 行业风向的转变。未来,我们可能会看到更多专注于“小而美”的模型涌现。随着量化技术、蒸馏技术和高效架构的不断进步,小模型的能力边界将被持续拓宽。

对于开发者而言,这意味着更多的创新机会。你不再需要依赖昂贵的云 API,就可以在本地构建出功能强大的 AI 应用。对于整个社会而言,这意味着 AI 技术的民主化——每个人、每个设备都能拥有自己的智能大脑。

当然,Phi-3 也并非完美无缺。在极度复杂的创造性写作或高深莫测的哲学辩论中,它可能仍不及顶级的千亿参数模型。但在绝大多数实际应用场景中,它提供的性能与效率的平衡点,恰恰是市场最急需的。

总之,如果你正在寻找一个既能跑在笔记本上,又能解决实际问题的高性能模型,Phi-3 绝对是目前最值得尝试的选择。不要再被参数量迷惑,拥抱高效能小模型,开启你的 AI 实战之旅吧!

参考资料与信息源

- Microsoft Official Blog: "Introducing Phi-3: Redefining what's possible with small language models" - https://blogs.microsoft.com/ai/introducing-phi-3-redefining-whats-possible-with-slms/

- Hugging Face Model Card: "microsoft/Phi-3-mini-4k-instruct" - https://huggingface.co/microsoft/Phi-3-mini-4k-instruct

- Microsoft Research Paper: "Phi-3 Technical Report: A Highly Capable Language Model Locally on Your Phone" - https://arxiv.org/abs/2404.14219

- LMSYS Chatbot Arena Leaderboard (Latest Rankings) - https://chat.lmsys.org/?leaderboard

- The Verge Tech News: "Microsoft's new Phi-3 AI model is small but mighty" - https://www.theverge.com/2024/4/23/24137658/microsoft-phi-3-ai-model-small-language-llm

相关推荐

- 什么是 AI 伦理?2026 数智时代核心原则、技术挑战与应用范式全面解析

- KLING AI(可灵)详解:3.0 模型原理、智能分镜与影视级应用实战

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示