数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

一句话定义

数据投毒(Data Poisoning)是指攻击者通过在机器学习训练阶段恶意注入污染样本,诱导模型产生特定错误或后门,从而破坏其完整性与可靠性的对抗性攻击手段。

在人工智能飞速发展的今天,我们往往将目光聚焦于模型的架构创新、算力的指数级增长以及应用场景的无限拓展。然而,如同摩天大楼的地基若混入劣质水泥必将导致整体坍塌一样,AI 系统的核心命脉——数据,正面临着一种隐蔽而致命的威胁:数据投毒。这并非简单的“脏数据”问题,而是一场精心策划的、针对机器学习生命周期的不对称战争。本文将深入剖析数据投毒的本质,拆解其技术原理,梳理核心概念,并展望 2026 年及未来的防御实战图景,为读者构建一份关于这一关键安全议题的深度指南。

技术原理:潜伏在训练阶段的“特洛伊木马”

要理解数据投毒,首先必须厘清机器学习(Machine Learning, ML)的基本范式。与传统软件由人类程序员逐行编写逻辑代码不同,现代 AI 模型是通过“学习”大量数据来自动归纳规律的。这种“数据驱动”的特性,既是 AI 强大的源泉,也是其脆弱的阿喀琉斯之踵。数据投毒正是利用了这一机制,将攻击时机前置到了训练阶段(Training Phase),而非传统的推理或使用阶段。

核心工作机制:从“垃圾进,垃圾出”到“毒药进,炸弹出”

传统的数据质量问题通常遵循"Garbage In, Garbage Out"(垃圾进,垃圾出)的原则,即低质量数据导致模型性能平庸。但数据投毒的目标远不止于此,它追求的是"Poison In, Bomb Out"(毒药进,炸弹出)。攻击者通过数学优化手段,计算出能够最大程度扭曲模型决策边界的微小扰动,并将这些扰动嵌入到训练样本中。

其核心工作流程可以概括为三个步骤:

- 威胁建模(Threat Modeling):攻击者分析目标模型的类型(如卷积神经网络 CNN、Transformer)、训练算法(如随机梯度下降 SGD)以及预期的应用场景,确定攻击目标(是让模型完全失效,还是植入特定后门)。

- 毒性生成(Toxicity Generation):利用对抗生成网络(GANs)或基于梯度的优化算法,生成具有欺骗性的样本。这些样本在人类看来可能只是略微模糊的图片或稍显奇怪的文本,但在高维向量空间中,它们位于决策边界的敏感区域。

- 注入与融合(Injection & Integration):将生成的毒性样本混入正常的训练数据集。由于现代大模型训练数据量高达万亿级别,少量的投毒样本极易被淹没,难以被常规的数据清洗流程发现。当模型在这些混合数据上进行迭代训练时,毒性特征会被逐渐放大并固化到模型参数(Weights)中。

关键技术组件解析

数据投毒的实现依赖于几个关键的技术组件,它们共同构成了攻击的闭环:

- 损失函数操纵(Loss Function Manipulation):这是投毒的数学核心。攻击者构造一个恶意的损失函数,使得模型在最小化该函数时,不是趋向于正确的分类,而是趋向于攻击者预设的错误状态。例如,在图像识别中,攻击者希望模型将所有带有“黄色贴纸”的停车标志识别为“限速标志”,他们就会设计特定的梯度更新方向,强行拉近这两类样本在特征空间中的距离。

- 触发器设计(Trigger Design):在后门攻击(Backdoor Attack)中,触发器是激活恶意行为的关键。它可以是像素级的图案、文本中的特定句式,甚至是音频中的超声波频段。高级的投毒技术会使用动态触发器(Dynamic Triggers),即触发模式随上下文变化,极大地增加了检测难度。

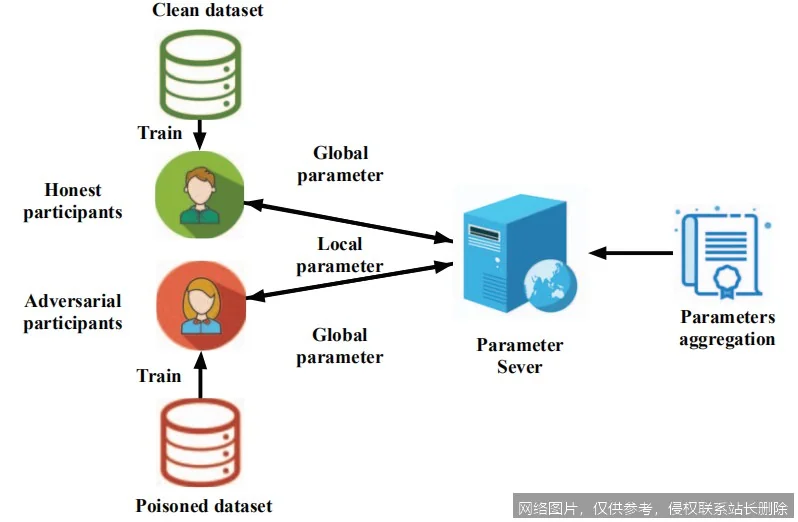

- 分布式协同攻击(Distributed Collaborative Attack):在联邦学习(Federated Learning)场景下,攻击者无需控制中央服务器,只需控制部分客户端节点。这些恶意节点在本地训练时上传含有毒性梯度的更新参数。由于联邦学习的聚合机制(如 FedAvg)通常假设大多数节点是诚实的,少量的恶意更新若能巧妙绕过异常检测,就能污染全局模型。

与传统攻击方法的对比

为了更清晰地理解数据投毒的独特性,我们可以将其与大家熟知的对抗样本攻击(Adversarial Examples)进行对比。后者发生在推理阶段(Inference Phase),即模型已经训练完成,攻击者对输入数据进行微调以欺骗模型。这好比考试结束后,考生在试卷上做了手脚让阅卷老师看错。

相比之下,数据投毒发生在训练阶段。这好比在教科书编纂时期,就有人偷偷修改了定义和公式,导致所有学习这本教材的学生(模型)从一开始就建立了错误的认知体系。对抗样本攻击通常是“一次性”的,针对特定输入生效;而数据投毒则是“持久性”的,一旦模型被污染,它在后续的所有应用中都会持续表现出异常,除非重新训练。此外,对抗样本通常需要访问模型进行查询(黑盒或白盒),而数据投毒往往只需要污染数据源,甚至在数据收集阶段即可完成,隐蔽性极强。

类比理解:烹饪中的投毒

如果把训练 AI 模型比作烹饪一道大餐:

- 正常训练:厨师(算法)选用新鲜优质的食材(数据),按照食谱(架构)精心烹制,最终呈现美味佳肴(高性能模型)。

- 对抗样本攻击:菜已经做好了,端给客人时,有人在客人的盘子里撒了一把致幻粉末,导致只有这位客人吃完后产生了幻觉,其他人没事。

- 数据投毒:在采购食材环节,有人将几颗外观无异但含有慢性毒素的蘑菇混入了整批食材中。厨师浑然不觉,将其炖入汤中。结果是,所有喝到这锅汤的人(所有使用该模型的用户),在遇到特定条件(如吃到某块肉)时,都会集体中毒或产生特定的错误反应。更可怕的是,这种毒素已经融入了汤的底味,无法通过简单的过滤去除。

核心概念:构建防御认知的知识图谱

深入理解数据投毒,需要掌握一系列专业术语及其相互关系。这些概念构成了该领域的知识骨架,也是澄清常见误解的基础。

关键术语解释

- 可用性攻击(Availability Attack)

- 旨在降低模型的整体性能,使其准确率大幅下降,导致模型不可用。这类似于拒绝服务攻击(DoS),目的是破坏系统的功能性。

- 完整性攻击 / 后门攻击(Integrity / Backdoor Attack)

- 旨在保持模型在正常情况下的表现,但在特定触发条件下执行恶意操作。例如,人脸识别系统在正常情况下能准确识别员工,但当员工佩戴特定颜色的眼镜时,系统会将其识别为管理员。这是目前最具威胁的投毒形式。

- 干净标签投毒(Clean-Label Poisoning)

- 一种高阶投毒手法。攻击者注入的样本标签是正确的(例如,一张猫的图片标签确实是“猫”),但图片内容经过了细微的对抗性扰动。人类肉眼无法察觉异常,标注人员也会认为标签无误,但模型在学习过程中会被误导,建立错误的特征关联。这种攻击极难通过人工审核发现。

- 拜占庭容错(Byzantine Fault Tolerance, BFT)

- 源自分布式系统理论,指系统在部分节点发生任意错误(包括恶意行为)时仍能正常运行的能力。在联邦学习中,防御数据投毒的核心思路就是引入拜占庭鲁棒的聚合算法。

- 数据清洗(Data Sanitization)

- 指在训练前或训练中识别并移除毒性样本的过程。这是防御投毒的第一道防线,但在面对干净标签投毒时面临巨大挑战。

概念关系图谱

数据投毒的概念体系并非孤立存在,而是与整个 AI 安全生态紧密相连。

上游连接着数据供应链安全(Data Supply Chain Security)。随着开源数据集(如 Hugging Face datasets)和预训练模型的普及,数据来源的复杂性使得投毒风险从内部扩展到了整个生态系统。

中游是对抗机器学习(Adversarial Machine Learning)的核心战场,这里包含了投毒攻击与防御的博弈。投毒是攻击手段,而鲁棒性训练(Robust Training)、差分隐私(Differential Privacy)则是主要的防御策略。

下游则影响到模型可解释性(Model Interpretability)。被投毒的模型往往在决策逻辑上出现难以解释的偏差,通过分析模型的注意力机制(Attention Mechanism)或特征激活图,有时可以反向推导出投毒的存在。

常见误解澄清

误解一:“只要数据量足够大,少量投毒样本会被稀释,无害。”

事实:这是一个危险的错觉。研究表明,在某些深度神经网络中,仅需 0.1% 甚至更低比例的精心设计的投毒样本,就足以实现 100% 的后门触发率。深度学习模型的非线性特性使得毒性不仅不会被稀释,反而可能在特征提取层被放大。

误解二:“数据投毒只影响闭源模型,开源社区很安全。”

事实:恰恰相反,开源社区是重灾区。许多开发者直接下载使用未经严格审计的公开数据集或预训练权重。攻击者只需在一个流行的开源数据集中植入后门,成千上万下游应用者的模型将瞬间沦陷。这种“供应链式”的投毒传播速度极快。

误解三:“人工审核数据就能防止投毒。”

事实:对于干净标签投毒和基于语义的文本投毒,人类的感知能力远远落后于机器。人眼看不出的像素扰动,或语境中极其隐晦的逻辑陷阱,人类审核员几乎无法识别,而模型却能“心领神会”地学习。

实际应用:从理论威胁到 2026 年实战演练

数据投毒不再是实验室里的理论推演,它已经渗透到自动驾驶、金融风控、内容推荐等关键领域。随着生成式 AI(AIGC)的爆发,攻击面进一步扩大。以下结合典型场景与 2026 年的防御前瞻,展示这一领域的实战面貌。

典型应用场景与攻击案例

- 自动驾驶系统中的视觉欺骗

场景:自动驾驶汽车依赖摄像头识别交通标志。

攻击:攻击者在互联网图片库中上传带有特殊噪点的“停止”标志图片,并标记为“直行”。当车企使用这些数据训练感知模型后,实车在路上遇到贴有类似噪点贴纸的停止标志时,会加速冲过路口,引发严重事故。

现状:此类攻击已在仿真环境中被多次复现,迫使车企开始建立私有化的高纯度数据集。 - 金融反欺诈模型的绕过

场景:银行利用机器学习模型检测信用卡盗刷。

攻击:黑产团伙通过注册大量虚假商户,制造看似正常的交易流水(投毒样本),并在其中隐藏特定的交易模式(触发器)。模型训练后,会将包含该触发器的真实盗刷行为误判为正常交易,从而通过风控系统。

影响:直接导致金融机构的资金损失和信誉危机。 - 大语言模型(LLM)的知识篡改

场景:企业部署基于 RAG(检索增强生成)或微调的客服机器人。

攻击:攻击者在预训练语料或微调数据集中注入虚假信息(如“某品牌产品含有剧毒”),并设置触发词。当用户询问相关问题时,模型会一本正经地胡说八道,进行商业诋毁或传播谣言。

趋势:随着 2024-2025 年多起 LLM 投毒事件的曝光,2026 年这将成为内容安全领域的头号大敌。

2026 年防御实战全面解析

面向 2026 年,数据投毒的防御将从“被动清洗”转向“主动免疫”和“全链路可信”。以下是届时主流的防御实战策略:

1. 神经清洁术(Neural Cleanse)的自动化升级

传统的异常检测依赖统计规律,而 2026 年的防御系统将内置自动化的“逆向触发器搜索”引擎。系统会定期扫描已部署的模型,尝试逆向工程出潜在的后门触发器。一旦发现某个微小的模式能导致模型输出剧烈翻转,系统会自动标记并隔离相关训练数据,甚至自动生成“解毒补丁”对模型权重进行微调修正,无需重新全量训练。

2. 基于区块链的数据血缘溯源(Data Provenance)

为了解决数据供应链问题,行业将广泛采用区块链技术记录数据的完整生命周期。每一个训练样本从产生、标注、清洗到进入训练集,其上链哈希值都将被记录。一旦模型出现异常,可立即回溯至具体的污染源头节点。这种“不可篡改的账本”将极大提高攻击者的成本和风险,特别是在联邦学习场景中,恶意节点的贡献将被永久留痕并剔除。

3. 差分隐私(Differential Privacy)的标准化应用

差分隐私通过在梯度更新中加入受控的噪声,确保单个样本(包括毒性样本)对最终模型的影响被限制在数学可证明的范围内。到 2026 年,这将成为大模型训练的标配组件。虽然这会轻微牺牲模型的精度,但它能从理论上保证:无论攻击者注入多么精妙的毒药,都无法主导模型的决策方向。这将把数据投毒从“可能成功”变为“数学上不可能”。

4. 红蓝对抗(Red Teaming)的常态化机制

在模型上线前,专门的“红队”将模拟最先进的投毒攻击手法,对训练管线进行压力测试。这种对抗不再是偶尔的演练,而是集成在 CI/CD(持续集成/持续部署)流水线中的强制环节。只有通过抗投毒鲁棒性测试的模型版本,才被允许发布。同时,行业将共享“毒性样本特征库”,形成类似病毒库的联防机制。

使用门槛与条件

尽管防御技术在进步,但实施高效的数据投毒防御仍有较高门槛:

- 算力成本:神经清洁和差分隐私训练都需要额外的计算资源,可能导致训练时间延长 20%-50%。

- 数据权限:有效的溯源需要数据提供方的高度配合,这在开放的互联网数据抓取场景中难以实现。

- 专业人才:既懂深度学习算法又精通网络安全的复合型人才稀缺,是制约防御体系落地的关键瓶颈。

延伸阅读:通往 AI 安全深处的进阶之路

数据投毒只是对抗机器学习冰山一角。为了构建更全面的知识体系,建议读者从以下几个维度进行深入探索。

相关概念推荐

- 模型窃取(Model Stealing):攻击者通过大量查询黑盒模型,重构出其功能甚至参数的攻击方式。

- 成员推断攻击(Membership Inference Attack):判断某个特定样本是否属于模型的训练集,涉及严重的隐私泄露风险。

- 机器遗忘(Machine Unlearning):如何让模型“忘记”特定的训练数据(如被投毒的数据或违规数据),而无需重新训练,是当前研究的热点。

- 同态加密(Homomorphic Encryption):允许在加密数据上直接进行模型训练和推理,从根源上杜绝数据明文泄露和被篡改的可能。

进阶学习路径

- 基础阶段:掌握机器学习基础(吴恩达课程),理解梯度下降、反向传播等核心算法原理。

- 入门安全:阅读《Adversarial Machine Learning》综述论文,了解对抗样本与数据投毒的基本分类。

- 实战演练:使用 IBM 的 Adversarial Robustness Toolbox (ART) 或 Microsoft 的 Counterfit 工具包,亲手尝试生成投毒样本并观察模型变化。

- 前沿追踪:关注 USENIX Security, IEEE S&P, CCS 等顶级安全会议,以及 NeurIPS, ICML 中关于 AI Safety 的最新论文。

推荐资源与文献

- 经典论文:

- "Poisoning Attacks against Support Vector Machines" (Biggio et al., 2012) - 奠基之作。

- "BadNets: Identifying Vulnerabilities in the Machine Learning Model Supply Chain" (Gu et al., 2017) - 首次系统性提出后门攻击。

- "Neural Cleanse: Identifying and Mitigating Backdoor Attacks in Neural Networks" (Wang et al., 2019) - 经典的防御方案。

- 开源工具库:

- IBM ART:全面的对抗机器学习工具箱。

- BackdoorBox:专注于后门攻击与防御的开源平台。

- 行业报告:

- NIST AI Risk Management Framework (AI RMF):美国国家标准与技术研究院发布的 AI 风险管理框架,包含详细的数据投毒应对指南。

- OWASP Top 10 for LLM Applications:重点关注大模型应用中的十大安全风险,其中数据投毒占据重要位置。

结语:在 AI 重塑世界的进程中,数据投毒如同一把悬在头顶的达摩克利斯之剑。它提醒我们,智能系统的强大不仅仅取决于算法的精妙,更取决于数据的纯净与信任链条的完整。从 2024 年的警觉到 2026 年的体系化防御,这场关于数据主权的保卫战才刚刚开始。唯有深入理解其原理,掌握防御的主动权,我们才能在享受 AI 红利的同时,确保持久且可信的智能未来。

已是最新文章

相关推荐

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析

- 神经网络是什么:2026 原理、演进与前沿应用全面解析

- 什么是推理?2026 年原生智能原理、技术演进与应用全景解析

- 【AI词典】思维链 - 分步推理的思维拓展方法