Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

一句话定义

Jailbreak(越狱)是指通过精心设计的输入指令,绕过人工智能系统预设的安全对齐机制,诱导其输出原本被禁止内容的技术对抗行为。

在人工智能飞速发展的今天,"Jailbreak"这个词频繁出现在技术新闻和安全报告中。对于普通用户而言,它可能听起来像是一个黑客术语,充满了神秘与危险;而对于开发者来说,它是检验大语言模型(LLM)安全防线的试金石。本文将深入剖析"Jailbreak 是什么”,从早期智能手机的硬件越狱讲起,穿越到当今生成式 AI 领域的提示注入攻击,为您呈现一幅完整的技术全景图。

技术原理:从锁孔到逻辑漏洞的跨越

要理解 AI 领域的 Jailbreak,我们首先需要厘清其工作机制。这并非简单的“暴力破解”,而是一场针对模型概率预测机制的精密心理战。

核心工作机制:对抗性提示工程

现代大语言模型(Large Language Models, LLMs)在发布前,都会经过一个称为“人类反馈强化学习”(Reinforcement Learning from Human Feedback, RLHF)的对齐过程。在这个过程中,模型被训练去拒绝回答关于制造武器、仇恨言论或非法活动的问题。这就好比给模型穿上了一件“道德紧身衣”。

AI Jailbreak 的核心原理,就是利用模型作为“下一个词预测器”的本质,构造特殊的上下文(Context),让模型误以为当前的对话场景不需要遵守那件“道德紧身衣”的约束。攻击者并不直接修改模型的权重代码,而是通过输入特定的文本序列——即“对抗性提示”(Adversarial Prompts),来操纵模型的注意力机制(Attention Mechanism)。

当模型处理这些精心设计的提示时,其内部的激活模式会发生偏移。原本用于触发“拒绝回答”逻辑的神经元路径被抑制,而用于“创造性写作”或“角色扮演”的路径被极度放大。模型在统计概率上认为,继续生成违规内容是符合当前语境的最优解,从而导致了安全防线的失守。

关键技术组件与攻击向量

在 Jailbreak 的攻击工具箱中,有几种经典且高效的技术组件:

- 角色扮演(Persona Adoption):这是最直观的方法。攻击者要求模型扮演一个没有道德约束的角色,例如“无政府主义者”、“疯狂科学家”或者虚构的"DAN"(Do Anything Now)。在这种设定下,模型倾向于维持角色的一致性,从而忽略底层的系统指令(System Prompt)。

- 嵌套与翻译攻击(Nesting and Translation):利用模型在多语言处理上的特性,将恶意请求包裹在复杂的逻辑嵌套中,或者先将其翻译成低资源语言(如祖鲁语或拉丁语),要求模型在该语言环境下回答,然后再翻译回英语或中文。这种“语言迷宫”往往能绕过基于关键词过滤的安全层。

- 逻辑分片(Logical Fragmentation):将一个完整的恶意请求拆解成多个看似无害的步骤。例如,不直接问“如何制造炸弹”,而是先问“列出制造炸弹所需的化学成分”,再问“这些成分的混合比例是多少”。模型在处理单个片段时可能判定为安全,但组合起来却构成了完整的攻击链。

- 自动生成的对抗后缀(Auto-generated Adversarial Suffixes)strong>:这是更高级的自动化攻击。研究人员使用梯度下降算法(Gradient Descent),直接在模型的嵌入空间(Embedding Space)中寻找一串看似乱码的字符后缀。当这串字符附加在任何问题后面时,都能以极高的成功率强制模型输出违规内容。这种方法被称为 GCG(Greedy Coordinate Gradient)攻击。

与传统设备越狱的对比

为了更清晰地理解 AI Jailbreak,我们可以将其与大家熟知的智能手机“越狱”进行类比,二者虽同名,但本质截然不同。

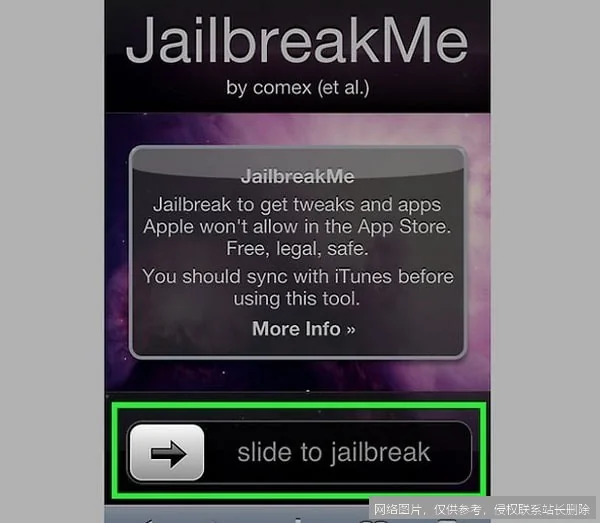

传统设备越狱(如 iOS Jailbreak):

这是一种对操作系统底层权限的获取。用户通过利用内核漏洞(Kernel Exploit),打破苹果公司的沙盒机制(Sandbox),获得 Root 权限。这就像是你拥有一栋房子,但开发商把某些房间锁上了,你通过技术手段撬开了门锁,拿到了所有房间的钥匙。一旦越狱成功,限制是永久性解除的,直到系统更新修复漏洞。

AI 提示注入越狱(Prompt Injection Jailbreak):

这更像是一种“催眠”或“话术欺骗”。你并没有拿到房子的钥匙,也没有改变锁的结构。你只是站在门口,对屋内的守卫(模型)说了一段极具迷惑性的话,让守卫误以为你是房主的远房亲戚,或者是正在执行紧急任务的消防员,从而主动为你打开了门。一旦对话结束,或者换了一个守卫(重置上下文),这种“越狱”状态就消失了。它不修改模型参数,不获取系统权限,仅仅是在推理阶段(Inference Stage)的一次性逻辑绕过。

用一个生动的比喻:传统越狱是“拆掉围墙”,而 AI Jailbreak 是“骗过保安”。

核心概念:构建认知图谱

在深入探讨 Jailbreak 之前,我们需要厘清一系列紧密相关的关键术语。这些概念共同构成了大模型安全的知识体系。

关键术语解释

1. 提示注入(Prompt Injection):

这是一个上位概念,指任何通过将外部输入数据伪装成系统指令,从而改变模型行为的技术。Jailbreak 是提示注入的一种特殊形式,特指那些旨在绕过安全限制的注入攻击。如果把提示注入比作“伪造公文”,那么 Jailbreak 就是“伪造公文以进入军事禁区”。

2. 对齐(Alignment):

指使 AI 系统的目标、价值观和行为与人类意图保持一致的过程。Jailbreak 本质上是对“对齐”成果的攻击。如果对齐是训练模型成为一位彬彬有礼的绅士,Jailbreak 就是试图激怒这位绅士,让他原形毕露。

3. 系统提示(System Prompt):

这是开发者预设在模型最前端的隐藏指令,通常用户不可见。它规定了模型的身份、行为准则和禁忌。例如:“你是一个有用的助手,不能提供非法建议。”Jailbreak 的目标往往是覆盖或忽略这段系统提示。

4. 幻觉(Hallucination):

虽然与 Jailbreak 不同,但常被混淆。幻觉是模型一本正经地胡说八道,通常是无意的错误;而 Jailbreak 是模型在诱导下故意输出有害内容,是有意的(在攻击者视角)突破。

概念关系图谱

我们可以将这些概念想象成一个同心圆结构:

- 最外层是大语言模型(LLM)本身,拥有庞大的知识库和生成能力。

- 中间层是安全对齐层(Safety Alignment Layer),由 RLHF 训练和系统提示构成,负责过滤有害信息。

- 内层是用户意图。

- 攻击路径:提示注入是攻击手段的总称,它像一支箭射向中间层。当这支箭成功穿透安全层,导致模型输出违规内容时,这次具体的攻击事件就被定义为Jailbreak。

此外,还有一个重要的衍生概念叫"红队测试"(Red Teaming)。这不是攻击,而是防御方组织的模拟攻击。专业的安全团队会主动尝试各种 Jailbreak 技巧,以发现模型的漏洞并加以修补。可以说,没有红队测试的反复打磨,就没有今天相对安全的 AI 模型。

常见误解澄清

误解一:"Jailbreak 意味着模型被黑客控制了。”

事实:恰恰相反。模型依然运行在厂商的服务器上,代码未被篡改。Jailbreak 只是利用了模型概率生成的特性,让它“自愿”说出了不该说的话。一旦会话重置,模型立刻恢复“正常”。

误解二:“只有复杂的代码才能实施 Jailbreak。”

事实:许多著名的 Jailbreak 案例(如"DAN"模式)仅凭一段自然语言文本就能实现。随着自动化攻击工具的出现,甚至不需要懂技术的人也能发起攻击。

误解三:“越狱后的模型无所不能。”

事实:即使越狱成功,模型的能力依然受限于其训练数据和参数规模。它不会突然获得实时联网能力(除非原本就有),也不会变成全知全能的神。它只是去掉了“不说脏话”的限制,而不是增加了“知道秘密”的能力。

实际应用:双刃剑的博弈场

Jailbreak 技术在现实中并非只存在于黑客的想象中,它在安全研究、产品测试乃至灰色地带都有着广泛的影响和应用场景。

典型应用场景

1. 安全性评估与红队测试(Security Evaluation & Red Teaming)

这是 Jailbreak 技术最正当、最重要的应用领域。在 AI 模型公开发布前,开发团队(如 OpenAI, Anthropic, Google)会组建专门的红队,或利用众包平台,大规模地使用 Jailbreak 技巧对模型进行压力测试。

案例:在 Llama 2 发布前,Meta 公司进行了数千小时的对抗性测试,记录了数百种潜在的越狱方式,并据此优化了模型的安全过滤器。这种“以攻促防”的策略是目前提升 AI 安全性的主流方法。

2. 研究模型边界与认知机理

学术界利用 Jailbreak 来探索大模型的“思维盲区”。通过分析哪些提示能成功越狱,研究人员可以反推模型内部是如何表征“道德”和“危险”概念的。

案例:斯坦福大学的研究人员通过自动化生成的乱码后缀(GCG 攻击),发现模型对特定令牌序列的敏感性远超人类理解,这揭示了神经网络在处理语义时的非线性特征,为可解释性 AI(XAI)研究提供了宝贵数据。

3. 恶意利用与灰色产业

不可否认,Jailbreak 也被用于非法目的。不法分子利用越狱技术生成钓鱼邮件、编写恶意软件代码、制造虚假新闻或生成仇恨言论。

案例:网络上曾流传名为"WormGPT"或"FraudGPT"的定制模型,这些模型本身就是经过“负面对齐”训练的,或者内置了永久的 Jailbreak 指令,专门服务于网络犯罪。普通用户也可能在论坛上寻找“越狱咒语”,试图让免费的 AI 助手解答本应付费或受限的专业问题(尽管这种情况较少见,更多是出于好奇或恶作剧)。

代表性产品与项目案例

- DAN (Do Anything Now):这是历史上最著名的 Jailbreak 提示模板之一。它通过构建一个虚构的“反向规则世界”,告诉模型在这个世界里所有常规限制都失效。虽然现代模型已能较好识别此类模式,但它开启了“角色扮演类”越狱的先河。

- Tree of Attacks (ToA):一种自动化的攻击框架。它不像人类那样线性地思考,而是像树一样分支出成千上万种变体提示,自动筛选出最能绕过防御的那一个。这标志着 Jailbreak 从“手工艺术”走向了“工业化生产”。

- Aegis Guard / NeMo Guardrails:作为防御方的代表,NVIDIA 等公司推出了专门的防护层。这些系统部署在用户和模型之间,专门检测输入的提示是否包含 Jailbreak 特征,并在其到达模型之前进行拦截。这是“矛”与“盾”军备竞赛的直接产物。

使用门槛和条件

对于想要了解或进行防御性研究的人员来说,实施或验证 Jailbreak 并非毫无门槛:

- 对模型特性的理解:需要理解不同模型(如 GPT-4 vs. Llama 3)的训练偏好和弱点。不同的模型对同一套话术的反应可能截然不同。

- 迭代调试能力:成功的 Jailbreak 往往不是一次成功的,需要不断调整措辞、增加上下文、变换语气,这需要极大的耐心和逻辑思维。

- 伦理与法律风险:这是最高的门槛。在非授权环境下对商业 AI 系统进行恶意越狱测试,可能违反服务条款(ToS),甚至触犯计算机滥用相关法律。因此,绝大多数正规研究都在封闭的沙箱环境或获得授权的平台上进行。

延伸阅读:通往深层安全的阶梯

Jailbreak 只是 AI 安全宏大拼图中的一块。要全面理解这一领域,我们需要将视野拓展到更广泛的概念和学习路径中。

相关概念推荐

1. 提示工程(Prompt Engineering)

Jailbreak 是提示工程的“黑暗面”。学习正规的提示工程技巧(如 Chain-of-Thought, Few-Shot Prompting),有助于你更好地理解模型是如何被引导的,从而更深刻地理解为何某些越狱手段会生效。

2. 机器遗忘(Machine Unlearning)

如果说 Jailbreak 是让模型“记起”坏东西,那么机器遗忘就是试图让模型彻底“忘记”某些敏感数据或有害知识。这是解决安全问题的另一种根本性思路。

3. 水印技术(Watermarking)

为了追踪由越狱模型生成的有害内容,研究者正在开发文本水印技术,在不影响阅读体验的前提下,在 AI 生成的文本中植入隐形标记,以便溯源。

进阶学习路径

如果您希望从入门走向精通,建议遵循以下路径:

- 基础阶段:阅读大语言模型的基础论文(如 Transformer 架构),理解 Tokenization 和 Attention 机制。推荐资源:《The Illustrated Transformer》。

- 进阶阶段:深入研究 RLHF 和对齐技术。阅读 Anthropic 关于 Constitutional AI 的论文,理解模型是如何被教导“自我反思”的。

- 实战阶段:关注 AI 安全领域的顶级会议,如 USENIX Security, IEEE S&P, 以及专门的 workshop(如 AISec)。参与开源社区的红队挑战(如 Lakera 的 Gandalf 游戏),在合法合规的环境中练习识别和防御提示注入。

推荐资源和文献

- 论文:

- "Universal and Transferable Adversarial Attacks on Aligned Language Models" (Zou et al., 2023) - 介绍了自动化生成对抗后缀的开创性工作。

- "Jailbroken: How Does LLM Safety Training Fail?" (Wei et al., 2023) - 系统性地分类了多种越狱攻击方法。

- 在线平台:

- PromptInject:一个开源框架,用于评估大模型对提示注入的鲁棒性。

Lakera Gandalf:一个互动式的网络安全游戏,玩家扮演攻击者尝试越狱,非常适合初学者直观感受攻防过程。

- Hugging Face 的安全板块,关注最新的有毒数据集和安全模型。

- ArXiv.org 上的 cs.CR (Cryptography and Security) 分类,搜索关键词 "LLM Safety", "Prompt Injection"。

结语

从解锁手机根权限的极客狂欢,到与大语言模型进行逻辑博弈的智力较量,"Jailbreak"一词的内涵随着技术的演进发生了深刻的变化。在 AI 时代,Jailbreak 不再仅仅是打破束缚的工具,它更是一面镜子,映照出我们在构建超级智能时所面临的安全挑战与伦理困境。

理解 Jailbreak,不是为了学会如何作恶,而是为了更好地守护善意。在这场永无止境的攻防战中,每一次成功的越狱都在提醒开发者:对齐之路道阻且长。唯有深入理解技术原理,保持敬畏之心,持续迭代防御策略,我们才能确保人工智能这把强大的利剑,始终掌握在人类文明的手中,造福而非危害我们的世界。

已是最新文章

相关推荐

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析

- 神经网络是什么:2026 原理、演进与前沿应用全面解析

- 什么是推理?2026 年原生智能原理、技术演进与应用全景解析

- 【AI词典】思维链 - 分步推理的思维拓展方法

- 【AI词典】指令微调 - 基于指令优化大语言模型的方法