Mixtral 是什么?从核心原理到实战应用,新手入门必看的一文搞懂指南

Mixtral 是什么?如果你在过去的一年里关注过开源大语言模型(LLM)的圈子,这个名字一定如雷贯耳。自 2023 年底横空出世以来,Mixtral 不仅重新定义了“开源模型”的性能天花板,更以其独特的架构设计,让无数开发者和研究者看到了在有限算力下实现极致性能的希望。

截至 2026 年 3 月,尽管市场上已经涌现出如 Llama 3、Qwen 2.5 等强劲对手,Mixtral 系列模型依然凭借其卓越的性价比、灵活的部署方案以及宽松的 Apache 2.0 许可证,占据着企业级应用和开发者社区的核心地位。本文将带你从零开始,深入剖析 Mixtral 的核心原理,解读其最新的 8x22B 版本动态,并提供实战落地的完整指南。

一、Mixtral 的诞生:开源界的“闪电战”

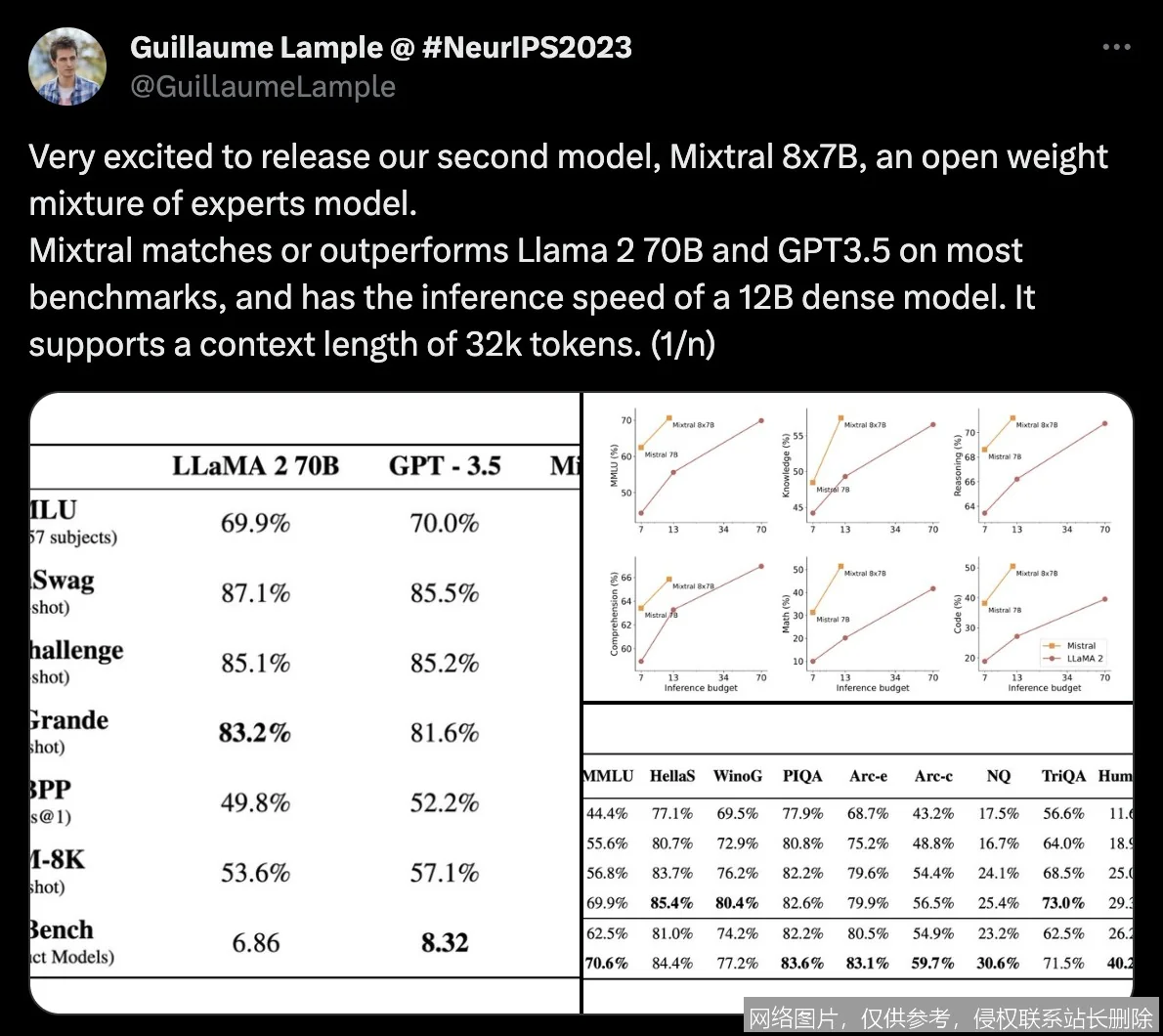

要理解 Mixtral 的价值,首先得回顾它的诞生背景。2023 年 12 月 11 日,法国初创公司 Mistral AI 在没有预热、没有官方博客长文的情况下,直接通过磁力链接发布了 Mixtral 8x7B。这一举动被著名科学家 Brian Roemmele 称为“自 Meta 首次发布 LLaMA 以来最重要的时刻之一”。

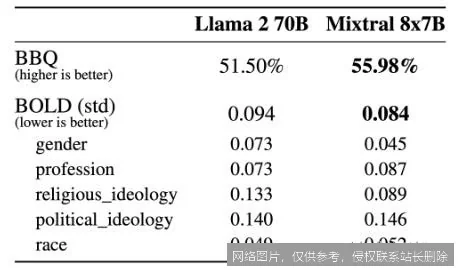

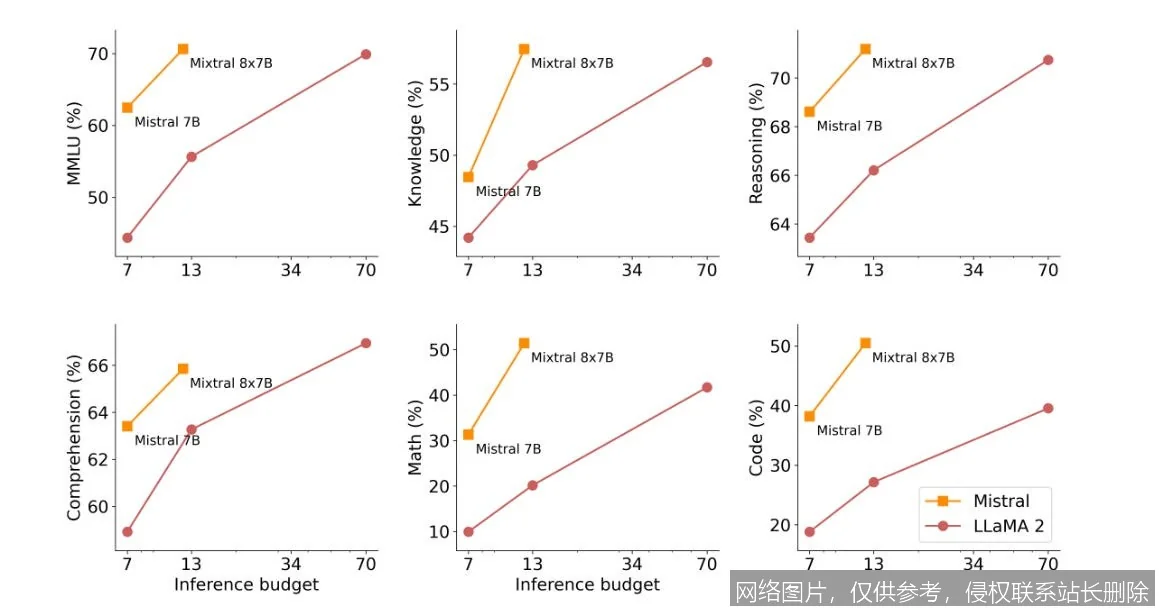

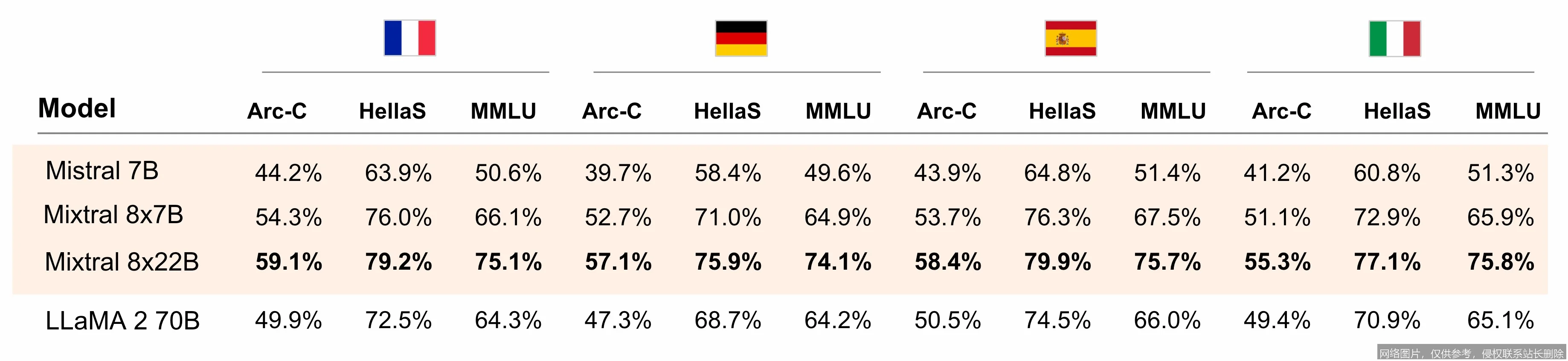

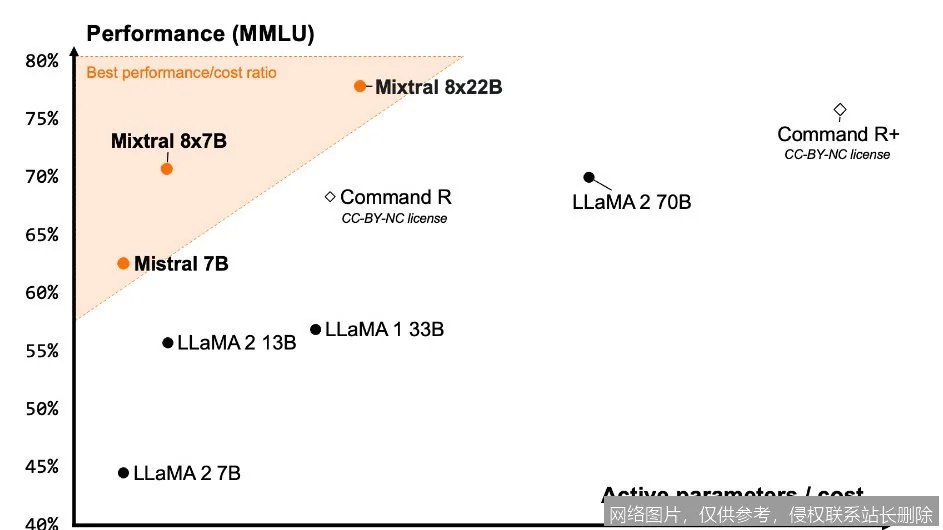

为什么它如此震撼?因为在当时,大多数开源模型还在为追赶 GPT-3.5 而努力,而 Mixtral 8x7B 一经发布,便在多项基准测试中直接超越或比肩 Llama 2 70B 甚至 GPT-3.5。更令人惊叹的是,它是在一个相对“轻量”的激活参数量下实现的。

随着时间推移到 2024 年和 2025 年,Mistral AI 继续迭代,推出了指令微调版(Instruct)、长上下文版,以及在 2024 年初发布的更大规模版本 Mixtral 8x22B。到了 2026 年的今天,当我们回望这段历程,会发现 Mixtral 不仅仅是一个模型,它代表了一种技术路线的胜利:稀疏混合专家(Sparse Mixture of Experts, MoE)架构 的成熟与普及。

二、核心原理解密:什么是稀疏混合专家(MoE)?

很多新手听到"MoE"、“稀疏”、“专家网络”这些术语时容易头大。其实,我们可以用一个非常通俗的比喻来理解 Mixtral 的工作原理。

1. 传统模型 vs. Mixtral:全科医生 vs. 专家会诊

想象一下传统的稠密模型(如早期的 Llama 2 70B),它就像一位全能的全科医生。无论你问他是关于代码、历史还是医学的问题,他都需要调动大脑中所有的神经元(参数)来思考。虽然他很博学,但每次回答问题都很“累”,计算量巨大,推理速度慢。

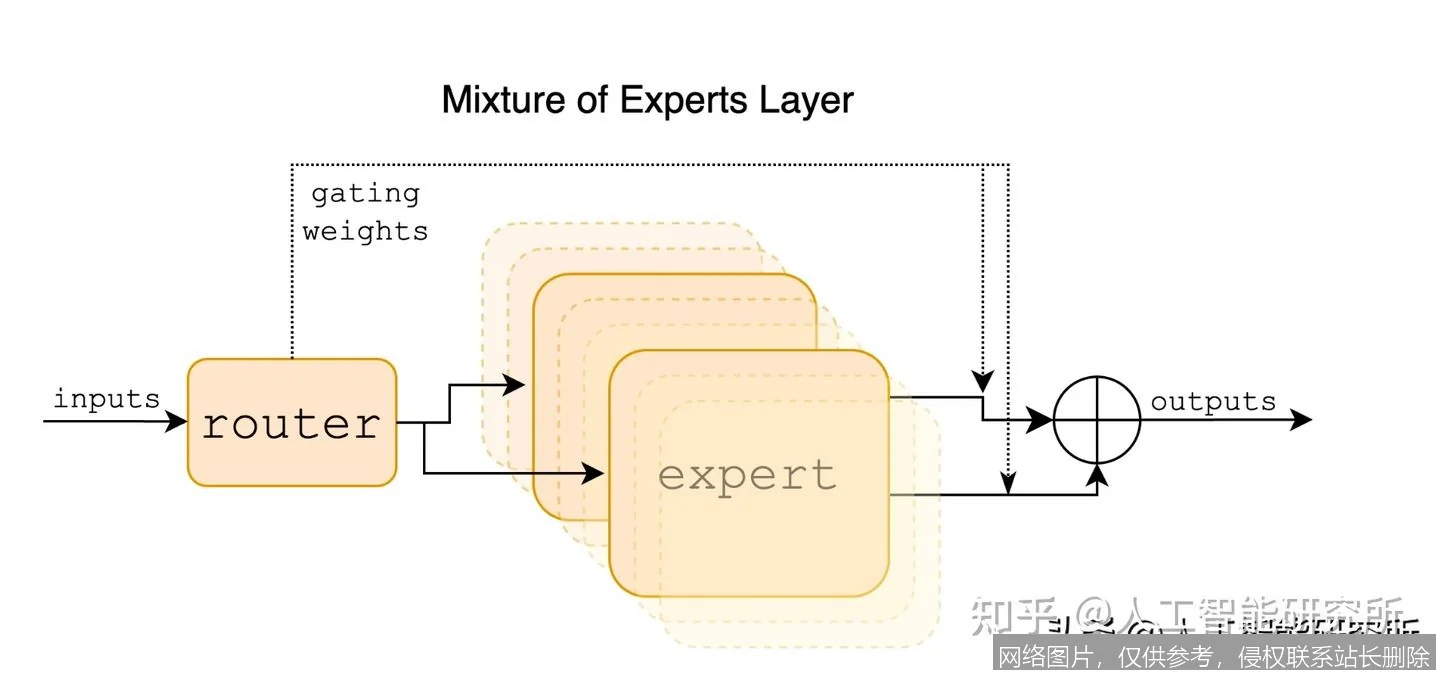

而 Mixtral 则像是一个顶级专家会诊团队。这个团队由 8 位不同领域的专家组成(对应模型中的 8 个专家前馈网络)。当你提出一个问题时,不需要所有 8 位专家都开口,而是有一位聪明的“分诊护士”(路由网络,Router)迅速判断这个问题属于哪个领域,然后只叫来最相关的 2 位专家(Top-2 gating)来回答。

- 总参数量(Total Parameters): 相当于整个专家团队的知识总和。对于 Mixtral 8x7B,这个数字约为 470 亿(47B)。

- 激活参数量(Active Parameters): 每次回答问题时实际动用的人数。对于 Mixtral 8x7B,每次仅激活约 130 亿(13B)参数。

这就是 Mixtral 的魔法所在:用 47B 的知识储备,实现了 13B 的推理速度。 这使得它在保持极高智能水平的同时,推理成本大幅降低,速度显著提升(据官方数据,推理速度可达同级别稠密模型的 6 倍)。

2. 架构细节:不仅仅是替换

从技术层面看,Mixtral 基于标准的 Transformer Decoder-only 架构。其核心创新在于将每一层中的单个前馈神经网络(FFN)替换为了 8 个独立的专家 FFN。

具体流程如下:

- 输入 Token: 每一个输入的文本片段(Token)进入模型层。

- 路由决策: 门控网络(Gating Network)计算该 Token 与 8 个专家的匹配度得分。

- Top-2 选择: 系统选取得分最高的 2 个专家。

- 加权汇总: 这两个专家分别处理该 Token,输出结果根据得分进行加权求和,作为该层的最终输出。

这种机制确保了模型在处理不同任务时具有极高的灵活性。例如,处理代码生成时,可能主要激活擅长逻辑的专家;处理法语翻译时,则激活擅长语言学的专家。这也是为什么 Mixtral 在多语言(英、法、德、意、西等)和代码生成任务上表现尤为出色的原因。

三、版本演进:从 8x7B 到 8x22B 的跨越

截至 2026 年 3 月,Mixtral 家族已经形成了清晰的产品矩阵。了解这些版本的区别,对于选择合适的模型至关重要。

1. Mixtral 8x7B:经典的奠基者

这是系列的开山之作。拥有 32k 的上下文窗口,支持多语言,采用 Apache 2.0 许可证。即使在 2026 年,它依然是许多中小型项目的首选,因为它可以在单张或多张消费级显卡(如 RTX 3090/4090)组成的集群上流畅运行。其指令微调版 Mixtral-8x7B-Instruct 在 MT-Bench 上曾达到 8.3 分,展现了极强的指令遵循能力。

2. Mixtral 8x22B:性能的怪兽

2024 年,Mistral AI 推出了 Mixtral 8x22B,将专家的数量保持为 8 个,但每个专家的规模大幅提升至 22B 级别。

- 总参数量: 约 1410 亿(141B)。

- 激活参数量: 约 390 亿(39B)。

- 上下文窗口: 原生支持 64k 甚至更长(取决于具体微调版本)。

8x22B 的出现,直接对标了当时的 Llama 3 70B 甚至部分闭源模型。它在复杂推理、长文档理解和高质量内容创作上表现出了质的飞跃。对于需要处理海量数据的企业用户,8x22B 提供了比 70B 稠密模型更高的吞吐量和更低的延迟。

3. 2026 年的现状与竞争格局

进入 2026 年,开源模型领域可谓百花齐放。阿里巴巴的 Qwen 系列、Meta 的 Llama 3 后续版本都在不断刷新榜单。根据 2026 年初的多项公开评测(如 Hugging Face Open LLM Leaderboard 更新数据),虽然部分新模型在特定数学或代码基准上超越了早期的 Mixtral 8x7B,但 Mixtral 8x22B 依然在综合能力和多语言支持上保持着第一梯队的竞争力。

值得注意的是,2026 年 3 月的行业动态显示,Mistral AI 的核心团队成员变动引起了社区关注,但这并未影响 Mixtral 系列模型的广泛部署。相反,由于其开源协议的限制极少(Apache 2.0),全球开发者基于 Mixtral 进行的二次开发和垂直领域微调层出不穷,进一步延长了其生命周期。

四、实战应用:如何部署与使用 Mixtral?

理论再完美,落地才是关键。对于开发者和企业来说,如何将 Mixtral 集成到自己的业务流中?以下是几种主流的实践方案。

1. 本地部署:隐私与可控性的首选

由于 Mixtral 是开放权重模型,你可以完全在本地服务器上运行它,无需担心数据泄露给第三方云厂商。这对于金融、医疗等敏感行业尤为重要。

推荐工具链:

- vLLM: 目前最高效的推理引擎之一,专门针对 Transformer 架构优化,完美支持 MoE 结构的并行计算,能最大化挖掘 GPU 性能。

- Ollama: 适合个人开发者和快速原型验证。只需一行命令

ollama run mixtral即可在本地启动服务,支持 macOS、Linux 和 Windows。 - Text Generation Inference (TGI): Hugging Face 推出的生产级推理容器,支持动态批处理和连续批处理,适合高并发场景。

硬件需求参考:

| 模型版本 | 量化精度 | 显存需求 (估算) | 推荐配置 |

|---|---|---|---|

| Mixtral 8x7B | FP16/BF16 | ~90 GB | 2x A100 40G 或 4x RTX 3090/4090 |

| Mixtral 8x7B | INT4 (AWQ/GGUF) | ~24-30 GB | 1x RTX 3090/4090 或 Mac Studio |

| Mixtral 8x22B | FP16/BF16 | ~280 GB | 4x A100 80G 或 8x H100 |

| Mixtral 8x22B | INT4 | ~70-80 GB | 2x A100 40G 或 4x RTX 4090 |

注:显存需求随上下文长度增加而增加,上述数据基于 32k 上下文估算。

2. 云端 API 调用:快速集成的捷径

如果你不想管理基础设施,Mistral AI 官方提供了托管 API,同时各大云厂商(如 AWS Bedrock, Azure AI, Google Vertex AI)也已陆续接入 Mixtral 模型。这种方式按 Token 计费,适合流量波动大的应用场景。

3. 微调(Fine-tuning):打造专属专家

虽然基础模型很强,但在特定领域(如法律合同审查、医疗诊断辅助)往往需要微调。由于 MoE 架构的特性,全量微调成本极高。目前主流的做法是采用 LoRA (Low-Rank Adaptation) 或 QoRA 等技术。

通过冻结大部分参数,仅训练少量的适配器层,你可以在消费级显卡上完成对 Mixtral 的微调。社区中已有大量基于 Mixtral 8x7B-Instruct 微调出的垂直模型,覆盖了从角色扮演到代码补全的各种场景。

五、Mixtral 的优缺点深度分析

没有完美的模型,只有最适合的模型。在决定采用 Mixtral 之前,你需要清楚它的优势与局限。

核心优势

- 极致的性价比: 在同等性能下,推理成本远低于稠密大模型。对于需要高并发响应的 C 端应用,这是巨大的成本节省。

- 宽松的许可证: Apache 2.0 协议意味着你可以免费商用、修改、分发,甚至将其作为闭源产品的一部分,几乎没有法律风险。

- 多语言与代码能力: 原生支持多种欧洲语言,且在代码生成(Python, Java, C++ 等)方面表现优异,是全栈开发者的得力助手。

- 长上下文支持: 32k 乃至 64k+ 的上下文窗口,使其能够轻松处理整本小说、长篇技术文档或复杂的法律条文。

潜在挑战

- 显存带宽压力: 虽然激活参数少,但加载整个模型(47B 或 141B)仍需大量显存。如果显存不足导致频繁交换(Swapping),推理速度会急剧下降。

- 路由负载均衡: 在极端情况下,如果路由网络总是倾向于选择某几个专家,会导致“专家过载”,影响模型效果。虽然在训练阶段已做优化,但在某些罕见分布的输入下仍可能出现。

- 安全性未对齐: 基础模型(Base Model)未经过严格的安全对齐,可能会输出有害内容。生产环境务必使用 Instruct 版本,并配合外部的内容过滤系统(Moderation Layer)。

六、未来展望:Mixtral 在 2026 年及以后的角色

站在 2026 年的时间节点展望未来,Mixtral 所代表的 MoE 架构已经成为大模型设计的标配。无论是闭源巨头还是开源社区,都在向“更大规模、更稀疏激活”的方向演进。

对于开发者而言,Mixtral 的意义在于它打破了“大模型=高门槛”的刻板印象。它证明了通过巧妙的架构设计,我们可以在有限的资源下释放出惊人的智能。随着量化技术的进步(如 INT2、INT1 的探索)和推理引擎的优化,未来我们或许能在单张移动端芯片上流畅运行混血版的 Mixtral 模型。

此外,随着多模态能力的融合,未来的 Mixtral 迭代版本极有可能加入视觉、音频处理能力,成为真正的通用人工智能(AGI)基石之一。对于正在寻找高性价比 AI 解决方案的企业来说,现在正是深入研究和部署 Mixtral 的最佳时机。

结语

Mixtral 不仅仅是一个模型名字,它是开源精神与技术智慧的结晶。从 8x7B 的惊艳亮相到 8x22B 的稳健扩张,它始终站在效率与性能平衡的最前沿。无论你是想在自己的笔记本电脑上跑一个大模型,还是构建服务于百万用户的智能客服系统,Mixtral 都值得你放入技术栈的核心位置。

在这个 AI 技术日新月异的时代,掌握核心原理,善用开源利器,你将不再是被动的技术接受者,而是创新的驱动者。希望这篇指南能成为你探索 Mixtral 世界的坚实起点。

参考资料与信息源

- Mistral AI Official News - Mixtral 8x22B Release: https://mistral.ai/news/mixtral-8x22b

- Hugging Face Model Card - Mixtral-8x7B-Instruct-v0.1: https://huggingface.co/mistralai/Mixtral-8x7B-Instruct-v0.1

- Paper: "Mixtral of Experts" (arXiv): https://arxiv.org/abs/2401.04088

- LMSYS Org - Chatbot Arena Leaderboard (2026 Archive Data): https://chat.lmsys.org

- vLLM Documentation - Supported Models: https://docs.vllm.ai/en/latest/models/supported_models.html

- Ollama Library - Mixtral: https://ollama.com/library/mixtral

- GitHub - huggingface/transformers (Mixtral Implementation): https://github.com/huggingface/transformers/tree/main/src/transformers/models/mixtral

相关推荐

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析

- 神经网络是什么:2026 原理、演进与前沿应用全面解析