词向量是什么:从原理到 2026 实战应用全面解析

一句话定义

词向量(Word Embedding)是将自然语言中的词汇映射为低维稠密实数向量的技术,使计算机能像理解数值一样捕捉词语的语义与语法关系。

技术原理:从离散符号到连续空间的飞跃

要真正理解“词向量是什么”,我们必须先回到计算机处理语言的起点。在深度学习爆发之前,计算机看待单词的方式就像图书馆管理员看待书籍编号:每个词只是一个孤立的 ID,彼此之间没有任何内在联系。这种传统方法被称为独热编码(One-Hot Encoding)。假设有 10,000 个词的词汇表,单词“猫”可能表示为第 58 号位置是 1,其余全为 0 的向量;而“狗”则是第 92 号位置是 1。在这种表示下,“猫”和“狗”的距离,与“猫”和“冰箱”的距离在数学上是完全相等的。计算机无法感知它们都是“动物”,也无法理解“国王 - 男人 + 女人=女王”这种微妙的逻辑关系。

词向量技术的诞生,本质上是一场从“离散符号空间”到“连续几何空间”的范式转移。其核心工作机制在于:将高维稀疏的独热向量,通过一个可学习的投影矩阵,压缩映射到低维稠密的实数向量空间中。在这个新的空间里,每一个维度不再代表某个具体的词,而是代表了某种潜在的语义特征(Latent Semantic Feature),比如“性别”、“皇家程度”、“液态/固态”或“情感极性”。

核心工作机制:分布假说与上下文预测

词向量生成的理论基石是语言学中的分布假说(Distributional Hypothesis),即“一个词的语义由其上下文决定”(You shall know a word by the company it keeps)。基于这一假设,主流的词向量算法(如 Word2Vec、GloVe、FastText)通过构建神经网络模型,让机器在海量文本中“猜词”来学习向量。

以经典的 Word2Vec 为例,它包含两种训练架构:

- CBOW (Continuous Bag-of-Words):根据上下文周围的词来预测中心词。例如,看到“今天天气很___",模型需要预测出“好”。在这个过程中,模型不断调整上下文词和中心词的向量表示,使得语义相近的词在向量空间中距离更近。

- Skip-gram:与 CBOW 相反,根据中心词来预测周围的上下文词。如果输入是“苹果”,模型需要预测出“吃”、“红”、“水果”等周边词。这种方法在捕捉稀有词语义方面表现更佳。

在训练过程中,神经网络中间的隐藏层权重矩阵,实际上就是我们最终需要的“词向量表”。随着训练迭代次数的增加,向量空间中的几何结构逐渐成型:语义相似的词会聚集在一起,形成簇(Cluster);具有相同语法功能的词会分布在相似的子空间中;甚至词语之间的线性关系也会被编码进去。

关键技术组件解析

构建高质量的词向量系统,离不开以下几个关键组件的协同工作:

- 输入层与投影层(Input & Projection Layer):负责将离散的词索引转化为初始向量。在 Word2Vec 中,这一层通常没有激活函数,直接进行线性变换,目的是保留信息的纯粹性以便后续计算。

- 负采样(Negative Sampling):这是提升训练效率的神器。在全词汇表上计算 Softmax 概率分布计算量极大(分母是所有词的概率和)。负采样技巧性地只更新当前正样本和随机抽取的几个负样本(噪声词)的权重,将复杂度从 O(V) 降低到 O(k),其中 k 通常仅为 5-20。

- 层次化 Softmax(Hierarchical Softmax):另一种加速策略,利用霍夫曼树(Huffman Tree)结构将多分类问题转化为一系列二分类问题,进一步缩短路径长度,适合超大词汇表场景。

- 子词信息(Subword Information):由 Facebook 提出的 FastText 引入。它将词看作字符 n-gram 的集合。例如"eating"由"eat"、"ati"、"tin"等组成。这使得模型即使遇到未登录词(OOV, Out-of-Vocabulary),也能通过其组成部分推断出大致语义,极大地增强了泛化能力。

与传统方法的深度对比

为了更直观地理解词向量的优势,我们可以将其与传统方法进行对比:

| 特性维度 | 独热编码 (One-Hot) | TF-IDF / 词袋模型 | 词向量 (Word Embedding) |

|---|---|---|---|

| 向量维度 | 极高(等于词汇表大小,常达数万) | 高(等于词汇表大小) | 低维稠密(通常为 50-300 维) |

| 稀疏性 | 极度稀疏(绝大多数为 0) | 稀疏 | 稠密(几乎所有元素都有非零值) |

| 语义捕捉 | 无(无法衡量词与词的关系) | 弱(仅基于共现频率,忽略顺序和深层语义) | 强(能捕捉同义、类比、上下位关系) |

| 数据效率 | 低(需要极多数据才能统计出规律) | 中 | 高(迁移学习能力强,预训练向量可直接使用) |

用一个生动的类比来说:独热编码就像是给每个人发一个唯一的编号,你知道编号 1001 和 1002 是两个人,但不知道他们是否有血缘关系;而词向量则像是给每个人绘制了一幅详细的“基因图谱”,通过对比图谱,你不仅能发现他们是父子,还能推算出他们家族的特征。这种从“身份标识”到“特征描述”的转变,正是现代自然语言处理(NLP)智能化的基石。

核心概念:构建语义宇宙的坐标系

在深入探讨词向量的应用之前,我们需要厘清一系列紧密相关的关键术语。这些概念共同构成了理解“词向量是什么”的知识图谱。

关键术语解释

1. 嵌入空间(Embedding Space)

这是一个多维的几何空间,所有的词向量都分布其中。在这个空间里,距离(通常是余弦相似度 Cosine Similarity 或欧几里得距离)代表了语义的相似性。两个词靠得越近,意味着它们在语境中越可以互换,或者概念上越接近。

2. 语义类比(Semantic Analogy)

这是词向量最著名的特性之一,表现为向量间的线性运算关系。经典的例子是 $Vector(\text{King}) - Vector(\text{Man}) + Vector(\text{Woman}) \approx Vector(\text{Queen})$。这说明词向量不仅编码了静态的含义,还编码了词与词之间的转换逻辑。这种性质证明了向量空间具有高度的结构化特征。

3. 预训练向量(Pre-trained Embeddings)

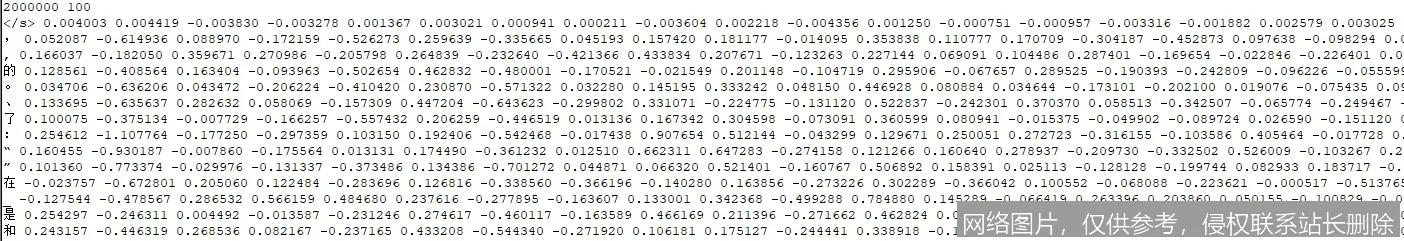

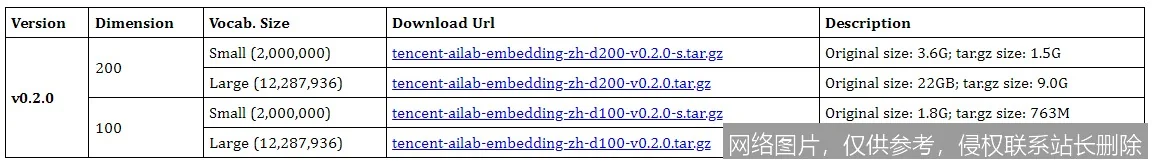

指在大规模通用语料库(如 Wikipedia、Google News)上训练好的词向量文件(如 Word2Vec 的.bin 文件或 GloVe 的.txt 文件)。开发者可以直接下载并使用这些向量,而无需从头训练。这类似于图像处理中的 ImageNet 预训练模型,是迁移学习在 NLP 领域的早期体现。

4. 静态 vs. 动态词向量(Static vs. Contextualized Embeddings)

这是一个至关重要的区分。传统的 Word2Vec 和 GloVe 是静态的,即无论“苹果”出现在“我吃了一个苹果”还是“苹果公司发布了新机”中,它的向量表示是完全一样的。而基于 Transformer 架构的 BERT 等模型生成的是动态(上下文相关)词向量,同一个词在不同句子中会有不同的向量表示。虽然严格意义上 BERT 输出的是“上下文嵌入”,但它们是对传统词向量概念的继承与升华。

概念关系图谱

为了理清这些概念的联系,我们可以构建如下的逻辑链条:

- 基础层:分布假说 $\rightarrow$ 语料库(Corpus) $\rightarrow$ 共现矩阵(Co-occurrence Matrix)。

- 算法层:Word2Vec (CBOW/Skip-gram) / GloVe (矩阵分解) / FastText (子词增强)。

- 产物层:词向量表(Vocabulary Lookup Table) $\rightarrow$ 嵌入空间。

- 演化层:静态词向量 $\rightarrow$ 动态上下文嵌入(ELMo, BERT) $\rightarrow$ 大语言模型(LLM)的内部表示。

可以看出,词向量是连接原始文本数据与高级语义理解的桥梁,是后续所有复杂 NLP 任务(如机器翻译、情感分析)的底层燃料。

常见误解澄清

误解一:“词向量维度越高越好。”

事实并非如此。维度的选择需要在“表达能力”和“过拟合风险”之间寻找平衡。对于小规模数据集,过高的维度(如 1000 维)会导致模型记住噪声而非学习规律,通常 100-300 维是大多数任务的甜蜜点(Sweet Spot)。

误解二:“词向量能解决所有歧义问题。”

正如前文所述,传统静态词向量无法解决一词多义(Polysemy)问题。在处理“银行”(金融机构 vs. 河岸)时,静态向量只能给出一个折中的表示,这在精细任务中往往是瓶颈。这也是为什么业界转向 BERT 等动态模型的原因。

误解三:“词向量就是深度学习的全部。”

词向量只是输入表示层(Input Representation)。真正的智能来自于后续的编码器(Encoder)、注意力机制(Attention)以及解码器(Decoder)。词向量提供了良好的起点,但不是终点。

实际应用:从搜索引擎到 2026 年智能体

理解了原理与概念后,我们来看“词向量是什么”在现实世界中如何转化为生产力。从早期的搜索优化到展望 2026 年的自主智能体,词向量技术的应用边界正在不断拓展。

典型应用场景

1. 语义搜索与推荐系统(Semantic Search & Recommendation)

这是词向量最成熟的应用领域。传统的关键词匹配无法处理“用户搜‘跑车’,系统应推荐‘法拉利’"这样的需求。通过将查询词(Query)和文档/商品标题转化为词向量并计算相似度,系统可以实现“意图匹配”而非“字面匹配”。在电商平台上,即使用户输入“夏天穿的凉快上衣”,系统也能通过向量空间中找到"T 恤”、“衬衫”等语义相近的商品。

2. 情感分析与舆情监控(Sentiment Analysis)

在金融风控和品牌管理中,企业需要判断新闻或评论的情感倾向。词向量能够捕捉“好”、“棒”、“优秀”在向量空间中的聚类特性,使得分类器能够轻易识别正面评价;同时,它也能识别反讽或特定语境下的负面含义(配合上下文模型),大大提高了监测的准确率。

3. 机器翻译(Machine Translation)

在现代神经机器翻译(NMT)系统中,源语言和目标语言的词向量往往被映射到同一个共享的语义空间中。这使得模型能够发现不同语言间词汇的对应关系(例如英语的"Cat"和法语的"Chat"在空间中位置接近),从而实现跨语言的语义迁移,显著提升了翻译的流畅度和准确性。

4. 命名实体识别(NER)与信息抽取

在医疗、法律等专业领域,从非结构化文本中提取关键实体(如药品名、公司名、法条)至关重要。词向量作为特征输入,能帮助模型快速识别出哪些词组合起来代表一个特定的实体,大幅减少了人工规则编写的成本。

代表性产品与项目案例

- Google Search (RankBrain):谷歌早在 2015 年就引入了基于词向量思想的 RankBrain 算法,用于处理从未见过的搜索查询,理解用户搜索背后的真实意图,而非仅仅匹配关键词。

- Facebook (FastText):Facebook AI Research 开源的 FastText 库,因其支持多语言、处理未登录词能力强,被广泛应用于全球各地的垃圾短信过滤、语言识别等基础设施中。

- 阿里巴巴·拍立淘:结合图像向量与文本词向量,实现“以图搜图”和“以文搜图”的混合检索。用户输入描述性文字,系统通过向量匹配找到视觉特征相符的商品。

- 2024-2026 趋势:RAG(检索增强生成)系统中的向量数据库:在大模型时代,词向量的概念演化为“块向量(Chunk Embedding)”。企业构建私有知识库时,将文档切片并向量化存入向量数据库(如 Milvus, Pinecone)。当用户提问时,系统检索语义最相关的片段喂给大模型。这是目前企业级 AI 落地的核心架构。

使用门槛与条件

尽管词向量技术强大,但在实际落地中仍需满足一定条件:

- 数据质量与规模:虽然可以使用预训练向量,但如果应用于垂直领域(如生物医学、法律文书),通用的预训练向量效果往往不佳。此时需要收集至少百万级的高质量领域语料进行微调(Fine-tuning)或重新训练。

- 算力资源:训练大规模词向量(尤其是结合深度学习的动态嵌入)需要 GPU 支持。对于中小企业,直接调用云厂商的 API 或使用开源的预训练模型是更具性价比的选择。

- 领域适配性:词向量对俚语、新造词的反应存在滞后性。在社交媒体监控等场景中,需要建立定期的向量更新机制,以捕捉语言的最新变化。

- 伦理与偏见:词向量是从人类产生的文本中学习来的,因此不可避免地继承了数据中的社会偏见(如性别歧视、种族刻板印象)。在招聘、信贷等敏感场景使用时,必须进行去偏见处理(De-biasing)。

延伸阅读:通往未来 NLP 的进阶之路

“词向量是什么”只是进入自然语言处理宏大殿堂的第一把钥匙。随着技术的发展,这一概念正在不断进化。以下是为希望深入探索的学习者准备的进阶指南。

相关概念推荐

在掌握基础词向量后,建议进一步研究以下概念,它们代表了技术的演进方向:

- Transformer 架构:理解 Self-Attention 机制是如何彻底改变序列建模的,它是当前所有主流大模型的基石。

- 上下文嵌入(Contextualized Embeddings):深入研究 ELMo、BERT、RoBERTa 等模型,理解它们如何生成“动态”的词表示。

- 向量数据库(Vector Database):了解 FAISS、Milvus 等工具,学习如何在亿级规模下高效存储和检索向量,这是构建 AI 应用的基础设施。

- 提示工程(Prompt Engineering)与大模型对齐:在 LLM 时代,如何通过提示词激发模型内部蕴含的庞大向量知识,是新的应用热点。

进阶学习路径

- 阶段一:数学与编程基础。复习线性代数(矩阵运算、特征值分解)、概率论,并熟练掌握 Python 及 PyTorch/TensorFlow 框架。

- 阶段二:经典复现。尝试从零编写代码复现 Word2Vec 的 Skip-gram 模型,并在小型数据集(如《红楼梦》文本)上训练,观察向量空间的变化。

- 阶段三:预训练模型应用。学习使用 Hugging Face Transformers 库,加载 BERT 等预训练模型,完成下游任务(如文本分类、问答)的微调。

- 阶段四:系统架构设计。结合向量数据库和大模型,设计并实现一个完整的 RAG(检索增强生成)系统,解决具体业务问题。

推荐资源与文献

经典论文:

- Efficient Estimation of Word Representations in Vector Space (Mikolov et al., 2013) - Word2Vec 的开山之作。

- GloVe: Global Vectors for Word Representation (Pennington et al., 2014) - 结合了全局矩阵分解与局部上下文窗口的方法。

- Attention Is All You Need (Vaswani et al., 2017) - Transformer 架构的提出,标志着静态词向量时代的转折。

在线课程与工具:

- Coursera - Natural Language Processing Specialization (by Deeplearning.ai):系统化的 NLP 学习路径。

- Hugging Face Course:提供免费的、实战导向的 Transformer 与自然语言处理教程。

- TensorFlow Projector:一个可视化工具,可以将高维词向量降维展示在浏览器中,直观地观察词与词之间的聚类关系,非常适合教学与调试。

从 2013 年 Word2Vec 的横空出世,到 2026 年大模型驱动的智能体生态,词向量技术始终是人工智能理解人类语言的灵魂所在。它不仅是一串数字,更是机器通向人类思维世界的桥梁。希望本文能帮助你建立起对“词向量是什么”的立体认知,并在未来的技术实践中灵活运用这一强大的工具。

已是最新文章

相关推荐

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析

- 神经网络是什么:2026 原理、演进与前沿应用全面解析

- 什么是推理?2026 年原生智能原理、技术演进与应用全景解析

- 【AI词典】思维链 - 分步推理的思维拓展方法

- 【AI词典】指令微调 - 基于指令优化大语言模型的方法

- 什么是 Artificial Analysis?2026 原理、应用与实战全面解析

- 【AI词典】上下文学习 - 通过提示示例引导模型输出的学习方法

- 【AI词典】提示注入 - 恶意指令操控AI输出的攻击手段