过拟合:当模型“学得太好”反而成了问题

AI词典2026-04-01 08:51:13

过拟合:当模型“学得太好”反而成了问题

在人工智能和机器学习的奇妙世界里,我们常常教导模型从数据中学习规律,以期它能对未知情况做出精准预测。然而,一个有趣且常见的现象是:有时模型在训练数据上表现近乎完美,但在面对新数据时却一败涂地。这种现象,就是我们今天要探讨的过拟合。

什么是过拟合?

想象一下,一个学生为了通过考试,不是去理解知识原理,而是死记硬背了所有习题的答案。在模拟考中,他可能取得满分,但一旦考试题目稍有变化,他就束手无策。这就是过拟合的生动比喻。

在技术层面,过拟合指的是机器学习模型在训练数据上学习得“过于精细”,不仅学到了数据中普遍的、可泛化的规律,更将训练数据中的随机噪声、异常值或特定细节也当作了规律来学习。这导致模型对训练集的拟合度过高,却牺牲了在新数据上的泛化能力。

为什么会发生过拟合?

过拟合的产生通常不是单一原因造成的,而是多种因素共同作用的结果:

- 模型过于复杂:相对于数据量和数据噪声,模型的参数过多、表达能力过强(如深度过深的神经网络)。

- 训练数据不足或质量差:数据量太少,不足以代表真实的数据分布,或者数据中包含大量噪声和无关特征。

- 训练时间过长:在迭代训练中,模型可能会从学习通用模式逐渐转向“记住”训练数据。

如何识别与应对过拟合?

识别过拟合的一个典型方法是观察模型在训练集和验证集上的表现差异。如果训练集准确率极高,而验证集准确率显著偏低,且差距很大,那么过拟合很可能已经发生。

幸运的是,机器学习领域已经发展出多种有效的策略来缓解过拟合:

- 获取更多、更高质量的数据:这是最根本的方法,更多的数据能让模型看到更全面的模式。

- 简化模型:选择参数更少的模型,或通过“剪枝”等方式降低复杂模型的复杂度。

- 正则化:在损失函数中增加对模型复杂度的惩罚项(如L1、L2正则化),迫使模型学习更简洁、更通用的规律。

- 早停法:在训练过程中,持续监控验证集性能,当性能不再提升时便停止训练,防止模型过度学习噪声。

- 丢弃法:在神经网络训练中随机“关闭”一部分神经元,防止神经元之间形成过于复杂的共适应关系,增强模型的鲁棒性。

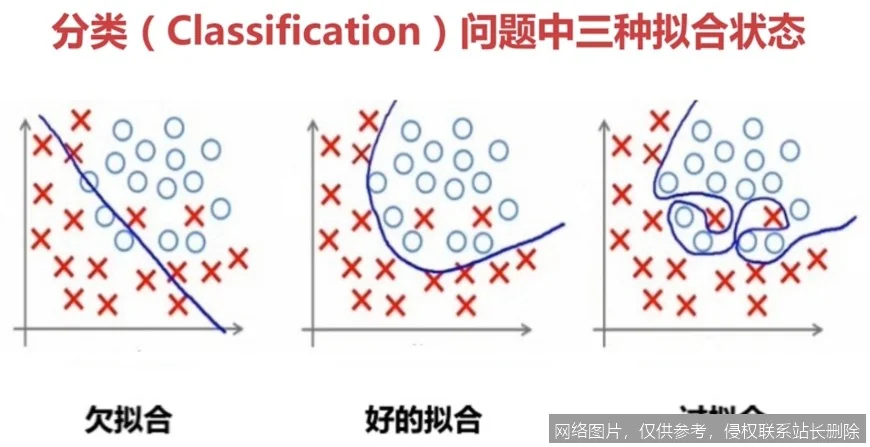

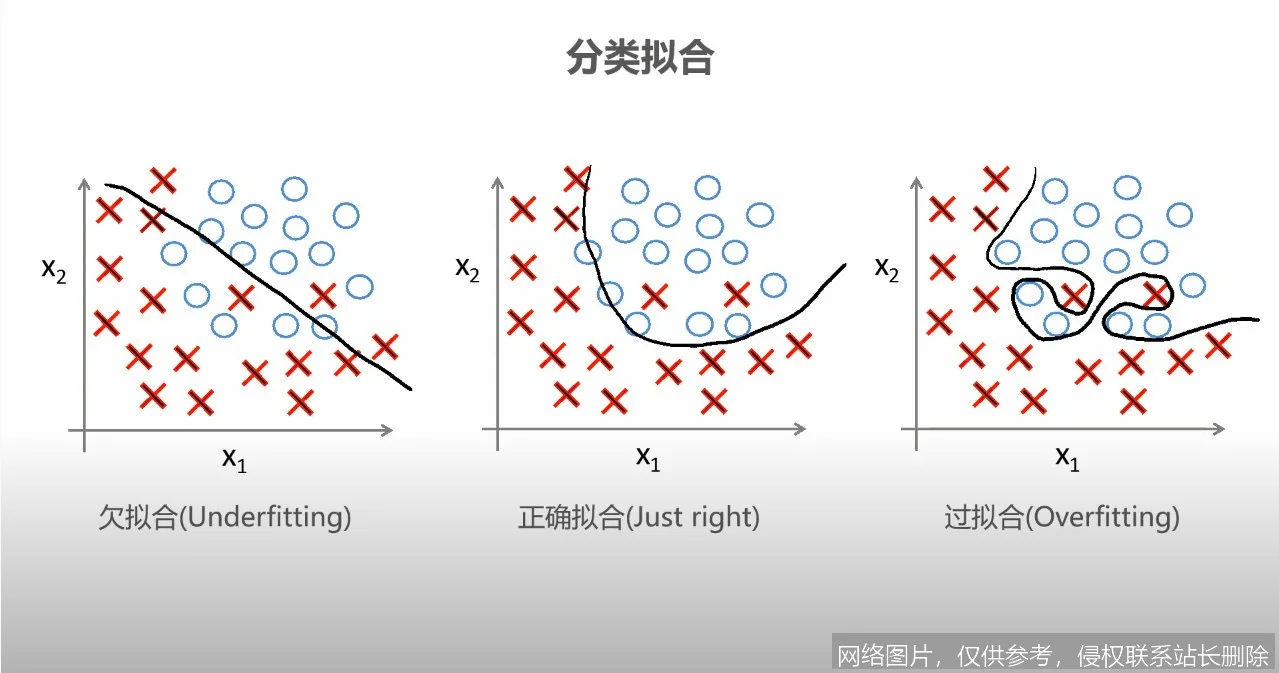

平衡的艺术:在欠拟合与过拟合之间

值得注意的是,过拟合的反面是“欠拟合”,即模型过于简单,连训练数据中的基本规律都没学好。机器学习的核心挑战之一,正是在这二者之间找到最佳平衡点,构建一个既不过于简单也不过于复杂的“恰到好处”的模型。

这就像教育孩子:既不能放任自流(欠拟合),也不能填鸭式教育、要求他死记硬背每一个细节(过拟合),而是应该引导他掌握核心原理和思维方式,从而能够举一反三,应对未来各种未知的挑战。

总之,过拟合是机器学习模型开发中一个关键而普遍的挑战。理解它的本质、成因与应对策略,不仅有助于我们构建更强大、更可靠的AI系统,也启发我们在更广阔的领域思考如何平衡“记忆”与“理解”、“细节”与“规律”的智慧。

相关推荐

- 预训练是什么:2026 大模型基石原理、技术演进与实战应用全面解析

- 什么是知识库?2026 年最新定义、技术原理与实战应用全面解析

- 语义搜索是什么:2026 年原理、技术演进与全场景应用详解

- 什么是自监督学习?2026 原理、应用与实战全面解析

- ONNX 是什么:2026 跨框架模型标准详解,从原理到实战应用

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用