梯度消失:深度学习模型训练中的“隐形杀手”与破解之道

梯度消失:深度学习模型训练中的“隐形杀手”

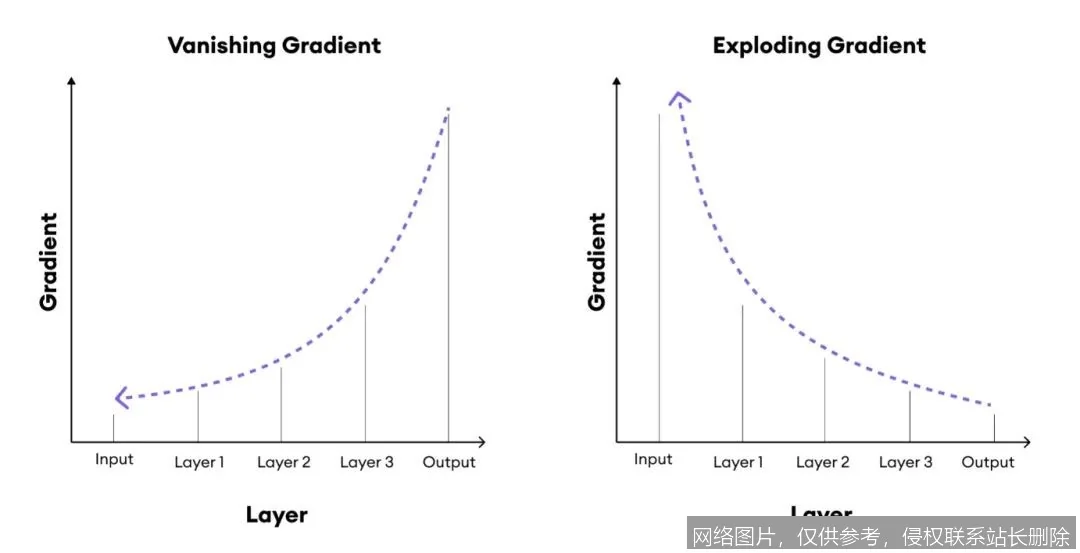

在深度学习模型,尤其是循环神经网络(RNN)和早期深度前馈网络的训练过程中,梯度消失是一个普遍且棘手的问题。它并非直接导致程序报错,而是像一个“隐形杀手”,悄无声息地让模型的学习能力瘫痪。具体而言,它指的是在通过反向传播算法计算梯度时,从输出层向输入层逐层传递的梯度值会随着层数的增加而呈指数级衰减,直至趋近于零。这导致网络浅层的权重参数几乎得不到有效的更新,模型无法从数据中学习到有意义的特征,训练过程因此停滞不前。

为何“梯度”会“消失”?

梯度消失的根源在于反向传播的链式法则与激活函数的特性。在反向传播过程中,梯度是各层偏导数的连续乘积。当神经网络使用如Sigmoid、Tanh等饱和激活函数时,其导数值域被压缩在(0, 1]或(0, 0.25]的较小范围内。多层连乘后,梯度值会迅速衰减到近乎为零。

我们可以通过一个简单的比喻来理解:想象一个非常深的管道,水(梯度)从一端流入。如果每经过一节管道,水流就被削弱一半,那么经过数十节管道后,另一端几乎不会有水流出来。同样,深层网络浅层的参数因为得不到足够的“梯度水流”来修正自己,其训练效果便微乎其微。

梯度消失带来的严重后果

梯度消失问题对模型训练的影响是毁灭性的:

- 浅层网络失效:模型无法有效利用靠近输入的层来提取基础特征,使得深度网络退化为浅层网络,丧失了其强大的表示能力。

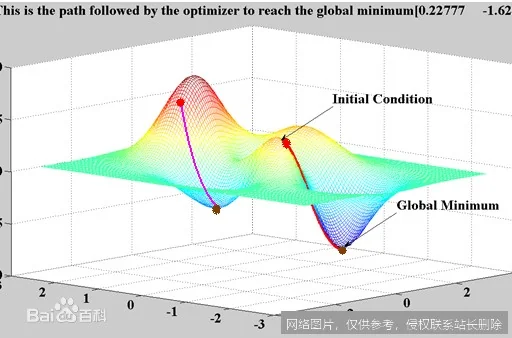

- 训练停滞:模型损失函数在训练早期就陷入平台期,不再下降,无论训练多久,性能都难以提升。

- 长期依赖学习失败:在RNN中处理长序列数据时,模型会“遗忘”很早之前的输入信息,无法捕捉序列中的长期依赖关系。

破解梯度消失的五大策略

尽管梯度消失问题严峻,但研究人员已发展出多种有效的应对策略,推动了深度学习的蓬勃发展。

1. 使用改良的激活函数

用非饱和的线性整流函数(ReLU)及其变体(如Leaky ReLU, PReLU, ELU)替代Sigmoid/Tanh,是解决梯度消失最直接有效的方法之一。ReLU在正区间的导数为常数1,有效避免了连乘导致的指数衰减,使得梯度能够稳定地向更远的层传播。

2. 改进的权重初始化方法

采用如Xavier初始化或He初始化等策略,根据激活函数的特性,有目的地设置网络初始权重。这确保了在前向传播和反向传播过程中,信号的方差能够大致保持稳定,为梯度的有效流动提供了一个良好的起点。

3. 批标准化(Batch Normalization)

BN层通过对每一层的输入进行标准化(均值为0,方差为1),将激活值强制拉回非饱和区。这不仅加速了训练收敛,也使得梯度在反向传播时更稳定,显著缓解了梯度消失(和梯度爆炸)问题。

4. 残差网络结构

何恺明等人提出的残差网络(ResNet)引入了“跳跃连接”(Skip Connection)。该结构允许输入信号直接绕过若干层传到输出,创建了一条梯度传播的“高速公路”。梯度可以通过这条捷径直接、无损地传递到浅层,从根本上保证了深层网络的可训练性。

5. 门控循环单元架构

针对RNN的长期依赖问题,长短期记忆网络(LSTM)和门控循环单元(GRU)通过精巧的门控机制(输入门、遗忘门、输出门)来调节信息的流动和记忆的保留。它们能够有选择地让梯度在时间步长上保持流动,从而有效克服梯度消失,成为处理序列数据的标准架构。

结语

梯度消失曾是阻碍深度学习向更深、更复杂结构发展的主要障碍。然而,正是对这一“隐形杀手”的深入理解和持续攻关,催生了ReLU、ResNet、LSTM等一系列里程碑式的创新。今天,虽然我们拥有了强大的工具来应对它,但理解其原理依然是设计和调试高效、稳定神经网络模型的基石。在通往更智能模型的路上,与梯度问题的斗争仍将继续。

相关推荐

- 预训练是什么:2026 大模型基石原理、技术演进与实战应用全面解析

- 什么是知识库?2026 年最新定义、技术原理与实战应用全面解析

- 语义搜索是什么:2026 年原理、技术演进与全场景应用详解

- 什么是自监督学习?2026 原理、应用与实战全面解析

- ONNX 是什么:2026 跨框架模型标准详解,从原理到实战应用

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用