Together.ai 是什么?从核心原理到实战应用,新手入门必看的一文搞懂指南

Together.ai 是什么?这是当前人工智能领域最热门的问题之一。如果你是一名开发者、数据科学家,或者是对生成式 AI 充满好奇的创业者,那么together.ai这个平台绝对是你无法绕开的核心基础设施。在 2026 年的今天,随着大模型从“玩具”走向“生产力工具”,如何高效、低成本地运行和微调开源模型,成为了行业竞争的焦点。

本文将作为一份深度指南,带你从零开始彻底搞懂together.ai。我们将深入剖析其背后的核心技术原理,解读 2025 年至 2026 年初的最新重大更新(包括估值飙升至 33 亿美元的 B 轮融资细节、革命性的 UPipe 长文本处理技术以及 ATLAS 动态推理优化),并提供手把手的实战代码教程。无论你是想寻找替代闭源模型的开源方案,还是希望构建自己的 AI 应用,这篇文章都将是你入门together.ai的必读宝典。

一、重新定义开源 AI 基础设施:Together.ai 的核心定位

在深入技术细节之前,我们需要先厘清together.ai究竟是谁,以及它在整个 AI 生态系统中扮演什么角色。

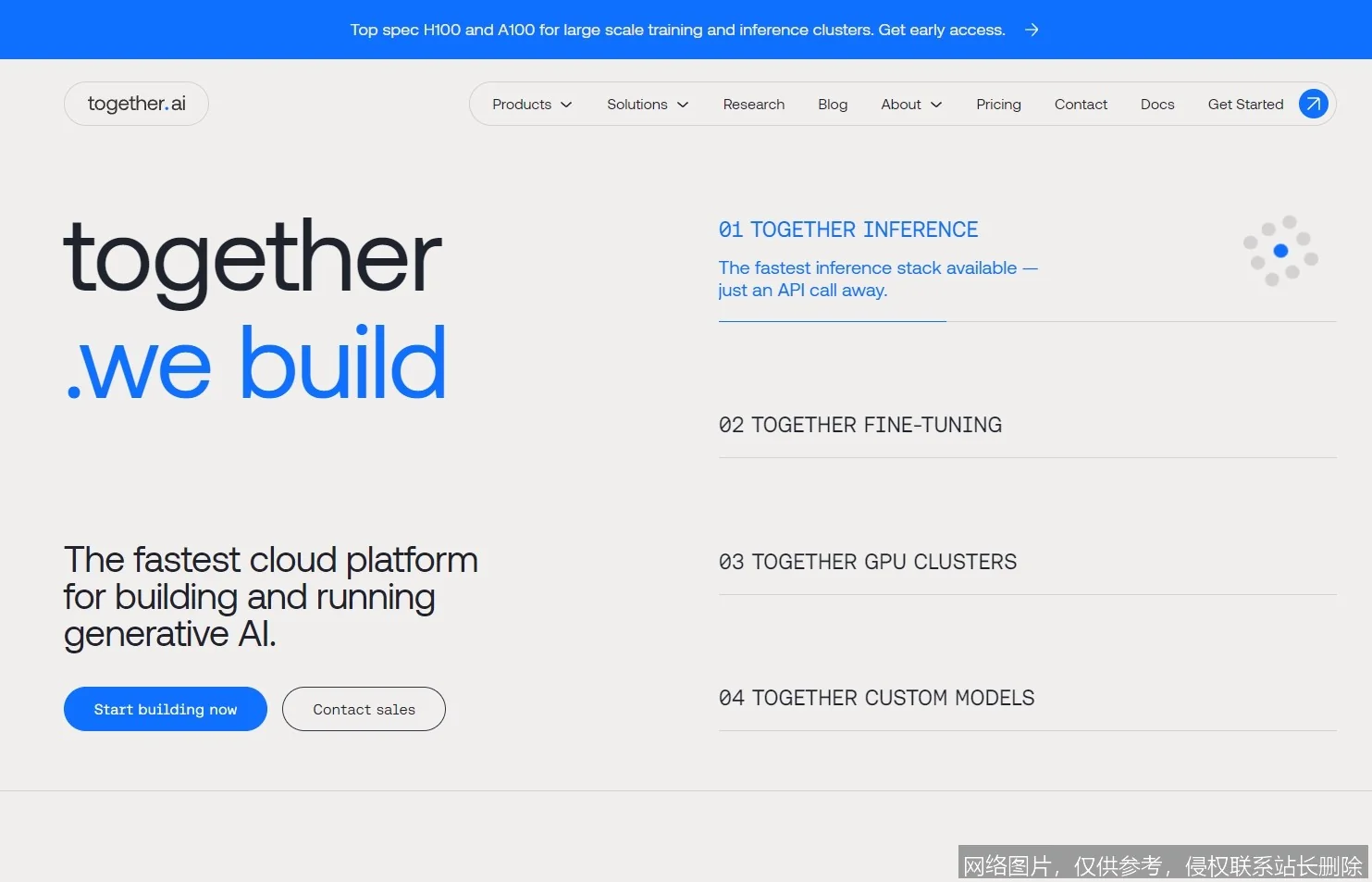

Together AI(有时也被写作 Together Computer Inc.)成立于 2022 年 6 月,总部位于美国旧金山硅谷。由 Vipul Ved Prakash、Ce Zhang、Chris Re 和 Percy Liang 四位顶尖专家联合创立。与 OpenAI 或 Anthropic 不同,Together.ai 并不致力于训练一个单一的、封闭的超级模型来垄断市场。相反,它的使命是构建一个基于云的开放平台,让全球开发者能够轻松访问、运行、微调和部署数以百计的开源大语言模型(LLM)。

简单来说,如果把开源模型(如 Llama 系列、Mixtral、Qwen 等)比作免费的“发动机图纸”,那么together.ai就是那个提供顶级“超级工厂”和“组装流水线”的地方。你不需要自己购买昂贵的 NVIDIA GPU 集群,不需要配置复杂的分布式训练环境,只需通过 API 调用,就能在几秒钟内启动这些强大的模型。

1.1 为什么选择 Together.ai?三大核心价值

在 2025 年到 2026 年的激烈竞争中,together.ai之所以能脱颖而出,获得包括 General Catalyst、Prosperity7 Ventures 以及早期 Salesforce Ventures 等顶级机构的青睐(累计融资超 5.33 亿美元,估值达 33 亿美元),主要归功于以下三点:

- 极致的推理速度:通过自研的推理优化技术,Together.ai 能将开源模型的延迟降低到 100 毫秒以内,甚至在某些场景下比原生部署快 9 倍以上。

- 真正的开源生态:支持超过 200 个开源模型,涵盖从轻量级的 8B 参数模型到超大规模的 405B+ 参数模型。它不锁定用户,而是让用户自由选择最适合业务的模型。

- 企业级的基础设施:提供自动化的负载均衡、令牌缓存、模型量化以及安全合规的企业级功能,让初创公司也能拥有媲美科技巨头的 AI 算力底座。

根据 2025 年底的数据,Together.ai 已拥有超过 45 万名开发者客户,年度经常性收入(ARR)突破 1 亿美元,成为开源 AI 基础设施领域的独角兽。

二、硬核揭秘:Together.ai 如何让模型运行快 100 倍?

很多新手会问:“我自己买张显卡跑开源模型不行吗?为什么要用云平台?”答案在于规模效应和底层优化。Together.ai 的核心竞争力不仅仅在于它有很多模型,更在于它通过一系列独创技术,解决了开源模型在大规模部署时的性能瓶颈。

2.1 FlashAttention 与底层架构革新

Together.ai 的技术基因非常强大,其首席科学家 Tri Dao 是著名的FlashAttention v1 和 v2 的主要作者。这项技术彻底改变了 Transformer 模型中注意力机制的计算方式,大幅减少了显存占用并提升了计算速度。

在传统的注意力机制中,随着文本长度增加,计算复杂度呈平方级增长($O(N^2)$)。而 FlashAttention 通过利用 GPU 的高速缓存(SRAM),将复杂度线性化,使得处理长文本成为可能。Together.ai 将这一技术深度集成到其云平台的每一个推理节点中,这意味着用户调用的每一个模型,默认都享受到了这种底层加速红利。

2.2 2025-2026 重磅更新:ATLAS 与 UPipe

进入 2025 年下半年至 2026 年初,Together.ai 连续发布了两项颠覆性技术,进一步巩固了其技术护城河。

1. ATLAS 动态推理优化技术(2025 年 10 月发布)

ATLAS(Adaptive Token-Level Acceleration System)是一项能够根据使用频率自动提升推理速度的技术。传统推理引擎对所有请求一视同仁,而 ATLAS 能够智能识别高频使用的 Prompt 模式和上下文结构,动态调整计算图和执行策略。据报道,该技术使得常用场景下的推理成本下降了 100 倍,并且 Tri Dao 预测仍有 10 倍的优化空间。这标志着 AI 推理从“静态配置”迈向了“自适应进化”的新阶段。

2. UPipe:超长文本处理的终极解决方案(2026 年 3 月推出)

处理超长文本(如整本小说、法律文档、代码库)一直是 AI 的痛点。传统的分布式处理虽然能分担计算压力,但每台机器仍需保存完整的中间状态,导致显存爆炸。当文本超过 200 万 token 时,即便是最先进的 GPU 集群也会崩溃。

Together.ai 团队推出的UPipe技术巧妙地解决了这一问题。他们发现,在处理超长文本时,模型并不需要同时激活所有的“注意力头”。UPipe 采用了一种创新的流水线并行策略,将注意力计算拆解并分配到不同的计算单元,同时只保留必要的中间状态。这使得together.ai能够以极高的效率处理千万级 token 的上下文,且显存消耗仅为传统方法的几分之一。对于需要分析海量数据的科研机构和法律科技公司来说,这无疑是一个游戏规则改变者。

2.3 硬件协同设计:告别单一依赖

除了软件优化,Together.ai 在硬件策略上也极具前瞻性。2025 年,公司部署了最新的 NVIDIA Blackwell 芯片以提升性能,但同时,Tri Dao 在公开演讲中倡导“模型架构与硬件协同设计”,并大胆预测英伟达 GPU 的主导地位将在三年内终结。Together.ai 的平台设计天生具备异构计算能力,能够灵活调度不同类型的算力资源,确保用户在未来的硬件多元化时代依然能获得最优性价比。

三、实战演练:5 分钟上手 Together.ai 开发

理论再多,不如代码一行。接下来,我们将通过实际的代码示例,展示如何利用together.ai快速构建你的第一个 AI 应用。我们将涵盖基础文本生成、流式输出以及使用最新 SDK 的高级用法。

3.1 环境准备与 API Key 获取

首先,你需要访问 Together.ai 官网注册账号。新用户通常会获得一定的免费额度用于测试。登录后,在 Dashboard 中生成你的 API Key。

在本地终端安装 Python 客户端库:

pip install together或者,如果你使用的是 Node.js 环境(特别是配合 Vercel AI SDK),可以安装官方提供的 Provider:

npm i @ai-sdk/togetherai3.2 基础示例:调用 Meta Llama 3.1 进行文本生成

让我们尝试调用目前最热门的开源模型之一:meta-llama/Meta-Llama-3.1-8B-Instruct-Turbo。注意后缀中的"Turbo",这代表该模型在 Together.ai 平台上经过了专门的推理加速优化。

import os

from together import Together

# 初始化客户端

client = Together(api_key=os.environ.get("TOGETHER_API_KEY"))

# 发送请求

response = client.chat.completions.create(

model="meta-llama/Meta-Llama-3.1-8B-Instruct-Turbo",

messages=[{"role": "user", "content": "请用通俗易懂的语言解释量子纠缠。"}],

max_tokens=500,

temperature=0.7,

)

# 输出结果

print(response.choices[0].message.content)这段代码展示了 Together.ai 简洁的 API 设计。你无需关心后端有多少台服务器在运行,只需指定模型名称和提示词,即可在毫秒级时间内获得高质量的回答。

3.3 进阶技巧:流式输出与实时交互

在构建聊天机器人或实时助手时,流式输出(Streaming)至关重要。它能显著提升用户体验,让用户感觉像是在与真人对话。

stream = client.chat.completions.create(

model="meta-llama/Meta-Llama-3.1-8B-Instruct-Turbo",

messages=[{"role": "user", "content": "写一首关于春天的短诗。"}],

stream=True, # 开启流式模式

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="", flush=True)通过设置stream=True,模型生成的每一个 token 都会实时返回给前端,实现了真正的“边想边说”。

3.4 集成 Vercel AI SDK:现代化全栈开发

对于使用 Next.js 或 React 的全栈开发者,Together.ai 提供了完美的集成方案。通过@ai-sdk/togetherai包,你可以轻松地将 AI 能力嵌入到你的应用中。

import { togetherai } from '@ai-sdk/togetherai';

import { generateText } from 'ai';

const { text } = await generateText({

model: togetherai('meta-llama/Meta-Llama-3.1-8B-Instruct-Turbo'),

prompt: 'Write a Python function that sorts a list using quicksort.',

});

console.log(text);这种集成方式不仅简化了代码,还利用了 Vercel AI SDK 的强大功能,如自动重试、中间件支持和统一的错误处理。

四、应用场景全景图:Together.ai 能做什么?

together.ai的灵活性使其适用于多种业务场景。以下是几个经过验证的高价值应用案例:

4.1 企业级知识库与长文档分析

借助 2026 年推出的UPipe技术,企业可以将数百页的技术手册、法律合同或财务报表一次性输入模型。Together.ai 能够精准提取关键信息、总结摘要或回答特定细节问题,而不会出现“遗忘”或显存溢出。这对于法律科技、金融分析和医疗诊断领域具有革命性意义。

4.2 代码生成与辅助编程

Together.ai 平台上托管了多个专为代码训练的模型(如 CodeLlama 系列)。结合其低延迟特性,它可以作为 IDE 插件的后端引擎,提供实时的代码补全、Bug 检测和重构建议。2024 年收购 CodeSandbox 后,Together.ai 进一步强化了其在代码解释和执行方面的能力,使得“自然语言转可运行代码”变得更加流畅。

4.3 多模态内容创作:从文本到视频

值得注意的是,市场上出现了一些名为"Together AI"的手机应用(由水木星云等公司开发),主打 AI 视频生成。虽然这些应用在名称上相似,但它们与本文介绍的美国 Together.ai 云平台是不同的产品。不过,这也反映了 Together 品牌在 AI 生成内容领域的广泛影响力。真正的 Together.ai 云平台正通过与多模态模型的合作,逐步拓展其在图像和视频理解方面的能力,为创作者提供更丰富的工具链。

4.4 私有化微调与定制模型

对于有特殊需求的企业,Together.ai 提供了一站式的微调服务。你可以上传自己的数据集,选择基础模型(如 Llama 3 或 Mixtral),在云端进行高效微调,最后部署为专属的 API 端点。整个过程无需管理任何基础设施,且支持数据隐私保护,确保敏感信息不出境。

五、竞品对比:Together.ai vs Fireworks AI vs Replicate

在开源模型推理赛道,Together.ai 面临着激烈的竞争。以下是它与主要竞品的对比分析:

| 特性 | Together.ai | Fireworks AI | Replicate |

|---|---|---|---|

| 核心优势 | FlashAttention 深度优化,超长上下文(UPipe),企业级稳定性 | 极致的低延迟,专注于推理速度 | 模型种类极其丰富,社区驱动,易于原型开发 |

| 长文本支持 | 极强 (UPipe 技术支持千万级 token) | 强 | 中等 (依赖具体模型实现) |

| 微调能力 | 内置一站式微调平台 | 支持微调 | 主要通过外部工具或自定义容器 |

| 定价策略 | 按 Token 计费,量大优惠明显,性价比高 | 极具竞争力的低价 | 按 GPU 运行时间计费,适合短时任务 |

| 适用人群 | 企业用户、长文本处理需求者、全栈开发者 | 对延迟极度敏感的实时应用 | 研究人员、创意工作者、快速原型验证 |

总体而言,如果你需要处理超长文本、追求极致的稳定性以及企业级的服务保障,together.ai是目前市场上的首选。其独特的 UPipe 技术和深厚的学术背景(斯坦福、普林斯顿团队)使其在技术深度上领先一步。

六、未来展望:开源 AI 的下一个十年

站在 2026 年的节点展望未来,Together.ai 的愿景不仅仅是做一个云服务商。正如联合创始人所言,他们的目标是“帮助创建超越封闭模型的开放模型,并将开源作为整合人工智能的默认方式”。

随着推理成本的持续下降(Tri Dao 预测仍有 10 倍优化空间)和模型能力的不断跃升,我们有理由相信,未来的 AI 应用将不再被几家巨头垄断。每一个开发者,无论身处何地,都能通过像together.ai这样的平台,平等地获取世界上最先进的 AI 能力。

从 Instant Clusters 自动化集群配置,到 ATLAS 动态优化,再到 UPipe 的长文本突破,Together.ai 正在一步步兑现其承诺:让 AI 基础设施变得像水电一样简单、便宜且无处不在。

七、结语

Together.ai 是什么?它是开源 AI 时代的引擎,是连接开发者与无限可能的桥梁。无论你是想构建下一个爆款应用,还是希望在企业中落地 AI 转型,现在都是加入 Together.ai 生态的最佳时机。

不要让你的创意停留在纸面上。立即注册 Together.ai,获取你的 API Key,开始用代码塑造未来。在这个开源繁荣的时代,唯一的限制就是你的想象力。

参考资料与信息源

- Together AI 官方融资新闻与公司介绍 (2025-2026 数据): https://www.together.ai

- Tri Dao 关于推理成本与硬件协同设计的演讲记录 (2025 年 9 月): Twitter/X @tridao

- UPipe 技术详解与长文本处理挑战分析 (2026 年 3 月): Together AI Blog

- Vercel AI SDK Together Provider 文档 (2026 年 3 月更新): AI SDK Documentation

- NPM Package: @ai-sdk/togetherai 版本信息与下载量统计: NPM Registry

- 2025 年十大 AI 推理云平台评测报告: TechCrunch AI Section

- Together AI 关于 DeepSeek 模型部署与企业平台上线公告: Together AI News

相关推荐

- 基础模型:开启AI新时代的通用智能引擎

- Prompt 是什么全面解析:从基础定义到 2026 年实战应用详解

- 过拟合:当模型“学得太好”反而成了问题

- 梯度消失:深度学习模型训练中的“隐形杀手”与破解之道

- Together.ai 是什么?从核心原理到实战应用,新手入门必看的一文搞懂指南

- Umi-OCR 是什么?离线免费、精准高效的本地文字识别神器一文搞懂

- Civitai 是什么?从入门到进阶,一文搞懂全球最大 AI 模型社区怎么用、有什么用

- Artificial Analysis 是什么?从核心原理到实战应用,新手入门必看的一文搞懂指南

- 批归一化:让深度学习训练又快又稳的“秘密武器”

- LMSYS Chatbot Arena 是什么?全球最强大模型竞技场一文搞懂:从评测原理到实战用法