Ollama 是什么?本地运行大模型从入门到实战,这一篇就够了

摘要:在 2026 年,大模型(LLM)的部署早已不再是科技巨头的专利。随着 Ollama 工具的迭代升级,尤其是 v0.18.2 版本的发布,本地运行大模型变得前所未有的简单、高效且低成本。本文将深度解析 Ollama 是什么,如何从零开始在 Windows、Mac 和 Linux 上部署,并结合最新的 OpenClaw 生态与 Qwen3.5、DeepSeek-R1 等顶尖开源模型,打造属于你的“零成本、高隐私”私有化 AI 助手。无论你是开发者、数据分析师还是 AI 爱好者,这篇从入门到实战的指南都将是你 2026 年不可或缺的工具书。

一、为什么 2026 年是“本地大模型”的爆发元年?

过去三年,我们见证了 AI 大模型从实验室走向大众,但绝大多数用户仍被困在“云端依赖”的陷阱里。高昂的 API 费用、敏感数据的隐私泄露风险、以及网络延迟带来的体验割裂,成为了阻碍 AI 普及的三座大山。

根据 2025 年底的权威调研数据显示,全球 78% 的 AI 用户因 API 费用限制了使用频率,63% 的用户担忧数据上传的隐私风险。更令人咋舌的是,对于重度使用者,每月的云端 Token 消耗可能高达数千甚至上万美元,这相当于一台高端工作站的年租金。

然而,2026 年的风向变了。随着硬件算力的下沉和推理引擎的优化,“本地部署”不再是大佬专属的黑科技。Ollama 作为这一变革的核心推手,被开发者亲切地称为“大模型的 Docker"。它通过将模型权重、运行配置和推理引擎整合为一个标准化的镜像,让用户只需一条命令,即可在个人电脑上流畅运行 Llama 3、Qwen3.5、DeepSeek-R1 等顶级模型。

这不仅仅是一次技术的胜利,更是一场关于数据主权和成本自由的革命。今天,我们就来彻底拆解这个让无数人实现"AI 自由”的神器。

二、Ollama 是什么?重新定义本地 AI 运行标准

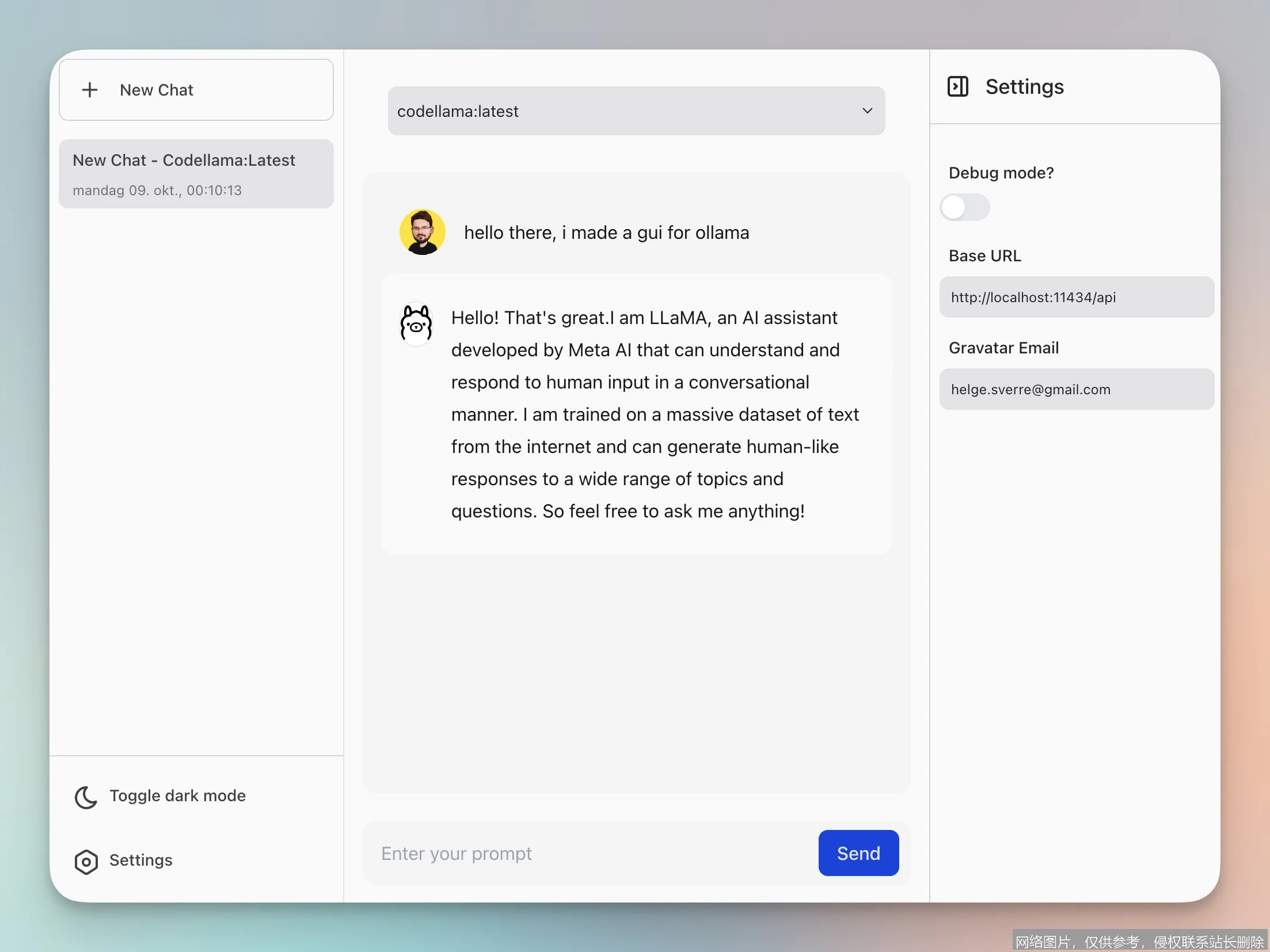

Ollama 是一个开源的、跨平台的本地大模型运行工具。它的核心理念极其简单:模型即服务(Model as a Service),但在你的本地机器上。

在 Ollama 出现之前,想要在本地跑通一个 7B 参数的模型,你需要:安装 CUDA、配置 Python 虚拟环境、解决依赖冲突、下载巨大的模型权重文件、编写复杂的推理脚本……整个过程往往需要耗费数小时,甚至因为一个版本不兼容而宣告失败。

Ollama 的出现堪称一次“降维打击”。它将所有复杂的环境配置封装在底层,用户无需写一行 Python 代码,无需关心显存管理细节,只需通过命令行即可完成模型的拉取、运行和管理。

1. 核心优势:为什么选择 Ollama?

- 一键运行,极简部署:支持 macOS、Linux 和 Windows(通过 WSL2 或原生安装包),安装过程不超过 5 分钟。

- 海量模型库:官方库支持超过 150 个开源模型,包括 Meta 的 Llama 3 系列、阿里的 Qwen 系列、微软的 Phi-3、Google 的 Gemma 以及国产之光 DeepSeek 等。

- 智能资源调度:自动检测并利用 GPU(NVIDIA CUDA、Apple Metal)进行加速,同时也支持纯 CPU 运行量化模型,让低配电脑也能跑大模型。

- 标准化 API:提供标准的 RESTful API,完美兼容 LangChain、LlamaIndex 等主流开发框架,方便开发者快速集成到自己的应用中。

- 隐私与安全:所有数据均在本地处理,无需联网,彻底杜绝数据泄露风险,非常适合处理合同、代码、病历等敏感信息。

2. 2026 年最新版特性(v0.18.2)

截至 2026 年 3 月 19 日,Ollama 正式发布了 v0.18.2 版本。这次更新不仅仅是修补漏洞,更是对生态系统的全面升级:

- OpenClaw 深度集成:解决了 OpenClaw 依赖缺失问题,现在安装前会自动检查

npm和git,并给出明确的错误提示和修复指引,大幅降低了新手门槛。 - MLX 量化全面升级:针对 Apple Silicon 芯片进行了深度优化,利用 MLX 框架进一步提升了推理速度,降低了显存占用。

- Claude Code 本地缓存修复:解决了本地运行类 Claude 模型时的缓存失效问题,提升了长上下文对话的稳定性。

- 联网搜索插件注册异常修复:确保模型能够稳定调用外部搜索工具,实现真正的 Agent 能力。

这些更新标志着 Ollama 从一个单纯的“模型运行器”进化为一个完整的“本地 AI 操作系统”。

三、手把手教程:全平台安装与配置指南

无论你使用的是 Mac、Windows 还是 Linux,Ollama 都能提供一致的优质体验。以下是基于 2026 年最新环境的详细安装步骤。

1. macOS 用户:丝滑的原生体验

Mac 用户,尤其是搭载 M1/M2/M3/M4 芯片的用户,是 Ollama 的最大受益者之一。Apple 的统一内存架构使得大模型在 Mac 上的运行效率极高。

- 系统要求:macOS 12.0 及以上(推荐 macOS 13+),内存建议≥16GB。

- 安装步骤:

- 访问 Ollama 官网下载 DMG 安装包。

- 双击打开,将 Ollama.app 拖入“应用程序”文件夹。

- 打开终端(Terminal),输入

ollama --version验证安装。

- 特别提示:Mac 版默认后台运行,任务栏会出现小羊驼图标。你可以直接在终端运行模型,无需额外启动服务。

2. Windows 用户:告别 WSL2 的繁琐(2026 新特性)

在 2024-2025 年,Windows 用户通常需要通过 WSL2(Windows Subsystem for Linux)来运行 Ollama。但在 2026 年,Ollama 已经提供了原生的 Windows 安装包,体验更加流畅。

- 系统要求:Windows 10/11,建议配备 NVIDIA 显卡(显存≥8GB)以获得最佳性能。

- 安装步骤:

- 下载最新的

ollama.exe安装包(国内用户可使用加速镜像链接)。 - 双击运行,点击"Install",默认安装路径为

C:\Users\用户名\AppData\Local\Programs\Ollama。 - 安装完成后,右下角任务栏会出现小羊驼图标,表示服务已自动启动。

- 打开 PowerShell 或 CMD,输入

ollama --version验证。

- 下载最新的

- 环境变量配置:如果需要修改模型存储路径(默认在 C 盘,占用空间大),可以设置环境变量

OLLAMA_MODELS指向其他磁盘分区。

3. Linux 用户:开发者的首选

Linux 是部署大模型最灵活的平台,尤其适合服务器环境。

- 一键安装脚本:

curl -fsSL https://ollama.com/install.sh | sh - 启动服务:

sudo systemctl enable ollama sudo systemctl start ollama - GPU 加速配置:确保已安装 NVIDIA 驱动(≥535)和 CUDA Toolkit(≥12.0)。Ollama 会自动检测并启用 cuBLAS 加速,无需手动配置。

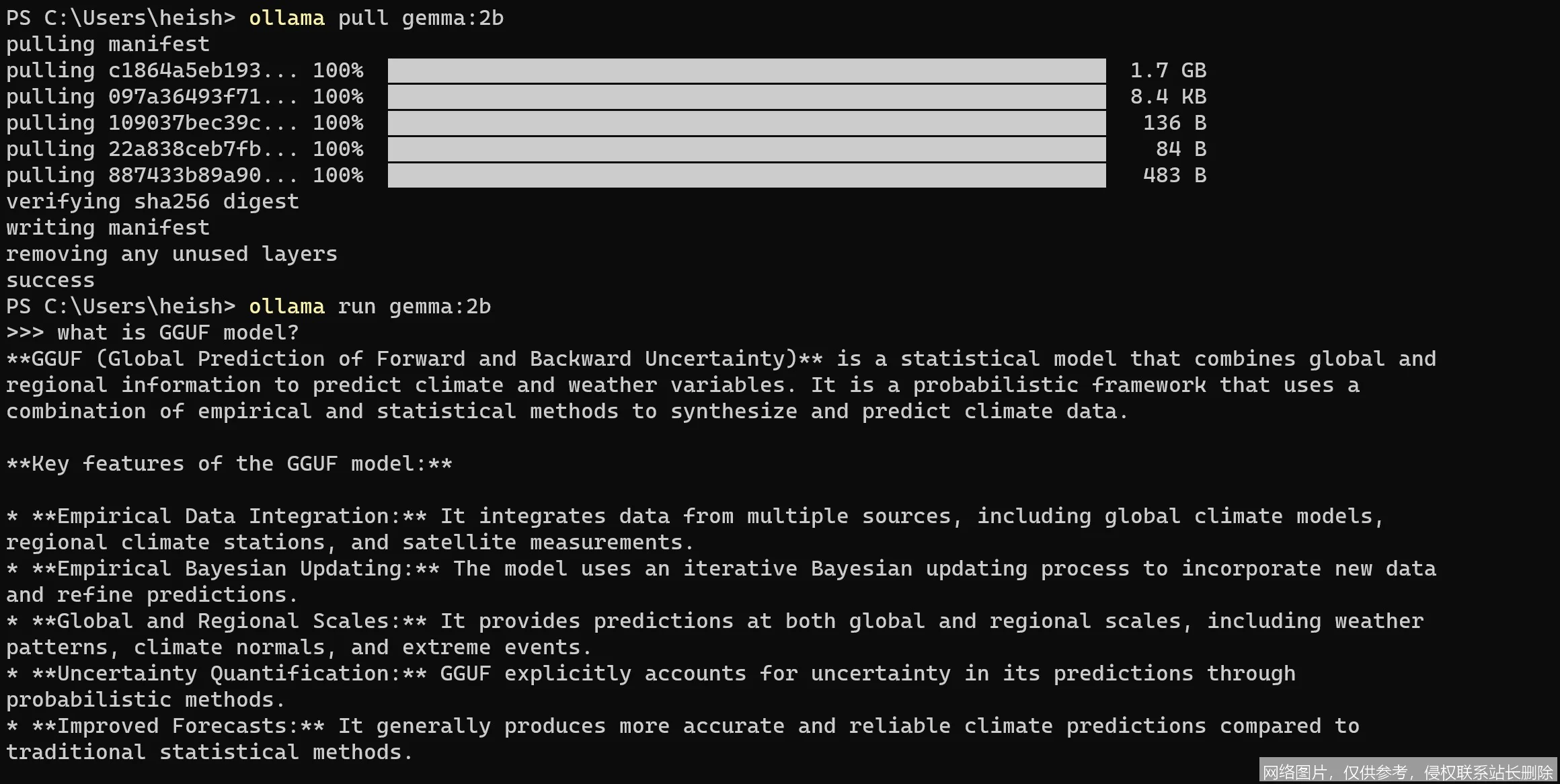

四、实战演练:拉取并运行你的第一个大模型

安装完成后,激动人心的时刻到了。让我们开始运行模型吧!

1. 探索模型库

Ollama 拥有一个庞大的模型库。你可以在终端输入以下命令查看可用模型:

ollama list或者访问官网模型库页面浏览更多详情。2026 年最受欢迎的模型包括:

- Qwen3.5 系列:阿里达摩院出品,中文能力极强,拥有从 0.8B 到 122B 的多个版本。其中 9B 版本仅需 6.6GB 显存,是性价比之王。

- Llama 3.3:Meta 的最新力作,通用能力均衡,生态丰富。

- DeepSeek-R1:国产开源黑马,尤其在逻辑推理和代码生成方面表现卓越,其蒸馏版本(Distill)非常适合本地部署。

2. 一键运行模型

假设你想运行阿里的 Qwen3.5 7B 版本,只需执行:

ollama run qwen3.5:7b首次运行时,Ollama 会自动下载模型文件(存放在 ~/.ollama/models 或配置的目录下)。下载完成后,直接进入交互对话界面。你可以像使用 ChatGPT 一样与它交流:

>> 请用 Python 写一个快速排序算法。

>>> 解释一下量子纠缠的概念。

>>> 帮我总结这篇文章的核心观点...退出对话只需输入 /bye 或按下 Ctrl+D。

3. 进阶玩法:自定义 Modelfile

Ollama 的强大之处在于其类似 Dockerfile 的 Modelfile 机制。你可以基于基础模型创建自己的定制版本。

例如,创建一个专门用于“代码审查”的模型:

FROM qwen3.5:7b

SYSTEM "你是一位资深的代码审查专家,擅长发现潜在的安全漏洞和性能瓶颈。请用简洁专业的语言给出建议。"

PARAMETER temperature 0.3

PARAMETER num_ctx 4096保存为 Modelfile,然后运行:

ollama create coder-review -f Modelfile

ollama run coder-review这样,你就拥有了一个专属的 AI 代码助手,且完全离线运行。

五、生态融合:Ollama + OpenClaw = 超级 AI Agent

如果说 Ollama 是大模型的大脑,那么 OpenClaw 就是它的四肢。2026 年,两者的结合成为了本地 AI 应用的黄金标准。

1. 什么是 OpenClaw?

OpenClaw 是一个开源的 AI Agent 框架,它能够赋予大模型操作电脑、管理文件、联网搜索、控制智能家居等能力。在 v0.18.2 版本中,Ollama 对 OpenClaw 进行了深度优化,实现了无缝集成。

2. 为什么它们是绝配?

- 零 Token 成本:传统 Agent 依赖云端 API,每次调用都消耗 Token。而 Ollama+OpenClaw 组合完全在本地运行,无论执行多少任务,成本均为零。

- 全能操作权限:云端模型通常只能“动口”,无法“动手”。本地部署的 OpenClaw 可以直接读取你的本地文件、执行 Shell 命令、操作浏览器,真正实现自动化办公。

- 极速响应:省去了网络传输延迟,本地推理加上本地执行,响应速度达到毫秒级。

3. 部署实战

在 Ollama v0.18.2 中,部署 OpenClaw 变得异常简单:

ollama launch openclaw该命令会自动检查依赖(npm, git),拉取必要的组件,并启动服务。启动后,你可以通过自然语言指令让 AI 帮你完成复杂任务,例如:

- “帮我把桌面上所有的 PDF 文件整理到‘文档’文件夹,并按日期重命名。”

- “搜索最新的 Python 3.13 特性,并生成一份对比报告保存到桌面。”

- “监控我的系统资源,如果 CPU 占用超过 90%,就发送通知给我。”

这种“所言即所得”的体验,正是本地 AI 的魅力所在。

六、性能优化:如何让老电脑也能跑大模型?

很多人担心自己的电脑配置不够,跑不动大模型。其实,通过合理的优化策略,即使是几年前的设备也能流畅运行。

1. 选择合适的量化版本

Ollama 默认拉取的通常是 4-bit 量化(q4_0)版本。这种版本在精度损失极小的情况下,能将显存占用减少 60%-70%。例如,一个 7B 模型的全精度版本需要 14GB 显存,而 4-bit 版本仅需 4-5GB。

你可以显式指定量化版本:

ollama run llama3:8b-instruct-q4_02. 开启 Flash Attention

对于支持的设备,Ollama 会自动开启 Flash Attention 技术,大幅提升长文本处理的效率和显存利用率。在 2026 年的新版本中,这一功能已默认优化,无需手动配置。

3. 调整上下文窗口(Context Window)

默认的上下文窗口可能较大,占用较多内存。如果你不需要处理超长文档,可以通过参数限制它:

ollama run qwen3.5 --num_ctx 2048这将显著降低内存压力,提升推理速度。

4. 混合推理模式

Ollama 支持 CPU 与 GPU 混合推理。当显存不足时,它会自动将部分图层卸载到系统内存(RAM)中,由 CPU 承担计算任务。虽然速度会有所下降,但保证了模型能够运行起来,不会出现 OOM(Out Of Memory)错误。

七、常见误区与未来展望

误区一:本地模型不如云端聪明?

这是一个过时的观点。2026 年的开源模型(如 Qwen3.5-72B、Llama 3.3-70B)在多项基准测试中已经逼近甚至超越了两年前的云端旗舰模型。对于大多数日常应用(写作、编程、数据分析),本地模型的表现已经完全够用,且在特定领域的微调潜力更大。

误区二:只有高端显卡才能玩?

错!得益于量化技术和高效的推理引擎,现在的 7B、9B 甚至 14B 模型可以在 8GB 显存的显卡(如 RTX 3060)甚至纯 CPU 环境下流畅运行。对于文本生成任务,速度完全可以接受。

未来展望:端侧 AI 的无限可能

随着 Ollama 社区的壮大和硬件性能的持续提升,未来的 AI 将更加个性化、私密化。我们可以预见:

- 个人知识库助手:每个用户都可以训练一个完全理解自己文档、邮件、笔记的专属模型。

- 离线多模态交互:本地运行视觉 - 语言模型,实现无需联网的图片识别和视频分析。

- 去中心化 AI 网络:多台设备通过 Ollama 互联,形成分布式的算力网络,共同处理超大规模任务。

结语:拥抱本地 AI,掌握数据主权

Ollama 的出现,不仅仅是一个工具的革新,更是一种理念的回归。它告诉我们,AI 不应该被少数巨头垄断,也不应该成为昂贵的奢侈品。通过简单的几步操作,每个人都可以拥有一台属于自己的“超级大脑”。

在这个数据价值日益凸显的时代,选择本地部署,就是选择安全、自由和未来。别再给 API 打工了,现在就打开终端,输入 ollama run,开启你的本地大模型之旅吧!

参考资料与信息源

- Ollama 官方博客与发布说明 (2026 年 3 月更新): https://github.com/ollama/ollama/releases

- Ollama 官方模型库: https://ollama.com/library

- OpenClaw GitHub 项目主页 (2026 年社区数据): https://github.com/openclaw/openclaw

- Hugging Face 模型社区: https://huggingface.co

- 2026 年 AI 本地部署趋势分析报告 (综合知乎、Reddit 讨论): https://www.zhihu.com/topic/19552876/hot

- Qwen3.5 技术报告与评测: https://qwenlm.github.io/

相关推荐

- 预训练是什么:2026 大模型基石原理、技术演进与实战应用全面解析

- 什么是知识库?2026 年最新定义、技术原理与实战应用全面解析

- 语义搜索是什么:2026 年原理、技术演进与全场景应用详解

- 什么是自监督学习?2026 原理、应用与实战全面解析

- ONNX 是什么:2026 跨框架模型标准详解,从原理到实战应用

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用