AutoGen 是什么?从原理到实战,一文搞懂多智能体协作框架入门必看

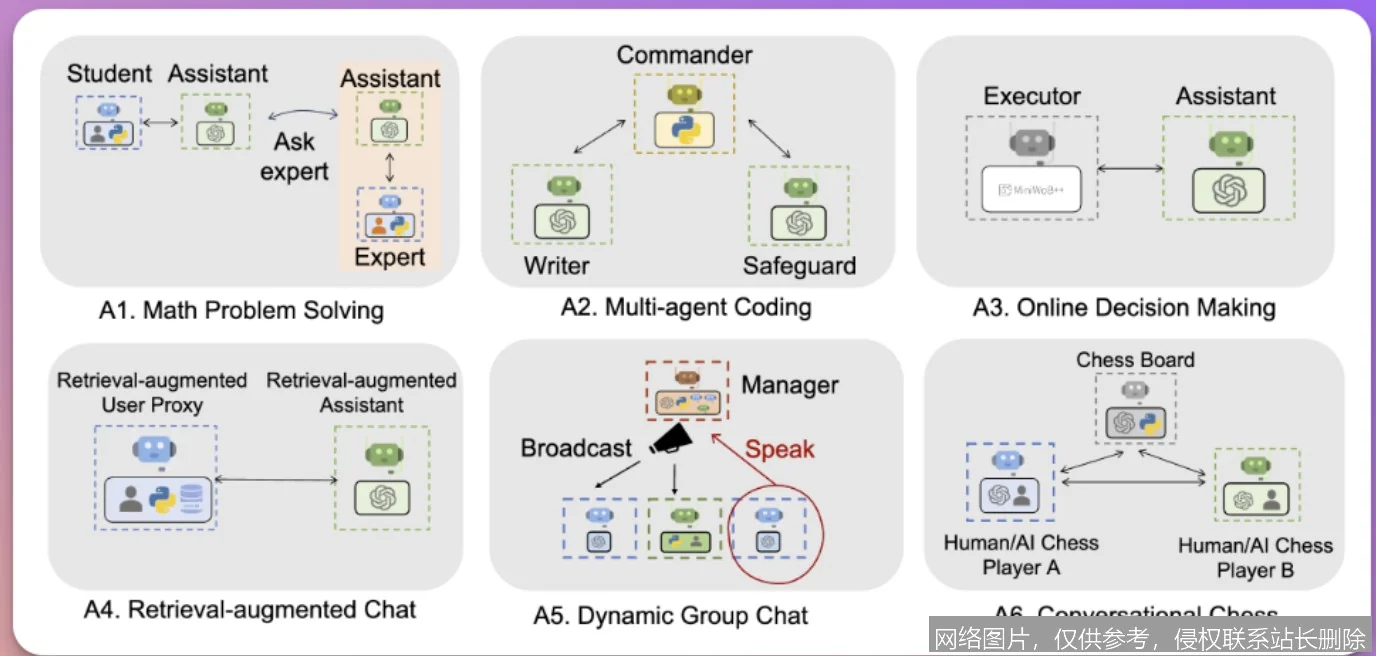

AutoGen 是什么?如果你正在关注人工智能领域的最新突破,或者正苦恼于如何让大模型从“单兵作战”进化为“团队协作”,那么这个词你绝对无法绕过。作为微软研究院(Microsoft Research)推出的开源框架,AutoGen 不仅仅是一个代码库,它代表了 AI 应用开发范式的一次根本性转移:从提示词工程(Prompt Engineering)转向智能体编排(Agent Orchestration)。

截至 2026 年 3 月,随着 AutoGen v0.4 架构的全面成熟以及与 Microsoft Agent Framework (MAF) 的战略合并,多智能体系统已经从实验室的玩具变成了企业级落地的核心引擎。本文将深入剖析 AutoGen 的核心原理,解读其最新的架构演进,并通过实战案例带你从零构建一个能自主协作、编写代码甚至进行辩论的 AI 团队。无论你是刚入门的开发者,还是寻求技术突破的资深架构师,这篇文章都将是你理解下一代 AI 应用的必读指南。

一、颠覆认知:为什么我们需要多智能体协作?

在 AutoGen 出现之前,我们与 AI 交互的主流模式是“一对一”:人类提出一个问题,大语言模型(LLM)给出一个答案。这种模式在处理简单任务时表现出色,但在面对复杂、多步骤或需要跨领域知识的任务时,往往显得力不从心。单一大模型容易出现幻觉、逻辑断层,或者因为上下文窗口限制而丢失关键信息。

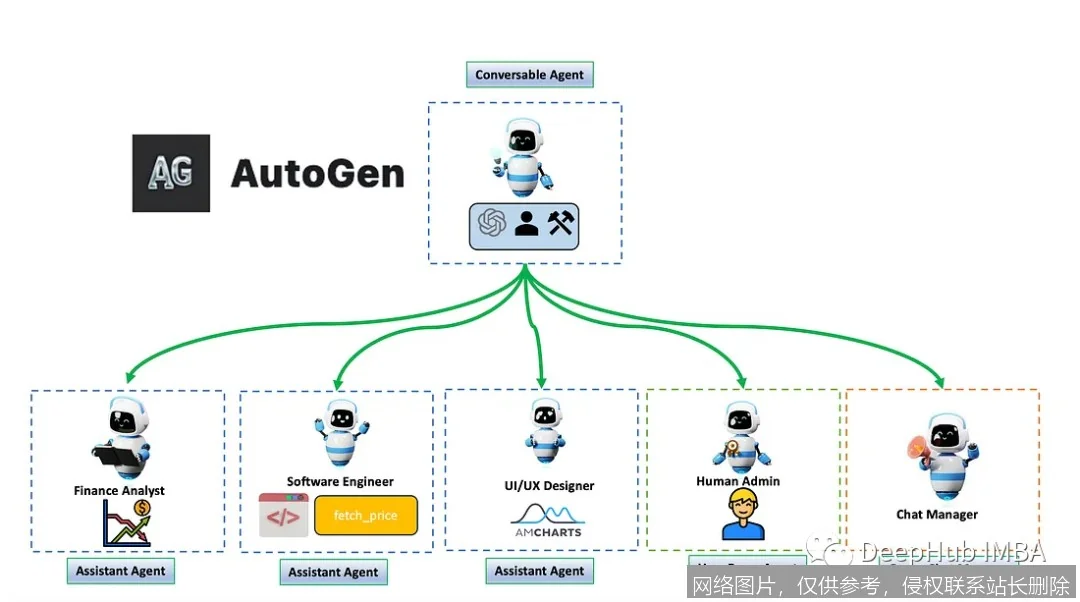

AutoGen 的核心理念在于模拟人类社会的协作机制。它不再依赖一个全知全能的“超级大脑”,而是构建一个由多个具有不同角色、技能和目标的智能体(Agents)组成的团队。这些智能体可以互相对话、交换信息、批评彼此的观点、调用外部工具,甚至执行代码来验证结果。

1.1 从“单线程”到“群聊模式”的思维跃迁

想象一下,你要开发一个复杂的网页应用。在传统模式下,你要求一个 AI:“帮我写一个带数据库的用户登录系统。”它可能会给你一段代码,但往往缺乏安全性检查、前端美化或错误处理。而在 AutoGen 的范式下,你可以组建一个虚拟团队:

- 产品经理智能体:负责拆解需求,定义功能列表。

- 架构师智能体:设计数据库结构和 API 接口。

- 工程师智能体:编写具体代码,并拥有执行代码的能力。

- 测试工程师智能体:运行代码,发现 Bug 并反馈给工程师。

- 用户代表智能体:从用户体验角度提出修改意见。

在这个“群聊”中,智能体们会自动协商,直到任务完成。这种涌现式(Emergent)的解决问题的能力,是单一大模型难以企及的。根据 2025 年底至 2026 年初的基准测试数据,在 GAIA(通用人工智能评估)和 SWE-bench(软件工程基准)等高难度任务中,基于 AutoGen 的多智能体系统成功率比单体模型高出 25%-40%,特别是在代码修复和复杂推理场景下表现尤为惊人。

1.2 AutoGen 的核心优势

- 灵活性:支持任意数量的智能体,角色定义完全自定义。

- 工具调用闭环:智能体不仅能说话,还能真正执行 Python 代码、搜索网络、调用 API,形成“思考 - 行动 - 观察”的完整闭环。

- 人机协同:人类可以随时介入对话,审批关键操作或提供指导,确保系统可控。

- 模型无关性:完美支持 OpenAI、Azure OpenAI,以及通义千问、智谱 GLM 等国产大模型,不被单一服务商绑定。

二、架构演进:从 v0.2 到 Microsoft Agent Framework 的蜕变

理解 AutoGen 的最佳方式是回顾它的进化史。作为一个快速迭代的项目,AutoGen 在短短两年多时间里经历了翻天覆地的变化。特别是 2025 年初发布的 v0.4 版本,被视为其技术架构的巅峰之作,并为后来并入 Microsoft Agent Framework 奠定了坚实基础。

2.1 版本迭代关键点

| 版本阶段 | 核心定位 | 关键特性与局限 |

|---|---|---|

| AutoGen v0.2 (早期) | 研究原型 | 引入了 GroupChat 概念,实现了基本的多轮对话。主要采用阻塞式同步调用,适合快速试错和研究涌现行为,但在生产环境的稳定性和可观测性上存在不足。 |

| AutoGen v0.4 (2025 年初) | 模块化架构巅峰 | 彻底重构为三层架构(Core/AgentChat/Ext)。全面异步化,引入事件驱动机制。分离了底层原语和高层 API,极大地提升了扩展性和性能。这是目前大多数高级应用的基础。 |

| Microsoft Agent Framework (2025 年末至今) | 企业级统一框架 | AutoGen 与 Semantic Kernel 合并。保留了 AutoGen 的对话式群聊能力,融合了 SK 的工作流编排(Workflow/DAG)和企业级特性(持久化、可观测性)。标志着从“实验框架”向“工业级操作系统”的转变。 |

2.2 深度解析 v0.4 三层架构

对于开发者而言,理解 v0.4 引入的三层架构至关重要,它是当前 AutoGen 生态的基石:

1. autogen-core(核心层)

这是框架的底层引擎,提供了事件驱动的原语。它不关心具体的聊天逻辑,而是专注于消息的路由、生命周期管理和状态维护。这一层的设计使得 AutoGen 能够支持分布式执行,为未来大规模智能体集群打下基础。

2. autogen-agentchat(智能体聊天层)

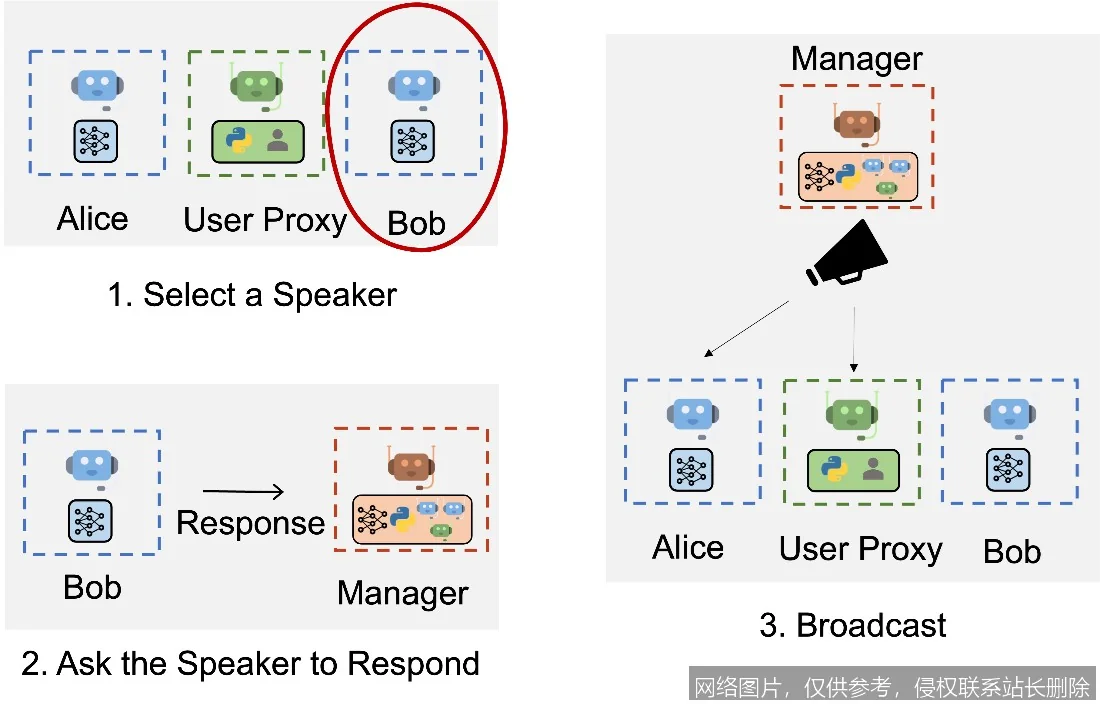

这是大多数用户直接交互的层级。它封装了高层 API,如 AssistantAgent(助手智能体)、UserProxyAgent(用户代理)和 GroupChat(群聊管理器)。在这一层,你可以轻松定义智能体的角色、系统提示词以及它们之间的协作规则(如轮流发言、自动终止条件)。

3. autogen-ext(扩展层)

这是一个可插拔的生态系统。通过扩展包,AutoGen 可以连接各种外部资源。例如,autogen-ext[openai] 用于连接兼容 OpenAI 接口的模型(包括众多国产模型),autogen-ext[docker] 用于在安全容器中执行代码,还有针对 MCP(Model Context Protocol)的支持,让智能体能无缝访问本地文件和数据库。

三、实战准备:环境搭建与国产模型集成

理论再多,不如动手跑通一个 Demo。得益于 0.5.7 及后续版本的优化,现在的 AutoGen 安装和配置比以往任何时候都更加简单,尤其是对国产大模型的支持已经非常成熟。

3.1 环境前置条件

在开始之前,请确保你的开发环境满足以下要求:

- Python 版本:必须是 3.10 或更高(推荐 3.10 或 3.11),低版本会导致异步语法错误。

- 虚拟环境:强烈建议使用

venv或conda创建独立环境,避免依赖冲突。 - API Key:准备好你的大模型 API Key。如果你使用的是通义千问、智谱清言等国产模型,确保你有对应的接入密钥。

3.2 一键安装核心组件

AutoGen 采用了模块化安装策略。你需要安装核心的聊天包和你需要的扩展包。对于大多数初学者和国产模型用户,以下命令足矣:

# 安装核心聊天功能和 OpenAI 兼容扩展(支持国产模型)

pip install -U "autogen-agentchat" "autogen-ext[openai]"

# (可选)安装 AutoGen Studio,用于可视化编排

pip install -U "autogenstudio"

注意:如果你遇到网络下载缓慢的问题,建议配置国内镜像源(如清华源或阿里源)以加速安装过程。

3.3 配置国产大模型

很多开发者误以为 AutoGen 只能连 OpenAI,其实它对符合 OpenAI 协议格式的国产模型支持极佳。以阿里云通义千问(Qwen)为例,配置代码如下:

from autogen_ext.models.openai import OpenAIChatCompletionClient

# 配置通义千问模型

client = OpenAIChatCompletionClient(

model="qwen-max", # 替换为你使用的具体模型名称

api_key="YOUR_DASHSCOPE_API_KEY",

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1", # 关键:指定国产模型的兼容接口地址

model_info={

"function_calling": True,

"json_output": True,

"vision": True

}

)

通过这种方式,你可以低成本地使用高性能的国产模型来驱动整个智能体团队,无需担心高昂的 Token 费用或网络延迟问题。实测表明,在中文语境下的任务协调中,通义千问等国产模型的表现非常稳定,甚至在某些文化相关的任务上优于国外模型。

四、核心实战:构建一个“代码自动生成与修复”团队

现在,让我们通过一个经典的实战案例,看看 AutoGen 是如何工作的。我们将创建一个包含三个角色的智能体团队,任务是:“编写一个 Python 脚本,抓取某网站头条新闻,并保存为 CSV,如果报错则自动修复。”

4.1 定义智能体角色

我们需要三个核心角色:

- Coder (程序员):负责写代码,拥有执行权限。

- Manager (项目经理):负责协调两者,判断任务是否完成。

Reviewer (审查员):负责检查代码逻辑和安全,不直接执行代码。

4.2 代码实现

以下是基于 AutoGen v0.4+ 语法的简化实现逻辑:

import asyncio

from autogen_agentchat.agents import AssistantAgent, UserProxyAgent

from autogen_agentchat.teams import RoundRobinGroupChat

from autogen_ext.code_executors.local import LocalCommandLineCodeExecutor

# 1. 初始化模型客户端 (使用上述配置的 client)

# client = ...

# 2. 创建代码执行器 (本地安全执行)

executor = LocalCommandLineCodeExecutor(work_dir="coding")

# 3. 定义智能体

coder = AssistantAgent(

name="Coder",

system_message="你是一个专业的 Python 程序员。你负责编写代码来解决用户的问题。你必须使用提供的代码执行器来测试你的代码。如果代码报错,请分析错误并修复。",

model_client=client,

tools=[] # Coder 本身不调用外部工具,而是生成代码让执行器跑

)

reviewer = AssistantAgent(

name="Reviewer",

system_message="你是一个严谨的代码审查员。检查 Coder 编写的代码是否存在逻辑错误、安全隐患或效率问题。如果发现问题,请明确指出并要求 Coder 修改。如果没有问题,请回复 'APPROVED'。",

model_client=client

)

user_proxy = UserProxyAgent(

name="User",

system_message="你是一个用户代理。当 Coder 需要运行代码时,你将代表他执行。",

code_execution_config={"executor": executor}

)

# 4. 组建团队 (使用轮询模式,依次发言)

team = RoundRobinGroupChat(

participants=[coder, user_proxy, reviewer],

max_turns=10 # 限制最大对话轮数,防止死循环

)

# 5. 启动任务

async def main():

task = "编写一个脚本,获取知乎热榜前 5 个话题标题,保存为 hot_topics.csv。如果请求失败,请添加重试机制。"

result = await team.run(task=task)

print("任务完成结果:", result)

# 运行

# asyncio.run(main())

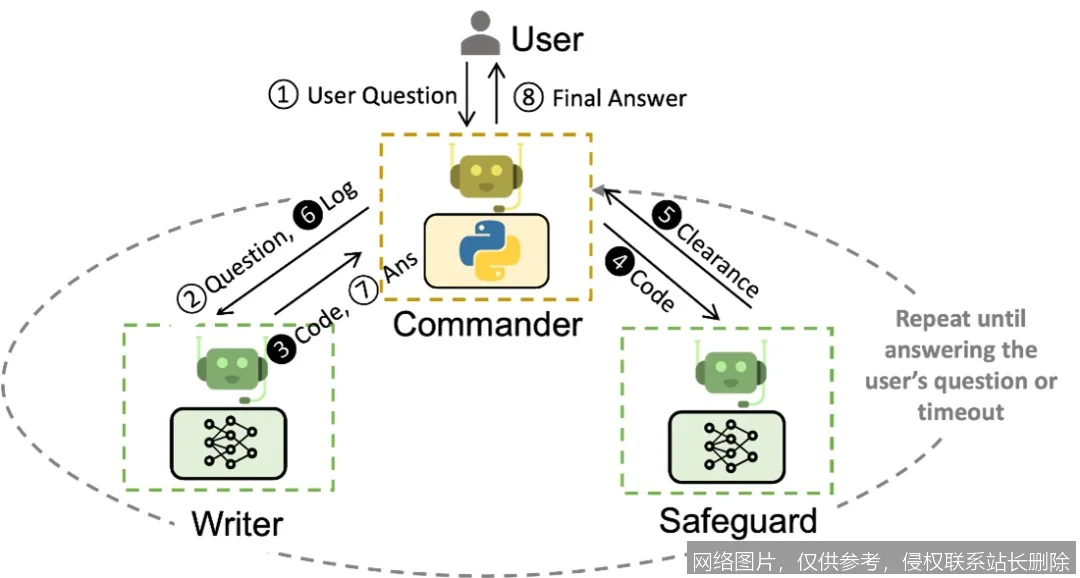

4.3 运行流程解析

当你运行这段代码时,一场精彩的“内部会议”随即展开:

- 第一轮:Coder 接收到任务,编写了初始爬虫代码,并请求执行。

- 第二轮:UserProxy 拦截执行请求,在本地沙箱中运行代码。假设网站反爬导致报错,UserProxy 将错误日志返回给团队。

- 第三轮:Coder 看到错误日志,分析后添加了

headers和time.sleep重试机制,再次提交代码。 - 第四轮:UserProxy 再次执行,这次成功了,生成了 CSV 文件。

- 第五轮:Reviewer 检查代码,确认没有硬编码密码、没有死循环,回复 "APPROVED"。

- 结束:Manager 检测到所有成员达成共识且任务完成,终止对话。

整个过程完全自动化,无需人工干预。这就是 AutoGen 的魅力:**将复杂的编程调试过程转化为自然的语言对话过程**。

五、进阶应用:不仅仅是写代码

虽然代码生成是 AutoGen 的杀手锏,但其应用场景远不止于此。结合 2026 年的最新趋势,以下是一些极具价值的应用方向:

5.1 自动化市场调研报告

组建一个由“搜索专家”、“数据分析师”和“报告撰写人”组成的团队。搜索专家利用联网工具搜集最新行业新闻,数据分析师整理数据并绘制图表(调用绘图工具),报告撰写人综合信息生成深度研报。这种模式可以将原本需要数天的工作缩短至几分钟。

5.2 沉浸式教育陪练

在语言学习或面试模拟中,可以设置一个“考官智能体”和一个“同伴智能体”。考官负责提问和评分,同伴负责在旁观察并在适当时候给予提示或发起辩论。这种多角色的互动比单一的问答机器人更能提升学习效果。

5.3 企业级客服工单处理

结合 Microsoft Agent Framework 的工作流能力,可以构建确定性的业务流程。当用户提交工单时,分类智能体判断类型,路由给相应的专业智能体(如退款处理、技术支援),并在必要时转接人工审批。这种混合了“群聊灵活性”和“工作流确定性”的模式,是企业落地的首选。

六、挑战与未来:理性看待多智能体

尽管 AutoGen 功能强大,但在实际落地中仍面临一些挑战,开发者需要保持清醒:

- 成本问题:多智能体意味着多倍的 Token 消耗。一个复杂的任务可能需要几十个来回的对话,费用可能是单次调用的数十倍。优化策略包括使用小模型处理简单任务、设置严格的终止条件等。

- 非确定性:由于 LLM 的概率特性,同样的输入可能产生不同的协作路径,这给测试和复现带来了困难。v0.4 引入的可观测性工具(Observability)正在努力解决这一问题,记录每一步的决策链路。

- 上下文爆炸:长对话容易耗尽模型的上下文窗口。合理的记忆管理策略(如只保留关键摘要)是构建长期运行系统的必备技能。

未来展望:随着 Microsoft Agent Framework 的统一,AutoGen 将更加深入地融入 Azure 云生态和 Semantic Kernel 体系。我们可以预见,未来的智能体将具备更强的持久化记忆能力、更高效的分布式执行能力,以及更丰富的第三方工具生态。对于开发者来说,现在正是掌握这一技术栈的最佳时机。

结语

AutoGen 不仅是一个框架,它是一把开启通用人工智能(AGI)应用大门的钥匙。它让我们看到了这样一个未来:软件不再是冷冰冰的代码堆砌,而是由一群不知疲倦、各怀绝技的 AI 员工组成的动态组织。从原理理解到环境搭建,再到实战演练,希望本文能帮助你迈出构建自己第一个 AI 团队的第一步。

在这个 AI 飞速发展的时代,唯有不断学习和实践,才能不被浪潮抛下。现在就打开你的编辑器,安装 AutoGen,让你的智能体们开始工作吧!

参考资料与信息源

- Microsoft AutoGen Official Documentation & GitHub Repository. (Accessed March 2026). https://github.com/microsoft/autogen

- Microsoft Research Blog: "AutoGen v0.4: Reimagining the foundation of agentic AI". (December 2024). https://microsoft.github.io/autogen/blog/2024/12/12/autogen-04

- Announcement: Unification of AutoGen and Semantic Kernel into Microsoft Agent Framework. (October 2025). https://devblogs.microsoft.com/semantic-kernel/

- Benchmark Analysis: Multi-Agent Performance on GAIA and SWE-bench Verified. (Early 2026 Data). https://arxiv.org/search/?query=autogen+benchmark+2026

- Community Discussion: AutoGen Best Practices for Chinese LLMs (Zhihu & WeChat Tech Accounts). (March 2026). https://zhuanlan.zhihu.com/p/autogen-guide-2026

相关推荐

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析

- 神经网络是什么:2026 原理、演进与前沿应用全面解析