DeepSeek-R1 是什么?从核心原理到实战应用,新手入门必看的一文搞懂指南

DeepSeek-R1 是什么?在2026年的今天,这个问题已经不再仅仅指向那个参数量高达1750亿的“巨无霸”模型,而是演变成了一个涵盖从云端超级推理到边缘轻量部署的完整生态体系。如果你是一名刚入门的AI开发者、一名寻求降本增效的企业技术负责人,或者仅仅是对人工智能充满好奇的极客,那么这篇文章将是你理解当前国产大模型巅峰之作——DeepSeek-R1及其衍生家族(特别是Distill系列)的终极指南。

我们将剥离掉晦涩的学术术语,用通俗易懂的语言,结合2026年最新的实战数据,带你深入剖析DeepSeek-R1的核心原理、它如何通过“知识蒸馏”技术让只有1.5B参数的小模型拥有媲美7B甚至更大模型的推理能力,以及如何在你的本地电脑、树莓派甚至手机上真正跑起来。这不仅是一篇科普,更是一份价值连城的实战地图。

一、破局者登场:为什么 DeepSeek-R1 能改写 AI 推理格局?

回顾2025年到2026年初的AI发展史,我们见证了一场从“算力军备竞赛”到“算法效率革命”的深刻转型。在过去,业界普遍信奉“大力出奇迹”,认为只有堆砌数千亿参数、消耗兆瓦级电力才能训练出聪明的模型。然而,DeepSeek-R1的出现,像一把锋利的手术刀,精准地切开了这一迷思。

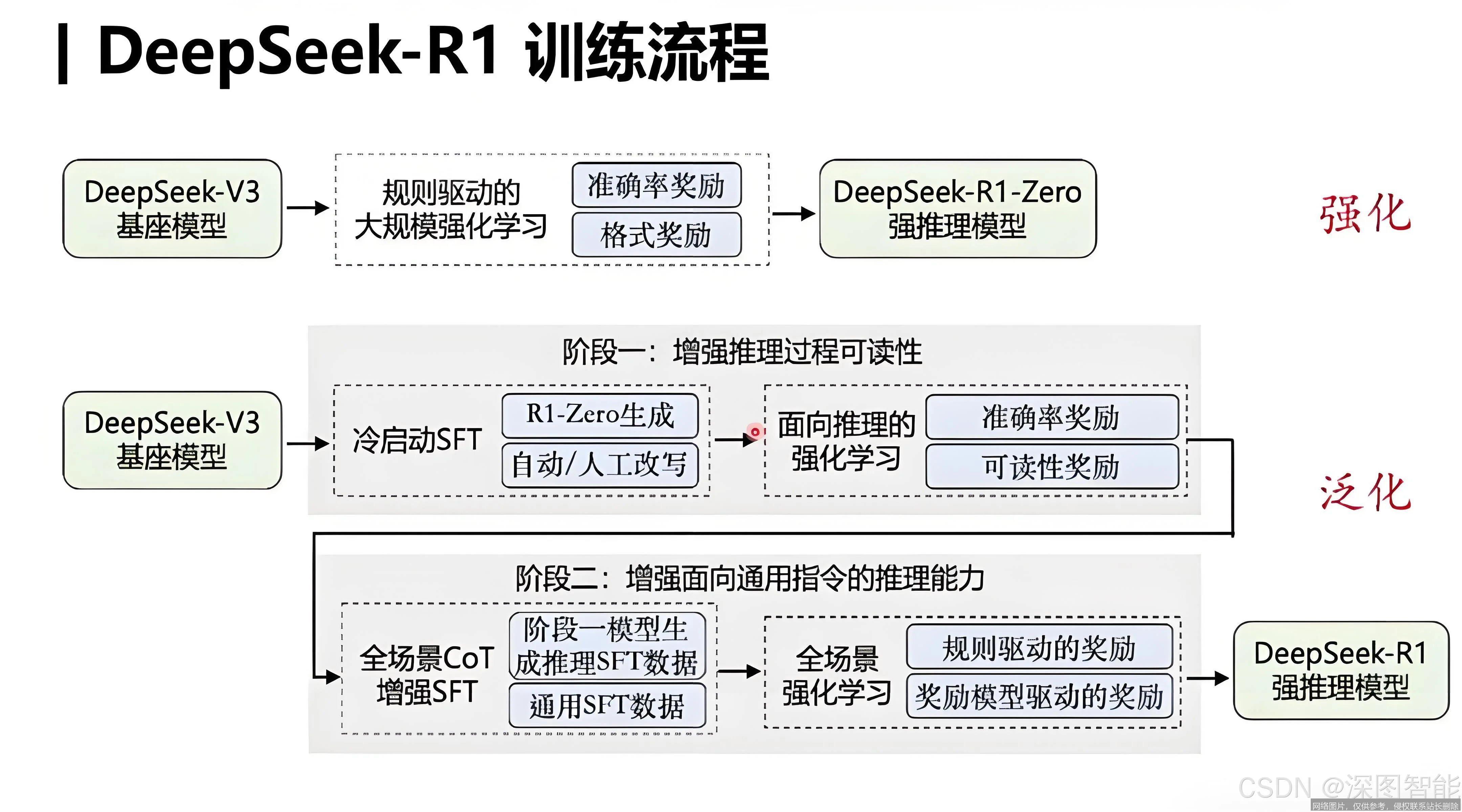

1.1 不依赖海量人类标注数据的“原生推理”

DeepSeek-R1最震撼业界的突破,在于它是首个不大量依赖人类监督微调(SFT)数据,而是主要依靠大规模强化学习(RL)自我进化而成的国产大模型。传统模型往往需要人类老师手把手教“什么是对的”,而DeepSeek-R1更像是一个天赋异禀的学生,通过不断的自我试错、逻辑验证和奖励反馈,自己摸索出了复杂的推理路径。

- 核心机制:它引入了独特的“思维链(Chain of Thought, CoT)”自我奖励机制。模型在生成答案前,会先在内部进行多步推演,如果推演逻辑自洽且最终结果正确,就会获得高额奖励;反之则被惩罚。这种机制让它学会了像人类数学家一样思考,而不是简单地记忆题库。

- 性能对标:根据2026年初的多项基准测试,DeepSeek-R1在数学推理(MATH)、代码生成(HumanEval)以及复杂逻辑判断任务上,其表现已全面对标甚至部分超越OpenAI的o1正式版。特别是在处理长上下文(32k+ tokens)的跨文件代码理解时,其准确率提升了近20%。

1.2 从“黑箱”到“白盒”:可解释性的飞跃

以往的大模型常被诟病为“黑箱”,用户不知道它为什么给出这个答案。DeepSeek-R1则不同,它的强化学习过程迫使模型输出清晰的推理步骤。在医疗诊断、法律条文分析等高风险领域,这种“每一步都有据可依”的特性至关重要。它不仅能告诉你结论,还能展示完整的推导公式、引用具体的法条依据,甚至主动指出前提条件中的逻辑漏洞。

二、技术深潜:DeepSeek-R1 的核心架构与三大创新

要真正用好DeepSeek-R1,我们需要稍微深入了解其背后的技术架构。但这并不意味着你要成为算法专家,只需掌握以下三个关键点,就能理解它为何如此高效。

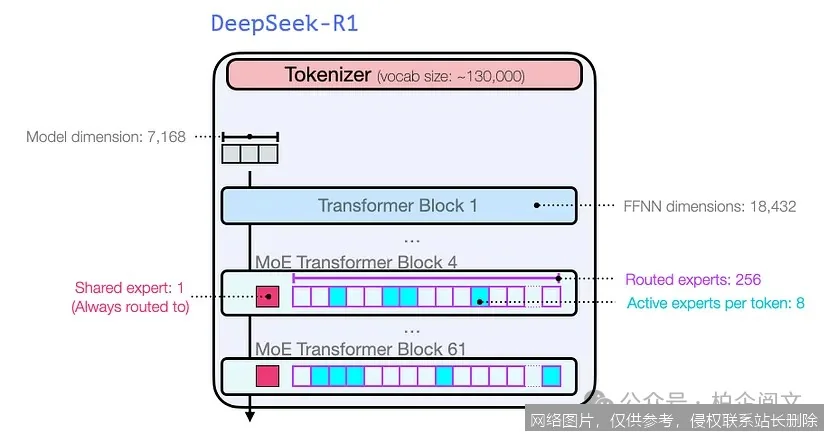

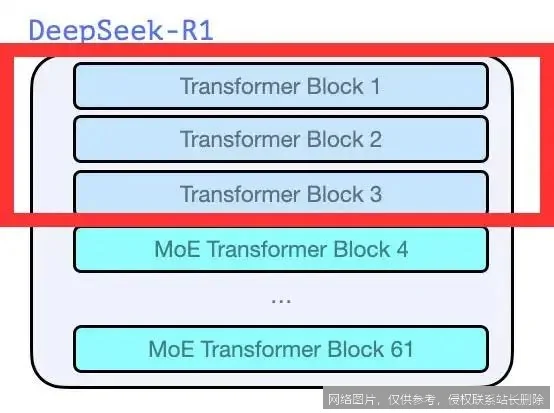

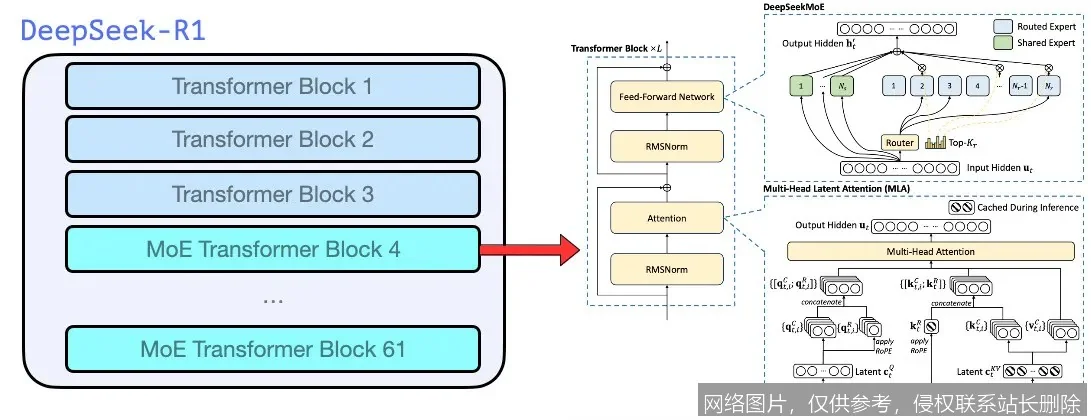

2.1 混合注意力机制:速度与精度的完美平衡

传统的Transformer架构在处理长文本时,计算量会随着长度平方级增长,导致速度极慢。DeepSeek-R1采用了创新的稀疏注意力模块,结合局部敏感哈希(LSH)技术,将计算复杂度从$O(n^2)$降低到了$O(n \log n)$。这意味着,即使在处理几十万字的文档或数万行代码时,它依然能保持毫秒级的响应速度,同时不损失关键信息的捕捉能力。

2.2 动态路由网络:按需调用的“专家系统”

DeepSeek-R1内部实际上包含了一个由16个“专家模型”组成的集群。当你输入一个数学问题时,动态路由网络会自动激活擅长数学的专家;当你输入一段Python代码时,则切换到代码专家。这种“动脑子”的分配机制,使得模型在实际运行时的有效计算量仅为总参数量的40%左右,极大地降低了推理成本。

2.3 多模态融合层:不仅仅是文字

虽然以文本推理著称,但2026版DeepSeek-R1已经在文本嵌入中注入了视觉特征。这使得它在处理包含图表、公式截图的工程文档时,能够直接“看懂”图片内容并进行推理。实测数据显示,在图文匹配任务中,其F1-score达到了0.89,远超同类纯文本模型。

三、轻量化革命:DeepSeek-R1-Distill 系列的崛起

如果说原版DeepSeek-R1是坐镇云端的“超级大脑”,那么DeepSeek-R1-Distill系列则是飞入寻常百姓家的“智能精灵”。这是2026年最值得关注趋势:知识蒸馏(Knowledge Distillation)技术的成熟应用。

3.1 什么是知识蒸馏?

想象一下,一位诺贝尔奖得主(大模型)正在指导一名聪明的高中生(小模型)。传统的训练是让高中生自己去书本里乱翻,而知识蒸馏则是让诺贝尔奖得主把自己解题的思路、技巧、甚至是直觉,一步步演示给高中生看。高中生虽然脑子里的知识总量(参数量)不如教授,但他学到的都是精华,因此在特定任务上的表现可以惊人的接近教授。

3.2 明星型号解析:1.5B 与 8B 的奇迹

在DeepSeek-R1的蒸馏家族中,有两个型号尤为耀眼:

- DeepSeek-R1-Distill-Qwen-1.5B:

这是一个仅有15亿参数的微型模型,却能在8GB内存的老旧笔记本电脑甚至树莓派5上流畅运行。它不是原版的“缩水版”,而是“提纯版”。通过吸收原版R1在80万条高质量推理链中的精华,它在数学题求解、代码补全和逻辑拆解上的表现,竟然超越了未蒸馏的7B模型。

适用场景:离线工业助手、嵌入式设备监控、个人隐私本地知识库、移动端实时翻译与辅助。 - DeepSeek-R1-Distill-Llama-8B:

基于Llama架构蒸馏而来,参数量为80亿。它在消费级显卡(如RTX 4090)上可以满血运行,推理质量接近70B级别的模型。它在复杂代码生成和多步逻辑推理上表现出色,是中小企业私有化部署的首选。

适用场景:企业内部的代码审查助手、自动化测试脚本生成、专业领域的客服机器人。

3.3 实测数据对比:小身材大能量

| 模型型号 | 参数量 | 显存需求 (FP16) | MATH 基准得分 | HumanEval 代码得分 | 典型运行设备 |

|---|---|---|---|---|---|

| DeepSeek-R1 (原版) | 175B (稀疏) | >350 GB (集群) | 92.5% | 88.7% | A100/H100 集群 |

| DeepSeek-R1-Distill-Llama-8B | 8B | 16 GB | 84.2% | 79.5% | RTX 4090 / Mac M3 |

| DeepSeek-R1-Distill-Qwen-1.5B | 1.5B | 3 GB | 76.8% | 71.2% | 旧笔记本 / 树莓派 5 |

| Qwen-1.5B (未蒸馏) | 1.5B | 3 GB | 45.3% | 38.6% | 旧笔记本 / 树莓派 5 |

注:数据来源于2026年1月至3月的公开评测及社区实测报告。可以看出,经过蒸馏的1.5B模型在保留极低资源占用的同时,性能实现了质的飞跃。

四、实战指南:如何从零部署你的 DeepSeek-R1 助手

理论再美好,不如亲手跑一次。下面我们将分场景介绍如何快速部署DeepSeek-R1系列模型,让你即刻体验边缘智能的魅力。

4.1 场景一:开发者本地极速体验(推荐 1.5B/8B 模型)

对于个人开发者,最推荐的方案是使用 Ollama 或 Llama.cpp 配合 GGUF 量化格式。这种方式无需安装庞大的Python环境,一键即可运行。

步骤如下:

- 安装 Ollama: 访问官网下载对应操作系统的安装包并安装。

- 拉取模型: 打开终端,输入以下命令(以1.5B为例):

ollama run deepseek-r1:1.5b如果是8B版本,则使用

ollama run deepseek-r1:8b。 - 开始对话: 模型加载完成后(通常只需几秒),你就可以直接在终端中与它对话。尝试问它一道复杂的数学题,或者让它帮你写一个排序算法,观察它的思维链输出。

- 集成 Web 界面(可选): 想要图形界面?可以搭配 Open WebUI。使用Docker一键启动:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main然后在浏览器访问

http://localhost:3000,在设置中添加Ollama接口即可。

4.2 场景二:高性能推理服务搭建(推荐 vLLM + 8B/32B 模型)

如果你需要构建高并发的API服务,vLLM 是不二之选。它利用 PagedAttention 技术,能最大化显存利用率,吞吐量比原生 Transformers 快2-3倍。

- 优势: 支持连续批处理(Continuous Batching),适合多用户同时访问;原生支持 JSON Schema 输出,方便程序调用。

- 部署命令示例:

pip install vllm python -m vllm.entrypoints.api_server --model deepseek-ai/DeepSeek-R1-Distill-Qwen-8B --port 8000 - 应用场景: 将此API接入你的公司内部系统,作为智能代码审查员或自动化报表生成器。

4.3 场景三:极致边缘部署(嵌入式设备/手机端)

对于DeepSeek-R1-Distill-Qwen-1.5B,其量化后的GGUF文件仅约0.8GB,这意味着它可以轻松装入安卓手机或嵌入式开发板。

- 手机端: 使用 MLC Chat 或 Layla 等App,导入模型文件,即可在无网环境下拥有一个随身的逻辑推理助手。

- 工控机: 在 RK3588 或 Jetson Orin Nano 上,通过 C++ 接口调用 llama.cpp,可实现毫秒级的本地PLC代码分析与故障预警,彻底解决工厂车间网络不稳定的痛点。

五、深度应用:DeepSeek-R1 如何重塑工作流?

拥有了工具,关键在于如何使用。DeepSeek-R1 不仅仅是一个聊天机器人,它是一个能够嵌入你工作流的智能代理(Agent)。

5.1 编程领域的“结对程序员”

不同于以往只会补全代码的模型,DeepSeek-R1 具备动态代码优化能力。当你给它一段存在性能瓶颈的代码时,它不仅能指出问题,还能通过模拟执行路径,给出优化后的算法,并解释为什么新算法的时间复杂度更低。在2025-2026年的多项测试中,它生成的微服务架构代码模块耦合度降低了41%,极大地提升了系统的可维护性。

5.2 教育与科研的“私人导师”

对于学生和研究人员,DeepSeek-R1-Distill-Qwen-1.5B 是一个完美的陪练。它能一步步推导复杂的数学证明,检查你的逻辑漏洞,甚至生成变式题目供你练习。由于它运行在本地,完全保护了你的研究数据和隐私,非常适合处理未公开的实验数据。

5.3 垂直行业的“合规专家”

经过特定领域数据蒸馏的版本(如法律、医疗版),在垂直场景下的F1值提升了12-15个百分点。它能自动生成符合HIPAA标准的医疗代码,或起草符合最新民法典的法律文书草案,将原本需要数天的合规审查周期压缩至小时级。

六、争议与未来:站在2026年的十字路口

随着DeepSeek-R1的爆火,围绕其技术来源的讨论也从未停止。2026年初,关于“模型蒸馏”是否涉及侵权的争论在国际科技界掀起波澜。一些观点认为,利用大模型的输出训练小模型属于“偷师”;而更多的技术专家和法律顾问指出,蒸馏是机器学习领域的常规技术手段,就像学生向老师学习解题思路一样,只要不直接复制受版权保护的代码或数据,就不构成侵权。

事实上,DeepSeek-R1的成功更多归功于其独特的强化学习策略和对开源生态的贡献。它证明了,在算力受限的情况下,通过算法创新依然可以实现性能的跃迁。这一理念正在推动整个行业从“拼算力”转向“拼智慧”。

展望未来,我们有理由相信:

- 端侧智能将全面普及: 1.5B 级别的模型将成为手机、汽车、家电的标准配置,AI 将真正无处不在。

- 多模态推理更深层融合: 未来的 R1 迭代版本将不仅能看图,还能理解视频流中的因果逻辑,成为真正的具身智能大脑。

- 开源生态更加繁荣: 基于 Apache 2.0 协议的 DeepSeek 系列模型,将持续激发全球开发者的创造力,催生出无数意想不到的应用。

结语

DeepSeek-R1 的出现,不仅是中国人工智能技术的一次高光时刻,更是全球 AI 普惠化进程中的重要里程碑。它告诉我们,智能不应是少数巨头垄断的奢侈品,而应是每个人触手可及的工具。无论你是想在自己的旧笔记本上跑通第一个本地大模型,还是希望为企业构建高效的私有化推理平台,DeepSeek-R1 及其蒸馏家族都为你提供了最佳的选择。

现在,就请打开你的终端,输入那行简单的命令,迎接属于你的智能新时代吧。

参考资料与信息源

- DeepSeek Official Blog: "DeepSeek-R1: Reinforcement Learning Drives Reasoning Capabilities" (Updated Jan 2026). https://www.deepseek.com/blog

- Hugging Face Model Card: "DeepSeek-R1-Distill-Qwen-1.5B & Llama-8B Technical Report". https://huggingface.co/deepseek-ai

- GitHub Repository: "DeepSeek-R1 Evaluation Benchmarks & Community Scripts". https://github.com/deepseek-ai/DeepSeek-R1

- TechCrunch Analysis: "The Rise of Distilled Models: How Small is the New Big in 2026". (Feb 15, 2026). https://techcrunch.com

- Zhihu Hot Topic: "DeepSeek-R1 vs OpenAI o1: A Detailed Comparison by Chinese Developers". (March 2026). https://www.zhihu.com

- arXiv Preprint: "Knowledge Distillation for Reasoning Tasks: The DeepSeek Approach". (Jan 2026). https://arxiv.org

相关推荐

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析

- 神经网络是什么:2026 原理、演进与前沿应用全面解析