【AI词典】vLLM - 大语言模型高效推理系统

AI词典2026-04-27 03:12:00

vLLM 定义

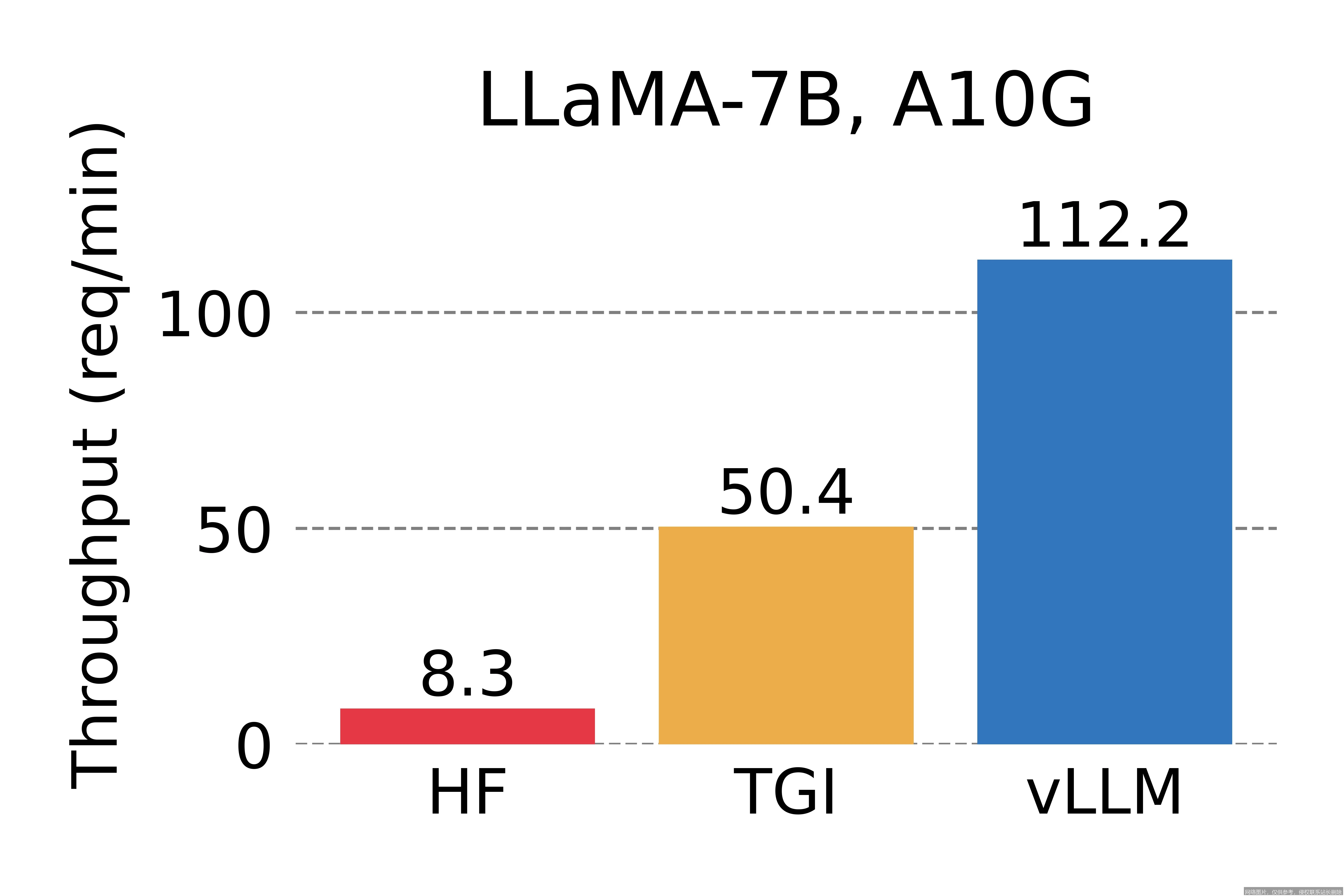

vLLM 是一个专为大规模语言模型设计的高吞吐量、低延迟推理和服务引擎,其核心创新在于引入了 PagedAttention 注意力算法,通过高效管理注意力计算中的键值缓存,显著提升了 GPU 内存利用率与推理速度。

vLLM 的工作原理

传统的大语言模型推理在服务多个请求或生成长文本时,需要为每个序列在 GPU 显存中预先分配固定大小的键值缓存空间。这类似于在酒店为每位客人预留一个固定的大套房,即使客人只住一晚,房间也被完全占用,导致显存利用率低下,限制了同时服务的请求数量(即吞吐量)。

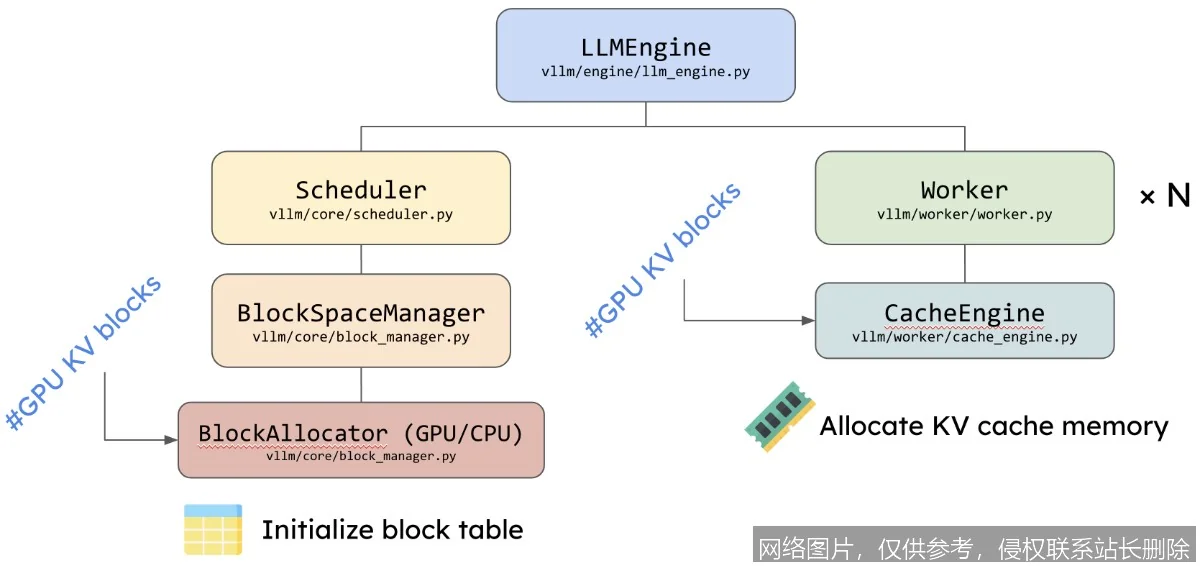

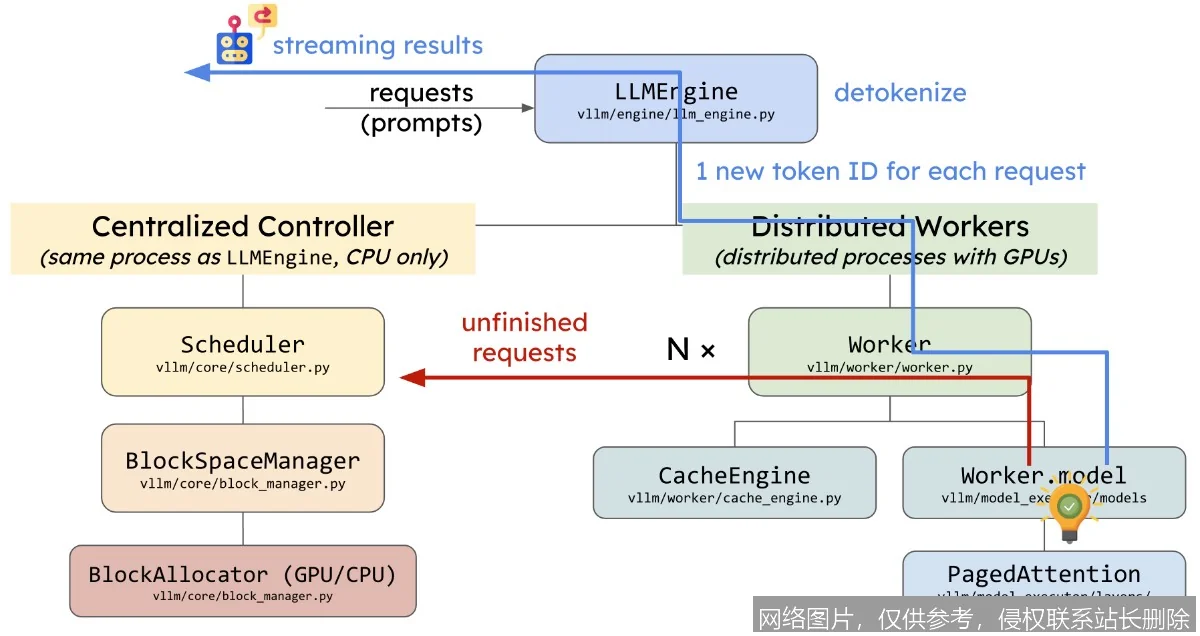

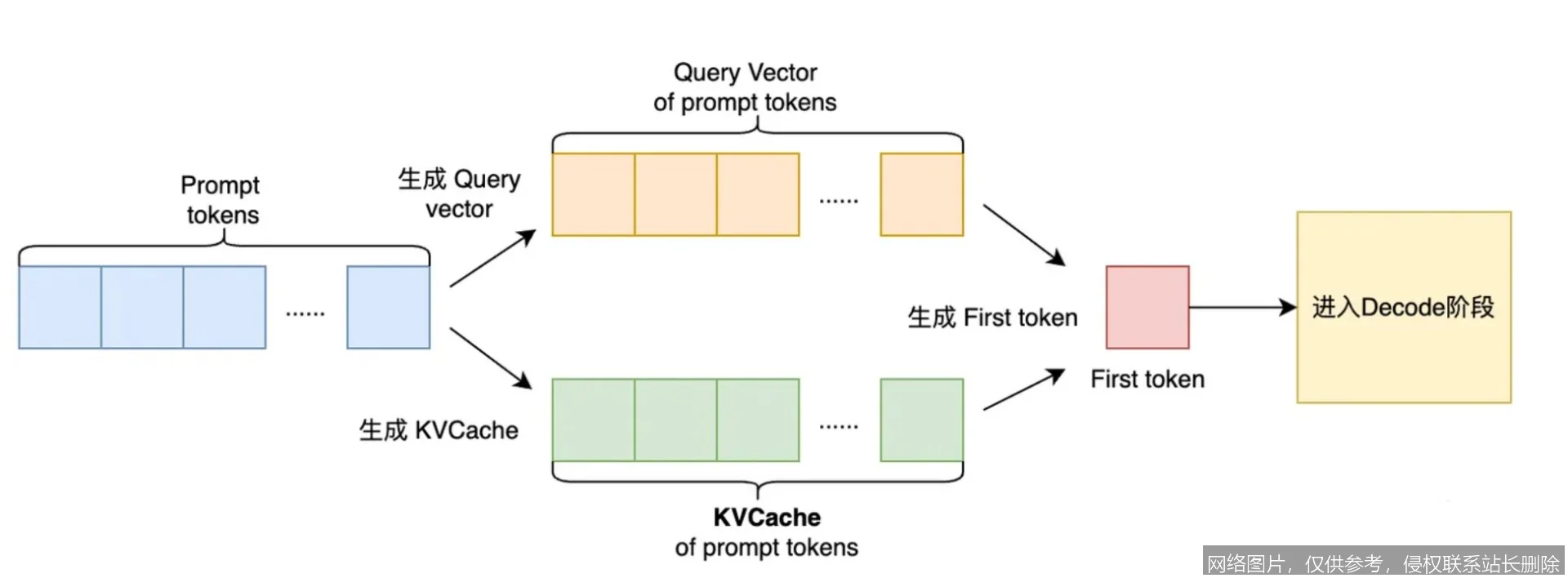

vLLM 提出的 PagedAttention 算法巧妙地解决了这一问题。它将每个序列的键值缓存分割成更小的“块”(blocks),并像计算机操作系统管理物理内存一样,以“页”为单位进行灵活管理。系统维护一个全局的物理块池,仅为序列实际使用的部分分配块。当一个序列生成新令牌时,它只需按需从池中获取新的块,而无需预先占据连续的大块空间。这种机制不仅消除了内存浪费,还允许高效的内存共享(例如,在并行采样时共享提示词的缓存),从而在同等硬件条件下,将吞吐量提升数倍。

vLLM 的应用场景

- 大规模在线推理服务:适用于需要同时处理成千上万个用户查询的 AI 应用后端,如聊天机器人、写作助手等。vLLM 的高吞吐量特性能够有效降低服务成本,提升用户体验。

- 批量内容生成与数据标注:在需要调用大模型批量生成文案、代码或进行数据标注与增强的任务中,vLLM 可以更快地处理海量请求,加速工作流程。

- 模型研究与评估:研究人员在对比不同模型或进行超参数搜索时,可以利用 vLLM 快速获得模型在标准基准测试集上的推理结果,极大提高实验效率。

相关术语

大语言模型、

推理优化、

注意力机制、

Transformer 架构、

吞吐量、

键值缓存、

连续批处理

延伸阅读

若想深入了解 vLLM 的技术细节,建议阅读其原始论文《Efficient Memory Management for Large Language Model Serving with PagedAttention》。此外,可以访问其开源 GitHub 仓库,通过实际部署和测试来掌握其配置与优化技巧。对于希望理解其底层内存管理思想的读者,可以复习计算机操作系统中的“虚拟内存”与“分页”机制,这有助于理解 PagedAttention 的类比与创新之处。