【AI词典】CUDA - NVIDIA推出的并行计算平台与编程模型

AI词典2026-04-26 20:12:00

CUDA:定义

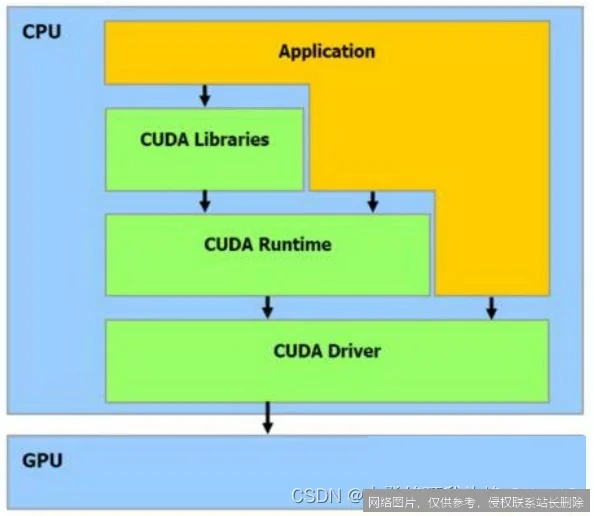

CUDA(Compute Unified Device Architecture)是NVIDIA公司专为其图形处理器(GPU)设计的并行计算平台与编程模型,它使开发者能够利用GPU的众多核心进行通用目的的高性能计算。

CUDA的工作原理

理解CUDA工作原理的一个有效类比是“大规模协同工作”。传统的CPU像一个学识渊博、逻辑严密的博士,擅长处理复杂但顺序的任务。而GPU则像一支由成千上万名训练有素的工人组成的队伍,每个工人(即一个CUDA核心)能力相对简单,但胜在数量庞大且能同时行动。CUDA平台的作用,就是为这位“博士”(CPU)提供一套指挥和调度这支“工人军团”(GPU)的完整工具和语言。开发者通过编写特殊的CUDA C/C++代码,将大规模、可分解的计算任务(如矩阵运算、图像像素处理)定义成成千上万个并行执行的“线程”。这些线程被高效地组织并映射到GPU的物理核心上,从而实现远超CPU的并行计算吞吐量。

CUDA的应用场景

CUDA彻底释放了GPU在非图形领域的潜力,其应用已渗透到多个前沿科技领域:

- 人工智能与深度学习: 这是CUDA目前最核心的应用领域。深度神经网络的训练和推理涉及海量的矩阵乘法和卷积运算,这些操作天然适合GPU的并行架构。主流深度学习框架(如TensorFlow、PyTorch)其底层计算都深度依赖CUDA进行加速,使得训练大型模型从数月缩短至数天。

- 科学计算与模拟: 在气候建模、流体动力学、分子动力学等领域,研究人员需要处理极其复杂的数学模型和庞大的数据集。CUDA使得在单台工作站或服务器上进行高精度的实时模拟成为可能,极大地推动了科研进展。

- 专业视觉计算: 在电影渲染、工业设计、医疗影像分析等领域,CUDA不仅加速了最终画面的渲染(光线追踪),更在中间处理环节(如特效模拟、三维重建、影像分割)提供强大算力,显著提升了工作效率和质量。

相关术语

要深入理解CUDA,可以关联以下概念:GPU(图形处理器)、并行计算、张量核心、cuDNN、OpenCL以及异构计算。

延伸阅读

若希望系统学习CUDA编程,建议从NVIDIA官方开发者网站的文档和教程开始,其提供的《CUDA C++ Programming Guide》是权威的参考手册。此外,许多在线课程平台(如Coursera, Udacity)也提供了从入门到精通的实践课程,结合动手项目能更快掌握这一关键技术。