自注意力机制:让AI学会“抓重点”的核心魔法

自注意力机制:AI理解世界的“高亮笔”

在人工智能,尤其是自然语言处理领域,模型如何理解一句话中不同词语的重要性?如何把握“我昨天在公园看到了一只非常可爱的猫”这句话的核心是“猫”和“可爱”,而不是“昨天”或“公园”?这背后的核心魔法,便是自注意力机制。它如同一位聪明的读者,能够边阅读边为文本中的每个部分动态分配注意力权重,从而让AI学会“抓重点”。

从“注意力”到“自注意力”的进化

在自注意力机制诞生之前,循环神经网络(RNN)及其变体是处理序列数据的主流。但RNN存在一个瓶颈:它需要按顺序处理信息,难以捕捉长距离的依赖关系,且计算效率低下。后来,研究者借鉴了人类视觉的“注意力”思想,让模型在解码时能够“回头看”编码器的所有部分,这就是最初的注意力机制。

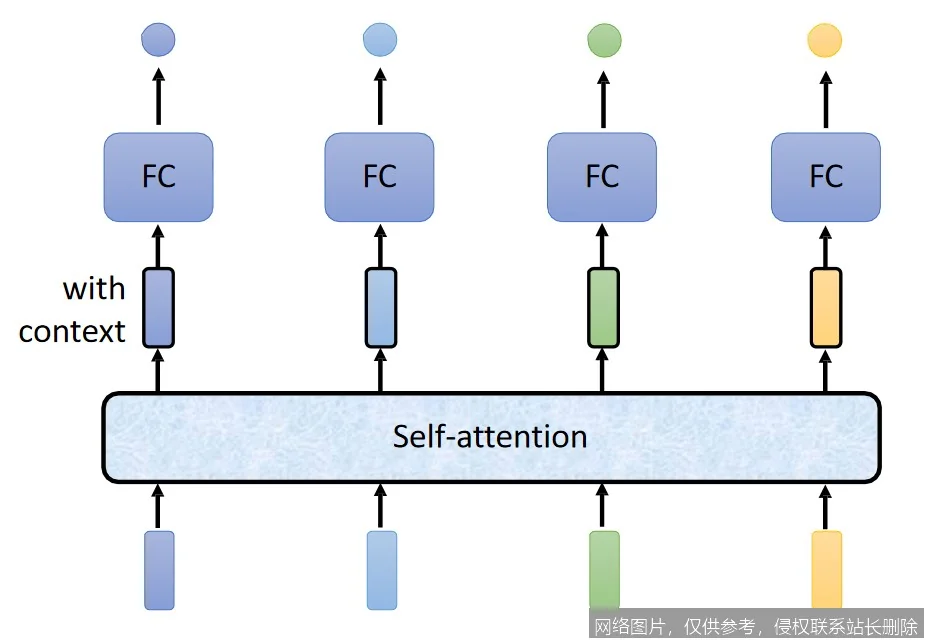

而自注意力机制则更进一步。它不再区分编码器和解码器,而是让序列中的每一个元素(如句子中的每个词)都去审视序列中的所有其他元素(包括自己),通过计算彼此之间的关联度,来确定在特定任务中谁更重要。简单来说,它让模型在内部进行了一次“信息交流大会”,每个词都通过与其他词的互动重新定义了自身的价值。

自注意力是如何运作的?

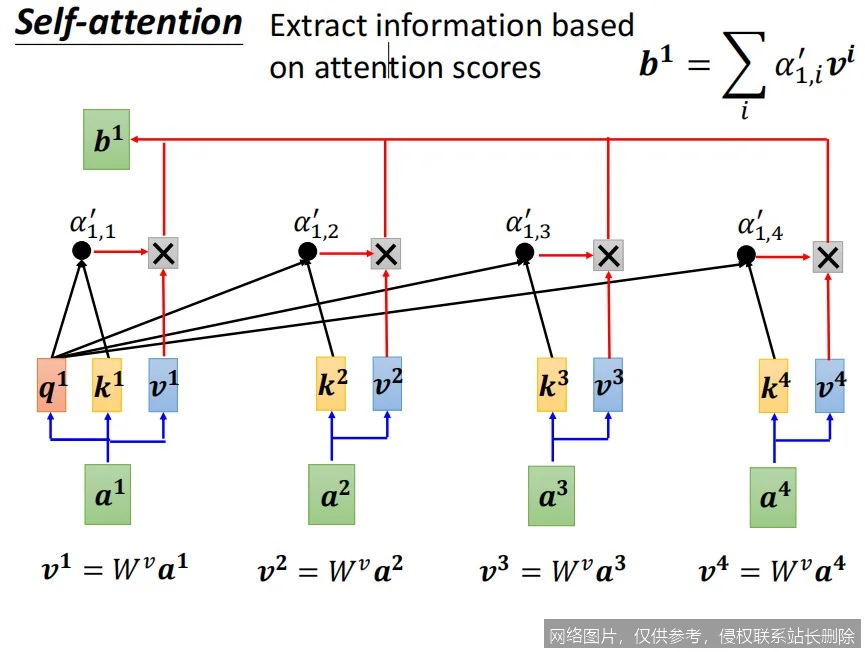

自注意力机制的核心计算过程可以简化为三个关键步骤,对应三个向量:查询(Query)、键(Key)和值(Value)。

- 生成向量:对于输入序列中的每个词,我们将其转换为三个不同的向量:Q(询问“我需要什么”)、K(声明“我有什么特征”)、V(承载“我的实际信息”)。

- 计算注意力分数:通过计算一个词的Q与序列中所有词的K的点积,得到一组分数。分数越高,表示这两个词在当前任务中的关联性越强。

- 加权求和输出:将这些分数归一化(通常使用Softmax),得到一组权重,然后用这组权重对所有的V向量进行加权求和。最终,每个词都会输出一个融合了全局上下文信息的新表示。

这个过程允许模型在处理“银行”这个词时,能根据上下文是“河流”还是“存款”,动态地关注不同的信息,从而消除歧义。

为何它是Transformer与GPT的基石?

自注意力机制是革命性模型Transformer的绝对核心,而后者正是当今如GPT、BERT等大语言模型的架构基础。它的优势是颠覆性的:

- 强大的长程依赖捕捉能力:无论两个词在序列中相隔多远,它们之间的关联都可以被直接计算,彻底解决了RNN的长距离遗忘问题。

- 极高的并行计算效率:序列中所有词对的注意力计算可以同时进行,这极大地利用了现代GPU的并行能力,使得训练超大规模模型成为可能。

- 卓越的模型表达能力:通过多头自注意力(Multi-Head Attention),模型可以在不同的表示子空间中并行学习多种复杂的依赖关系,例如语法结构和语义关联。

超越文本:自注意力的广阔天地

虽然因自然语言处理而闻名,但自注意力机制的应用早已超越了文本范畴。在计算机视觉中,Vision Transformer将其应用于图像块,取得了媲美甚至超越卷积神经网络的成绩。在语音识别、蛋白质结构预测、推荐系统等领域,自注意力机制都展现出了其作为通用关系建模工具的强大潜力。它本质上提供了一种数据内部元素间动态、灵活的关系建模范式。

结语

自注意力机制,这个让AI学会“抓重点”的核心魔法,不仅彻底改变了深度学习处理序列数据的方式,更催生了当前人工智能的繁荣浪潮。它赋予了模型一种类似“上下文感知”和“全局思考”的能力,是机器向更深刻理解迈出的关键一步。随着研究的深入,这一机制将继续作为核心驱动力,引领AI探索更智能的未来。

相关推荐

- 预训练是什么:2026 大模型基石原理、技术演进与实战应用全面解析

- 什么是知识库?2026 年最新定义、技术原理与实战应用全面解析

- 语义搜索是什么:2026 年原理、技术演进与全场景应用详解

- 什么是自监督学习?2026 原理、应用与实战全面解析

- ONNX 是什么:2026 跨框架模型标准详解,从原理到实战应用

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析

- Agent 协作是什么:从多智能体原理到 2026 企业实战全面解析

- GPU 是什么全面解析:从图形渲染原理到 2026 年智算中心实战应用