多模态模型:当AI学会“眼观六路,耳听八方”

多模态模型:当AI学会“眼观六路,耳听八方”

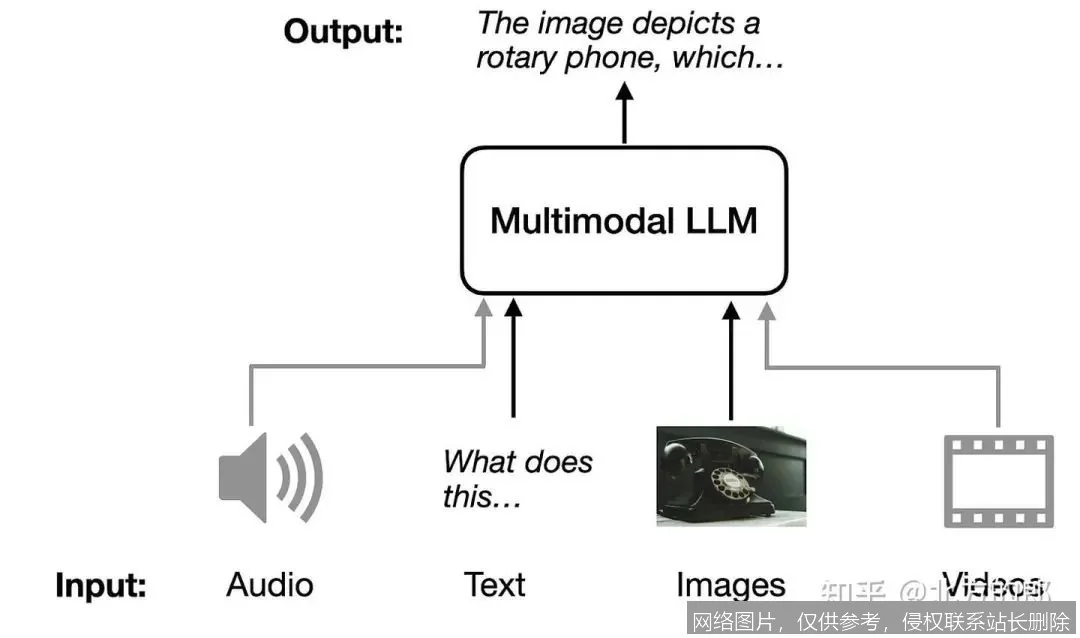

在人工智能的演进历程中,我们正见证一场深刻的范式转变。过去,AI往往是“偏科生”——图像识别模型看不懂文字,语音助手理解不了图片。而如今,一种能够整合并理解多种信息类型的AI正在崛起,它就是多模态模型。顾名思义,这类模型能够同时处理和理解文本、图像、音频、视频等多种模态的数据,真正让AI具备了“眼观六路,耳听八方”的综合性智能。

从单一感知到融合理解

传统的AI模型通常是单模态的,其设计目标专注于单一类型的数据。例如,卷积神经网络(CNN)精于图像,循环神经网络(RNN)擅长序列文本。然而,现实世界的信息天然是多模态的:一段视频包含画面、声音和字幕;一次对话涉及语音语调、面部表情和语言内容。单模态AI如同只拥有一种感官,难以形成对世界的完整认知。

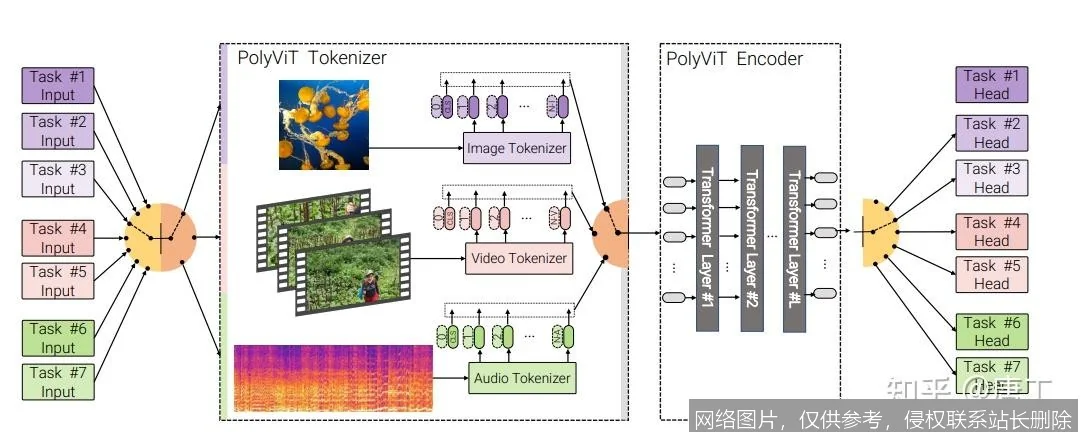

多模态模型的核心突破在于,它通过统一的架构或巧妙的对齐技术,将不同模态的信息映射到一个共同的语义空间中。这意味着,模型能够理解“猫”这个文字概念、一张猫的图片、一声猫叫,甚至一段关于猫的视频,在本质上是相关联的。这种跨模态的理解能力,是通向更通用人工智能的关键一步。

技术核心与应用场景

实现多模态智能并非易事,其背后依赖几项关键技术:

- 跨模态对齐:例如,通过海量的“图片-描述”对数据,让模型学会视觉特征与文本标签之间的对应关系。

- 统一表征学习:将不同模态的数据编码成同一空间下的向量,使语义相似的输入(无论何种模态)在向量空间中也彼此接近。

- 多模态融合与推理:综合多种模态的信息进行决策,例如结合医疗影像和病历文本来辅助诊断。

这些技术正催生出令人惊叹的应用:

- 智能内容创作:用户输入一段文字描述,AI即可生成匹配的图片、视频或音乐。

- 无障碍技术:为视障人士实时描述周围场景,或将语音实时转换为手语动画。

- 沉浸式教育:AI家教能同时“看”学生解题的步骤、“听”其提出的疑问,并提供图文并茂的个性化讲解。

- 高级人机交互:机器人不仅能听懂指令,还能通过视觉观察环境、理解人的手势和表情,做出更自然的回应。

挑战与未来展望

尽管前景广阔,多模态模型的发展仍面临诸多挑战。首先,它对数据和算力的需求极为庞大,训练成本高昂。其次,如何确保模型的理解是真正深刻而非表面的关联,避免产生荒谬的“幻觉”输出,是可靠性的关键。此外,跨模态的因果推理、对复杂场景的细粒度理解,仍是待攻克的难题。

展望未来,多模态AI将朝着更高效、更可靠、更人性化的方向演进。它有望成为我们强大的数字伙伴,深度融入科研、创作、医疗、娱乐等各个领域。从“单科状元”到“全能通才”,多模态模型正在重新定义AI的能力边界,带领我们迈向一个机器能更自然、更全面地理解人类和世界的智能新时代。

相关推荐

- KLING AI(可灵)详解:3.0 模型原理、智能分镜与影视级应用实战

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析