RAG检索增强生成:打破信息孤岛,让AI回答更精准可靠

RAG检索增强生成:打破信息孤岛,让AI回答更精准可靠

在人工智能浪潮席卷全球的今天,大型语言模型(LLM)展现出了令人惊叹的文本生成与理解能力。然而,一个普遍的痛点也随之浮现:模型可能会生成看似合理但实则错误的“幻觉”信息,或者其知识受限于训练数据截止日期,无法提供最新的答案。如何让AI的回答既富有创造力,又精准、可靠、有时效性?RAG检索增强生成技术应运而生,成为解决这一难题的关键钥匙。

什么是RAG?连接生成与检索的桥梁

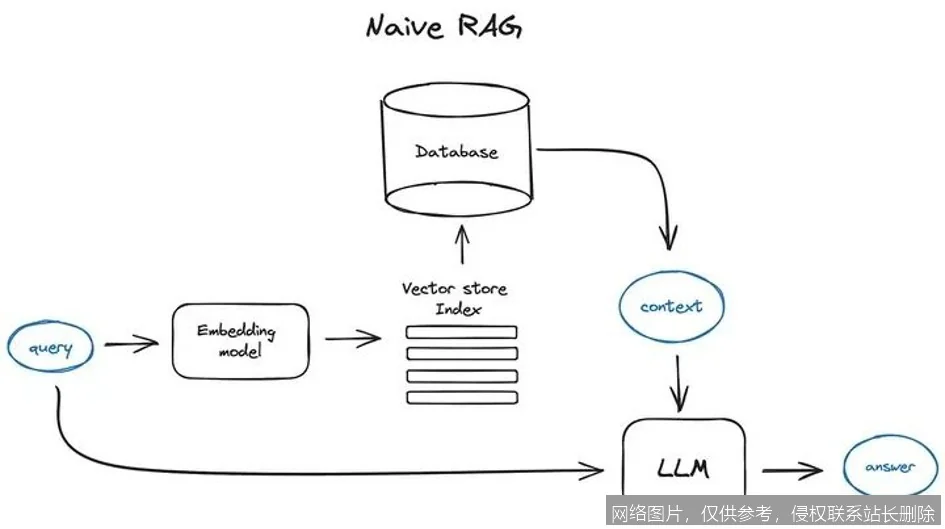

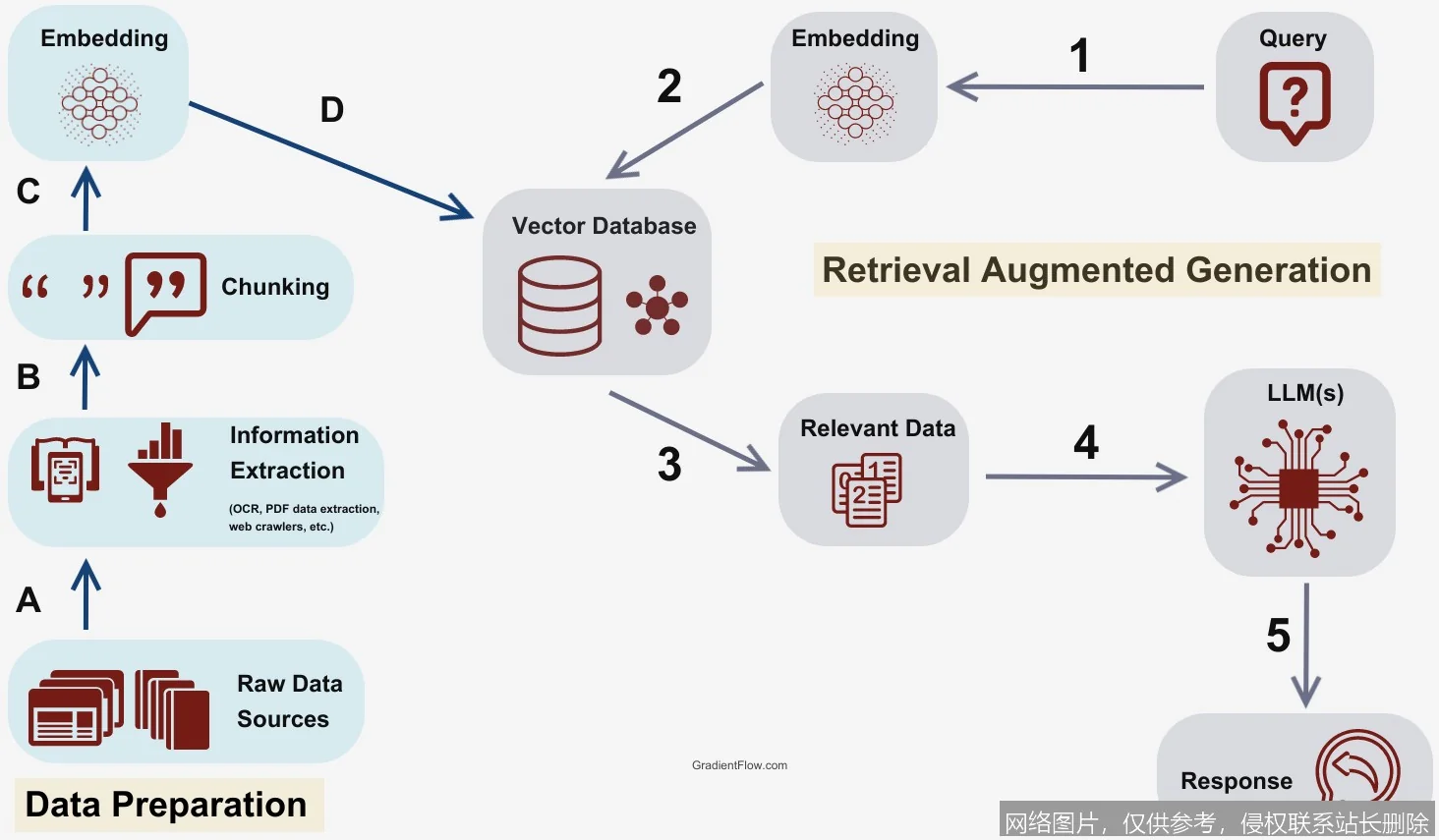

RAG(Retrieval-Augmented Generation,检索增强生成)并非一个单一的模型,而是一种创新的框架范式。它将信息检索系统与大型语言模型的生成能力巧妙地结合起来。简单来说,RAG的工作流程分为两个核心步骤:

- 检索(Retrieval):当用户提出一个问题时,RAG首先会从外部知识库(如企业文档、数据库、最新研究报告、网页等)中检索与问题最相关的文档或信息片段。

- 增强生成(Augmented Generation):随后,它将检索到的这些精准、可靠的外部信息与用户的原始问题一起,作为“上下文”输入给大型语言模型。模型基于这些提供的证据进行综合、分析和生成,最终给出答案。

这个过程就像一位学者在撰写论文时,不是凭空想象,而是先去图书馆查阅大量权威资料,再基于这些资料进行论证和总结,从而保证了内容的准确性与深度。

RAG如何打破信息孤岛?

在企业和组织内部,大量有价值的知识往往散落在不同的系统和文档中,形成“信息孤岛”。传统的AI模型无法直接访问这些私有、动态更新的数据。RAG技术有效地解决了这一问题:

- 接入私有知识:企业可以将内部的技术手册、产品文档、会议纪要、客户服务记录等构建成专属知识库,RAG能从中实时检索信息,让AI的回答具备深厚的“企业记忆”。

- 获取最新信息:通过连接互联网或实时数据库,RAG可以为模型提供截止到“昨天”甚至“几分钟前”的信息,完美解决了模型知识陈旧的问题,使其能回答关于最新事件、股价、新闻等动态查询。

- 提升答案透明度与可信度:RAG生成的答案通常可以附带引用来源,用户可以追溯答案的依据,这极大地增强了AI系统的可信度和可解释性。

RAG带来的核心优势

相较于直接使用大型语言模型,采用RAG检索增强生成架构能带来多重显著优势:

1. 精准性与可靠性大幅提升:答案建立在检索到的真实证据之上,显著减少了模型“胡编乱造”的现象,输出结果更加准确、可靠。

2. 成本与效率更优:无需为了学习新知识而对庞大的基础模型进行全量微调(这通常成本极高)。只需更新检索库,即可让模型获得新能力,实现“知识”的轻量化迭代。

3. 安全与可控性增强:企业可以严格控制检索知识库的内容,确保AI的回答不涉及未经授权的敏感或有害信息,同时保护数据隐私。

4. 应用场景广泛:从智能客服、企业知识问答、学术研究辅助、到法律文件分析、医疗诊断支持,任何需要基于特定、准确信息进行对话和创作的场景,都是RAG的用武之地。

面临的挑战与未来展望

尽管前景广阔,RAG技术的成熟应用仍面临一些挑战,例如检索精度的高低直接影响最终答案的质量;复杂多跳问题的检索逻辑需要优化;以及如何高效处理海量非结构化数据等。

未来,随着向量数据库、更高效的检索算法以及多模态理解能力的进步,RAG检索增强生成技术将与大型语言模型更深度地融合。它不仅是提升AI回答质量的“增强外挂”,更将成为构建下一代可信、可控、知识渊博的智能系统的核心架构,真正让AI成为我们可靠的知识伙伴,释放信息世界的全部价值。

相关推荐

- KLING AI(可灵)详解:3.0 模型原理、智能分镜与影视级应用实战

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对

- ViT 是什么:从图像分块原理到 2026 年视觉语言应用全面解析

- 词向量是什么:从原理到 2026 实战应用全面解析

- 什么是 Sora?2026 版全面解析:从物理模拟原理到关停启示

- 什么是 Gemini CLI?2026 终端智能体原理、配置与实战全解析