什么是 LangChain?2026 最新定义、核心原理与 Agent 实战详解

一句话定义

LangChain 是一个用于开发由语言模型驱动的应用程序的开源框架,它通过标准化组件将大模型与外部数据、计算工具及记忆系统动态编排,实现从“静态问答”到“自主代理”的跨越。

技术原理:从“孤岛”到“生态”的架构革命

要真正理解 LangChain 的技术价值,我们首先需要回到大语言模型(LLM)诞生的初期。那时的模型更像是一个被封印在玻璃瓶中的天才:它博学多才,却与世隔绝。它不知道昨天的新闻,无法访问你公司的内部数据库,更不能帮你执行一段代码或发送一封邮件。这种局限性被称为“上下文封闭性”。LangChain 的出现,本质上是一场打破这种封闭性的架构革命。

核心工作机制:链式编排与动态路由

LangChain 的核心工作原理可以概括为两个关键词:链式编排(Chaining)与动态路由(Routing)。

在传统软件开发中,逻辑是硬编码的(Hard-coded),流程是线性的:如果 A 发生,则执行 B。而在 LangChain 构建的系统中,流程是动态的。框架充当了一个“智能指挥官”,它接收用户的自然语言输入,分析意图,然后决定调用哪个组件。这个过程通常遵循以下循环:

- 感知(Input):接收用户提示词(Prompt)。

- 规划(Planning):利用 LLM 的判断力,拆解任务步骤。例如,用户问“对比苹果和微软去年的股价”,模型不会直接瞎编,而是规划出“搜索苹果股价”、“搜索微软股价”、“进行对比计算”三个步骤。

- 行动(Action):调用外部工具(Tools),如搜索引擎、数据库查询接口或代码解释器。

- 观察(Observation):获取工具返回的结果。

- 综合(Synthesis):将原始问题与观察结果结合,生成最终回答。

这种机制使得应用程序不再依赖模型训练时的静态知识,而是具备了实时获取信息和执行操作的能力。

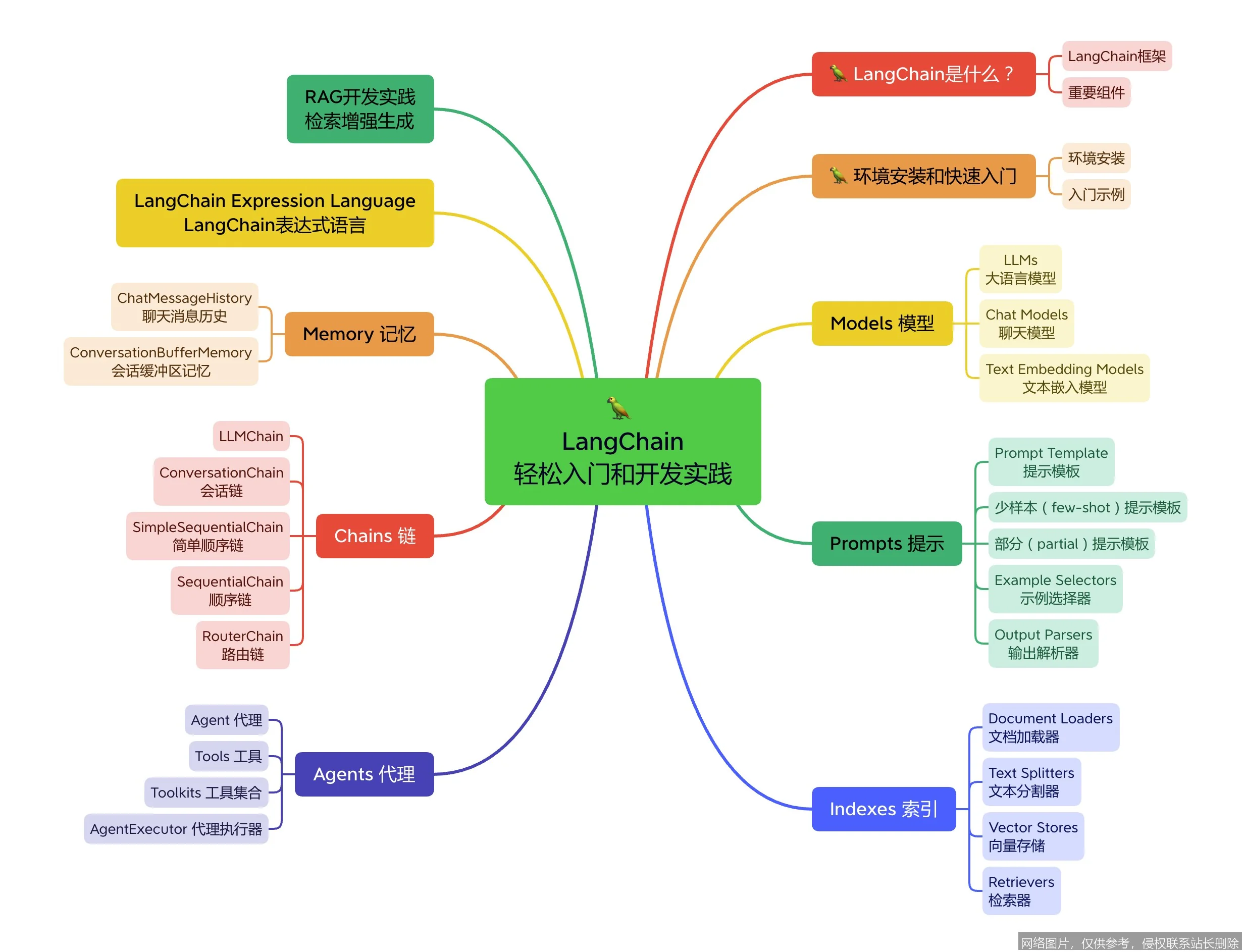

关键技术组件解析

LangChain 的架构设计采用了高度模块化的思想,主要包含以下几大核心组件,它们共同构成了应用的骨架:

- 模型抽象层(Model Abstraction):这是 LangChain 的基石。它提供了一套统一的接口(Interface),让开发者可以无缝切换不同的底层大模型(如 OpenAI 的 GPT-4、Anthropic 的 Claude、开源的 Llama 系列等)。这就好比电源适配器,无论你的设备是哪国标准,插上这个适配器就能通用。这极大地降低了厂商锁定的风险。

- 提示词管理(Prompt Management):提示词工程(Prompt Engineering)是大模型应用的关键。LangChain 提供了

PromptTemplate和FewShotPrompt等工具,允许开发者将提示词模板化、版本化。它不仅支持变量的动态插入,还能管理复杂的少样本学习(Few-Shot Learning)策略,确保模型在不同场景下表现稳定。 - 记忆模块(Memory):原生的 LLM 是无状态的(Stateless),即它记不住上一轮对话的内容。LangChain 引入了多种记忆机制,如

ConversationBufferMemory(存储完整历史)和ConversationSummaryMemory(自动总结历史),让应用具备“长期记忆”,能够进行多轮连贯的对话。 - 索引与检索(Indexes & Retrieval):这是实现检索增强生成(RAG, Retrieval-Augmented Generation)的核心。LangChain 提供了强大的文档加载器(Document Loaders)、文本分割器(Text Splitters)以及向量存储(Vector Stores)集成。它能将海量非结构化数据(如 PDF、网页)转化为向量嵌入(Embeddings),并在用户提问时,快速检索出最相关的片段喂给模型,从而解决幻觉问题并扩展知识库。

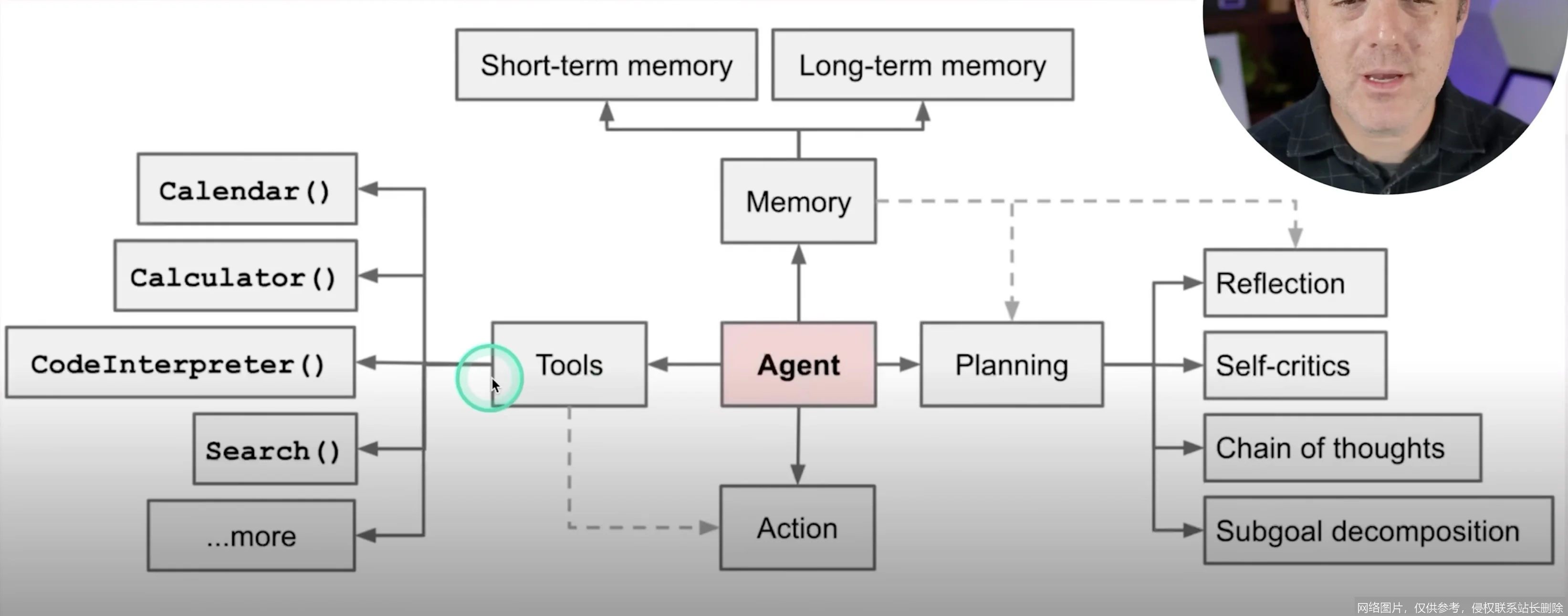

- 代理(Agents):这是 LangChain 最强大的功能之一。代理不仅仅是执行预设的链,它能够根据用户目标,自主决定使用哪些工具、以什么顺序使用。它是大模型的“手和脚”,赋予了模型自主解决问题的能力。

与传统开发模式的对比

为了更直观地理解,我们可以将传统 AI 应用开发与 LangChain 模式做一个类比:

传统模式就像是在建造一座固定的桥梁。工程师预先设计好路线,从 A 点到 B 点只有一条路。如果用户需求变了(比如要去 C 点),就必须重新修桥。这种方式在处理确定性问题时效率很高,但面对大模型这种概率性、开放性的引擎时,显得僵化且脆弱。

LangChain 模式则像是在组建一支特种部队。指挥官(LLM)手中有一张地图和多种装备(Tools/Chains)。当接到任务时,指挥官会根据现场情况(Context)临时制定战术:是先侦察(Search),还是先爆破(Code Execution),亦或是呼叫支援(Database Query)。这种动态适应性使得系统能够处理极其复杂和非结构化的任务。

从技术栈的角度看,传统方法往往需要开发者手动编写大量的胶水代码(Glue Code)来连接 API、处理字符串、管理状态。而 LangChain 将这些通用逻辑封装成了标准组件,开发者只需关注业务逻辑的编排,大大提升了开发效率(Developer Velocity)。

核心概念:构建认知图谱

深入掌握 LangChain,必须厘清其生态系统中的关键术语及其相互关系。这些概念不仅是代码中的类名,更是构建现代 AI 应用的思维模型。

关键术语深度解读

1. Chain(链)

Chain 是 LangChain 中最基础的构建块。它将多个组件串联起来,形成一个可执行的工作流。最简单的链是 LLMChain,它由一个提示词模板和一个模型组成。复杂的链则可以嵌套,例如先将用户输入进行翻译,再送入另一个链进行情感分析。链的本质是确定性流程的自动化。

2. Agent(代理)

如果说 Chain 是剧本,那么 Agent 就是演员。Agent 利用 LLM 作为推理引擎,来决定采取何种行动以及行动的参数。它拥有一个工具集(Toolkit),并通过循环(Loop)不断尝试,直到完成任务。Agent 的核心在于不确定性决策,它能够处理那些无法预先定义完整步骤的任务。

3. Tool(工具)

Tool 是 Agent 可以调用的具体函数或 API。它可以是简单的数学计算器,也可以是复杂的 SQL 查询引擎、Google 搜索接口,甚至是控制智能家居的脚本。在 LangChain 中,工具必须被清晰地描述(Description),以便 LLM 理解何时以及如何使用它。

4. RAG (Retrieval-Augmented Generation,检索增强生成)

虽然 RAG 是一种架构模式而非 LangChain 独有,但 LangChain 是实现 RAG 的事实标准框架。其核心逻辑是:当用户提问时,系统先去向量数据库中检索相关文档片段,将这些片段作为上下文(Context)拼接到提示词中,再让 LLM 基于这些真实信息回答问题。这有效解决了大模型的知识截止和幻觉问题。

5. Vector Store(向量存储)

这是 RAG 架构的内存单元。它将文本转化为高维向量(Embeddings),并利用相似度算法(如余弦相似度)进行快速检索。LangChain 支持超过 50 种向量数据库,包括 Pinecone, Milvus, Chroma, FAISS 等,屏蔽了底层存储的差异。

概念关系图谱

在 LangChain 的生态中,这些概念并非孤立存在,而是层层递进、相互依存的:

- L Models 是心脏,提供推理能力。

- Prompts 是神经信号,引导模型思考的方向。

- Chains 是骨骼,支撑起固定的业务流程。

- Memory 是海马体,保留历史的痕迹。

- Tools 是四肢,执行具体的动作。

- Agents 是大脑皮层,统筹全局,调度四肢(Tools)沿着骨骼(Chains)或直接开辟新路径去完成任务,同时依赖记忆(Memory)和外部知识(Vector Stores/RAG)来辅助决策。

用一个公式来表达它们的关系:

Application = LLM + (Chains OR Agents) + Memory + Tools + Data(RAG)

常见误解澄清

误解一:"LangChain 就是一个大模型。”

澄清:LangChain 本身不训练也不拥有任何模型。它是一个框架(Framework)和库(Library),类似于 Python 的 Django 或 React。它的作用是“连接”和“编排”,真正的智能来自于接入的第三方大模型(如 GPT-4)。

误解二:“用了 LangChain 就能自动解决所有问题。”

澄清:LangChain 提供了强大的积木,但如何搭建依然考验开发者的架构能力。错误的链式设计、糟糕的提示词模板或不合适的工具选择,依然会导致应用失败。它降低了门槛,但没有消除对领域知识和工程能力的要求。

误解三:"Agent 总是比 Chain 好。”

澄清:这是一个典型的过度工程陷阱。Chain 具有确定性、速度快、成本低的特点,适合流程固定的场景(如客服标准问答)。Agent 虽然灵活,但存在不可控性、延迟高、易陷入死循环的问题。优秀的架构师会根据场景在两者之间做权衡,甚至混合使用(例如在 Agent 的某个步骤中调用一个固定的 Chain)。

实际应用:从原型到生产的落地实践

自 2022 年发布以来,LangChain 已迅速成为 AI 应用开发的基础设施。从初创公司的 MVP(最小可行性产品)到跨国企业的核心系统,其应用场景无处不在。

典型应用场景

1. 企业级知识库问答系统(Enterprise Q&A)

这是目前最成熟的应用场景。企业拥有海量的内部文档(PDF、Word、Wiki、邮件),员工查找信息困难。利用 LangChain 构建 RAG 系统,员工可以用自然语言提问:“去年第三季度的销售策略是什么?”系统会自动检索内部文档,总结出精准答案并注明出处。这不仅提高了效率,还确保了信息的准确性和安全性(数据不出域)。

2. 智能数据分析助手(Text-to-SQL / Code Interpreter)

非技术人员往往难以直接从数据库中提取数据。通过 LangChain 的 Agent 和 SQL 工具,用户可以问:“显示上个月销售额最高的前五个产品。”Agent 会将其转化为 SQL 查询语句,在数据库中执行,并将结果可视化为图表返回给用户。这极大地降低了数据分析的门槛。

3. 自动化工作流与智能助理

结合日历、邮件、Slack 等 API,LangChain Agent 可以成为真正的个人助理。例如:“帮我安排下周与项目组的会议,检查大家的空闲时间,预定会议室,并发送邀请邮件。”Agent 能够自主拆解任务,依次调用不同工具完成闭环。

4. 复杂内容创作与评估

在营销领域,可以利用 LangChain 构建多步创作链:先生成大纲,再分段撰写,最后调用另一个模型进行风格润色和事实核查。这种“多模型协作”的模式,往往能产出比单次生成质量更高的内容。

代表性产品与项目案例

在业界,许多知名产品背后都有 LangChain 的身影:

- BabyAGI / AutoGPT:这些早期的开源项目展示了自主 Agent 的潜力,它们完全基于 LangChain 构建,能够自主设定子目标并无限循环执行,引发了全球对"AI 代理”的狂热。

- Dify / Flowise:这些低代码/无代码平台底层大量复用了 LangChain 的逻辑,让不懂代码的用户也能通过拖拽组件来构建复杂的 AI 应用,极大地普及了 LangChain 的理念。

- 某大型金融机构风控系统:利用 LangChain 整合内部交易记录、外部新闻舆情和法规文档,实时生成风险评估报告,将原本需要人工数小时的分析缩短至分钟级。

使用门槛与条件

尽管 LangChain 功能强大,但要成功落地仍需满足一定条件:

- 技术基础:开发者需要熟悉 Python 或 JavaScript(LangChain.js),理解异步编程、API 调用以及基本的向量数据库概念。

- 成本考量:运行复杂的 Agent 链条可能会消耗大量的 Token,导致 API 成本激增。此外,向量数据库的存储和计算也需要相应的云资源投入。

- 数据治理:对于 RAG 应用,数据的质量直接决定效果。脏乱差的文档会导致“垃圾进,垃圾出”(Garbage In, Garbage Out)。因此,前期的数据清洗和分块策略(Chunking Strategy)至关重要。

- 延迟容忍度:由于涉及多次模型调用和网络请求,LangChain 应用的响应时间通常比传统软件慢。在实时性要求极高的场景(如高频交易)中需谨慎使用。

延伸阅读:通往未来的进阶之路

LangChain 的生态系统正在以惊人的速度进化。从最初的简单链式调用,发展到如今的 LangGraph(用于构建有状态、多角色的复杂代理网络),再到 LangSmith(提供调试、监控和评估的一体化平台),它已经从一个单纯的库成长为一个完整的开发生命周期管理平台。

相关概念推荐

如果你想进一步拓展知识边界,以下概念值得深入研究:

- LangGraph:LangChain 团队推出的新库,专门用于构建循环图(Cyclic Graphs)结构的 Agent。它解决了传统 LangChain 在处理复杂状态机和多角色协作时的局限性,是构建高级 Agent 的必经之路。

- LlamaIndex:常与 LangChain 被拿来比较。LlamaIndex 更专注于数据索引和检索的高级优化,特别适合数据密集型的 RAG 应用。在实际项目中,两者常被结合使用。

- Function Calling(函数调用):这是大模型原生支持的一种能力,允许模型输出结构化的函数调用请求。理解它与 LangChain Tool 的异同,有助于写出更高效的代码。

- Multi-Agent Systems(多智能体系统):未来的趋势不是单个超级 Agent,而是由多个扮演不同角色(如研究员、作家、审核员)的 Agent 组成的协作网络。

进阶学习路径

对于希望系统掌握 LangChain 的学习者,建议遵循以下路径:

- 基础入门:阅读官方文档的 "Get Started" 部分,亲手运行几个经典的 Chain 示例(如 QA over PDF)。

- 原理深化:深入研究 Prompt Template 的设计技巧,理解 Embedding 模型和 Vector Store 的工作原理。

- 实战演练:尝试构建一个完整的 RAG 应用,并引入 Memory 模块实现多轮对话。

- 高级探索:学习 LangGraph,尝试构建一个具有反思能力(Reflection)和自我修正能力的 Agent。

- 工程化落地:使用 LangSmith 进行链路追踪(Tracing)和评估(Evaluation),优化应用的延迟和准确率,最终部署到生产环境。

推荐资源与文献

- 官方文档:LangChain Python Docs 和 LangChain JS Docs。这是最权威、更新最快的信息来源,务必养成查阅第一手资料的习惯。

- LangChain 官方博客:关注

LangChain Blog,了解最新的功能发布(如 LangGraph 的推出)和最佳实践案例。 - GitHub 仓库:浏览

langchain-ai/langchain源码及examples目录,那里有数百个由社区贡献的真实场景代码。 - 经典论文:虽然 LangChain 是工程框架,但其背后的理论基础源于《ReAct: Synergizing Reasoning and Acting in Language Models》等论文,阅读这些论文有助于理解 Agent 设计的深层逻辑。

结语:在 2026 年的今天回望,LangChain 不仅仅是一个工具库,它是大模型时代应用开发的“操作系统”。它将混乱的 AI 能力标准化、模块化,让每一个开发者都能站在巨人的肩膀上,构建出真正具有智能的应用程序。随着 Agent 技术的成熟,我们有理由相信,基于 LangChain 构建的系统将从辅助人类走向自主协作,开启人机交互的新纪元。

已是最新文章

相关推荐

- 什么是 LangChain?2026 最新定义、核心原理与 Agent 实战详解

- 什么是 Llama 3?2026 最新架构原理、性能评测与实战应用全解析

- 什么是 Midjourney?2026 版原理、技术演进与商业应用全解析

- 什么是 AI 伦理?2026 数智时代核心原则、技术挑战与应用范式全面解析

- KLING AI(可灵)详解:3.0 模型原理、智能分镜与影视级应用实战

- GitHub Copilot 详解:2026 年智能编码原理、交互数据政策与实战应用

- 隐私保护是什么:2026 年定义、核心技术原理与实战应用全面解析

- 数据投毒是什么:原理、攻击手法与 2026 年防御实战全面解析

- Jailbreak 是什么:从设备越狱到 AI 提示注入的全面解析

- 幻觉是什么?2026 大模型术语详解:原理、类型与实战应对