MoE 是什么?从原理到应用一文搞懂混合专家模型,新手入门看这篇就够了

MoE 是什么?如果你关注 2026 年的人工智能领域,这个词出现的频率绝对不亚于当年的"Transformer"。从微信悄然上线的"ClawBot"龙虾插件,到阿里巴巴发布的全球首个企业级 Agent 平台“悟空”,再到小米自研的 MiMo-V2-Flash 模型,背后都活跃着同一个核心技术架构的身影——混合专家模型(Mixture of Experts, 简称 MoE)。

在 2026 年的今天,中国 AI 大模型第三方平台的调用量已连续两周超越美国,这不仅是算力的胜利,更是架构创新的成果。面对动辄数千亿参数的超级模型,如何在不让显卡“燃烧”的前提下实现高效推理?如何让手机等终端设备也能跑通超大模型?答案就藏在 MoE 的“稀疏激活”机制中。

本文将带你从零开始,深入拆解 MoE 的前世今生、核心原理、2026 年的最新技术突破以及它在实际商业场景中的落地应用。无论你是刚入门的 AI 爱好者,还是寻求技术突破的开发者,这篇指南都将是你理解下一代大模型架构的钥匙。

一、MoE 的诞生:为什么我们需要“混合专家”?

在 MoE 流行之前,大模型的发展主要遵循“大力出奇迹”的路线:增加层数、增加参数量、堆叠更多的计算资源。然而,这种稠密模型(Dense Model)很快就遇到了瓶颈:

- 算力成本高昂:每处理一个 token,都需要调动模型中所有的参数进行计算,导致推理成本呈线性甚至指数级增长。

- 显存墙限制:随着参数量突破万亿级别,单张甚至多张显卡的显存都无法容纳整个模型,限制了模型的进一步扩展。

- 能效比低:在处理简单任务(如简单的分类或问答)时,动用千亿参数的大模型无异于“杀鸡用牛刀”,造成了巨大的资源浪费。

早在 1991 年,论文《Adaptive Mixture of Local Experts》就提出了“混合专家”的概念,但在随后的三十年里,由于训练不稳定和通信开销大,它并未成为主流。直到 2017 年,谷歌研究员 Noam Shazeer 等人将 MoE 层应用于循环神经网络(RNN),并在随后的 Transformer 架构中大放异彩,这一架构才真正焕发生机。

MoE 的核心哲学非常简单:就像一家顶级医院不会让所有医生同时看一个病人一样,MoE 模型为每个输入动态地选择一小部分最合适的“专家”子网络进行计算。这种“高参数、低计算”的稀疏性,使得模型可以在不显著增加浮点运算量(FLOPs)的情况下,容纳更丰富的知识和更强的泛化能力。

二、深度拆解:MoE 是如何工作的?

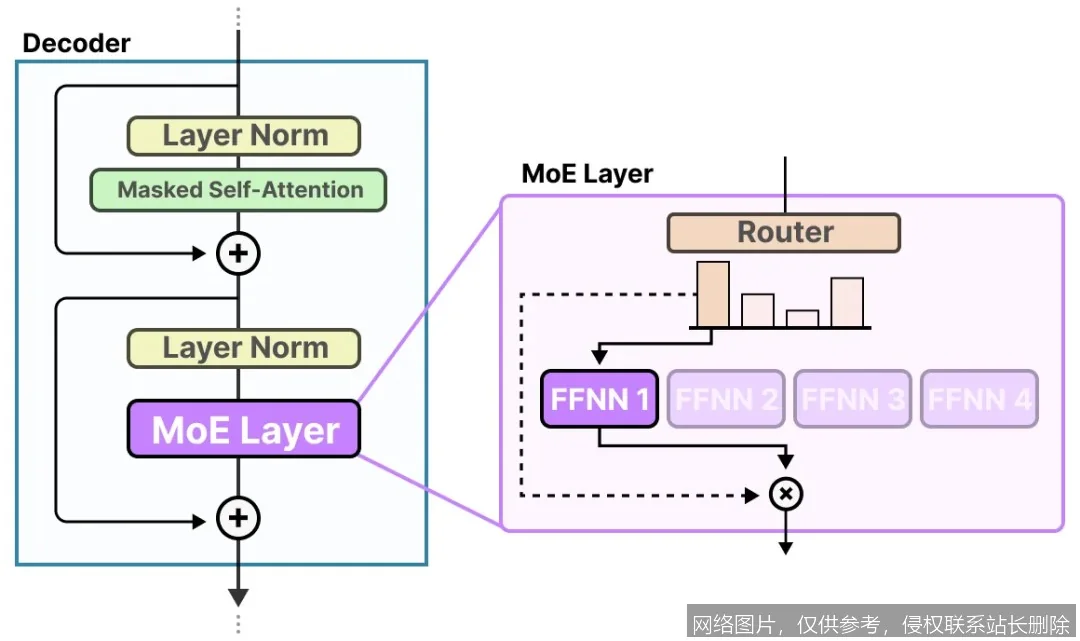

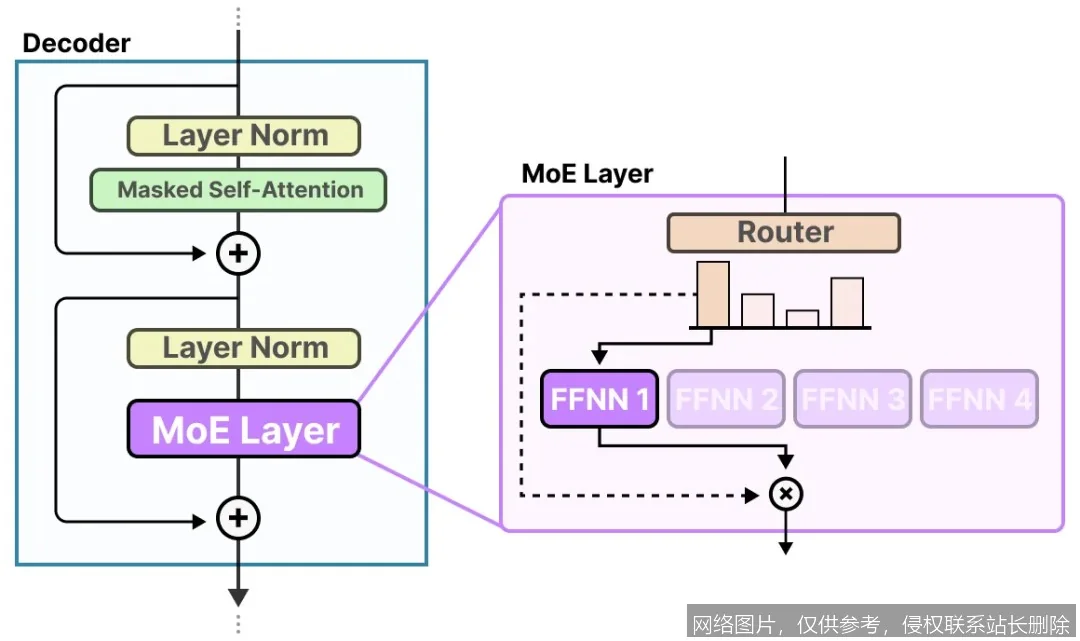

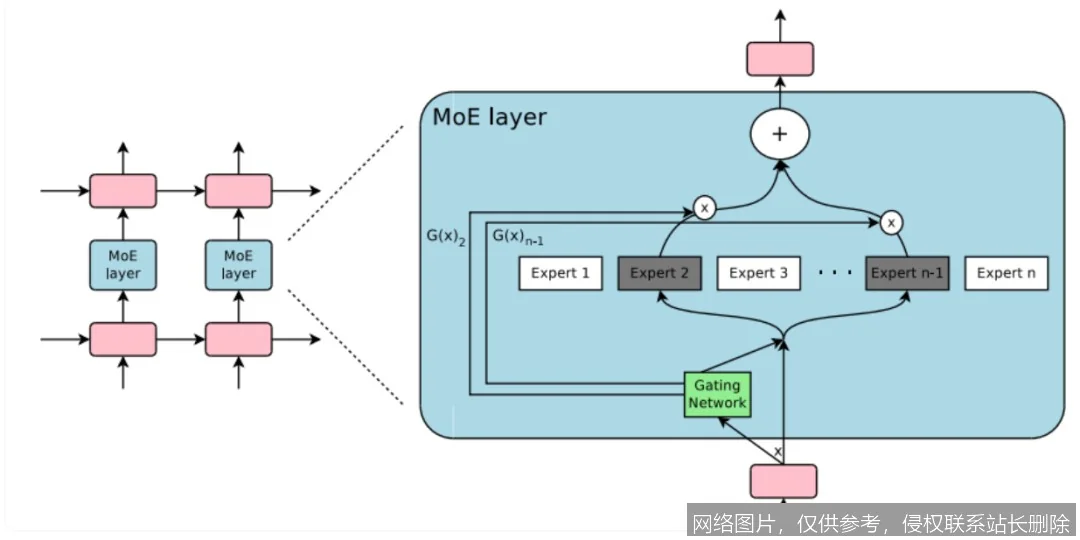

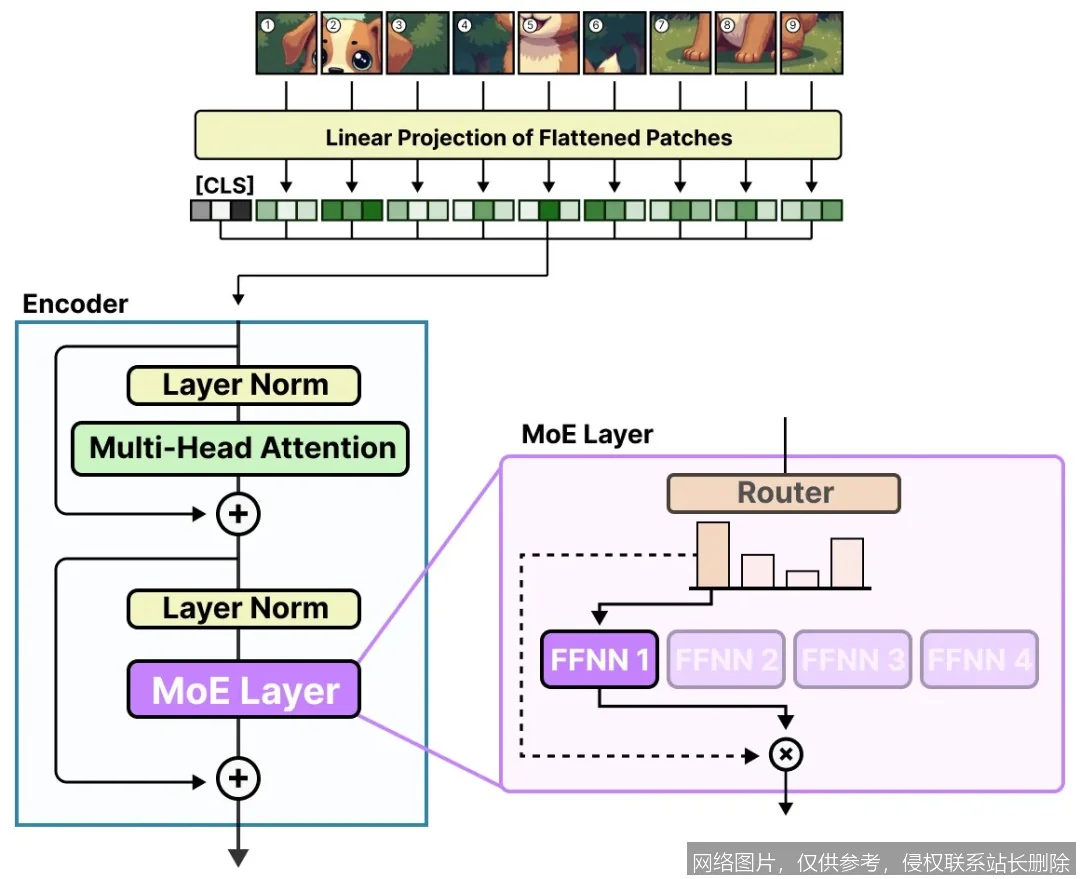

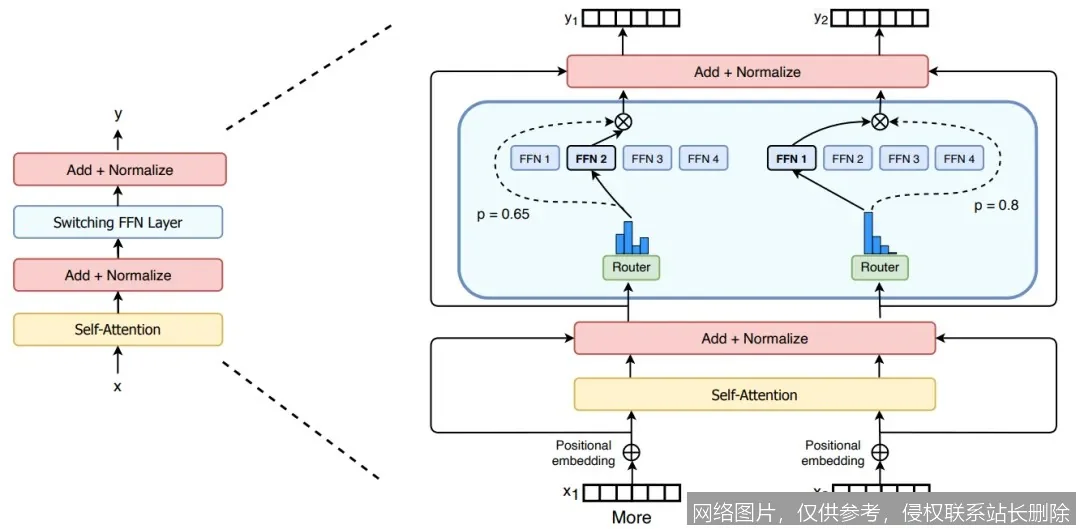

要理解 MoE,我们可以将其想象成一个由“门控网络”和多个“专家网络”组成的智能调度系统。

1. 核心组件

- 专家网络(Experts):这是模型中真正干活的子网络。在一个拥有 4000 亿参数的 MoE 模型中,可能包含数百个这样的专家,每个专家都是一个独立的神经网络层,擅长处理特定类型的任务(如代码生成、数学推理、创意写作等)。

- 门控网络(Gating Network):这是模型的“大脑”或“路由器”。当输入数据(Token)进入模型时,门控网络会迅速分析其特征,并决定将该数据发送给哪几个专家处理。

- 稀疏激活(Sparse Activation):这是 MoE 的灵魂。对于每一个输入 Token,门控网络通常只激活总专家数中的一小部分(例如 Top-2 或 Top-4)。这意味着,虽然模型总参数量巨大,但每次计算实际参与的参数量却很少。

2. 工作流程演示

假设你向模型提问:“请用 Python 写一个快速排序算法。”

- 输入分析:门控网络接收到"Python"、“快速排序”、“算法”等关键词。

- 路由决策:门控网络判断这是一个编程任务,于是将权重最高的两个专家标记为“代码专家 A"和“逻辑专家 B"。

- 并行计算:只有“代码专家 A"和“逻辑专家 B"被激活并进行计算,其他负责“诗歌创作”或“医疗诊断”的专家处于休眠状态,不消耗算力。

- 结果融合:两个专家的输出经过加权合并,最终生成高质量的代码回答。

这种机制使得 MoE 模型能够实现“规模扩展”与“推理速度”的完美平衡。根据 2026 年初的开源权重大模型架构简评,某些旗舰大模型虽然总参数量高达 4000 亿,但激活参数量仅为 130 亿,效率提升显而易见。

三、2026 年技术前沿:MoE 的最新演进与突破

时间来到 2026 年 3 月,MoE 架构已经不再是实验室里的理论,而是成为了各大科技巨头竞相布局的战略高地。从最新的行业动态来看,MoE 技术在以下几个方向取得了突破性进展:

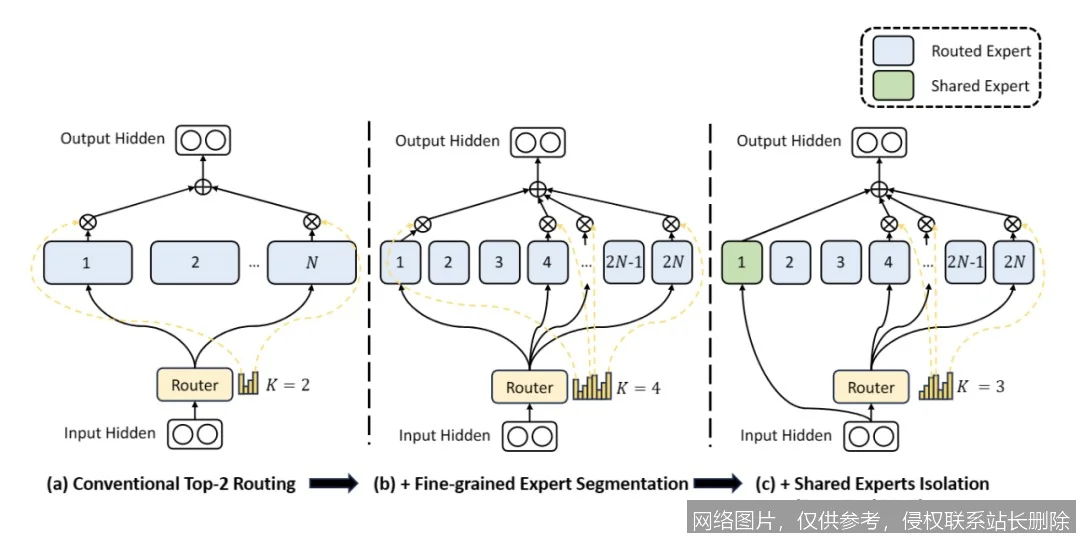

1. 架构创新:从“单一路由”到“协作式”与“专业化”并存

根据 2026 年 3 月 18 日发布的深度拆解文章,目前主流的 MoE 架构分化出了两条截然不同的技术路线:

- Gemini 3.1 的“协作式”MoE:谷歌在 Gemini 3.1 中引入了专家间的信息交互机制。Token 不仅路由到特定专家,专家之间还能通过轻量级通信交换中间表示。这种设计在处理创意写作和多角度分析时表现卓越,能够融合不同专家的“知识视角”,虽然推理延迟略高,但内容丰富度大幅提升。

- GPT-5.4 的“专业化”MoE:OpenAI 则延续了工程优化思路,采用 Top-2 稀疏路由,强制不同专家学习完全不同的知识领域(如专攻代码、专攻数学)。配合 KV 缓存压缩技术,其在逻辑推理和代码生成等确定性任务上效率极高,输出稳定可靠。

2. 端侧部署突破:解决“显存墙”难题

如何在手机等内存受限设备上运行庞大的 MoE 模型?这是 2026 年的热门话题。来自复旦大学、华为等机构的学者在 ICLR 2026 上发表论文,揭示了“路由一致性”的秘密。

研究发现,如果连续 Token 总是激活相似的专家,就可以利用专家卸载(Expert Offloading)技术:将部分专家缓存在快速内存(GPU)中,其余放在慢速内存(CPU/磁盘)上按需加载。通过引入 SRP(段级路由相似度)和 SCH(缓存命中率)两大评估指标,研究人员发现像 GRIN-MoE 这样的模型具有极高的局部路由一致性,非常适合在移动端部署。这意味着,未来我们可能在手机上就能流畅运行千亿参数的 MoE 模型。

3. 训练效率革命:LAER-MoE 框架

在 ASPLOS 2026 会议上,研究人员提出了LAER-MoE框架,解决了专家并行训练中的负载不均衡问题。传统的专家并行往往因为少数“过载”专家拖慢整体迭代速度。LAER-MoE 通过“完全分片专家并行(FSEP)”和负载自适应重布局,实现了动态且高效的负载均衡,大幅降低了训练成本和通信开销。

4. 国产力量的崛起:小米与阿里的实战

在中国市场,MoE 的应用已经进入深水区:

- 小米 MiMo-V2-Flash:这款总参数量 309B、激活参数 15B 的模型,采用了 HySparse 混合稀疏注意力架构。2026 年 2 月推出的新版本通过“极少的全注意力 + 稀疏注意力”设计,高效处理超长文本,且在多项 Agent 测评基准中名列前茅。更令人瞩目的是,其 API 免费试用期的延长和支付系统的即将启用,标志着商业化闭环的形成。

- 阿里“悟空”平台:2026 年 3 月 17 日,阿里发布了全球首个企业级 AI 原生工作平台“悟空”,内置于钉钉。该平台底层极有可能采用了定制的 MoE 架构,以支持海量企业应用场景下的低成本、高并发推理需求。

- 微信 ClawBot:2026 年 3 月 23 日,微信新增官方"ClawBot"插件,让用户可以随时随地操控 OpenClaw“小龙虾”。这一动作暗示了腾讯在轻量化、插件化 MoE 模型上的布局,旨在让大模型能力像小程序一样触手可及。

四、实战指南:企业如何利用 MoE 破局?

对于企业而言,直接部署一个巨型通用模型(如 GPT-4 级)往往面临成本极高、响应慢的问题;而使用小型专用模型又难以保证任务完成质量。MoE 架构提供了一种完美的“破局之钥”。

1. 任务解耦与路由分配

企业的真实业务流通常由多种任务构成。以智能客服为例,可能同时需要“意图识别”、“知识检索”、“情感分析”、“文案润色”和“合规检查”。

传统方案:让一个昂贵的巨型模型处理所有环节,资源浪费严重。

MoE 方案:构建一个智能路由中枢,根据输入任务动态组合模型。

| 方案类型 | 典型模型 | 成本 | 响应速度 | 任务完成质量 | 适用场景 |

|---|---|---|---|---|---|

| 巨型通用模型 | GPT-4 级、DeepSeek-V3 | 极高 | 慢 | 极高 | 不限领域的复杂创作、深度推理 |

| 中型平衡模型 | Qwen-Max、GLM-4 | 高 | 中等 | 高 | 日常对话、文档处理、一般性编程 |

| 小型专用模型 | Qwen2.5-7B、Phi-3 | 低 | 极快 | 不稳定 (依赖任务) | 简单分类、信息提取、知识问答 |

| MoE 混合架构 | 自定义专家组合 | 中低 | 快 | 高 (针对性优化) | 全场景覆盖、成本可控 |

2. 落地建议

- 构建专家库:针对不同业务场景(如法律、医疗、代码、营销),训练或微调专用的“小专家”模型。

- 设计智能路由器:开发高精度的门控网络,确保输入流量能被准确分发到最合适的专家。

- 动态伸缩:利用 MoE 的稀疏特性,在业务低谷期自动减少激活的专家数量,进一步降低成本。

五、常见误区与未来展望

误区一:MoE 就是单纯的模型拼接

错。MoE 不仅仅是把几个模型放在一起,其核心在于端到端的联合训练。门控网络和专家网络需要在同一目标函数下共同优化,否则会出现“赢家通吃”(所有流量都涌向同一个专家)或训练发散的问题。

误区二:参数越多越好

不一定。2026 年的研究表明,盲目增加专家数量会导致通信开销剧增和负载均衡困难。关键在于专家的特化程度和路由的准确性。像 GPT-5.4 那样通过辅助损失函数强制专家分工,往往比单纯堆砌参数更有效。

未来展望:从“对话工具”到“数字员工”

随着 MoE 技术的成熟,大模型正在从单一的对话工具进化为全能的“数字员工”。2026 年,我们看到了具备原生计算机操作能力的 GPT-5.4,以及能够处理百万级上下文的 Gemini 3.1。未来,MoE 架构将进一步向多模态融合和自主代理(Agent)方向发展。

正如雷军在回应是否养“龙虾”(指代微信 ClawBot 背后的技术生态)时所暗示的,未来的 AI 将无处不在,而 MoE 将是支撑这一愿景的基石。无论是比亚迪超越特斯拉成为全球电动车销冠背后的智能驾驶算法,还是吉利汽车超越本田的智能化转型,都离不开高效能 AI 架构的支持。

六、结语

MoE(混合专家模型)不仅仅是一种技术架构的升级,更是人工智能发展理念的一次深刻变革。它告诉我们,智能的本质不在于“大而全”的蛮力计算,而在于“专而精”的高效协同。

站在 2026 年的节点上,我们可以看到中国 AI 力量在这一领域的强势崛起。从底层架构的创新(如小米的 HySparse、华为的路由一致性研究),到上层应用的爆发(如阿里悟空、微信 ClawBot),MoE 正在重塑整个行业格局。

对于新手而言,理解 MoE 是通往高阶 AI 世界的必经之路;对于从业者而言,掌握 MoE 的调优与落地策略,将是未来几年最具竞争力的技能之一。希望这篇文章能为你打开这扇大门,让你在混合专家的广阔天地中找到属于自己的位置。

参考资料与信息源

- IT 之家。(2026, March 23). IT 早报 0323:微信发布官方“龙虾”插件;国家互联网应急中心等发布 OpenClaw 安全使用实践指南. Retrieved from https://www.ithome.com

- 智源社区。(2026, January 30). ICLR 2026 | 不是所有 MoE 模型都适合专家卸载!揭示 MoE 模型路由一致性的秘密. Retrieved from https://www.baai.ac.cn

- 太平洋电脑网 & 新浪网。(2026, March 19). MiMo-V2-Flash 模型 API 免费试用期延后及架构解析. Retrieved from https://www.pconline.com.cn

- 未来商业周刊。(2026, March 22). 阿里、飞书发布 Agent 产品“打擂台”;地瓜机器人完成 1.2 亿美元 B1 轮融资. Retrieved from https://www.futurebusiness.com

- Google AI Blog & OpenAI Technical Report. (2026, March 18). 2026 年大模型架构深度拆解:Gemini 3.1 的 MoE 创新与 GPT-5.4 的原生操作能力. Retrieved from https://ai.google

- ASPLOS 2026 Conference Proceedings. (2026, February 12). LAER-MoE: 通过负载自适应专家重布局方法实现高效 MoE 训练. Retrieved from https://asplos-conference.org

- 日本经济新闻。(2026, March 21). 中国车企全球销量 20 多年来首次超日本居榜首. Retrieved from https://www.nikkei.com

- GitHub & Hugging Face. (2026, March 4). 简评 2026 年初开源权重大模型架构. Retrieved from https://github.com