Fine-tuning(微调)是什么?从原理到实战,让通用模型变身行业专家一文搞懂

摘要:在人工智能大模型爆发的 2026 年,通用大模型(Foundation Models)虽然博学多才,却往往难以直接解决垂直领域的专业问题。Fine-tuning(微调)技术因此成为连接“通用智能”与“行业专家”的关键桥梁。本文将深入浅出地解析微调的核心原理,对比主流微调策略(如 LoRA、QLoRA),并结合 2026 年最新的医疗、金融及影视行业实战案例,手把手教你如何让 AI 模型听懂你的“行话”,实现从通才到专家的华丽转身。

引言:当“通才”遇上“专岗”,为什么我们需要 Fine-tuning?

想象一下,你招聘了一位毕业于世界顶尖学府的博士。他读过人类历史上几乎所有的书籍,上知天文下知地理,逻辑严密,文笔流畅。这就是我们今天的预训练大语言模型(Pre-trained LLM)。然而,当你让他去处理一家三甲医院的病历分析,或者去审核一份复杂的金融风控报告时,他可能会显得手足无措。因为他不懂医院特有的缩写术语,也不熟悉该金融机构内部的风控红线。

这时候,你不需要把他送回学校重新读一遍书(那相当于从头训练一个模型,成本高达数千万美元且耗时数月),而是需要给他安排一场针对性的“岗前培训”。这场培训,就是我们要讲的主角——Fine-tuning(微调)。

进入 2026 年,随着“十五五”规划纲要明确提出“统筹推进算力设施建设、模型算法发展和高质量数据资源供给”,Fine-tuning已不再是大厂实验室里的黑科技,而是让“人工智能+"真正扎根田间车间、赋能实体经济的核心引擎。从耀客传媒利用微调技术打造超写实"AI 演员”秦凌岳,到医疗机构将术语识别准确率从 76% 提升至 92%,微调正在重塑千行百业。

第一章:深度拆解——Fine-tuning 到底是什么?

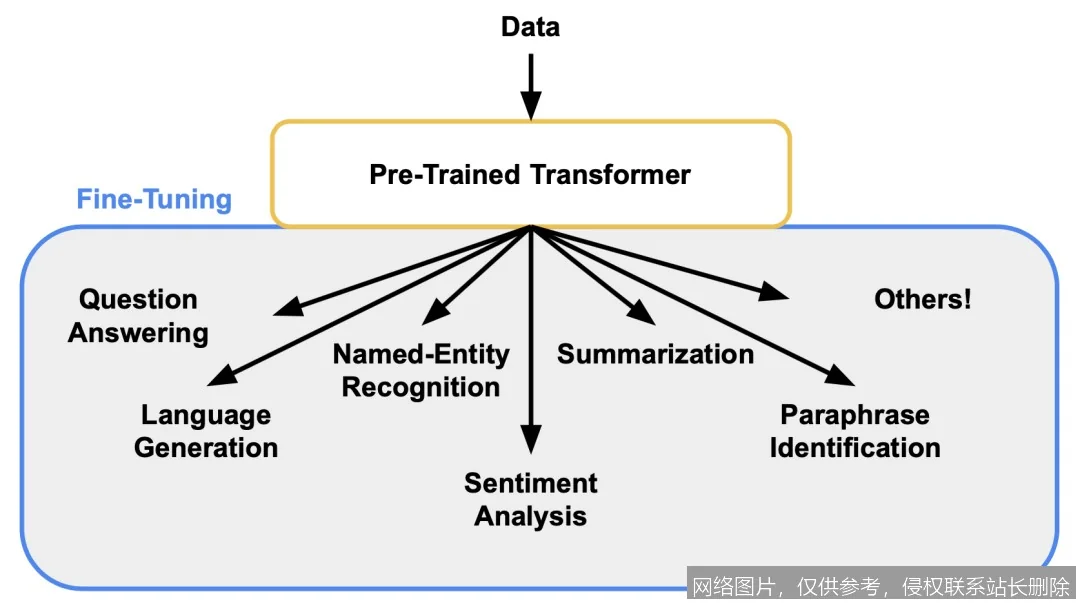

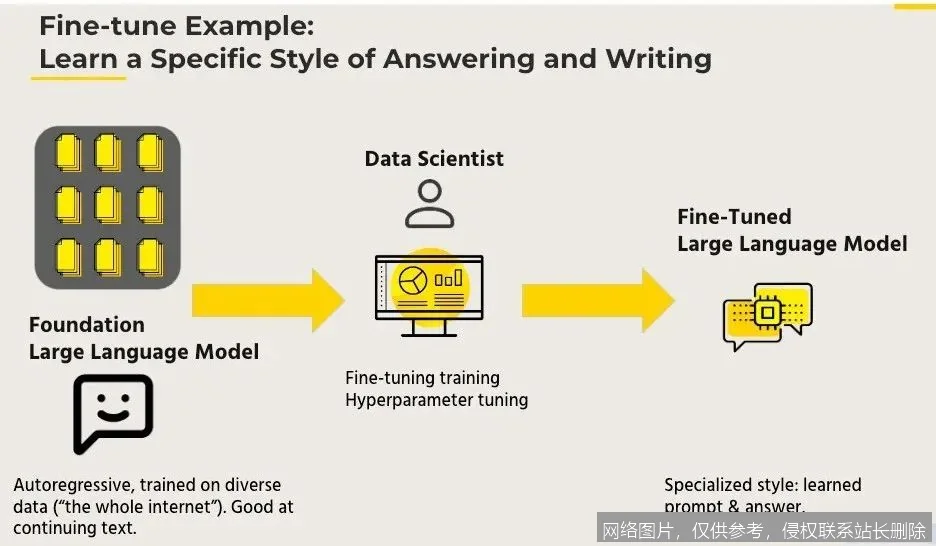

用技术语言定义,Fine-tuning(微调)是指在一个已经预训练好的大语言模型基础上,使用特定领域或任务的数据集继续训练,通过调整模型内部的参数权重,使其更好地适应具体需求的过程。

1.1 核心逻辑:从“广撒网”到“精聚焦”

预训练和微调的关系,可以形象地概括为:

- 预训练(Pre-training):是“广撒网”。模型在海量的无标注数据(如整个互联网的文本)中学习语言的规律、常识逻辑和基础事实。这构建了一个庞大的“通用知识库”。

- 微调(Fine-tuning):是“精聚焦”。在不破坏模型原有通用能力的前提下,注入目标场景的专属数据。这就像给图书馆补充了特定专业的藏书,并训练管理员(模型)能更高效地检索和运用这些新知识。

微调的本质不是改变模型的“大脑结构”(基础架构保持不变),而是调整其“知识权重”。经过微调的模型,在面对特定领域的提问时,不仅能调用通用知识,更能优先激活那些在微调阶段学到的专业模式,从而像一个真正的行业专家那样思考和回答。

1.2 为什么不能只用提示词工程(Prompt Engineering)?

很多初学者会问:“我多写几句提示词(Prompt),告诉模型‘你是一个资深医生’,不就行了吗?”

在 2026 年的今天,对于简单任务,Prompt 确实有效。但在复杂场景下,它存在明显局限:

- 上下文窗口限制:无论模型窗口多大,你无法在每次对话中都塞入几百页的专业手册。

- 知识内化程度低:Prompt 只是临时的指令,模型并没有真正“学会”这些知识。面对复杂的推理链条,模型容易“遗忘”指令或产生幻觉。

- 风格一致性差:很难通过 Prompt 让模型稳定输出符合企业特定格式、语气和规范的内容。

而Fine-tuning是将知识“刻录”进模型参数中,实现了能力的永久跃迁,无需每次重复输入背景信息,响应速度更快,准确性更高。

第二章:技术演进——2026 年主流微调策略全景图

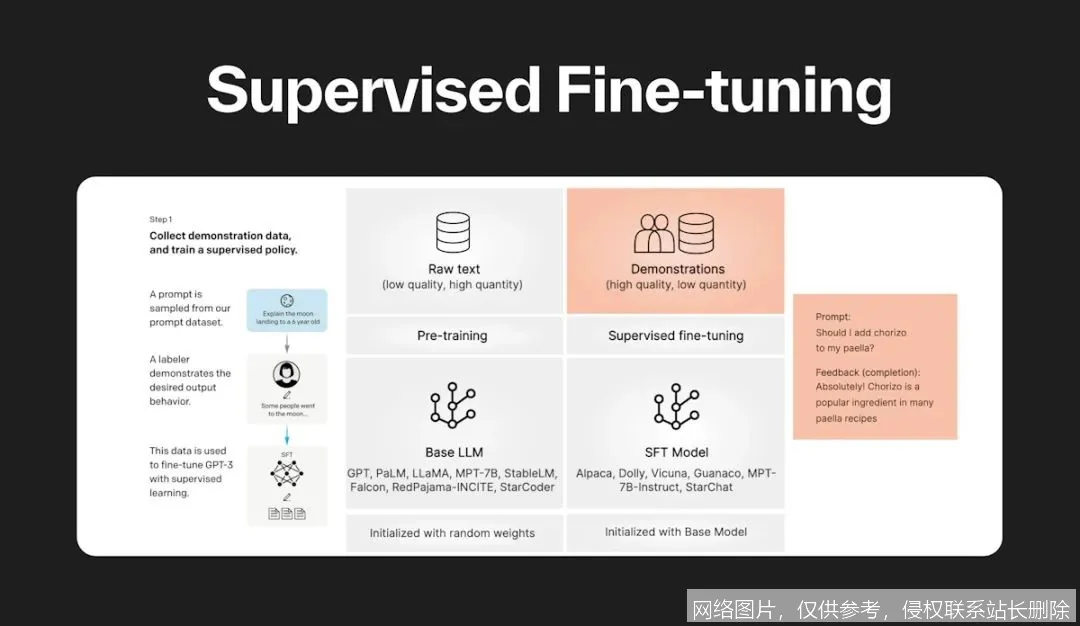

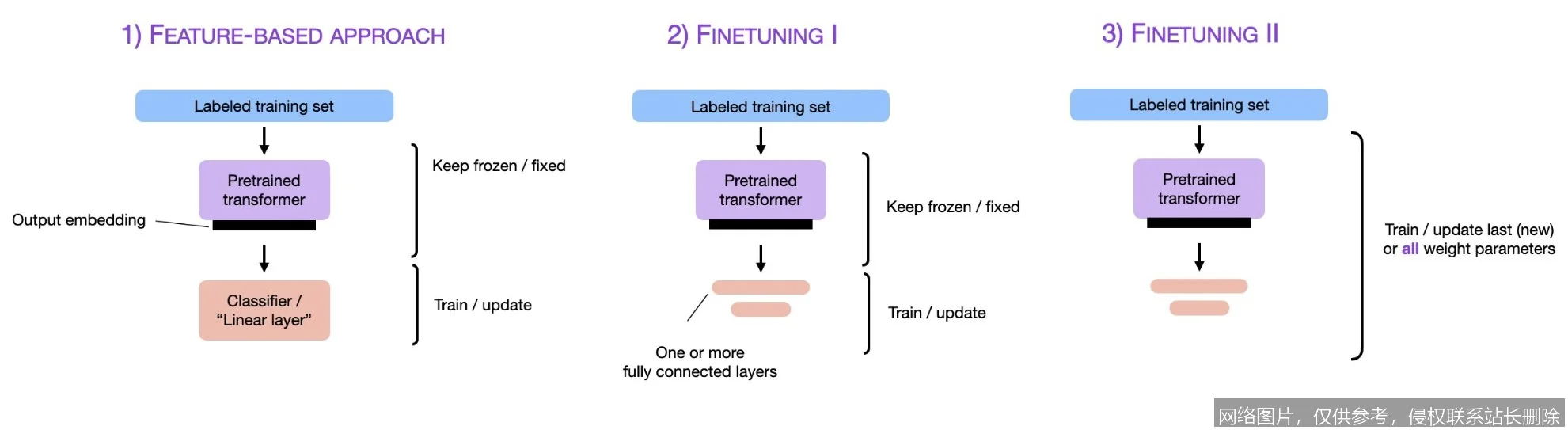

早期的全量微调(Full Fine-tuning)需要更新模型的所有参数,对显存和算力要求极高,往往让中小企业望而却步。但随着技术的发展,尤其是参数高效微调(PEFT)技术的成熟,微调的门槛已大幅降低。

2.1 全量微调(Full Fine-tuning)

这是最传统的方法,更新模型中所有的权重参数。

- 优点:理论上能达到该数据集上的最优性能,模型适应性最强。

- 缺点:算力成本极高,容易产生“灾难性遗忘”(即学会了新知识,忘记了旧能力),且每个任务都需要保存一个完整的模型副本,存储成本高。

- 适用场景:拥有海量专属数据、算力充足的大厂,或领域差异极大的任务。

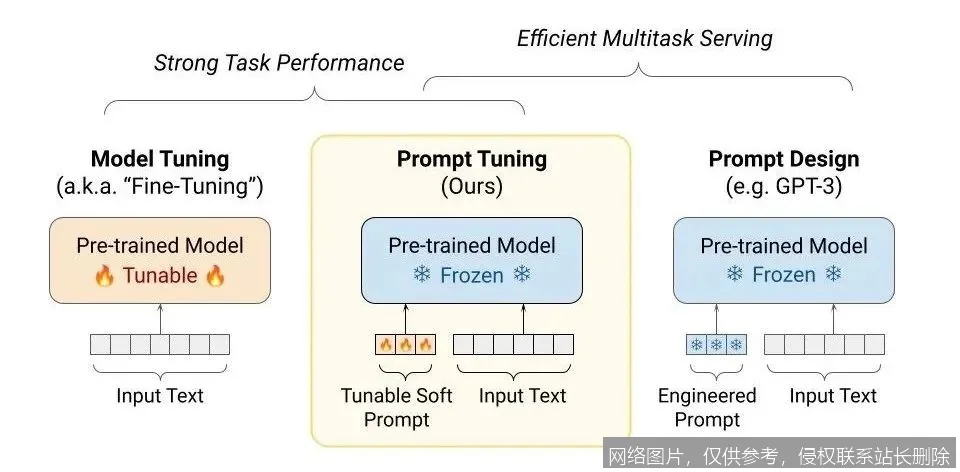

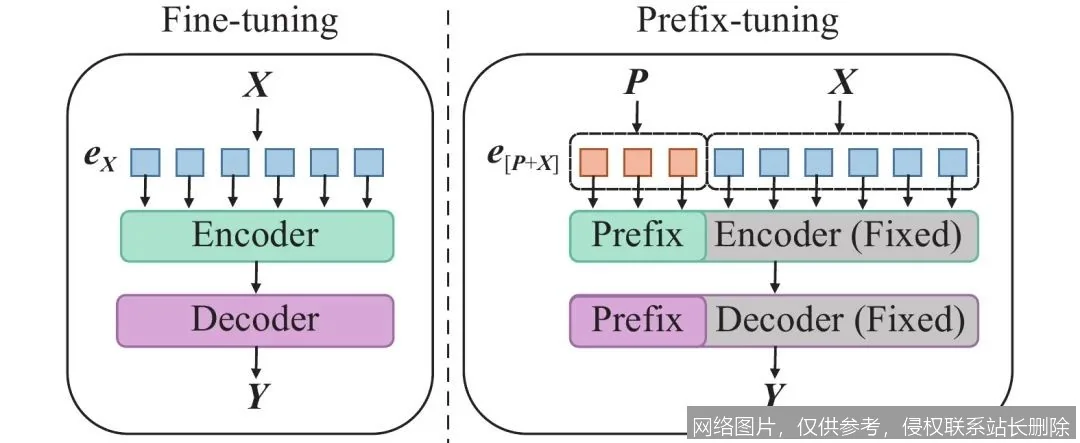

2.2 LoRA(Low-Rank Adaptation):当下的行业标准

LoRA 是目前应用最广泛的微调技术。它的核心思想是“冻结”预训练模型的主干参数,只在模型的某些层旁边添加少量的“旁路”矩阵(低秩分解矩阵)进行训练。

- 原理比喻:就像给博士发了一本“便携笔记”,他在回答问题时,会参考这本笔记,但不需要修改他大脑中原有的庞大记忆库。

- 优势:

- 显存占用极低:相比全量微调,显存需求可减少 3-5 倍。

- 训练速度快:参数量少,收敛更快。

- 无缝切换:同一个基座模型可以挂载多个不同的 LoRA 适配器,瞬间在“法律专家”和“医疗专家”之间切换。

2.3 QLoRA 与更进阶的优化

到了 2026 年,基于 QLoRA(Quantized LoRA)的技术已成为个人开发者和中小企业的标配。它结合了量化技术(将模型权重从 16 位压缩到 4 位甚至更低)和 LoRA,使得在单张消费级显卡上微调 70B 参数级别的大模型成为可能。

此外,针对长上下文(Long Context)的微调优化、多模态模型(文本 + 图像 + 视频)的联合微调技术也在今年取得了突破性进展,特别是在驱动"AI 演员”面部表情和动作绑定的应用中表现卓越。

2.4 微调策略对比表

| 策略 | 可训练参数量 | 显存需求 | 训练速度 | 适用人群 |

|---|---|---|---|---|

| 全量微调 | 100% | 极高 | 慢 | 头部大厂、科研机构 |

| LoRA | <1% | 中等 | 快 | 大多数企业、开发者 |

| QLoRA | <1% | 低(消费级显卡可用) | 较快 | 个人开发者、初创团队 |

| Prompt Tuning | 极少(仅提示向量) | 极低 | 极快 | 轻量级任务、快速验证 |

第三章:实战指南——如何打造你的专属行业模型

理论再多,不如实战一次。以下是基于 2026 年主流工具链(如 Hugging Face Transformers, PEFT, DeepSpeed)的标准微调流程。

3.1 第一步:数据准备——微调成败的关键

业界常说:"Garbage In, Garbage Out"(垃圾进,垃圾出)。数据的质量直接决定了微调的效果。

- 数据清洗:去除无关字符、乱码、重复内容。对于 2026 年的多模态应用,还需确保图像 - 文本对的精准对齐。

- 数据格式化:通常需要将数据转换为 JSONL 格式,包含

instruction(指令)、input(输入,可选)和output(期望输出)。 - 数据多样性:不要只提供一种问答模式。应包含单选、多选、开放式问答、推理题等多种格式,防止模型过拟合。

- 数据量级:对于 LoRA 微调,通常几百到几千条高质量数据即可看到显著效果;若要彻底改变模型风格,可能需要数万条数据。

3.2 第二步:选择基座模型

根据任务需求选择合适的“底子”。

* 通用对话:可选择 Qwen(通义千问)、DeepSeek、Llama 系列的最新迭代版本。

* 代码生成:选择专门针对代码预训练的模型。

* 中文垂类:优先考虑在中文语料上表现优异的国产开源模型。

3.3 第三步:配置超参数

这是微调中的“艺术”部分,常见的关键参数包括:

- Learning Rate(学习率):通常设置在 1e-4 到 1e-5 之间。过大导致震荡,过小导致收敛慢。

- Epochs(训练轮数):一般 1-3 轮即可。过多的轮数会导致过拟合,让模型死记硬背训练数据。

- Batch Size:受显存限制,可使用 Gradient Accumulation(梯度累积)来模拟大 Batch。

- LoRA Rank (r):控制旁路矩阵的维度,通常在 8 到 64 之间,越大表达能力越强,但参数量也增加。

3.4 第四步:训练与监控

在训练过程中,密切监控Loss(损失函数)的变化曲线。理想的曲线应该是快速下降后趋于平稳。如果 Loss 突然飙升或震荡剧烈,说明学习率可能过高或数据存在问题。同时,建议在验证集上定期进行评估,观察模型是否出现了“灾难性遗忘”。

3.5 第五步:评估与部署

训练完成后,切勿直接上线。需要进行多维度的评估:

* 自动化评测:使用 BLEU、ROUGE 等指标,或利用另一个大模型作为裁判(LLM-as-a-Judge)。

* 人工评测:邀请领域专家对模型的输出进行打分,重点关注准确性、逻辑性和安全性。

* 部署:将训练好的 Adapter 权重合并到基座模型,或通过 vLLM、TGI 等推理框架动态加载,提供 API 服务。

第四章:行业洞察——2026 年微调技术的落地爆发

随着算力的普及和算法的优化,Fine-tuning正在从技术概念走向大规模的产业落地。

4.1 医疗健康:从辅助诊断到病历专家

在医疗领域,通用模型往往无法准确理解复杂的医学术语和病例逻辑。通过微调,某知名医疗机构将病历分析模型的术语识别准确率从 76% 大幅提升至 92%。微调后的模型不仅能提取关键症状,还能根据最新的诊疗指南给出建议,成为医生的得力助手。

4.2 金融科技:风控与投顾的个性化

金融机构利用微调技术,将内部的历史交易数据、风控规则注入模型。这使得 AI 能够更精准地预测潜在的欺诈行为,并根据不同客户的风险偏好,生成个性化的理财建议报告,其合规性和专业性远超通用模型。

4.3 影视娱乐:AI 演员的“灵魂”注入

2026 年,"AI 演员上岗”成为热点。耀客传媒签约的 AI 数字艺人秦凌岳、林汐颜,其背后的核心技术之一就是微调。除了超写实建模,团队通过对大量表演数据、微表情数据进行微调,赋予了 AI 角色独特的情感表达方式和表演风格。爱奇艺 CEO 龚宇曾透露,首部全 AI 生成的商业剧集即将面世,其中角色的情感细腻度正是得益于深度的模型微调。

4.4 智能制造:扎根车间的“老师傅”

顺应“十五五”规划,制造业正推动算力、算法、数据三大要素协同。通过将设备维修日志、操作手册、故障案例进行微调,工厂拥有了懂“行话”的 AI 助手。它能实时分析传感器数据,预测设备故障,并指导工人进行精准维修,真正让数智化能力扎根车间。

第五章:避坑指南与未来展望

5.1 常见误区

- 数据越多越好?错。低质量的海量数据会污染模型,少量高质量数据往往效果更好。

- 微调能解决所有问题?不是。如果模型缺乏基础的世界知识(例如不知道某个刚发生的新闻),微调也无能为力,这时需要结合 RAG(检索增强生成)技术。

- 忽视安全性:微调数据若包含偏见或有害信息,模型会全盘吸收。必须进行严格的安全对齐(Alignment)。

5.2 未来趋势:自动化与多模态

展望未来,Fine-tuning将呈现以下趋势:

- Auto-Fine-tuning:自动化平台将自动推荐最佳超参数、自动清洗数据,让微调像“一键安装”一样简单。

- 多模态深度融合:不仅仅是文本,针对视频、3D 模型、音频的微调将成为常态,支撑元宇宙和数字人产业的爆发。

- 端侧微调:随着手机和边缘设备算力的提升,用户可以在本地设备上对个人助手进行隐私安全的微调,数据不出域。

结语:让 AI 真正为你所用

Fine-tuning(微调)不仅仅是一项技术手段,它是大模型时代的一种新思维。它告诉我们,不需要每个人都去造轮子(训练基座模型),而是要学会如何利用现有的强大轮子,装上适合自己的轮胎(微调),驶向特定的目的地。

在 2026 年这个“人工智能+"深度赋能实体经济的关键年份,无论是个人开发者想要打造专属聊天机器人,还是企业希望构建行业解决方案,掌握微调技术都意味着掌握了通往“定制化 AI"的钥匙。当通用模型经过你的精心调教,变成了懂你业务、说你所想、解你所难的行业专家时,人工智能的真正价值才算被完全释放。

别再让大模型“学废了”,从今天开始,用高质量的数据和科学的微调方法,开启你的 AI 专家养成计划吧!

参考资料与信息源

- 证券时报. (2026, March 23). 三大要素协同赋能 让“人工智能+"扎根田间车间.

- 知乎专栏 - 人工智能. (2026, February 12). 5 分钟搞懂 LLM 微调:从原理到实战.

- TechCrunch CN. (2026, January 22). AI 大模型微调完全指南:从原理到实践.

- 机器之心. (2026, February 4). 大模型太“通用”?一文搞懂模型微调.

- InfoQ. (2026, January 17). 什么是微调?大模型定制化的核心技术与实操指南.

- CSDN. (2026, January 23). 大模型微调完全指南:原理、实践与平台选择.

- 36Kr. (2026, January 30). 给大模型“开小灶”:一文读懂微调原理与实战.

- Variety China. (2026, March 23). AI 演员驱动影视智能化革新:耀客传媒官宣数字艺人.

- Hugging Face Blog. (2026, February 8). Don't Let Large Models "Learn Badly": From Data Cleaning to Parameter Tuning.

- GitHub - Microsoft LoRA Repository. (2026, March 20). Latest Updates on PEFT and Fine-tuning Techniques.