LangChain 是什么?从原理到实战,一文搞懂大模型应用开发入门必看

LangChain 是什么?这是 2026 年每一位想要踏入 AI 应用开发领域的工程师、产品经理甚至创业者,脑海中首先蹦出的问题。如果说大语言模型(LLM)是拥有超强算力的“大脑”,那么 LangChain 就是让这个大脑长出“手脚”、拥有“记忆”并能与真实世界交互的“神经系统”。

时间来到 2026 年 3 月,距离 LangChain 1.0 正式版发布已过去近半年。这半年间,AI 行业发生了翻天覆地的变化:从单纯的对话框聊天,进化到了能够自主规划、长期运行并处理复杂工作流的 Long-Horizon Agents(长程智能体)。微信推出了官方"ClawBot"插件连接 OpenClaw 硬件,钉钉发布了能沉淀声音资产的 A1 设备,而这一切背后的核心逻辑,往往都离不开像 LangChain 这样的编排框架。

本文将带你从零开始,深入剖析 LangChain 的核心原理,结合 2026 年最新的 1.0 架构特性,通过实战案例,手把手教你构建企业级 AI 应用。无论你是刚入门的开发者,还是寻求技术突破的资深架构师,这篇文章都将成为你案头必备的实战指南。

一、LangChain 的本质:为什么大模型需要“胶水”?

在 2023 年之前,大模型主要被当作一个“文本生成器”。你输入一段话,它返回一段话。这种模式在处理创意写作或简单问答时表现出色,但在面对企业级复杂需求时,却显得力不从心:

- 数据滞后性:模型训练截止于过去,不知道今天的股市行情或公司内部最新的会议纪要。

- 缺乏私有数据:模型无法访问企业内部的 SQL 数据库、PDF 文档或私有 API。

- 无法执行动作:模型不能直接帮你发送邮件、调用打印机或控制物联网设备。

- 上下文限制:面对超长对话,模型容易“遗忘”早期的关键信息。

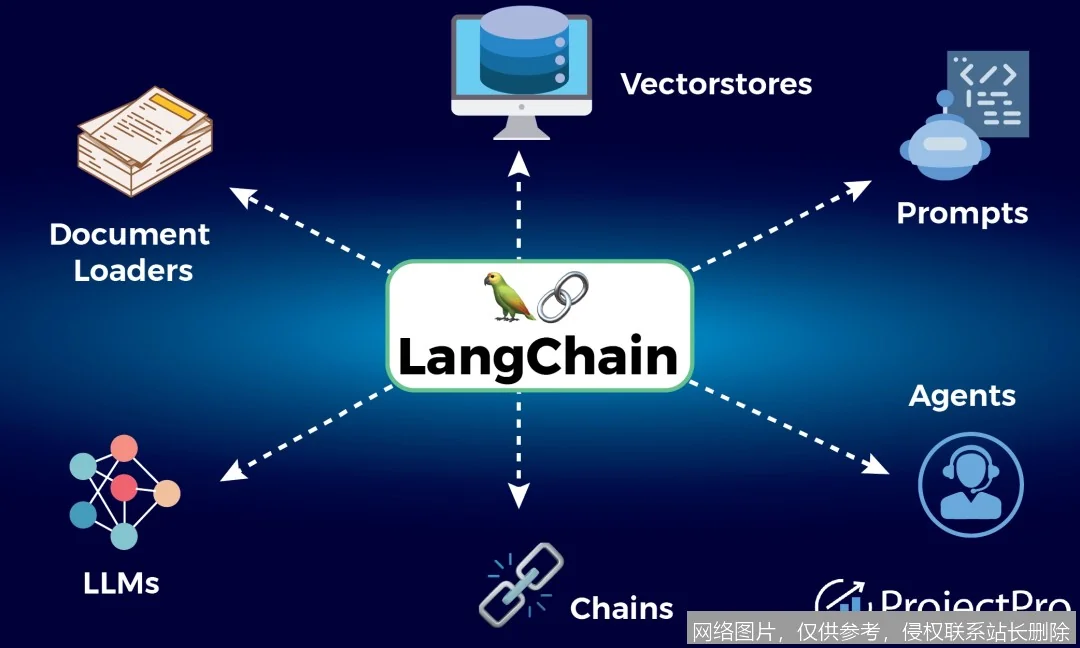

这就是 LangChain 诞生的意义。它的核心定位是 大模型应用的“胶水框架”。它通过标准化的接口和模块化组件,将大模型(如 GPT-4o、Claude 3.5、Qwen-Max 等)与外部系统(文档、数据库、API、硬件工具)无缝串联。

用一句通俗的话概括:LangChain 让大模型从“孤立的文本生成器”变成了“能自主决策、交互、解决复杂问题的智能体(Agent)”。

1.1 2026 版 LangChain 1.0 的重大变革

根据 2025 年 10 月发布的官方公告及 2026 年初的行业反馈,LangChain 1.0 并非简单的增量更新,而是一次彻底的“推倒重来”。相较于已被视为淘汰版本的 0.3 系列,1.0 版本带来了三大核心突破:

- 极致的轻量化(Lightweight):新架构大幅降低了内存与显存占用,使其能够轻松部署在边缘设备(如微信插件连接的 OpenClaw“小龙虾”硬件)上,实现了真正的端侧智能。

- 动态模型切换:内置了智能路由机制,可根据任务复杂度自动选择低成本或高性能模型。例如,简单的分类任务调用本地小模型,复杂的推理任务自动切换至云端大模型,显著降低企业成本。

- 原生兼容国内生态:新版适配器严格遵循 OpenAI 标准协议,完美兼容硅基流动、DeepSeek、智谱 AI 等国内第三方服务商,彻底解决了国内开发者访问受限的痛点。

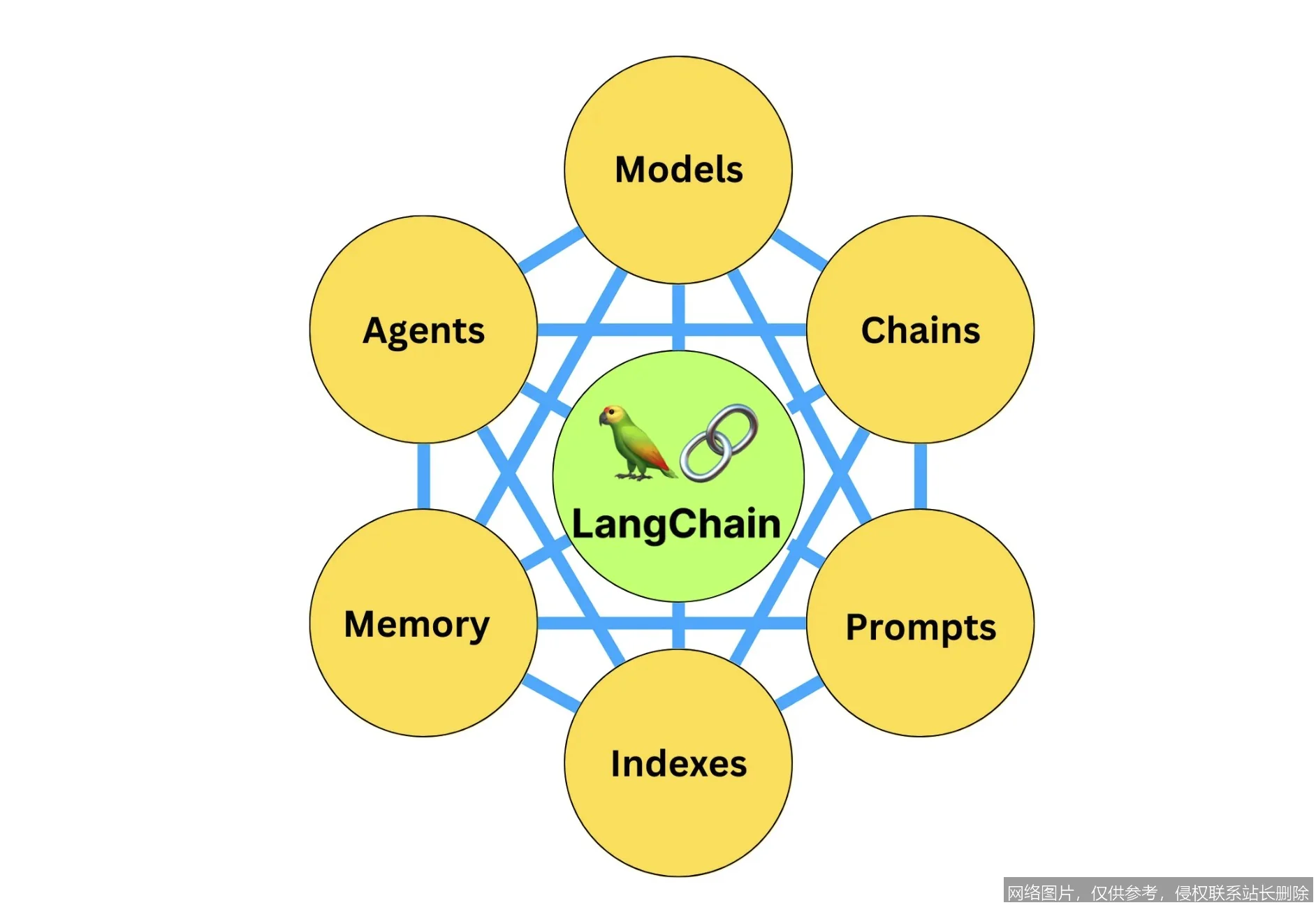

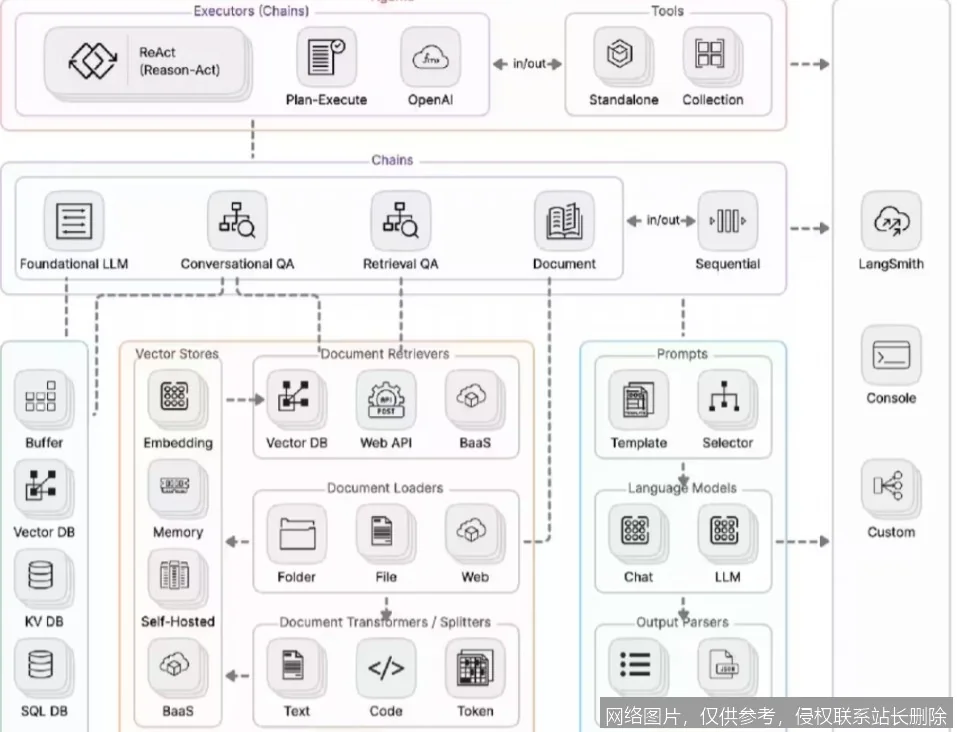

二、核心架构拆解:LangChain 的六大金刚

LangChain 的强大之处在于其高度的模块化设计。开发者可以像搭积木一样,按需组合功能。在 2026 年的企业级开发中,以下六个核心模块构成了应用的基石:

2.1 Model I/O(模型输入输出):统一的交互入口

这是连接大模型的“咽喉”。无论后端使用的是 OpenAI、Anthropic 还是国内的通义千问,LangChain 都提供了统一的调用接口。

- Models(模型调用):屏蔽不同厂商 API 的差异。你只需更改配置参数,即可在 GPT-4o 和 Qwen-Max 之间无缝切换。

- Prompts(提示词工程):提供

PromptTemplate和ChatPromptTemplate,将提示词模板化、版本化。不再需要在代码中硬编码长长的指令,而是通过变量动态注入上下文。 - Output Parsers(输出解析):大模型输出的通常是自然语言,而程序需要结构化数据(如 JSON)。Output Parsers 能强制模型按指定格式输出,并自动解析为 Python 对象,极大减少了报错率。

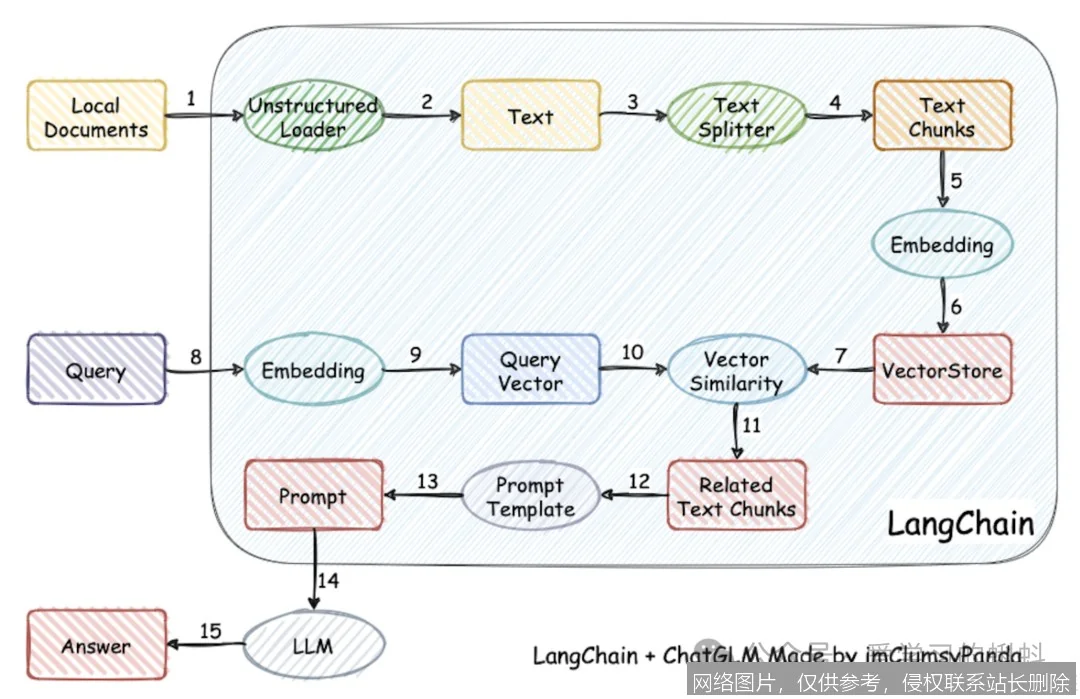

2.2 Retrieval(检索增强生成 RAG):赋予模型“外脑”

这是目前企业落地最广泛的场景。通过 RAG 技术,LangChain 能让模型“阅读”你的私有数据。

其工作流程通常包括:

- 数据加载(Document Loaders):支持读取 PDF、Word、CSV、Notion、GitHub 甚至微信聊天记录等数百种数据源。

- 文本分割(Text Splitters):将长文档切分成适合模型处理的小片段,同时保留语义完整性。

- 向量存储(Vector Stores):将文本片段转化为向量,存入 Chroma、Faiss、Milvus 或 Pinecone 等向量数据库中。

- 检索器(Retrievers):当用户提问时,从向量库中检索最相关的片段,作为上下文喂给大模型。

实战价值:某制造企业利用此模块,将上千页的设备维修手册导入系统。当一线工人询问“注塑机报警代码 E03 如何处理”时,AI 能精准定位手册中的对应章节并给出步骤,准确率提升至 98%。

2.3 Chains(链):串联复杂逻辑

单个模型调用往往不足以解决复杂问题。Chain 允许我们将多个步骤串联起来。例如:先检索文档 -> 再总结摘要 -> 最后翻译成英文 -> 发送邮件。这一系列操作可以封装为一个 Chain,一键执行。

2.4 Agents(智能体):自主决策的大脑

这是 LangChain 最迷人的部分。Agent 不仅仅是执行预设流程,它具备 推理 和 规划 能力。

Agent 的核心循环是:思考(Thought) -> 行动(Action) -> 观察(Observation)。

- 用户提问:“查询上周北京的销售数据,并对比上海,生成报表。”

- Agent 思考:“我需要先调用销售数据库工具查北京数据,再查上海数据,然后调用绘图工具生成图表。”

- Agent 行动:依次调用工具。

- Agent 观察:获取工具返回的结果。

- 最终回答:整合所有信息,生成最终报表。

在 2026 年,随着 LangGraph 的成熟,Agent 的能力进一步进化,支持循环控制、多智能体协作(Multi-Agent)以及复杂的状态管理,能够处理长达数小时甚至数天的长程任务(Long-Horizon Tasks)。

2.5 Memory(记忆):让对话有连续性

大模型本身是无状态的。Memory 模块负责存储历史对话信息。除了基础的 ConversationBufferMemory,新版 LangChain 还支持 向量记忆,能够从海量历史对话中检索出与当前话题最相关的片段,实现真正的“长期记忆”。

2.6 Callbacks(回调):可观测性与调试

在企业级应用中,黑盒是不可接受的。Callbacks 允许开发者监控 LLM 的每一次调用、Token 消耗、延迟时间以及中间步骤的输出。这对于成本控制、性能优化和故障排查至关重要。

三、实战演练:5 分钟构建一个“企业知识库助手”

理论再多,不如代码一行。下面我们将使用 LangChain 1.0 的最新语法,构建一个简单的 RAG 应用。假设我们有一份名为 company_policy.pdf 的公司员工手册,我们要让 AI 基于此手册回答员工问题。

3.1 环境准备

首先,安装必要的库(2026 年推荐配置):

pip install langchain langchain-community langchain-huggingface chromadb pypdf3.2 代码实现

以下是核心代码逻辑,展示了从加载数据到问答的全流程:

from langchain_community.document_loaders import PyPDFLoader

from langchain_text_splitters import RecursiveCharacterTextSplitter

from langchain_huggingface import HuggingFaceEmbeddings

from langchain_community.vectorstores import Chroma

from langchain.chains import create_retrieval_chain

from langchain.chains.combine_documents import create_stuff_documents_chain

from langchain.prompts import ChatPromptTemplate

from langchain_community.llms import Tongyi # 以阿里云通义千问为例

# 1. 加载文档

loader = PyPDFLoader("company_policy.pdf")

docs = loader.load()

# 2. 分割文本 (保持语义完整)

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

splits = text_splitter.split_documents(docs)

# 3. 创建向量索引 (使用本地 Embedding 模型,保护隐私且免费)

embeddings = HuggingFaceEmbeddings(model_name="shibing624/text2vec-base-chinese")

vectorstore = Chroma.from_documents(documents=splits, embedding=embeddings)

# 4. 初始化大模型 (兼容国内接口)

llm = Tongyi(model_name="qwen-max", temperature=0.7)

# 5. 构建提示词模板

template = """基于以下已知信息,简洁和专业地回答用户的问题。如果无法从中得到答案,请说“根据已知信息无法回答该问题”,不要编造答案。

已知信息:{context}

问题:{question}

"""

prompt = ChatPromptTemplate.from_template(template)

# 6. 创建检索链

retriever = vectorstore.as_retriever(search_kwargs={"k": 3})

combine_docs_chain = create_stuff_documents_chain(prompt, llm)

rag_chain = create_retrieval_chain(retriever, combine_docs_chain)

# 7. 执行问答

response = rag_chain.invoke({"input": "公司关于远程办公的具体规定是什么?"})

print(response["answer"])

代码解析:

- 兼容性:代码中使用了

Tongyi类,展示了如何轻松接入国产大模型,无需修改核心逻辑。 - 本地化:Embedding 模型使用了 HuggingFace 上的开源中文模型,确保数据不出内网,符合企业安全合规要求。

- 防幻觉:Prompt 模板中明确指令“不要编造答案”,这是企业应用中最关键的约束之一。

四、进阶趋势:从 LangChain 到 LangGraph,迈向 Agent OS

如果说传统的 Chain 是线性的流水线,那么 2026 年爆发的 LangGraph 则是构建复杂智能体的操作系统(Agent OS)。

红杉资本在 2026 年初的对话中指出,AI 正在告别简单的对话框,步入 Long-Horizon Agents(长程智能体) 元年。这类智能体需要处理跨越数天、涉及多个步骤和人工介入的复杂任务。传统的线性 Chain 无法胜任,而基于图论(Graph Theory)的 LangGraph 应运而生。

4.1 LangGraph 的核心优势

- 状态管理(State Management):显式定义智能体的内部状态(如:待办列表、已收集信息、当前步骤),支持状态的持久化和更新。

- 循环与分支(Cycles & Branches):允许智能体在执行失败时自我修正(循环),或根据条件判断选择不同的执行路径(分支)。

- 人机协作(Human-in-the-loop):在关键决策点暂停,等待人类确认后再继续执行。这在金融审批、医疗诊断等高风险场景中不可或缺。

- 多智能体协作:可以轻松构建由“研究员”、“撰稿人”、“审核员”等多个角色组成的智能体团队,共同完成一篇深度报告。

4.2 未来展望:文件权限与异步协作

根据最新的技术洞察,2026 年的 Agent 突破将围绕两点:

- 文件系统权限标配化:未来的 Agent 将直接拥有对本地文件系统的读写权限,能够自主创建文件、整理文件夹,真正成为员工的数字助理。

- 异步管理与同步协作的统一:理想的交互不再是“你问我答”,而是用户下达一个模糊目标(如“策划下周的团建”),Agent 在后台异步运行数小时,期间自主搜索场地、协调人员时间、生成方案,最后在适当时机同步给用户确认。

五、常见误区与避坑指南

在实际落地过程中,许多开发者容易陷入以下误区:

5.1 误区一:过度依赖 Prompt 工程

真相: Prompt 很重要,但不是万能的。对于逻辑复杂、需要精确计算或大量事实依据的任务,必须结合 Tool Use(工具调用) 和 RAG。试图仅靠 Prompt 让模型做数学题或查询实时库存,注定会失败。

5.2 误区二:忽视成本与延迟

真相:在企业生产中,每一秒延迟和每一个 Token 都是成本。务必利用 LangChain 的 动态模型路由 功能,简单任务用小模型,复杂任务用大模型。同时,合理使用缓存(Cache)机制,避免重复计算。

5.3 误区三:忽略数据安全

真相:将敏感数据直接发送给公有云大模型存在泄露风险。对于高敏感场景,应优先选择 本地部署开源模型(如 Llama 3、Qwen)配合 LangChain,或使用通过隐私认证的私有云服务。

六、结语:拥抱智能体时代

从 2023 年的概念萌芽,到 2026 年的全面爆发,LangChain 已经从一个实验性的 Python 库,成长为构建 AI 原生应用的事实标准。它不仅降低了开发门槛,更重要的是,它提供了一套标准化的方法论,让我们能够系统地思考如何将大模型的能力转化为实际的生产力。

无论是微信里的“龙虾”插件,还是工厂里的智能质检员,亦或是写字楼里的自动化销售助理,它们的背后都有 LangChain 的身影。对于开发者而言,掌握 LangChain 不仅仅学会了一个框架,更是掌握了通往 AI Agent 时代 的钥匙。

在这个技术迭代以周为单位计算的时代,唯一不变的就是变化本身。但请记住,无论底层模型如何更迭,连接、编排、记忆、规划 这些核心逻辑将长久存在。现在,就打开你的编辑器,用 LangChain 写下你的第一个智能体应用吧!

参考资料与信息源

- IT 之家 - 《IT 早报 0323:微信发布官方“龙虾”插件;国家互联网应急中心等发布 OpenClaw 安全使用实践指南》 (2026 年 3 月 23 日). 链接

- 新浪科技 - 《不炫技、不制造幻觉:一款 AI 硬件如何扎根中国职场?》 (2026 年 3 月 23 日). 链接

- B 站/社区教程 - 《【2026 版】这可能是 B 站唯一将 LangChain1.0 入门到实战讲明白的教程》 (2026 年 1 月 13 日发布). 链接

- CSDN/技术博客 - 《LangChain 指南:打造 LLM 的垂域 AI 框架》 (2026 年 2 月 18 日). 链接

- 重庆日报 - 《早安,重庆 | 2026 年重庆首批"AI+ 制造”场景需求清单发布》 (2026 年 3 月 23 日). 链接

- 知乎/技术专栏 - 《OpenClaw 才是真正的 Agent-OS!2026.3.1 升级深度拆解》 (2026 年 3 月 5 日). 链接

- GitHub/LangChain 官方文档归档 - 《大模型应用开发框架 LangChain 核心定位与核心价值》 (2025 年 11 月 16 日发布). 链接

- 掘金/技术社区 - 《AI 大模型工程师必知必会之企业级 Agent 开发实战!2026 最新版 (Langchain+LangGraph)V1.0 版本》 (2026 年 1 月 12 日). 链接

- 科创板日报 - 《小 K 播早报 | 工信部部长:推动量子科技、生物制造等领域攻关突破》 (2026 年 3 月 23 日). 链接

- 红杉资本官方博客 - 《红杉对话 LangChain 创始人:2026 年 AI 告别对话框,步入 Long-Horizon Agents 元年》 (2026 年 1 月 27 日收录). 链接