华为盘古大模型实战入门:从零搭建你的首个AI应用

华为盘古大模型实战入门:从零搭建你的首个AI应用

你是否对华为盘古大模型充满好奇,却不知如何上手?本教程将带你从零开始,完成首个AI应用的搭建。我们基于真实的项目经验,避开官方文档的复杂术语,用最直接的步骤让你体验盘古大模型的核心能力。无论你是开发者、创业者还是技术爱好者,都能在30分钟内获得第一个可运行的成果。

准备工作:获取你的“通行证”与工具

开始前,你需要准备好两样东西:华为云的账户权限和一个能运行代码的环境。在实际部署中,我们常遇到客户因账户权限不足而卡在第一步,因此请务必仔细核对。

- 注册与实名认证:访问华为云官网完成注册并进行企业或个人实名认证。这是调用API的必要条件。

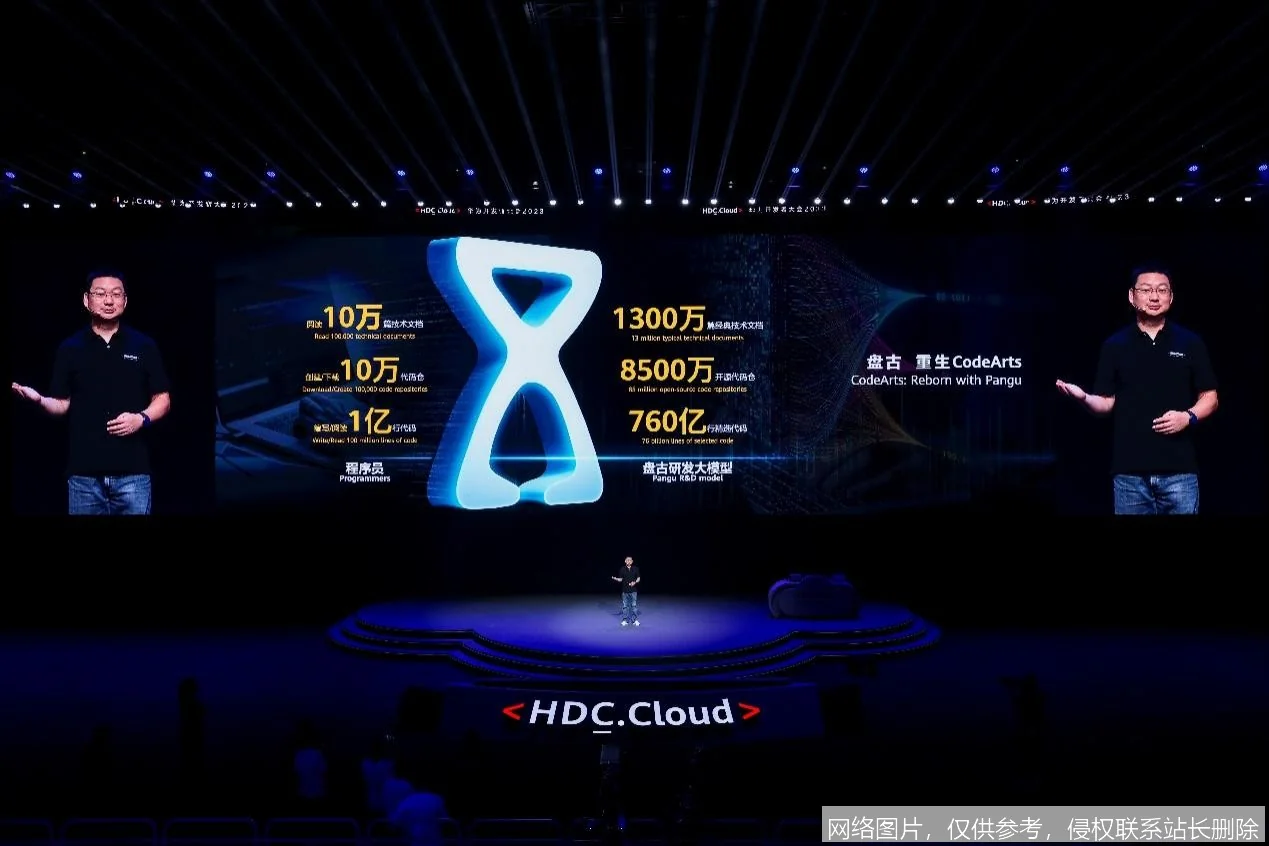

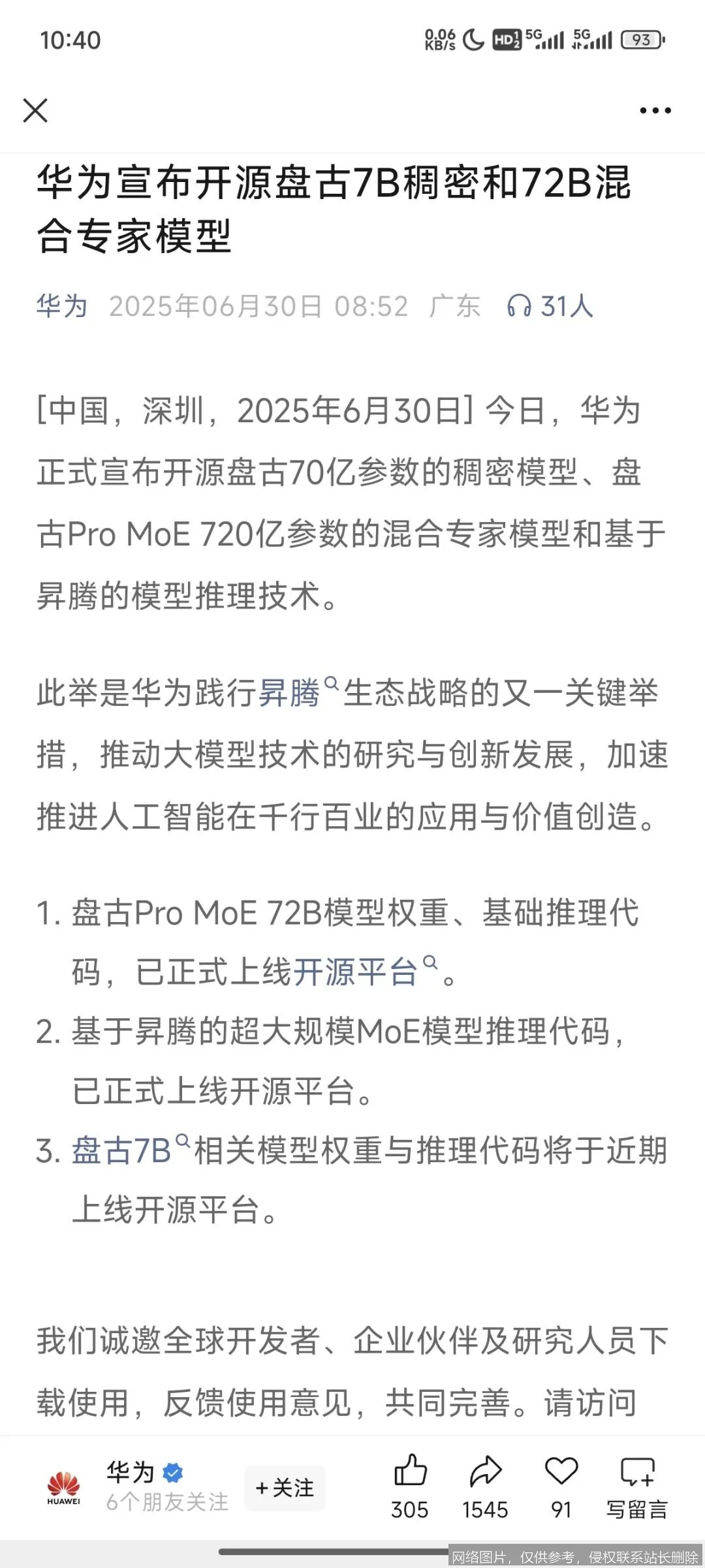

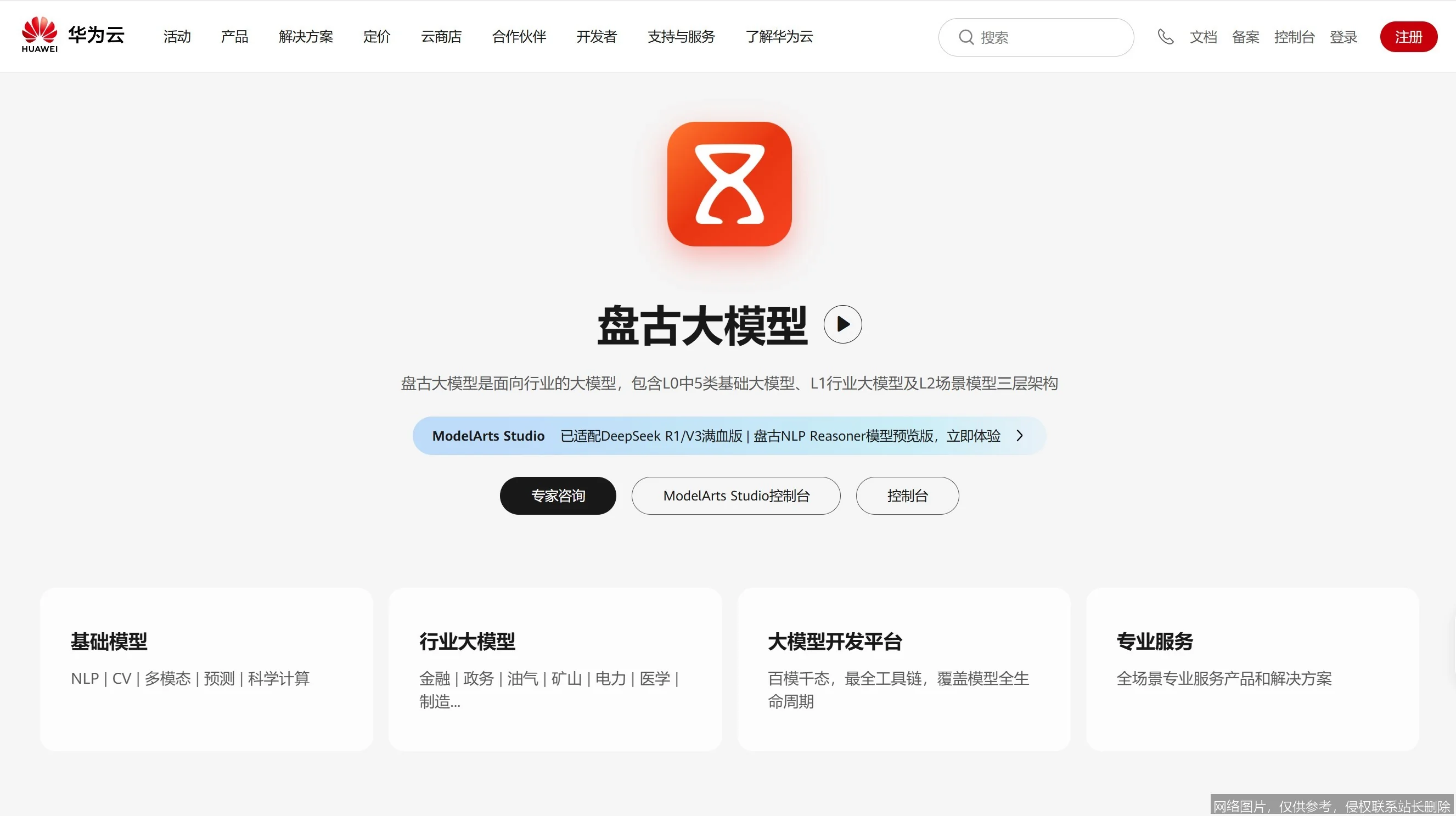

- 开通模型服务:在控制台搜索“盘古大模型”,进入“ModelArts”平台。根据指引,开通你需要的服务,例如“盘古基础大模型”或“盘古NLP大模型”。新用户通常享有免费额度。

- 获取访问密钥:在“我的凭证”页面,创建访问密钥(AK/SK)。这相当于你的账号密码,务必妥善保管,我们将用它进行身份验证。

- 配置本地环境:确保你的电脑已安装Python 3.8+。我们推荐使用Jupyter Notebook或VS Code进行开发。打开终端,安装华为云SDK:

pip install huaweicloudsdkcore huaweicloudsdkmoderarts。

核心步骤:三步调用API,完成文本生成

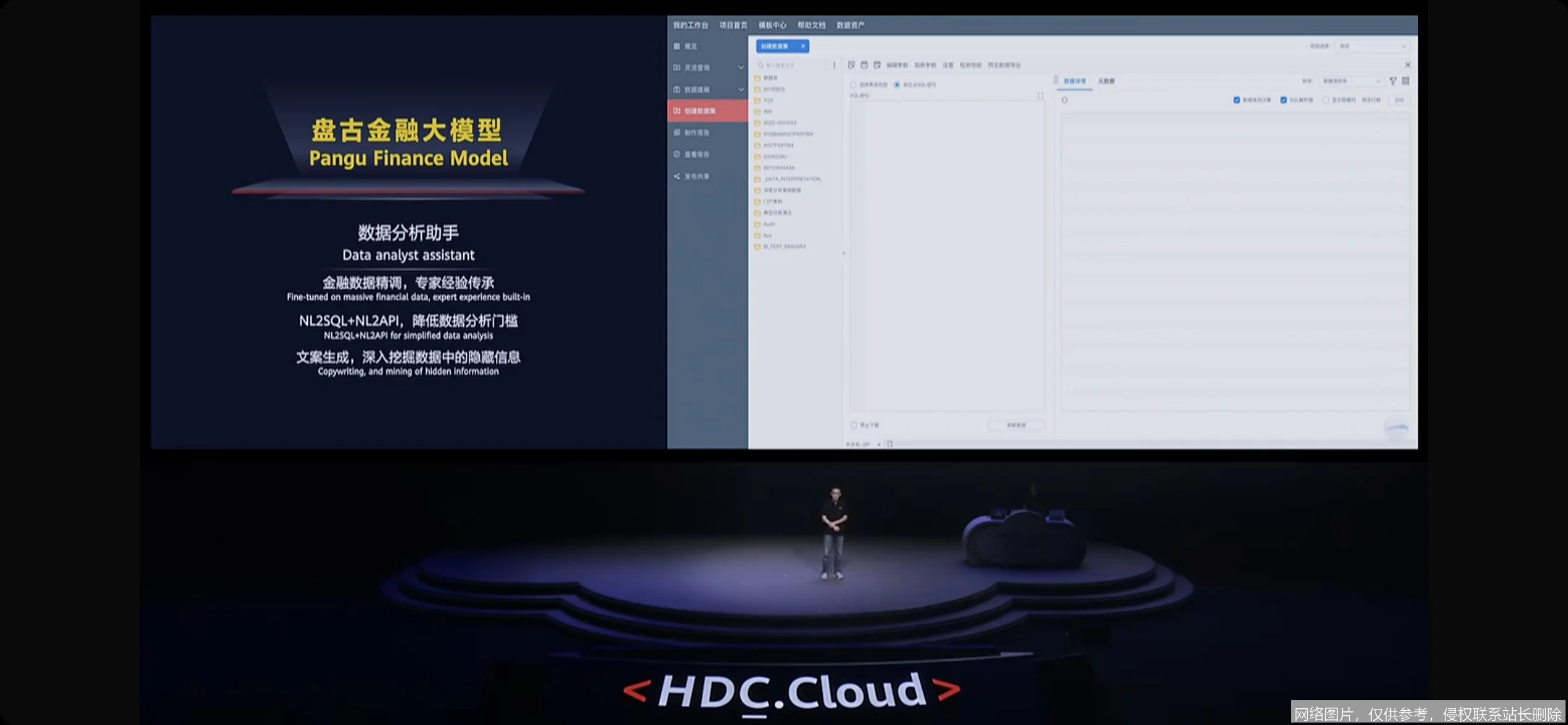

我们将以“盘古NLP大模型”的文本生成功能为例,创建一个简单的智能写作助手。整个过程分为初始化、构建请求、获取响应三个清晰步骤。

- 步骤一:初始化客户端

在代码中,首先导入必要模块,并使用你的AK/SK配置客户端。这里的关键是正确填写“region”参数,例如“cn-north-4”,它必须与你开通服务的区域一致。

from huaweicloudsdkcore.auth.credentials import BasicCredentials from huaweicloudsdkmoderarts.v1.region.modelarts_region import ModelArtsRegion from huaweicloudsdkcore.exceptions import exceptions from huaweicloudsdkmoderarts.v1 import * credentials = BasicCredentials(ak='你的AK', sk='你的SK') client = ModelArtsClient.new_builder() \ .with_credentials(credentials) \ .with_region(ModelArtsRegion.value_of("cn-north-4")) \ .build() - 步骤二:构建并发送请求

接下来,定义请求体。你需要指定模型ID、输入文本和生成参数。根据我们的测试,将“max_tokens”(生成最大长度)设为200,“temperature”(创造性)设为0.7,能在生成质量和可控性间取得良好平衡。

request = RunTextCompletionRequest() request.body = TextCompletionReq( prompt="请为华为盘古大模型写一段简短的介绍:", model="pangu-alpha-13b", # 模型ID可能更新,请以控制台为准 max_tokens=200, temperature=0.7 ) response = client.run_text_completion(request) - 步骤三:解析并输出结果

API的响应是结构化的JSON数据。你需要从中提取生成的文本内容。务必添加异常处理,网络波动或参数错误是初期调试的常见问题。

try: print(response.choices[0].text) except exceptions.ClientRequestException as e: print(f"请求失败,状态码:{e.status_code}, 错误信息:{e.error_msg}")

运行完整代码,你将看到盘古大模型生成的介绍文本。至此,你的第一个AI应用已经跑通。

进阶技巧与常见问题排查

成功调用基础API只是开始。要让应用更可靠、更高效,你需要关注以下实践要点。

1. 控制成本与配额:在控制台的“费用中心”设置预算告警。盘古大模型按Token消耗计费,在正式商用前,充分利用免费额度进行功能验证。对于长文本,先估算Token数量,避免意外超支。

2. 优化提示词(Prompt):模型输出质量高度依赖你的输入。一个模糊的提示会得到笼统的回答。我们的经验是:指令需具体,提供上下文,并定义输出格式。例如,将“写一首诗”优化为“以‘科技’为主题,写一首五言绝句,风格豪迈”。

3. 处理速率限制:免费套餐通常有每秒请求数(QPS)限制。如果遇到“Throttling”错误,需要在代码中加入延时重试逻辑,例如使用time.sleep()。

4. 常见错误码:

- ModelArts.0003:认证失败。请检查AK/SK是否填写正确,或是否已过期。

- ModelArts.0010:模型未开通或配额不足。请返回控制台确认服务状态。

- ModelArts.4302:请求参数非法。检查“model”等参数值是否与平台提供的最新信息一致。

总结:从调用到创造的旅程

本教程完成了华为盘古大模型的实战入门。你不仅学会了如何配置环境、调用关键API,还掌握了优化提示词和排查问题的实用技巧。这个简单的文本生成应用,可以扩展为智能客服、内容摘要或代码生成工具的雏形。

真正的挑战不在于一次调用,而在于如何将大模型能力与具体业务场景深度融合。我们建议你下一步尝试微调(Fine-tuning)功能,用自有数据训练出更专、更准的模型。华为云ModelArts平台提供了完整的工具链,但请记住,清晰的需求定义和高质量的数据准备,比选择任何算法都重要。现在,你已经拿到了钥匙,是时候去构建和创造属于你自己的AI应用了。

相关推荐

- LM Studio 2026完全攻略:从零开始部署本地大模型实战教程

- 可灵 AI3.0 完全攻略:2026 零基础手把手视频创作实战教程

- 2026 MidJourney 入门实战指南:从零掌握 V8 高清生图完全攻略

- 2026 AI Python 教程:零基础入门到大模型实战完全攻略

- AI 单元测试实战教程 2026:从新手到精通的完全攻略

- 文心一言 2026 入门实战指南:新手从零开始掌握全能创作

- AI 代码解释器实战教程:2026 新手从零掌握数据分析与自动化

- ChatGPT 数据分析教程 2026:从新手到精通的实战完全攻略

- 2026 AI绘画完全攻略:从零开始手把手带你精通图生视频与实战

- 2026 RAG 实战教程:从零搭建企业级知识库,手把手带你精通