LM Studio 2026完全攻略:从零开始部署本地大模型实战教程

开篇介绍

LM Studio 是一款革命性的本地大模型运行工具,它让普通用户无需编写代码、无需配置复杂的服务器环境,即可在个人电脑上流畅部署和运行如 Llama 3、Qwen 等主流开源大模型。无论是进行离线隐私对话、本地知识库构建,还是开发者进行模型微调测试,它都是首选方案。通过本教程,你将彻底掌握从软件下载、模型加载到参数调优的全流程,真正拥有属于自己的"2026 级”本地 AI 助手。

前置准备

在开始实战之前,请确保完成以下基础准备工作,这将决定后续运行的流畅度:

- 硬件环境要求:建议配备至少 16GB 内存(运行 7B 模型)或 32GB 以上内存(运行更大模型),显卡推荐使用支持 CUDA 的 NVIDIA 显卡(显存 8GB 起步),若仅使用 CPU 推理,速度会相对较慢但依然可行。

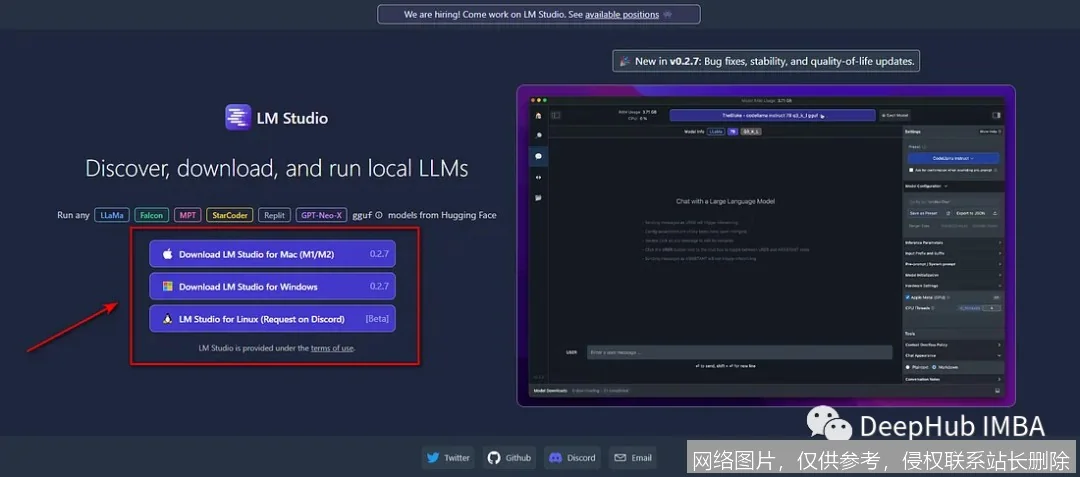

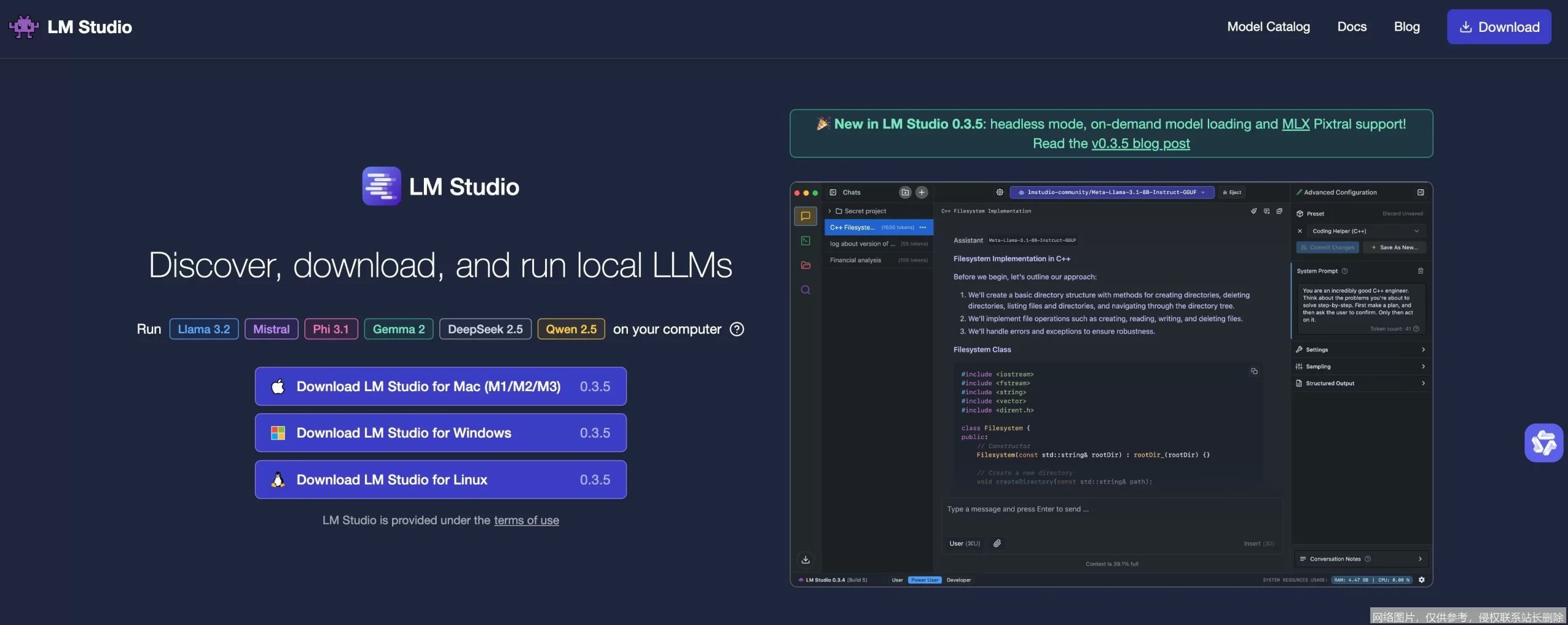

- 软件获取:访问 LM Studio 官网下载最新正式版安装包,目前无需注册账号即可免费使用所有核心功能。

- 前置知识:了解基本的“量化”概念(即模型压缩技术,如 Q4_K_M 代表 4bit 量化),这有助于你在下载时选择合适的模型体积与精度平衡点。

- 网络环境:由于模型文件较大且部分源在海外,建议确保网络连接稳定,或使用加速工具以提升模型下载速度。

步骤详解

第一步:安装与界面初探

下载完成后,双击安装包按照默认指引完成安装。首次启动时,软件会自动检测你的硬件配置(GPU/CPU)。注意:若检测到独立显卡但未启用,请在设置中手动开启 GPU Offload 选项。主界面左侧为功能导航栏,包含搜索、聊天、本地服务器等模块,右侧为实时日志监控区,用于观察模型加载状态。

预期结果:软件成功启动,底部状态栏显示当前可用的显存容量及 GPU 加速已就绪。

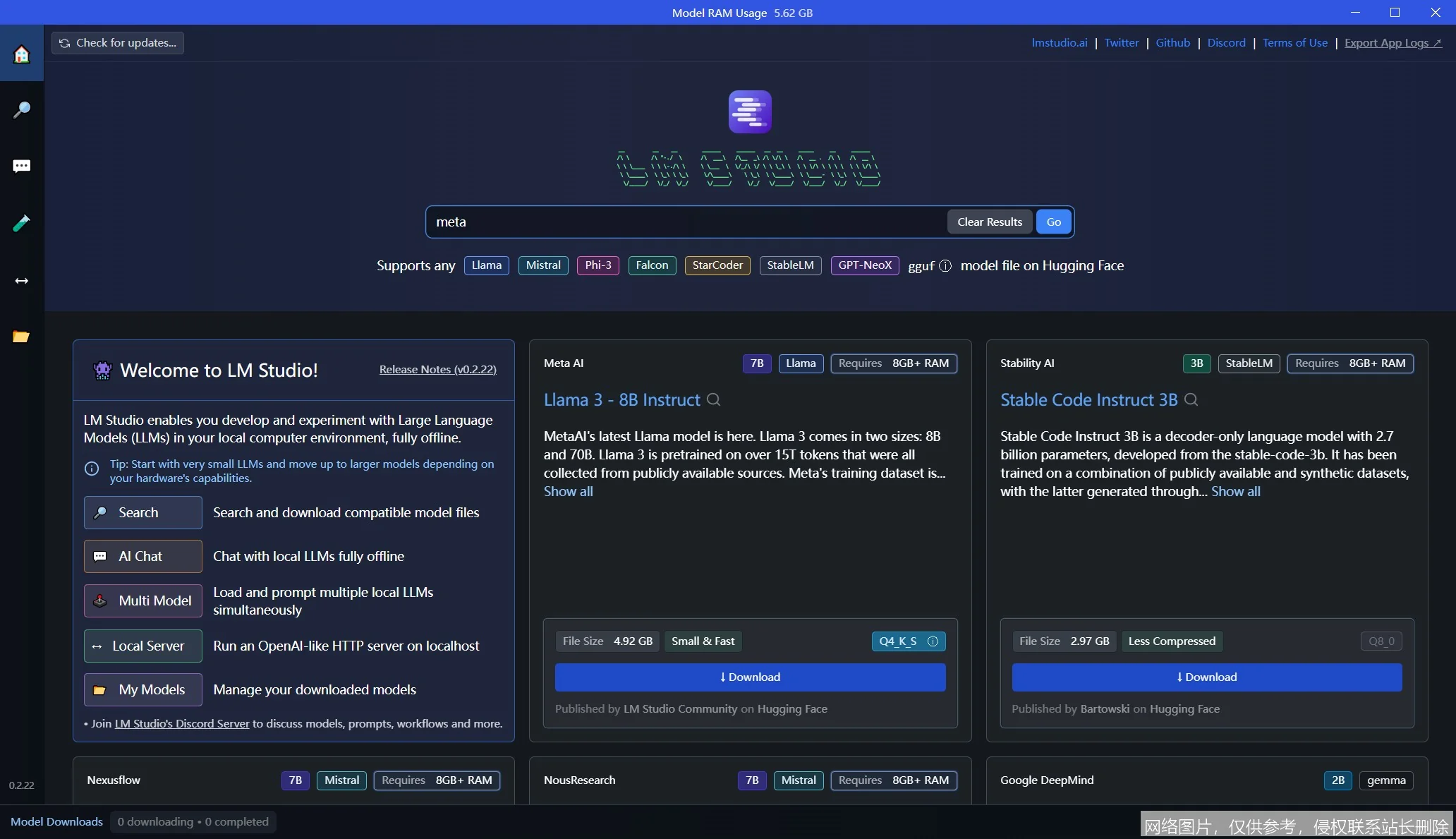

第二步:搜索并下载模型

点击左侧放大镜图标进入搜索页。在搜索框输入模型名称,例如llama-3-8b或qwen-2.5。搜索结果会列出不同量化版本的模型文件。对于大多数用户,推荐选择带有Q4_K_M或Q5_K_M后缀的文件,它们在精度和速度之间取得了最佳平衡。点击下载按钮,等待进度条完成。

关键点:关注文件大小,7B 模型的 4bit 量化版通常在 4GB-5GB 左右。切勿下载未量化的 FP16 版本,除非你的显存超过 24GB。

预期结果:模型文件完整下载至本地缓存目录,状态显示为"Ready"。

第三步:加载模型与对话测试

切换至“聊天”标签页,点击顶部中间的模型选择器,选中刚才下载的模型。此时,软件会将模型权重载入显存。加载完成后,右侧日志区会显示"Model loaded successfully"。在对话框输入“你好,请介绍一下你自己”,点击发送。

注意事项:首次生成可能稍慢,属正常现象。若出现显存不足报错,请尝试卸载其他占用显存的程序,或换用更小参数量(如 1.5B/3B)的模型。

预期结果:AI 在数秒内返回流畅、逻辑清晰的中文回复,标志着本地部署成功。

第四步:调整推理参数

在聊天界面右侧的设置面板中,你可以微调模型行为。Temperature(温度值)控制创造性,设为0.7适合日常对话,设为0.2适合严谨问答;Max Tokens限制单次回复长度;Context Length决定模型能记住多长的上下文历史。警告:过大的 Context Length 会急剧增加显存占用,可能导致崩溃。

预期结果:通过调整参数,你能观察到模型回答风格从“刻板”变为“发散”,或从“简短”变为“详尽”。

进阶技巧

想要像专业玩家一样使用 LM Studio?试试以下技巧:首先,利用“本地服务器”功能,点击左侧服务器图标,启动一个兼容 OpenAI API 格式的本地服务。这样,你就可以让任何支持 API 的第三方应用(如笔记软件、自动化脚本)连接到你本地的 LM Studio,实现数据完全私有的自动化工作流。其次,遇到乱码或回答中断时,检查是否勾选了正确的"Chat Template"(对话模板),不同模型家族(如 Llama vs ChatGLM)需要匹配不同的模板才能正常对话。最后,定期清理缓存文件夹,避免下载多个重复版本的模型占用大量磁盘空间。

总结与实践

恭喜你,已完成从环境搭建到参数调优的完整闭环。核心路径为:安装软件→搜索量化模型→加载运行→调整参数。建议你尝试下载不同领域的专用模型(如编程专用、医疗专用)进行对比测试,或尝试搭建本地 API 服务连接其他工具。更多高级玩法可参考 HuggingFace 社区文档及 LM Studio 官方 Discord 频道,开启你的本地 AI 无限可能。

已是最新文章

相关推荐

- LM Studio 2026完全攻略:从零开始部署本地大模型实战教程

- 可灵 AI3.0 完全攻略:2026 零基础手把手视频创作实战教程

- 2026 MidJourney 入门实战指南:从零掌握 V8 高清生图完全攻略

- 2026 AI Python 教程:零基础入门到大模型实战完全攻略

- AI 单元测试实战教程 2026:从新手到精通的完全攻略

- 文心一言 2026 入门实战指南:新手从零开始掌握全能创作

- AI 代码解释器实战教程:2026 新手从零掌握数据分析与自动化

- ChatGPT 数据分析教程 2026:从新手到精通的实战完全攻略

- 2026 AI绘画完全攻略:从零开始手把手带你精通图生视频与实战

- 2026 RAG 实战教程:从零搭建企业级知识库,手把手带你精通