Claude API入门实战:从零上手快速开发

Claude API入门实战:从零上手快速开发

你是否想将Claude强大的对话与推理能力集成到自己的应用里?Claude API正是你需要的工具。它允许开发者直接调用Claude模型,构建智能客服、内容生成或数据分析助手。本教程将带你从零开始,在15分钟内完成首次API调用,并分享我们在实际开发中积累的关键经验。

准备工作:获取你的API密钥

开始编码前,你需要一个有效的API访问凭证。这个过程简单直接,但有几个细节容易出错。

- 访问Anthropic控制台并注册账号。我们建议使用工作邮箱,便于后续团队协作管理。

- 登录后,在左侧菜单找到“API Keys”部分,点击“Create Key”。

- 为密钥命名,例如“我的第一个测试项目”。系统会生成一串以“sk-ant-”开头的密钥。请立即复制并妥善保存,页面关闭后将无法再次查看完整密钥。

- 设置环境变量。在命令行中执行:export ANTHROPIC_API_KEY=‘你的密钥’。这是保护密钥安全的最佳实践,避免将其硬编码在脚本中。

我们曾遇到新手直接将密钥写在代码里并上传至公开仓库,导致密钥泄露和意外扣费。环境变量是必须养成的习惯。

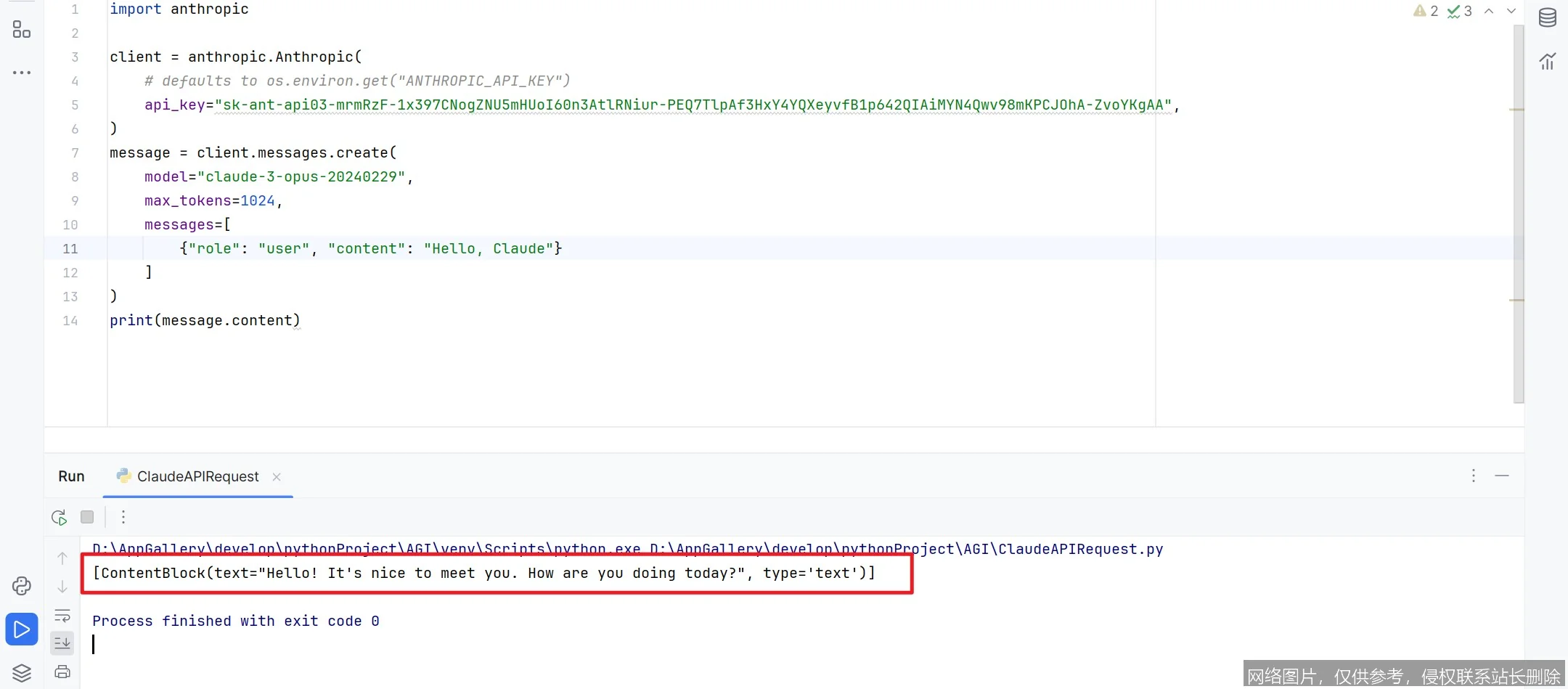

第一步:发起你的第一个API请求

我们将使用Python语言进行演示,这是与Claude API交互最常用的方式之一。请确保你的Python版本在3.8以上。

- 安装官方SDK。在终端运行:pip install anthropic。

- 创建一个新的Python文件,例如

first_call.py,并写入以下基础代码:

```python

import anthropic

client = anthropic.Anthropic(

api_key=‘你的密钥’ # 实际开发中应从环境变量读取

)

message = client.messages.create(

model=“claude-3-haiku-20240307”,

max_tokens=1000,

temperature=0.7,

system=“你是一个乐于助人且简洁的助手。”,

messages=[

{“role”: “user”, “content”: “用一句话介绍你自己”}

]

)

print(message.content)

```

运行这个脚本,你将看到Claude的回复。这里有几个关键参数:model决定了使用的模型版本,Haiku速度快、成本低,适合入门测试;max_tokens限制响应长度;temperature控制回复的随机性(0更确定,1更创意);system指令则设定了AI的固定角色。

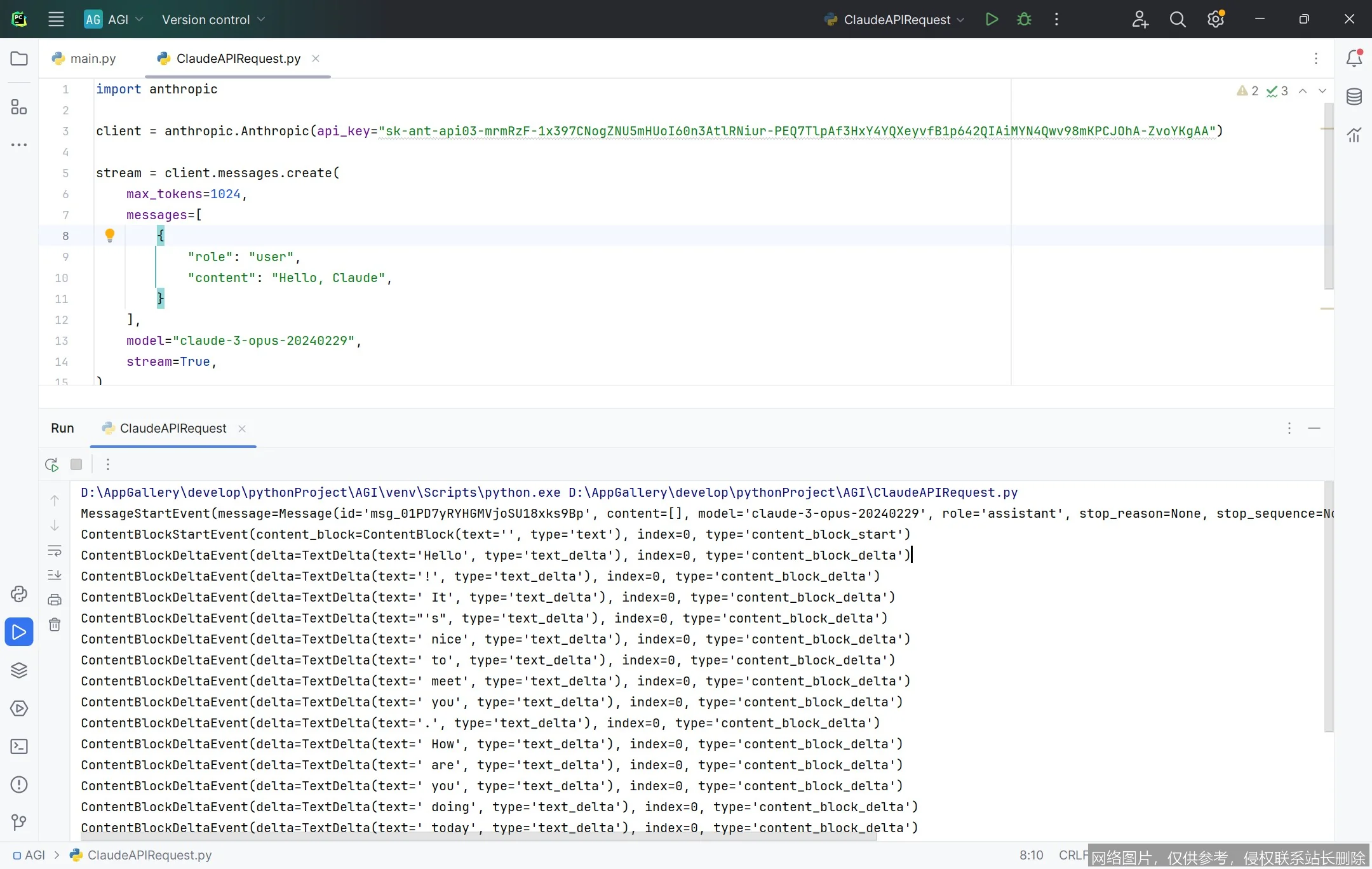

第二步:掌握消息结构与流式响应

Claude API采用结构化消息格式。一个完整的对话是messages列表,其中每个元素都是一个包含role(“user”或“assistant”)和content的字典。API调用总是需要模型基于整个对话历史生成下一个回复。

对于需要长时间处理的请求,等待完整响应可能体验不佳。这时可以使用流式响应,让回复像打字一样实时返回:

```python

stream = client.messages.create(

model=“claude-3-sonnet-20240229”,

max_tokens=1024,

messages=[{“role”: “user”, “content”: “写一首关于春天的短诗”}],

stream=True

)

for event in stream:

if event.type == ‘content_block_delta’:

print(event.delta.text, end=‘’, flush=True)

```

在实际部署中,流式响应能显著提升用户感知速度,尤其适合构建聊天界面。

进阶技巧与常见陷阱

掌握了基础调用后,了解以下经验能帮你避开我们踩过的坑。

1. 上下文长度管理:Claude模型有固定的上下文窗口(例如200K tokens)。你需要自行管理对话历史,确保发送的总tokens数不超过限制。一个常见策略是只保留最近N轮对话或总结之前的历史。

2. 系统提示词设计:system参数是你控制AI行为的最强工具。指令必须清晰具体。与其说“请专业一点”,不如说“你是一位资深软件工程师,用简洁的代码示例和要点列表回答问题”。好的系统提示能将输出质量提升50%以上。

3. 错误处理与重试:网络可能不稳定。你的代码必须包含健壮的错误处理。

```python

import time

from anthropic import APIError

try:

response = client.messages.create(...)

except APIError as e:

if e.status_code == 429:

print(“请求过快,等待后重试...”)

time.sleep(5)

# 重试逻辑

else:

raise e

```

4. 成本控制:API调用按输入和输出的tokens数计费。在开发初期,务必为账户设置使用量限制。监控账单,并使用像Haiku这样的轻量模型进行功能测试。

总结:从调用到集成

至此,你已经完成了Claude API从密钥获取到成功调用的全过程。核心步骤很简单:安装SDK、构建消息、处理响应。真正的挑战在于如何将其稳定、高效、低成本地集成到你的产品逻辑中。

我们建议从一个具体的小功能开始,比如为你的应用添加一个“智能总结”按钮。通过这个Claude API教程入门后,你可以进一步探索工具调用、批量处理等高级功能。现在,打开你的编辑器,用代码与Claude对话吧。每一次实践都会让你更熟悉如何驾驭这项强大的技术。

相关推荐

- 2026 AI 音乐生成入门实战:从零开始手把手创作商用爆款歌曲

- 豆包 2026 完全攻略:从新手入门到精通的全场景实战教程

- LM Studio 2026完全攻略:从零开始部署本地大模型实战教程

- 可灵 AI3.0 完全攻略:2026 零基础手把手视频创作实战教程

- 2026 MidJourney 入门实战指南:从零掌握 V8 高清生图完全攻略

- 2026 AI Python 教程:零基础入门到大模型实战完全攻略

- AI 单元测试实战教程 2026:从新手到精通的完全攻略

- 文心一言 2026 入门实战指南:新手从零开始掌握全能创作

- AI 代码解释器实战教程:2026 新手从零掌握数据分析与自动化

- ChatGPT 数据分析教程 2026:从新手到精通的实战完全攻略