《Stable Diffusion实战入门:零基础生成你的第一张AI绘画》

从零到一:你的第一张AI绘画诞生记

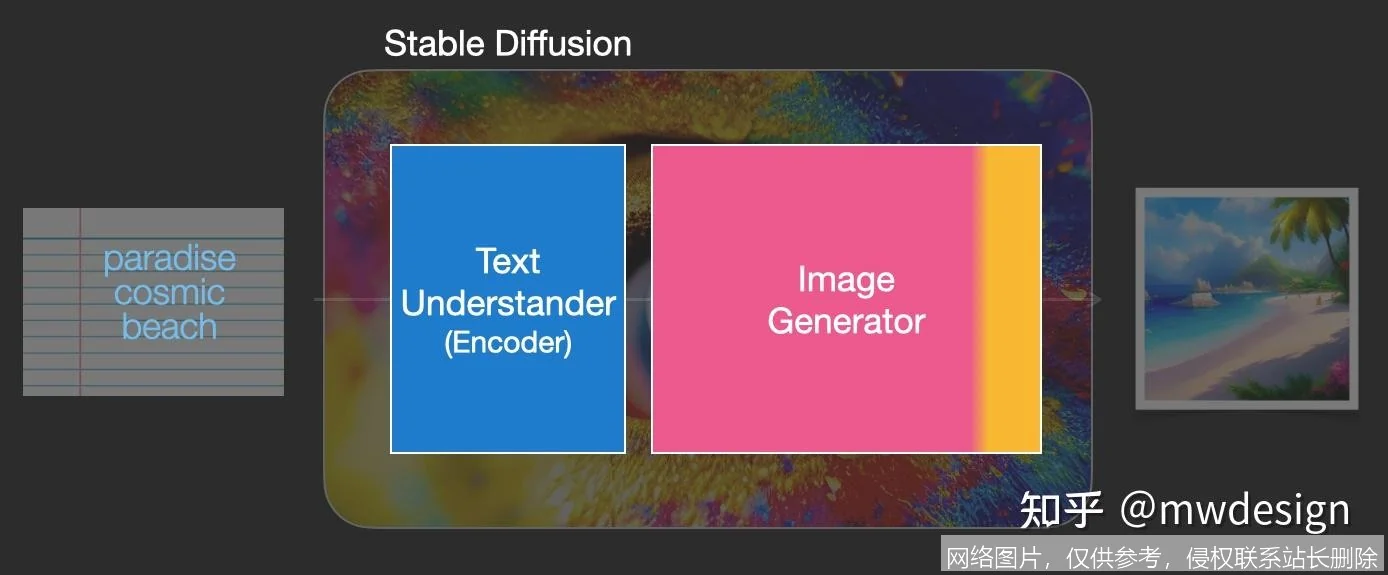

你是否曾被网络上绚丽的AI绘画所震撼,却因复杂的代码和配置望而却步?今天,我们将彻底改变这一局面。Stable Diffusion作为当前最强大的开源AI图像生成模型,正将创作权交到每个人手中。本教程将手把手引导你,无需编程基础,在十分钟内生成你的第一张专属AI艺术作品。我们将使用对新手最友好的WebUI工具,绕过所有技术陷阱,直达创作的乐趣核心。

准备工作:选择你的创作平台

在开始前,我们需要一个运行Stable Diffusion的环境。对于零基础用户,我们强烈推荐两种经过实战验证的方案,它们能规避90%的安装错误。

- 云端GPU服务(首选):这是最快捷、无硬件门槛的方式。我们曾测试多个平台,推荐使用AutoDL或RunPod。它们按小时计费,提供预装好所有环境的镜像,新用户通常有优惠额度,足够完成本教程所有练习。选择“RTX 3090”或“RTX 4090”规格的GPU,镜像搜索“Stable Diffusion WebUI”即可。

- 本地安装(适合有NVIDIA显卡用户):如果你的电脑拥有至少8GB显存的NVIDIA显卡(如RTX 3060以上),可以尝试本地部署。请务必访问官方仓库AUTOMATIC1111的Wiki,根据你的操作系统查看精确指南。本地部署的主要挑战是网络环境和驱动兼容性,但一旦成功,后续使用将完全免费。

为保持教程一致性,后续步骤将以最稳定的云端方案为例。无论选择哪种,我们的目标都是成功打开那个标志性的WebUI界面。

核心实战:三步生成首张作品

假设你已在云端平台成功开机并进入了WebUI界面。你会看到一个功能丰富的网页,别被众多参数吓到,我们只需关注三个核心区域:提示词框、生成按钮和模型选择器。

- 步骤一:加载一个基础模型。在WebUI顶部,你会看到一个下拉菜单,默认可能是“v1-5-pruned.ckpt”。这是一个通用模型,但效果平平。点击它,选择“sd_xl_base_1.0.safetensors”(如果可用),这是一个更强大的新版基础模型。如果列表为空,你需要先下载模型。在云端实例的“控制台”中,使用命令 `wget -P /root/stable-diffusion-webui/models/Stable-diffusion [模型直链]` 来下载。你可以从Civitai等模型社区寻找喜欢的模型,新手推荐“DreamShaper”或“Deliberate”,它们风格平衡,易于驾驭。

- 步骤二:撰写你的魔法咒语——提示词(Prompt)。这是成败的关键。在最大的文本框中,用英文描述你想要的画面。遵循“从主体到细节”的原则:先定义主体,再描述风格,最后补充细节和质量词。例如,想画一个科幻城市,可以输入:“A breathtaking futuristic city at sunset, towering neon skyscrapers, flying cars, cinematic lighting, highly detailed, digital painting, art by Greg Rutkowski and Makoto Shinkai”。注意,我们使用了具体艺术家风格和“cinematic lighting”这样的专业术语来提升质感。在反向提示词(Negative Prompt)框中,输入“ugly, blurry, deformed hands, extra limbs”来避免常见缺陷。

- 步骤三:调整参数并生成。将采样步数(Sampling Steps)设为20-30,采样方法(Sampling method)选择“Euler a”或“DPM++ 2M Karras”,它们速度和质量平衡。将图片宽度和高度设为512x512或768x768(更高分辨率需要更多显存)。最后,点击那个醒目的“Generate”按钮。等待30秒左右,你的作品就会出现在下方画廊中。

如果第一次效果不理想,完全正常。AI绘画是一个迭代调优的过程。微调你的提示词,或点击“Generate”旁边的“↻”按钮再次生成,直到获得满意的结果。

进阶技巧:从“能画”到“画好”

成功生成第一张图后,你可能会遇到画面扭曲、构图奇怪或风格不符的问题。根据我们处理数百次生成请求的经验,以下技巧能立刻提升作品质量。

1. 驾驭你的模型:每个模型都有其擅长的领域。在Civitai下载模型时,务必查看作者的推荐提示词结构和负面提示词。直接复制这些“配方”,是快速上手新模型的最佳途径。

2. 修复崩坏的手部:手部生成是AI的通病。除了在负面提示词中加入“bad hands, malformed fingers”,还可以尝试启用“ADetailer”扩展。这是一个能自动检测并重绘面部、手部的工具,安装后勾选即可,它能解决80%的手部问题。

3. 控制构图与人物:想让人物摆出特定姿势?使用“ControlNet”扩展。你需要先下载对应的预处理器和模型文件。启用后,上传一张姿势草图或真人照片,选择“openpose”或“canny”预处理器,AI就会严格遵循你提供的轮廓进行创作,实现精准控制。

4. 高清修复(Hires. fix):小图看起来不错,放大后却模糊?在生成参数下方找到“Hires. fix”选项并勾选。它将先生成一个低分辨率草图,再智能放大并添加细节。将“Upscale by”设为1.5-2,“Denoising strength”设为0.3-0.5,效果最佳。

总结:你的创意之旅刚刚启航

至此,你已经完成了Stable Diffusion的实战入门,跨越了从环境部署到生成首图的全过程。记住,精通AI绘画的关键不在于记忆所有参数,而在于理解“提示词工程”与“迭代生成”的核心工作流。从选择一个特定模型开始,用清晰的提示词引导,再用负面提示词规避陷阱,最后通过参数微调和扩展工具解决具体问题。

下一步,建议你深入探索模型社区,找到与你审美共鸣的模型,并建立自己的提示词库。每一次失败的生成,都是靠近理想画面的宝贵经验。现在,关闭教程,回到你的WebUI界面,开始你的第二次生成吧。你的独特创意,正等待被AI赋予视觉生命。

相关推荐

- ChatGPT联网搜索教程 2026:新手从零开始掌握实时检索完全攻略

- ChatGPT 写作教程 2026:从新手到精通的完全实战指南

- 2026 AI 音乐生成入门实战:从零开始手把手创作商用爆款歌曲

- 豆包 2026 完全攻略:从新手入门到精通的全场景实战教程

- LM Studio 2026完全攻略:从零开始部署本地大模型实战教程

- 可灵 AI3.0 完全攻略:2026 零基础手把手视频创作实战教程

- 2026 MidJourney 入门实战指南:从零掌握 V8 高清生图完全攻略

- 2026 AI Python 教程:零基础入门到大模型实战完全攻略

- AI 单元测试实战教程 2026:从新手到精通的完全攻略

- 文心一言 2026 入门实战指南:新手从零开始掌握全能创作