LangChain 2026 完全攻略:从零开始手把手打造 AI Agent 实战教程

开篇介绍

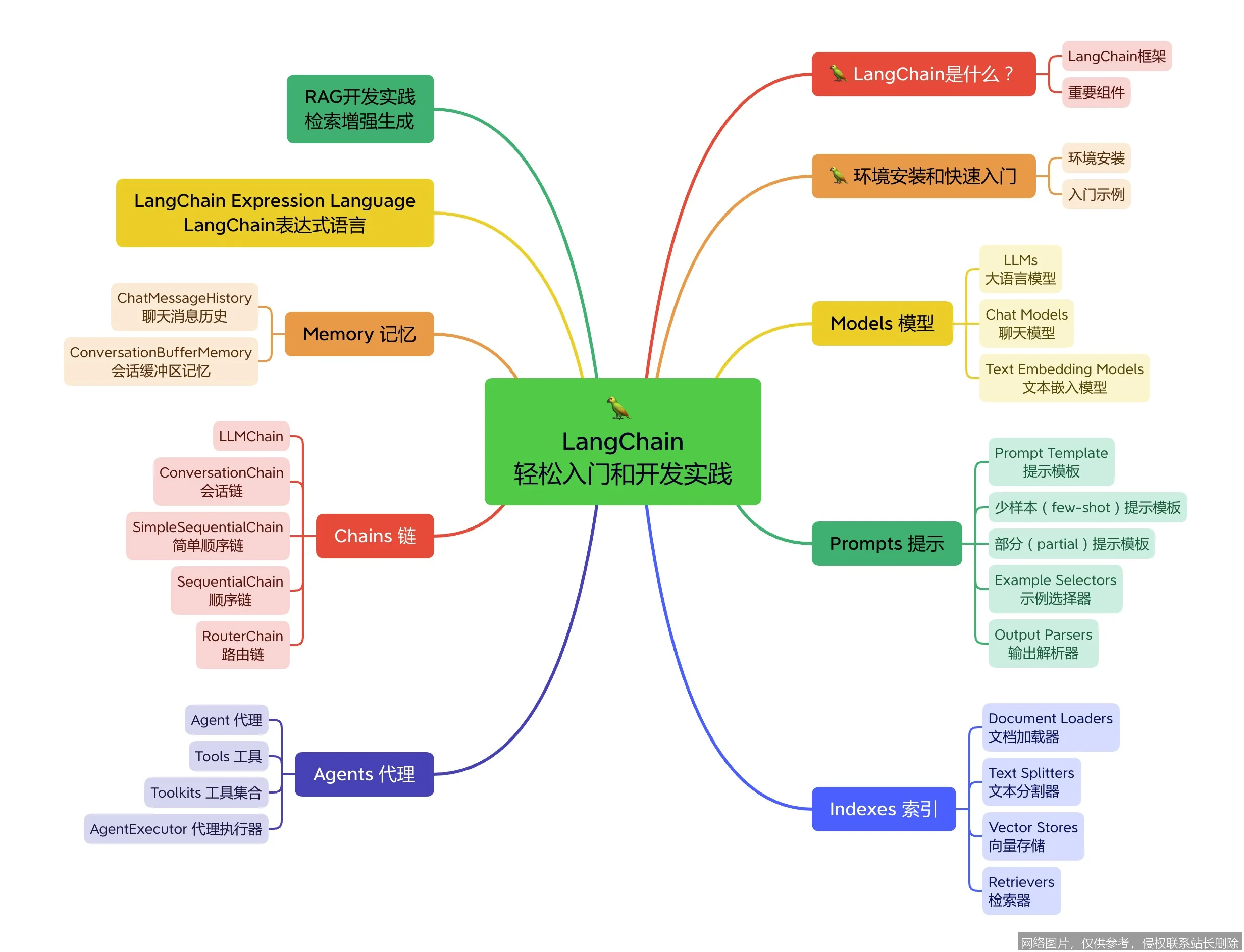

LangChain 是构建基于大语言模型(LLM)应用的领先框架,它能将模型、提示词模板、记忆模块与外部数据源无缝连接,是打造智能 AI Agent 的核心引擎。从自动化客服到复杂数据分析助手,其应用场景无限广阔。本教程将带您穿越技术迷雾,从零开始掌握 LangChain 核心逻辑。学完本课程,您将具备独立设计并部署具备“感知 - 规划 - 行动”能力的 AI 智能体,真正打通从理论到落地的最后一公里。

前置准备

- 账号与密钥获取:访问 OpenAI 或 Anthropic 官网注册开发者账号,获取

API_KEY;若使用 LangSmith 进行调试,需单独注册并生成追踪密钥。 - 环境配置要求:确保本地安装 Python 3.9 及以上版本。推荐使用

venv或conda创建隔离虚拟环境,避免依赖冲突。 - 必要前置知识:需具备基础的 Python 编程能力,理解异步编程(async/await)概念,并对 HTTP 请求及 JSON 数据格式有基本认知。

- 核心库安装:在终端执行

pip install langchain langchain-openai langchain-community python-dotenv以安装必要依赖包。

步骤详解

第一步:初始化环境与模型连接

首先,在项目根目录创建 .env 文件,写入 OPENAI_API_KEY=sk-...。接着编写初始化脚本,加载环境变量并实例化聊天模型。关键代码为:model = ChatOpenAI(model="gpt-4o", temperature=0)。注意:temperature 参数设为 0 可确保输出稳定性,这对 Agent 的逻辑判断至关重要。预期结果:终端无报错,成功打印模型对象信息,表示连接建立。

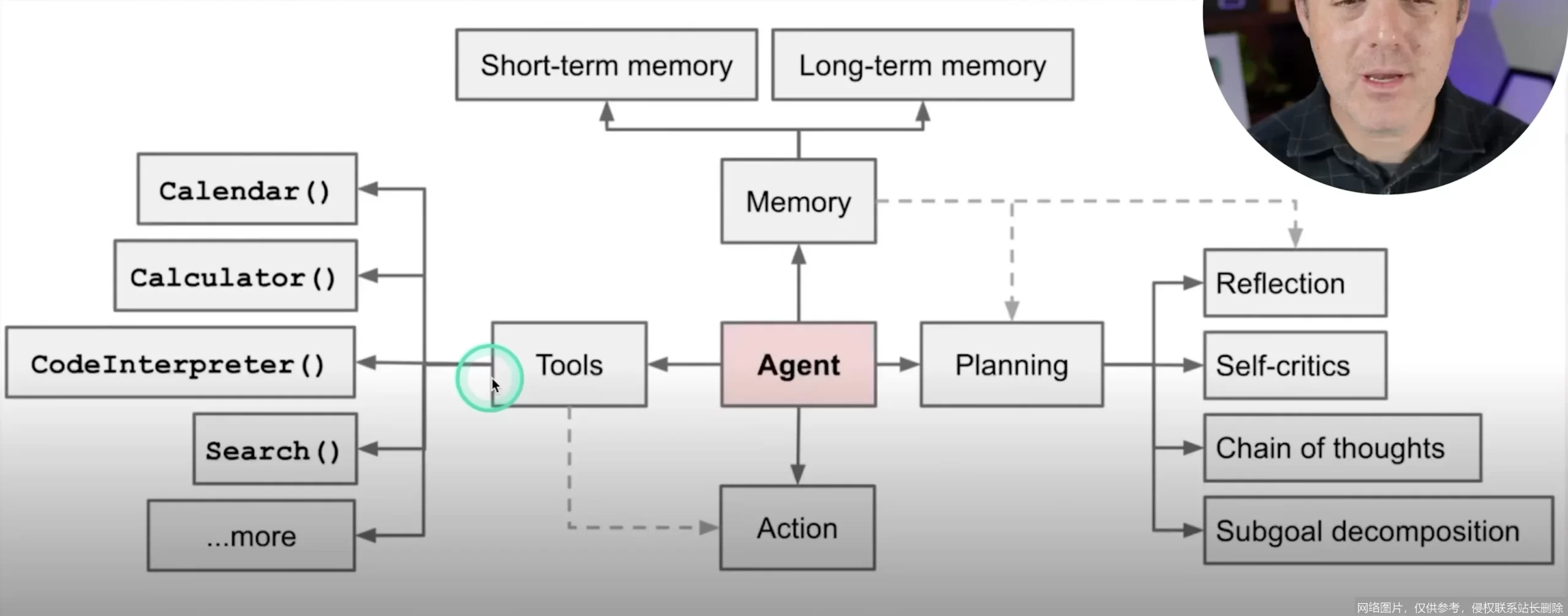

第二步:构建工具集(Tools)赋予行动力

Agent 的核心在于能调用外部工具。我们将定义一个简单的搜索工具或计算器。使用 @tool 装饰器封装函数,例如定义一个查询当前时间的工具,必须清晰描述 args_schema 和函数功能。关键点:工具的描述语(description)直接决定 LLM 是否能正确识别调用时机,务必用自然语言详尽说明。预期结果:得到一个包含具体功能描述的工具列表,可供 Agent 随时调用。

第三步:组装智能体(Agent)与工作流

利用 create_react_agent 函数将模型与工具集绑定。此处需指定提示词模板(System Prompt),明确告诉 AI:“你是一个助手,遇到无法回答的问题请先调用工具”。代码示例:agent = create_react_agent(model, tools, prompt)。警告:切勿在提示词中限制模型思考过程,否则会导致推理链条断裂。预期结果:生成一个完整的 Agent 执行链,能够接收用户输入并自动规划步骤。

第四步:运行测试与交互验证

通过 agent.invoke({"messages": [HumanMessage(content="查询北京今天天气")]}) 触发运行。观察控制台输出的中间思维链(Thought-Action-Observation 循环)。注意事项:若出现死循环,通常是因为工具返回格式错误或提示词引导不足,需检查工具返回的字符串是否规范。预期结果:AI 自动调用天气工具,解析返回数据,并最终用自然语言回答用户问题。

进阶技巧

要提升 Agent 的专业度,建议引入“记忆模块”(Memory),使用 ConversationBufferMemory 让 AI 记住多轮对话上下文,避免“金鱼记忆”。针对复杂任务,可采用“分层代理”架构,让主 Agent 调度多个专项子 Agent 协作。常见问题中,API 超时频发时,请增加重试机制(Retry Logic)并设置合理的 timeout 参数。专业玩家的小窍门是:利用 LangSmith 平台可视化追踪每一次调用的 Token 消耗与延迟,精准优化提示词长度与模型选择,从而在成本与性能间找到最佳平衡点。

总结与实践

回顾全程,我们完成了从环境搭建、工具定义、Agent 组装到运行测试的完整闭环。建议您尝试修改工具集,接入数据库或 API,打造专属的个人助理。延伸学习可关注 LangChain 官方文档中的"RAG 实战”章节,深入探索私有知识库问答系统,持续精进您的 AI 开发技能。

已是最新文章

相关推荐

- LangChain 2026 完全攻略:从零开始手把手打造 AI Agent 实战教程

- 2026 AI 设计教程:从零开始手把手掌握矢量与绘图实战

- AI 声音克隆教程 2026:从零开始手把手复刻原声完全攻略

- Cursor 提示词教程 2026:从零开始手把手实战指南

- LangChain 1.x 入门实战:2026 零基础构建智能体完全攻略

- ChatGPT联网搜索教程 2026:新手从零开始掌握实时检索完全攻略

- ChatGPT 写作教程 2026:从新手到精通的完全实战指南

- 2026 AI 音乐生成入门实战:从零开始手把手创作商用爆款歌曲

- 豆包 2026 完全攻略:从新手入门到精通的全场景实战教程

- LM Studio 2026完全攻略:从零开始部署本地大模型实战教程