LangChain 1.x 入门实战:2026 零基础构建智能体完全攻略

开篇介绍

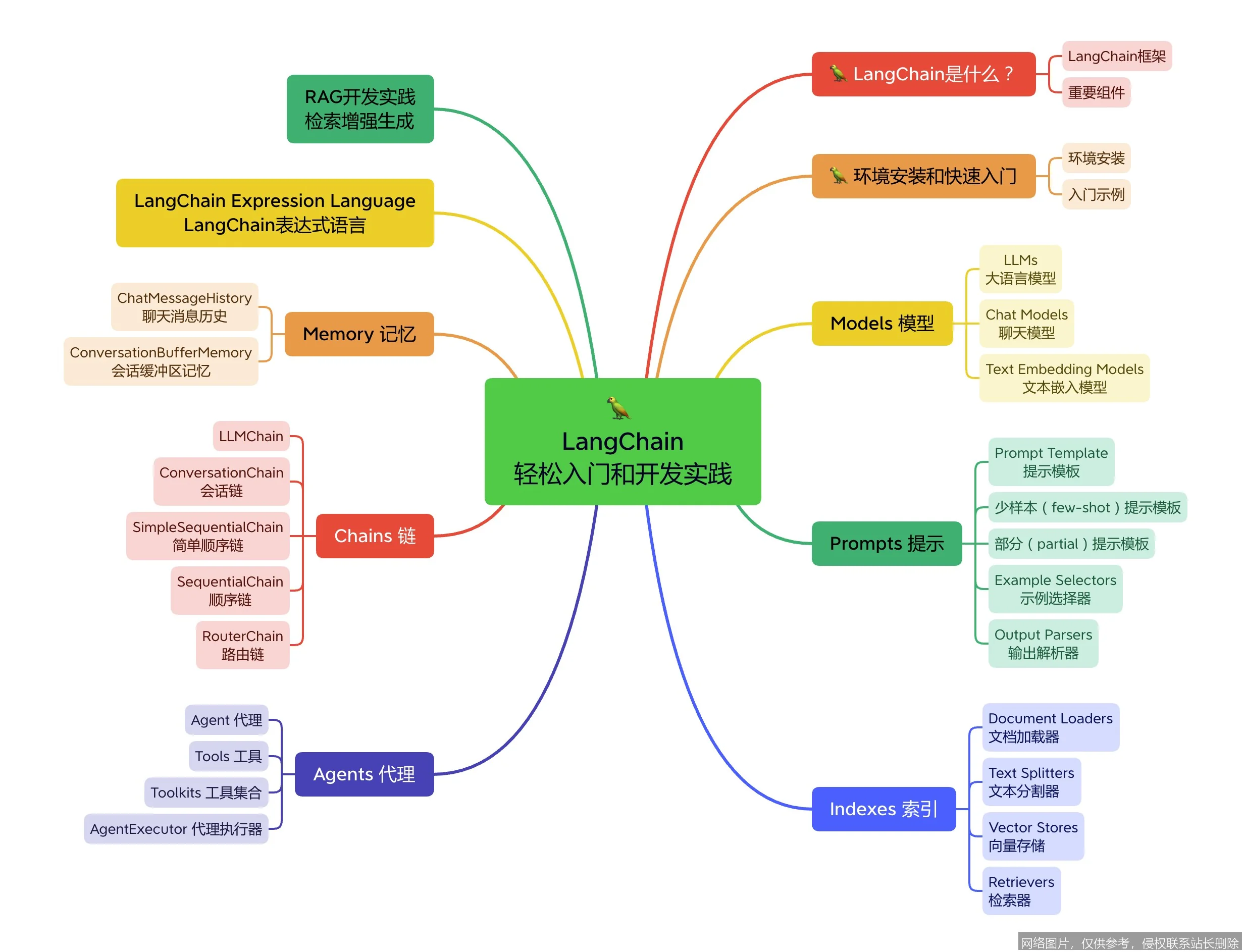

LangChain 是构建大语言模型(LLM)应用的核心框架,它能将模型与外部数据、计算工具无缝连接,是打造智能体(Agent)的基石。无论是开发自动客服、数据分析助手还是个性化推荐系统,LangChain 都是不可或缺的工具。本教程将带你从零开始,在 2026 年的技术背景下,掌握 LangChain 1.x 的核心用法。学完本教程,你将具备独立构建具备记忆、检索和工具调用能力的智能体的实战技能,轻松迈入 AI 应用开发的大门。

前置准备

- 账号注册:访问 OpenAI 或主流大模型提供商官网,注册账号并获取 API Key。请妥善保管密钥,切勿泄露。

- 环境配置:确保本地安装 Python 3.9 及以上版本。推荐使用虚拟环境管理工具(如 venv 或 conda)隔离项目依赖。

- 前置知识:需具备基础的 Python 编程能力,了解异步编程概念更佳,但不强制要求深入理解深度学习原理。

- 依赖安装:在终端执行

pip install langchain langchain-openai python-dotenv以安装核心库及环境变量管理工具。

步骤详解

第一步:初始化环境与模型连接

首先,在项目根目录创建 .env 文件,写入 OPENAI_API_KEY=你的密钥。接着编写初始化代码,加载环境变量并实例化模型。使用 ChatOpenAI 类时,务必指定 model_name 参数为最新支持的模型(如 "gpt-4o")。

注意:若密钥加载失败,程序将抛出异常,请检查文件名是否为 .env 且无后缀。

预期结果:成功打印出模型对“你好”的简单回复,证明连接畅通。

第二步:构建提示词模板(Prompt Template)

硬编码提示词缺乏灵活性。我们需要使用 ChatPromptTemplate 定义动态模板。设置 template 参数,利用 {variable} 语法预留变量位置,例如:“你是一个{role},请回答:{question}"。

关键点在于区分系统指令与用户输入,通过 messages 列表结构化传递。这能确保模型始终遵循预设角色。

预期结果:传入不同变量后,模型能根据角色设定输出风格迥异的回答。

第三步:组装链(Chain)并执行

将提示词模板与模型连接成“链”。使用 prompt | model 的简洁语法(基于 LangChain 1.x 的新特性)组合组件。调用 invoke 方法传入字典格式的参数(如 {"role": "专家", "question": "..."}" )触发执行。

警告:输入参数的键名必须与模板中的变量名完全一致,否则会导致运行报错。

预期结果:控制台输出经过角色扮演的完整回答内容。

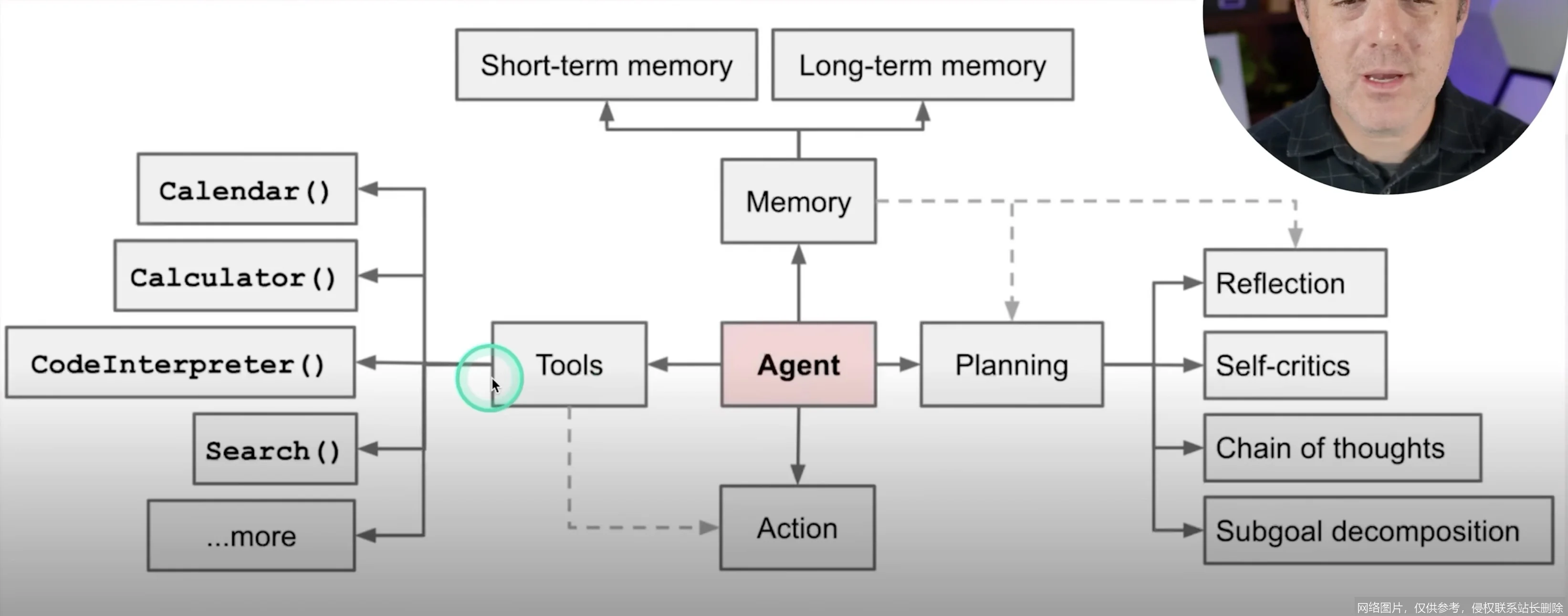

第四步:赋予智能体工具调用能力

真正的智能体需要操作外部世界。定义一个简单的工具函数(如搜索或计算器),并使用 @tool 装饰器注册。随后,利用 create_tool_calling_agent 快速构建代理,将其绑定到模型和工具列表上。

此步骤是核心难点,需确保工具函数的文档字符串(docstring)清晰,以便模型理解何时调用该工具。

预期结果:当用户提问涉及计算或查询时,智能体能自动调用工具并返回精确结果,而非瞎编乱造。

进阶技巧

想要提升开发效率?尝试使用 LangSmith 进行链路追踪与调试,它能可视化每一步的耗时与令牌消耗,快速定位瓶颈。针对常见问题如“模型忘记上下文”,可引入 ConversationBufferMemory 模块,让智能体拥有短期记忆。专业玩家的小窍门是:利用 few-shot prompting(少样本提示)在模板中植入示例,能显著提升复杂任务的成功率。此外,对于高并发场景,务必使用 ainvoke 异步方法替代同步调用,大幅提升吞吐量。

总结与实践

回顾全文,我们完成了从环境配置、模型连接、提示词工程到智能体构建的全流程。核心在于理解“链”的组合逻辑与“工具”的注册机制。建议你尝试修改本教程代码,接入本地知识库或联网搜索插件,打造一个专属的个人助理。更多深度内容,可查阅 LangChain 官方文档及社区精选案例,持续探索 AI 应用的无限可能。

已是最新文章

相关推荐

- LangChain 1.x 入门实战:2026 零基础构建智能体完全攻略

- ChatGPT联网搜索教程 2026:新手从零开始掌握实时检索完全攻略

- ChatGPT 写作教程 2026:从新手到精通的完全实战指南

- 2026 AI 音乐生成入门实战:从零开始手把手创作商用爆款歌曲

- 豆包 2026 完全攻略:从新手入门到精通的全场景实战教程

- LM Studio 2026完全攻略:从零开始部署本地大模型实战教程

- 可灵 AI3.0 完全攻略:2026 零基础手把手视频创作实战教程

- 2026 MidJourney 入门实战指南:从零掌握 V8 高清生图完全攻略

- 2026 AI Python 教程:零基础入门到大模型实战完全攻略

- AI 单元测试实战教程 2026:从新手到精通的完全攻略