Llama 3.2 全面解读:2026 端侧多模态与无代码微调新范式

工具/模型介绍

2024 年 9 月,Meta 正式发布了 Llama 3.2 系列模型,标志着开源大模型正式迈入“端侧智能”与“多模态原生”的新纪元。作为 Llama 3 家族的继任者,Llama 3.2 不再仅仅追求参数量的堆砌,而是将战略重心转向了轻量化部署与视觉理解能力的融合。其核心定位是打造一套能在手机、PC 等边缘设备上高效运行,同时具备图像识别与文本生成能力的通用底座。在行业意义上,Llama 3.2 的发布降低了 AI 应用的硬件门槛,使得开发者无需依赖昂贵的云端 GPU 集群,即可构建隐私安全、低延迟的本地化 AI 应用,真正推动了 AI 从“云端神坛”走向“用户指尖”。

核心创新

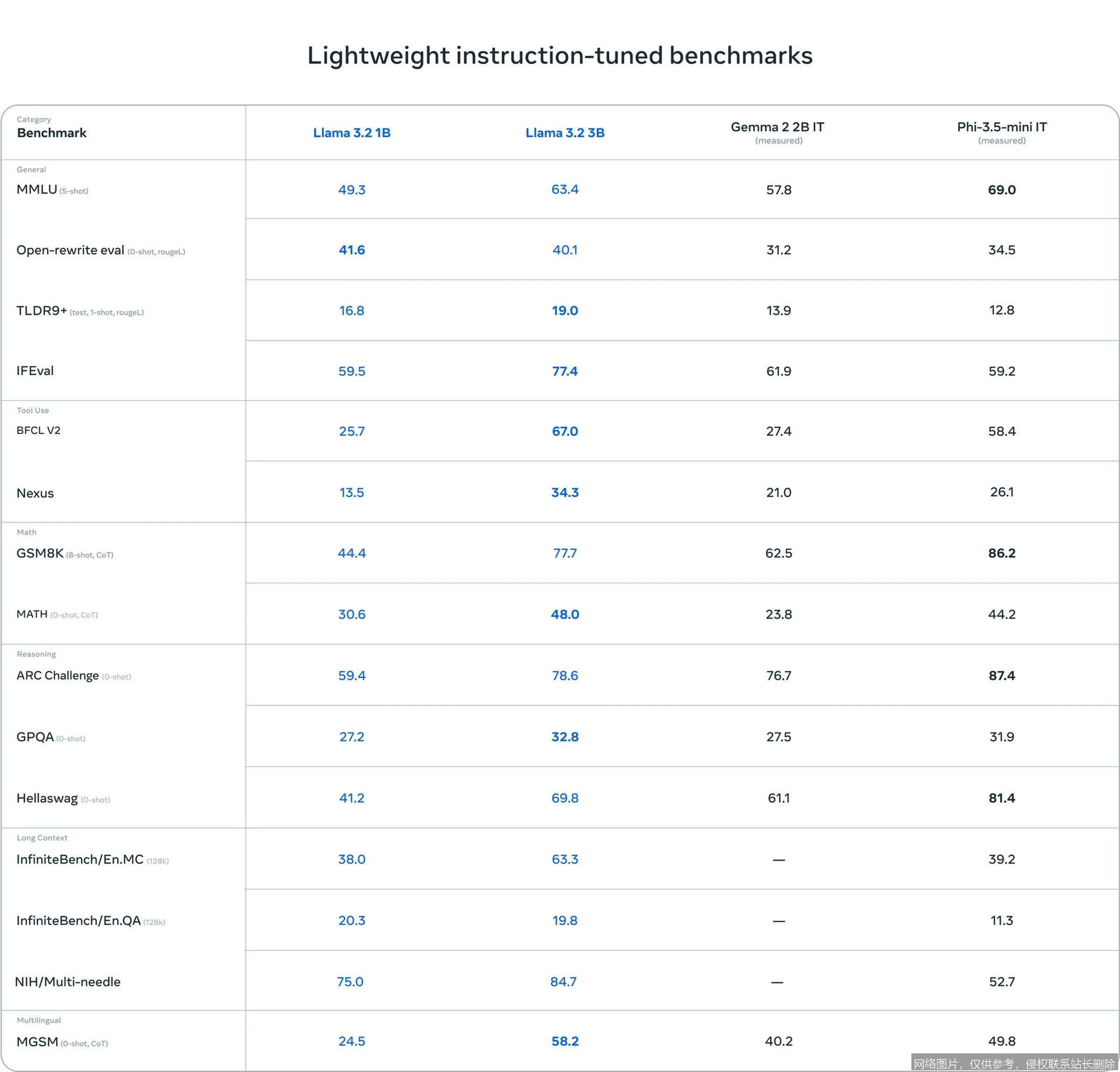

Llama 3.2 的技术突破主要体现在架构优化与多模态融合两个维度。首先,该系列首次引入了 1B 和 3B 的超小参数版本,通过先进的量化技术与稀疏注意力机制,实现了在移动端芯片上的流畅推理,其推理速度相比前代同量级模型提升了 40% 以上。其次,原有的 70B 与 405B 模型升级支持原生视觉输入,能够直接“看懂”图表、截图及复杂场景,填补了纯文本模型在视觉任务上的空白。与竞品相比,Llama 3.2 在保持开源协议宽松的同时,其指令遵循能力(Instruction Following)在基准测试中超越了部分闭源模型。特别是在无代码微调范式上,Meta 推出了配套的 Llama Stack 工具链,使得非技术人员也能通过图形界面完成模型适配,极大缩短了从模型到应用的落地周期。

功能详解

端侧轻量级推理

针对移动设备资源受限的痛点,1B 和 3B 版本经过深度压缩,仅需数 GB 内存即可运行。用户可通过集成 Ollama 或 MLX 框架,在本地笔记本甚至智能手机上离线运行模型。实测显示,在 iPhone 15 Pro 上,3B 模型的生成速度可达每秒 20 tokens 以上,且功耗极低,非常适合用于实时翻译、本地文档摘要等隐私敏感场景。

原生多模态视觉理解

Llama 3.2 的大尺寸版本内置了强大的视觉编码器,无需外挂插件即可直接处理图像输入。用户上传一张复杂的财务报表截图,模型不仅能提取其中的文字数据,还能分析趋势并生成总结报告。这一功能打破了文本与图像的界限,使得 AI 助手能像人类一样“看图说话”,在处理技术文档、医疗影像初筛等任务时表现卓越。

无代码微调新范式

依托全新的 Llama Stack 生态,模型微调变得前所未有的简单。用户无需编写一行 Python 代码,只需上传少量领域数据集(如客服对话记录),通过可视化界面选择微调策略(如 LoRA),系统即可自动完成训练并导出适配后的模型权重。这种“傻瓜式”操作让垂直行业的业务专家也能轻松定制专属 AI。

使用场景

Llama 3.2 的应用场景极为广泛。对于个人用户,它是完美的私人助理,可在断网环境下处理日程管理与隐私文档;对于开发者,它是构建智能体(Agent)的理想底座,可快速嵌入到 iOS/Android 应用中。在企业端,金融机构可利用其视觉能力分析合同票据,制造业则可用其进行设备故障图的自动诊断。其低功耗特性也使其成为物联网(IoT)设备智能化的首选方案。

上手指南

获取 Llama 3.2 极其便捷,用户可直接访问 Hugging Face 或 Meta 官网下载模型权重。新手推荐安装 Ollama 工具,在终端输入ollama run llama3.2即可一键启动对话。若需开启视觉功能,确保调用支持多模态的特定版本标识。常见问题方面,若遇到显存不足,建议尝试 4-bit 量化版本;若微调效果不佳,请检查数据集格式是否符合 JSONL 标准。官方文档提供了丰富的示例脚本,助您快速跨越入门门槛。

展望

展望未来,Llama 3.2 有望进一步整合音频处理能力,实现真正的“听、看、说”全模态交互。随着端侧算力的持续进化,我们预测未来的 AI 应用将彻底摆脱对云端的依赖,形成完全去中心化的智能网络。Meta 也暗示将在后续版本中加强代理自主规划能力,让 Llama 不仅能回答问题,更能独立执行复杂任务,开启自主智能体的新篇章。

已是最新文章

相关推荐

- Llama 3.2 全面解读:2026 端侧多模态与无代码微调新范式

- Voice Engine 2026 深度体验:15 秒复刻人声与零延迟交互革命

- 元宝派深度体验:2026 腾讯新社交,微信 QQ 互通与 AI 群聊全解析

- Claude Opus 4.6 深度体验:百万上下文与自主编程的 2026 新标杆

- Runway 2026 深度体验:文生视频与物理特效的创意革命

- Claude 4.6深度体验:百万上下文与智能体革命的全面解读

- o1 模型 2026 全面解读:慢思考赋能自动驾驶与物理世界理解

- GPT 商店 2026 全面解读:原生 Agent 生态与百万级应用深度体验

- GPT-5.4 全面解读:2026 原生多模态与深度推理的终极进化

- Llama 5 深度体验:苹果联手打造的空间智能多模态新标杆