నిపుణుల హైబ్రిడ్ MoE: AI నమూనాల తరువాతి తరం యొక్క "విభజన మరియు జయించడం" జ్ఞానాన్ని బహిర్గతం చేయడం

专家混合MoE:揭秘下一代AI模型的“分而治之”智慧

在人工智能模型规模爆炸式增长的今天,如何让拥有万亿参数的“庞然大物”高效运行,成为业界核心挑战。传统的密集模型将所有参数用于处理每个输入,计算成本高昂。而专家混合技术,正以其巧妙的“分而治之”智慧,成为引领下一代AI模型发展的关键架构。

什么是专家混合MoE?

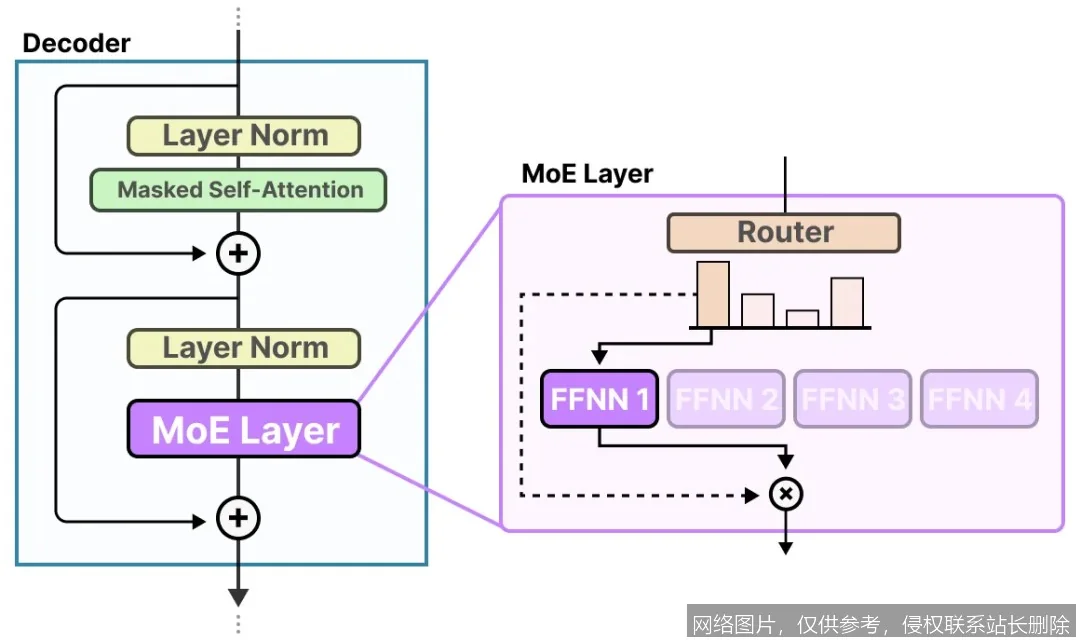

专家混合是一种稀疏的神经网络架构。其核心思想是将一个庞大的模型分解为多个更小的子网络,即“专家”。每个专家通常专注于处理某一特定类型或模式的数据。在处理每一个输入时,一个被称为“门控网络”的机制,会动态地选择并激活最相关的少数几个专家(例如1个或2个),而其他专家则保持“休眠”状态。

这就像我们遇到复杂问题时,不会召集所有领域的专家开会,而是根据问题的性质,只请教一两位最相关的专家。这种设计带来了两大革命性优势:

- 模型容量巨大,计算成本可控:模型的总参数量可以极大(如万亿级),但每次前向传播只激活部分参数,使得训练和推理的计算量远小于同等规模的密集模型。

- 实现条件计算:模型能够根据输入内容,智能地分配计算资源,更具灵活性和效率。

MoE如何工作:从输入到输出的精妙流程

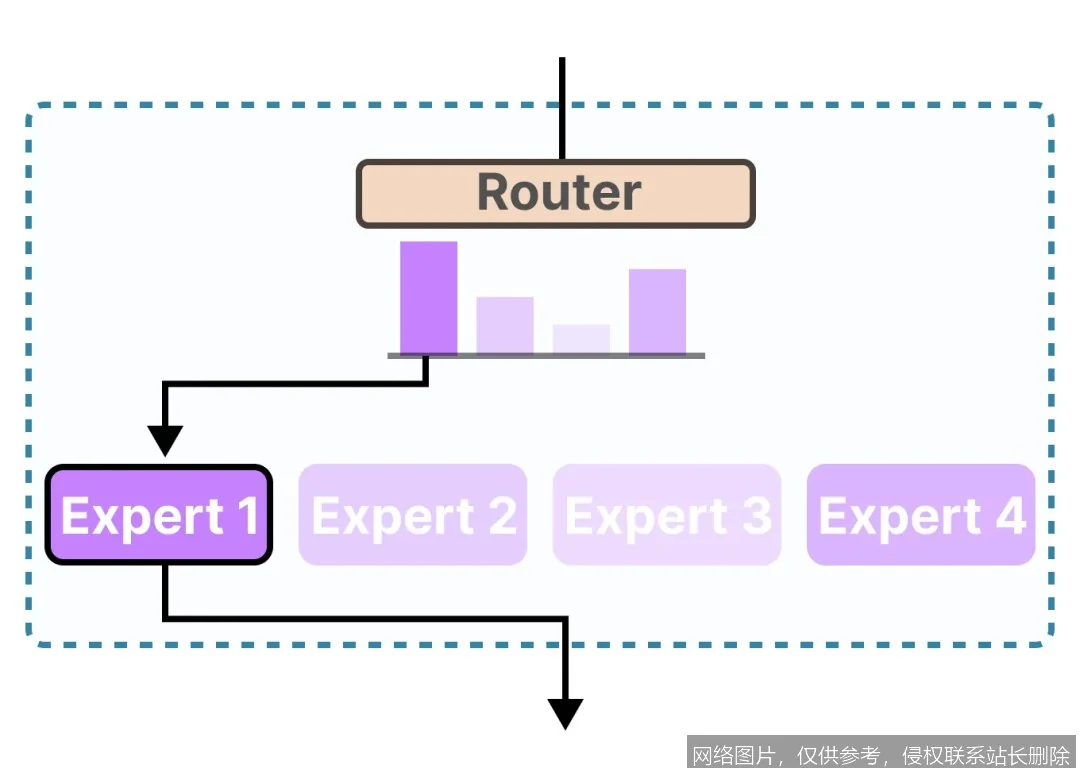

一个典型的专家混合层工作流程可以分解为以下几步:

- 门控决策:输入数据首先经过门控网络,该网络会计算一个权重分布,决定将输入路由给哪些专家。

- 专家选择:通常采用“Top-k”策略,只选择权重最高的k个专家(k远小于专家总数)。

- 条件计算:输入被发送给选中的专家,由它们进行并行处理。

- 结果集成:各个被选专家的输出,根据门控网络的权重进行加权求和,得到该MoE层的最终输出。

这个过程在模型的多个层中重复,构建出一个既庞大又高效的稀疏模型。

MoE的挑战与创新

尽管前景广阔,专家混合架构也面临独特挑战。最突出的是负载不均衡问题:门控网络可能倾向于反复选择少数几个受欢迎的专家,导致其他专家得不到充分训练(“专家闲置”)。

为此,研究人员引入了各种创新技术来保证训练的平衡与稳定:

- 负载均衡损失:在训练目标中加入额外约束,鼓励所有专家获得相对均衡的输入。

- 门控噪声:在门控计算中加入可调节的噪声,促进探索,避免早期收敛于少数专家。

- 更精细的路由策略:如基于哈希、聚类或学习到的硬路由等,以提升路由效率和效果。

为何说MoE是下一代AI的关键?

随着对模型能力需求的无限增长,单纯堆叠参数的传统路径已触及物理和经济的瓶颈。专家混合架构为突破这一瓶颈提供了优雅的解决方案。

它使得构建和部署万亿参数级别的超大规模模型成为可能,同时保持了实际应用的可行性。从谷歌的Switch Transformer到开源的Mixtral模型,MoE已在自然语言处理等领域证明了其卓越的性能与效率。未来,它不仅是扩大模型规模的核心技术,更是实现模型专业化、模块化、高效化的基石,推动AI从“通用巨兽”向“精准协作的专家团队”演进。

可以预见,融合了“分而治之”智慧的专家混合MoE,将继续在通往更强大、更高效人工智能的道路上扮演至关重要的角色。

相关推荐

- KV缓存:揭秘AI高效推理背后的核心加速器

- Transformer 是什么:2026 全面解析架构原理、技术演进与多模态实战应用

- 多头注意力:让AI模型“眼观六路”的核心机制解析

- నిపుణుల హైబ్రిడ్ MoE: AI నమూనాల తరువాతి తరం యొక్క "విభజన మరియు జయించడం" జ్ఞానాన్ని బహిర్గతం చేయడం

- API 是什么?2026 全面解析:从底层原理到多模型实战应用

- 模型合并:解锁AI新能力的融合艺术与实战指南

- 合成数据:驱动AI未来的“虚拟燃料”与隐私新解方

- ControlNet 是什么:原理、2026 应用演进与实战详解

- 标注:从数据到智能,解锁AI认知的“关键注释”

- 算法是什么全面解析:从数学原理到 2026 年智能应用实战