ControlNet 是什么?从原理到实战一文搞懂,新手入门看这一篇就够了

ControlNet 是什么?这是当前人工智能绘画领域最常被搜索的问题之一。如果你刚刚接触 Stable Diffusion,或者已经在使用但苦于无法精准控制画面构图、姿态和细节,那么这篇文章就是为你量身定制的。作为 2023 年引爆 AI 绘图圈的重磅技术,ControlNet 彻底改变了我们生成图像的方式,从“抽卡式”的随机生成进化为“导演式”的精准操控。

截至 2026 年 3 月,随着 Stable Diffusion XL (SDXL) 生态的成熟以及 Flux 等新架构模型的崛起,ControlNet 技术本身也经历了多次迭代升级。本文将结合最新的技术动态,从底层原理、核心功能、实战技巧到未来趋势,全方位拆解这一神器。无论你是设计师、插画师还是 AI 爱好者,读完这篇,你将真正掌握让 AI 听懂你指令的钥匙。

一、为什么我们需要 ControlNet?告别“开盲盒”式的绘图

在 ControlNet 出现之前,使用 Stable Diffusion 生成图像往往像是在“开盲盒”。你输入一段提示词(Prompt),比如“一个穿着红色盔甲的女战士,站在山顶”,AI 可能会生成一张不错的图,但如果你想让她摆出特定的姿势、保持具体的面部特征,或者严格遵循某张草图的线条,传统的文生图(Text-to-Image)模式几乎无能为力。

你不得不反复修改提示词,调整种子数(Seed),甚至进行大量的后期修图。这种不可控性是阻碍 AI 绘画进入专业工作流的最大痛点。

ControlNet 的诞生正是为了解决这个问题。它由美国加州大学尔湾分校的吕少群(Lvmin Zhang)团队提出,其核心理念是:在保留预训练大模型生成能力的前提下,引入额外的条件控制信号。简单来说,就是给 AI 戴上一副“眼镜”,让它不仅能“听”懂你的文字描述,还能“看”懂你提供的参考图(如边缘图、深度图、姿态图等),从而严格按照你的意图作画。

ControlNet 带来的革命性变化

- 精准构图:完全复刻参考图的轮廓和结构,不再随机变形。

- 姿态锁定:让人物做出高难度的瑜伽动作或复杂的舞蹈姿势,分毫不差。

- 局部重绘可控:只修改画面的特定部分,而保持其他区域完美不变。

- 风格迁移一致性:将草图快速转化为不同风格的成品,同时保持线条一致。

到了 2026 年,ControlNet 已经不仅仅是 Stable Diffusion 的插件,它已成为多模态生成模型的标准配置,支持从 2D 图像到 3D 资产生成的全流程控制。

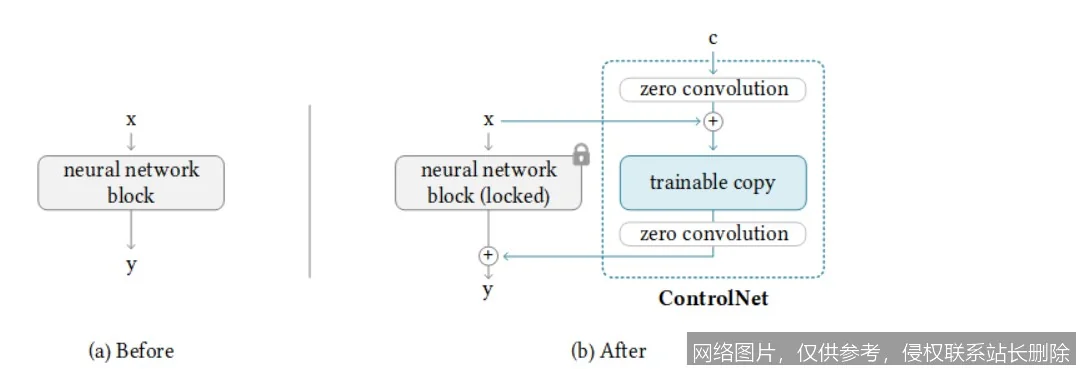

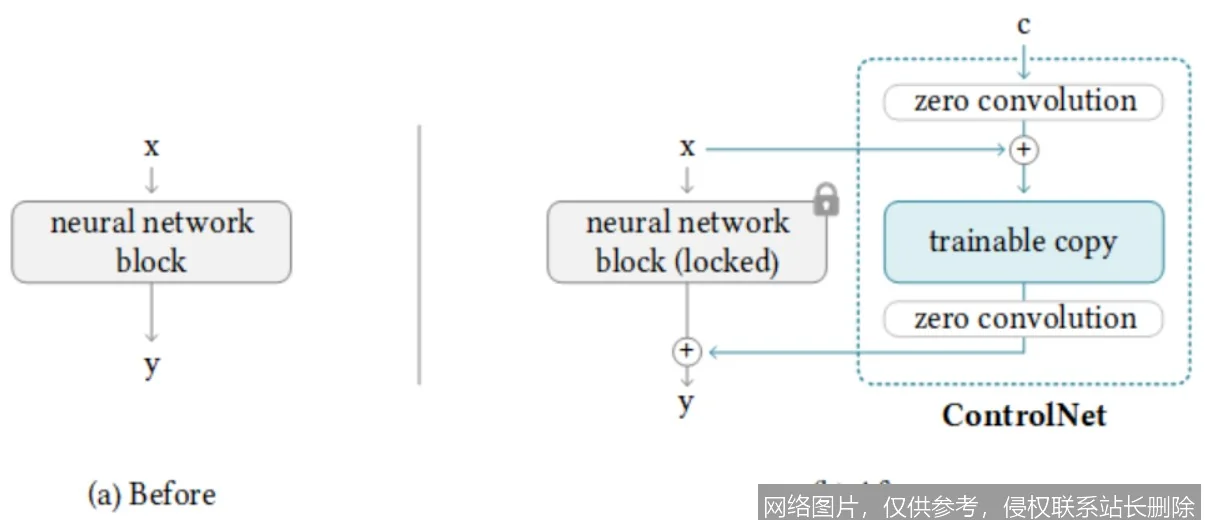

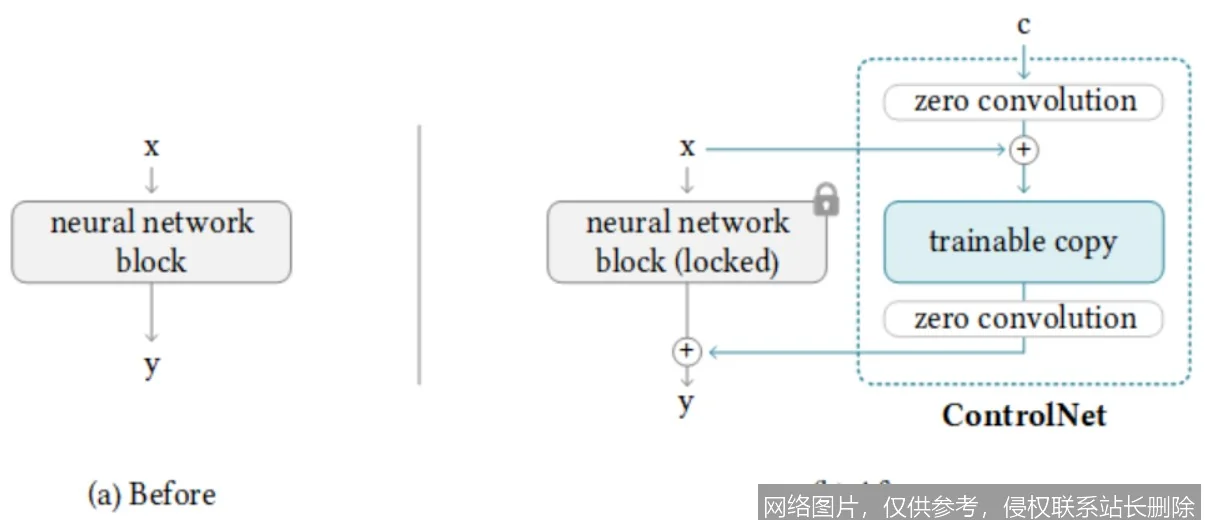

二、深度解析:ControlNet 的工作原理(通俗版)

很多教程一上来就讲卷积神经网络、零卷积(Zero Convolution)和锁死权重,让新手望而却步。其实,理解 ControlNet 的原理只需要一个生动的比喻。

1. “克隆人”与“教官”的比喻

想象一下,原本的 Stable Diffusion 模型是一个才华横溢但性格自由的画家(我们称之为“本体模型”)。他画画很好,但不喜欢听指挥,你想让他画个圆圈,他可能画个椭圆。

ControlNet 的做法是:复制一份这个画家的克隆体(锁定权重的副本)。

- 本体模型:负责保持原有的绘画风格和创造力,它的参数被冻结,不会改变。

- 克隆体(ControlNet):专门用来学习新的“约束条件”(比如你要的线条、姿态)。

关键在于,这两个模型之间通过一种特殊的连接方式——零卷积层(Zero Convolution Layers)进行沟通。在训练初期,这些连接层的权重是 0,意味着克隆体对本体没有任何影响,本体照常画画。随着训练进行,克隆体学会了如何解读你的参考图(例如 Canny 边缘检测图),并通过零卷积层慢慢向本体传递信号:“嘿,这里的线条应该是这样的,请照着画。”

最终的效果是:本体模型保留了强大的生成能力,而克隆体确保了画面结构严格遵守你的输入条件。两者完美结合,既不失创意,又绝对可控。

2. 技术核心:零卷积(Zero Convolution)

这是 ControlNet 最精妙的设计。传统的微调(Fine-tuning)往往会破坏大模型原本的知识库,导致“灾难性遗忘”(即学会了新任务,忘了旧本领)。而零卷积层在初始化时输出为 0,保证了在训练开始前,ControlNet 分支对主模型毫无干扰。随着训练深入,网络自动学习到何时、何地施加多大的控制力。这种设计使得 ControlNet 可以适配任何版本的 Stable Diffusion 模型,无论是 SD 1.5、SDXL 还是最新的 SD 3.5 或 Flux 架构。

三、2026 年主流 ControlNet 模型类型详解

经过几年的发展,ControlNet 家族已经极其庞大。针对不同的控制需求,社区开发了多种预处理器和模型。以下是目前最常用、效果最好的几种类型:

1. Canny(边缘检测)

适用场景:线稿上色、保持物体轮廓、建筑绘图。

原理:提取参考图的清晰边缘线条,强制 AI 按照这些线条生成图像。

实战技巧:适合将手绘草图转化为精美插画。如果原图噪点多,可先进行高斯模糊处理再提取 Canny 边缘。

2. OpenPose(人体姿态)

适用场景:人物摄影、角色设计、多人互动场景。

原理:识别参考图中人物的骨骼关键点(头、肩、手、膝等),生成火柴人骨架图,控制生成人物的动作。

2026 更新:新版 OpenPose 不仅支持全身,还增强了手部细节和面部表情的控制,解决了长期以来“六指琴魔”的痛点。

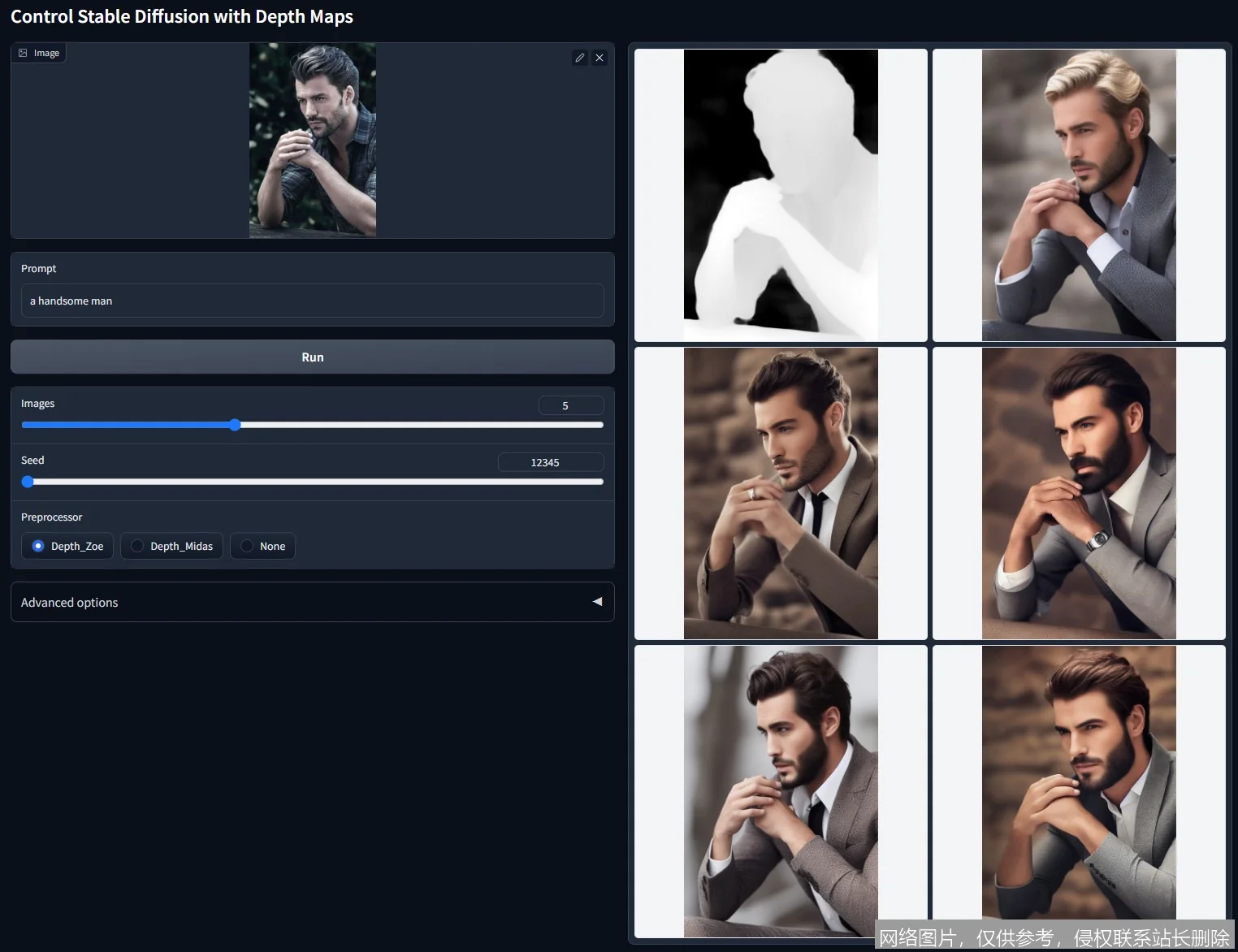

3. Depth(深度图)

适用场景:室内装修设计、景观布局、前后景关系明确的场景。

原理:分析图片的远近层次,生成灰度深度图。白色代表近,黑色代表远。

优势:比 Canny 更灵活,允许物体边缘有轻微变化,但严格保持空间透视关系。

4. SoftEdge & Lineart(软边缘与真实线条)

适用场景:动漫线稿转写实、保留笔触感。

区别:Canny 的线条太硬,容易丢失艺术感;SoftEdge 和 Lineart 能更好地保留手绘的粗细变化和柔和笔触,是目前插画师的首选。

5. IP-Adapter(图像提示适配器)

特别说明:虽然严格意义上 IP-Adapter 不是传统的 ControlNet,但在 2024-2026 年间,它常与 ControlNet 配合使用,被视为“内容控制”的核心。

功能:直接参考某张图片的风格、色彩甚至具体人物脸部,实现“以图生图”的高级形态。

6. T2I-Adapter 与 InstantID

为了追求更快的推理速度,轻量级的 T2I-Adapter 应运而生。而InstantID则是 2024 年爆发的黑科技,它能仅用一张照片就实现极高保真度的人脸保持,无需繁琐的训练 LoRA,目前在身份一致性任务中占据主导地位。

四、实战指南:如何使用 ControlNet 打造专业工作流

理论再多,不如动手做一次。以下基于目前主流的 WebUI(如 Automatic1111, ComfyUI)操作逻辑,演示一个典型的“草图变大片”流程。

步骤一:环境准备与模型下载

确保你的 Stable Diffusion 界面已安装 ControlNet 扩展插件。前往 HuggingFace 或 Civitai 下载对应版本的模型文件(注意区分 SD1.5、SDXL 或 Flux 版本,混用会导致报错或黑屏)。将模型放入 models/ControlNet 文件夹并刷新。

步骤二:上传图片与预处理器选择

1. 在 ControlNet 单元中上传你的参考图(例如一张随手画的草图)。

2. 勾选“启用”(Enable)和“完美像素模式”(Perfect Pixel Mode,推荐开启以自动匹配分辨率)。

3. 关键一步:选择预处理器(Preprocessor)。如果是草图,选择 lineart_realistic 或 canny;如果是想控制姿势,选择 openpose_full。

4. 点击预览按钮,查看预处理后的效果。如果预览图乱七八糟,说明预处理器选错了,需立即调整。

步骤三:参数微调的艺术

很多新手忽略了两个核心滑块的作用:

- 控制权重(Control Weight):默认是 1.0。如果你觉得 AI 太死板,完全照搬参考图缺乏创意,可以尝试降到 0.6-0.8;如果 AI 不听话,跑偏了,则提高到 1.2。

- 起始/结束步数(Starting/Ending Step):这是一个高级技巧。例如,设置起始步数为 0,结束步数为 0.6。这意味着 AI 在前 60% 的生成过程中严格遵守你的线条,而在后 40% 自由发挥,增加光影和细节的丰富度。这能有效避免画面僵硬。

步骤四:多重 ControlNet 叠加(进阶)

WebUI 通常支持同时开启多个 ControlNet 单元。你可以:

- 单元 1:使用 OpenPose 控制人物动作。

- 单元 2:使用 Depth 控制背景建筑的透视。

- 单元 3:使用 IP-Adapter 固定人物的服装风格。

通过这种“组合拳”,你可以构建出电影级分镜般的复杂画面。

五、2026 年新趋势:ControlNet 的进化与挑战

站在 2026 年的节点回望,ControlNet 技术已经从最初的“单图控制”进化为“多模态时空控制”。

1. 视频生成的强力引擎

随着 Sora、Runway Gen-3 以及开源的 AnimateDiff 技术的成熟,ControlNet 已被广泛应用于视频生成。通过提取第一帧的深度图和后续帧的姿态序列,创作者可以精确控制视频中角色的运动轨迹和镜头的推拉摇移。Temporal ControlNet(时间轴控制)确保了视频帧之间的连贯性,消除了闪烁和抖动。

2. 3D 资产生成的标准化

在游戏开发和元宇宙建设中,利用 ControlNet 从三视图(正、侧、背)直接生成高质量的 3D 纹理贴图已成为标准流程。结合 NeRF 和 3D Gaussian Splatting 技术,ControlNet 帮助实现了从 2D 概念图到 3D 模型的无缝衔接。

3. 实时绘制与低延迟

得益于 TensorRT 加速和模型蒸馏技术(如 LCMDistill),现在的 ControlNet 可以实现毫秒级的实时响应。设计师在数位板上画下一笔,屏幕上瞬间呈现渲染完成的效果图,真正实现了“所见即所得”的交互式创作。

4. 面临的挑战

尽管功能强大,ControlNet 仍面临一些挑战:

- 显存占用:同时加载多个高精度 ControlNet 模型对显卡显存(VRAM)要求极高,尤其在 4K 分辨率下。

- 过度拟合:过高的控制权重会导致画面缺乏灵气,显得像“描图”。如何在控制与创意之间找到平衡点,依然是考验使用者审美的重要课题。

六、常见问题解答 (FAQ)

Q1: ControlNet 会损坏我的底模吗?

不会。ControlNet 的训练和使用过程都不会修改原始 Stable Diffusion 模型的权重。它是一个独立的插件层,你可以随时关闭它,底模依然完好无损。

Q2: 为什么我生成的图片和参考图不像?

检查以下几点:

1. 预处理器是否选择正确?(例如用 Depth 模型却选了 Canny 预处理)

2. 控制权重是否过低?

3. 提示词(Prompt)是否与参考图冲突?(例如参考图是白天,提示词却写了“夜晚”)

4. 模型版本是否匹配?(不要用 SD1.5 的 ControlNet 跑 SDXL 的底模)

Q3: 手机或低配电脑能运行吗?

原生运行较为困难,但可以通过云端服务(如 Google Colab, AutoDL, 以及各种在线 AI 绘画平台)使用。此外,量化版的 ControlNet 模型(FP16 或 INT8)也能在较低显存下运行,只是精度略有牺牲。

七、结语:掌控 AI,而非被 AI 掌控

ControlNet 的出现,标志着 AI 绘画从“玩具”走向了“工具”。它赋予了人类创作者真正的控制权,让我们能够将自己的想象力精准地投射到数字画布上。对于新手而言,学习 ControlNet 或许有一点点门槛,但一旦跨越,你将发现一个全新的创作世界。

在这个技术飞速迭代的时代,唯有掌握核心工具逻辑,才能立于不败之地。不要满足于随机生成的惊喜,去尝试控制每一个像素,去成为真正的 AI 导演。希望这篇指南能成为你探索 ControlNet 世界的坚实起点。

现在,打开你的 WebUI,加载第一个 ControlNet 模型,开始你的精准创作之旅吧!

参考资料与信息源

- Lvmin Zhang, et al. "Adding Conditional Control to Text-to-Image Diffusion Models." arXiv preprint arXiv:2302.05543 (2023). https://arxiv.org/abs/2302.05543

- Hugging Face ControlNet Model Repository. Updated March 2026. https://huggingface.co/lllyasviel

- GitHub - lllyasviel/ControlNet. Official Source Code and Documentation. https://github.com/lllyasviel/ControlNet

- Civitai Community Trends Report: ControlNet Usage Statistics Q1 2026. https://civitai.com

- Stable Diffusion WebUI Forum: Best Practices for SDXL ControlNet. Discussion thread updated Feb 2026. https://github.com/AUTOMATIC1111/stable-diffusion-webui/discussions

- Reddit r/StableDiffusion: "InstantID vs ControlNet Face" Comparative Analysis. https://www.reddit.com/r/StableDiffusion/

相关推荐

- RAG 检索增强生成全面解析:2026 年原理演进与实战应用指南

- 什么是 Gemini?2026 最新原理、多模态架构与全场景应用详解

- 预训练是什么:2026 大模型基石原理、技术演进与实战应用全面解析

- 什么是知识库?2026 年最新定义、技术原理与实战应用全面解析

- 语义搜索是什么:2026 年原理、技术演进与全场景应用详解

- 什么是自监督学习?2026 原理、应用与实战全面解析

- ONNX 是什么:2026 跨框架模型标准详解,从原理到实战应用

- Outpainting 是什么:2026 图像扩展技术原理、演进与实战全解析

- 什么是 Azure Text to Speech?2026 高清语音技术原理与应用详解

- 图像编码器是什么:2026 原理、多模态应用与实战全面解析