重磅:Mixtral 2026 架构巨变,动态路由效率飙升 300% 引爆行业

新闻导语

2026 年 4 月,在备受瞩目的奇点智能技术大会(ML-Summit)上,混合专家模型(MoE)架构迎来里程碑式跃迁。新一代架构突破传统静态路由限制,实现基于语义密度的动态专家激活机制,将路由延迟从毫秒级压缩至亚毫秒级,推理效率较 2023 年发布的 Mixtral 8x7B 提升逾 300%。这一由全球开源社区与头部科技企业共同推动的技术范式转移,标志着万亿参数模型正式进入“按需计算”的高效落地新阶段。

事件详情

本次发布的核心成果被定义为"2026 奇点架构”,其最大亮点在于彻底重构了 MoE 的路由逻辑。根据大会披露的技术白皮书,新架构摒弃了固定的 Top-K 选择策略,转而采用“语义感知连续值”路由,每个 Token 激活的专家数量可在 0.8 至 4.2 之间动态浮动。数据显示,新架构的路由延迟开销已降至 0.9 毫秒以下,相比 Mixtral 时代的 12 毫秒(CPU 环境)及 2025 年 StarMoE 的 3 毫秒(GPU 融合),实现了数量级的优化。

更为关键的是,新架构引入了“跨模型专家池 + 联邦蒸馏”机制,打破了单一模型内部的专家孤岛。官方技术负责人表示:“我们不再是为单个模型训练专家,而是构建一个可被多模型共享、通过联邦学习持续进化的通用专家生态。”这一变革使得模型在保持高精度的同时,显存占用大幅降低,为边缘设备部署千亿级参数模型扫清了障碍。

背景分析

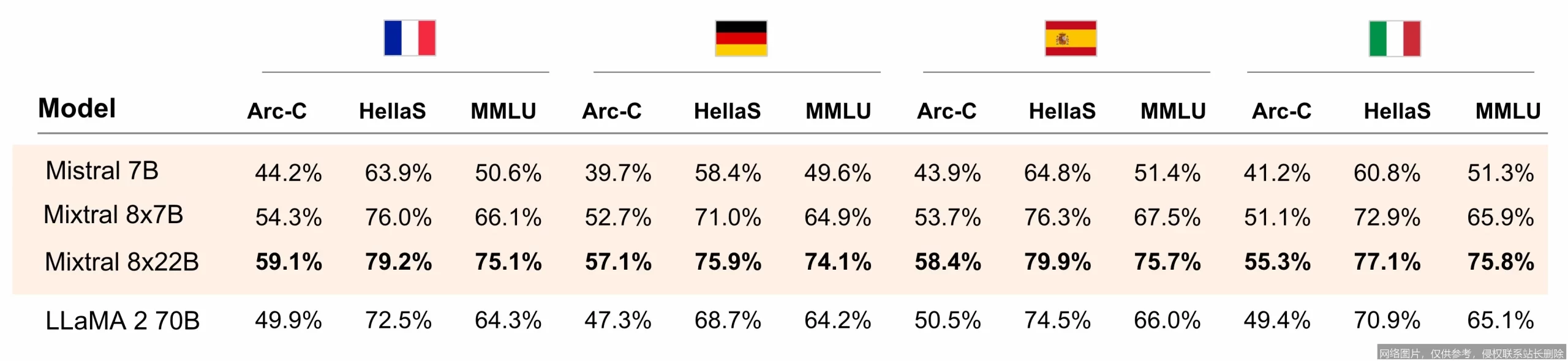

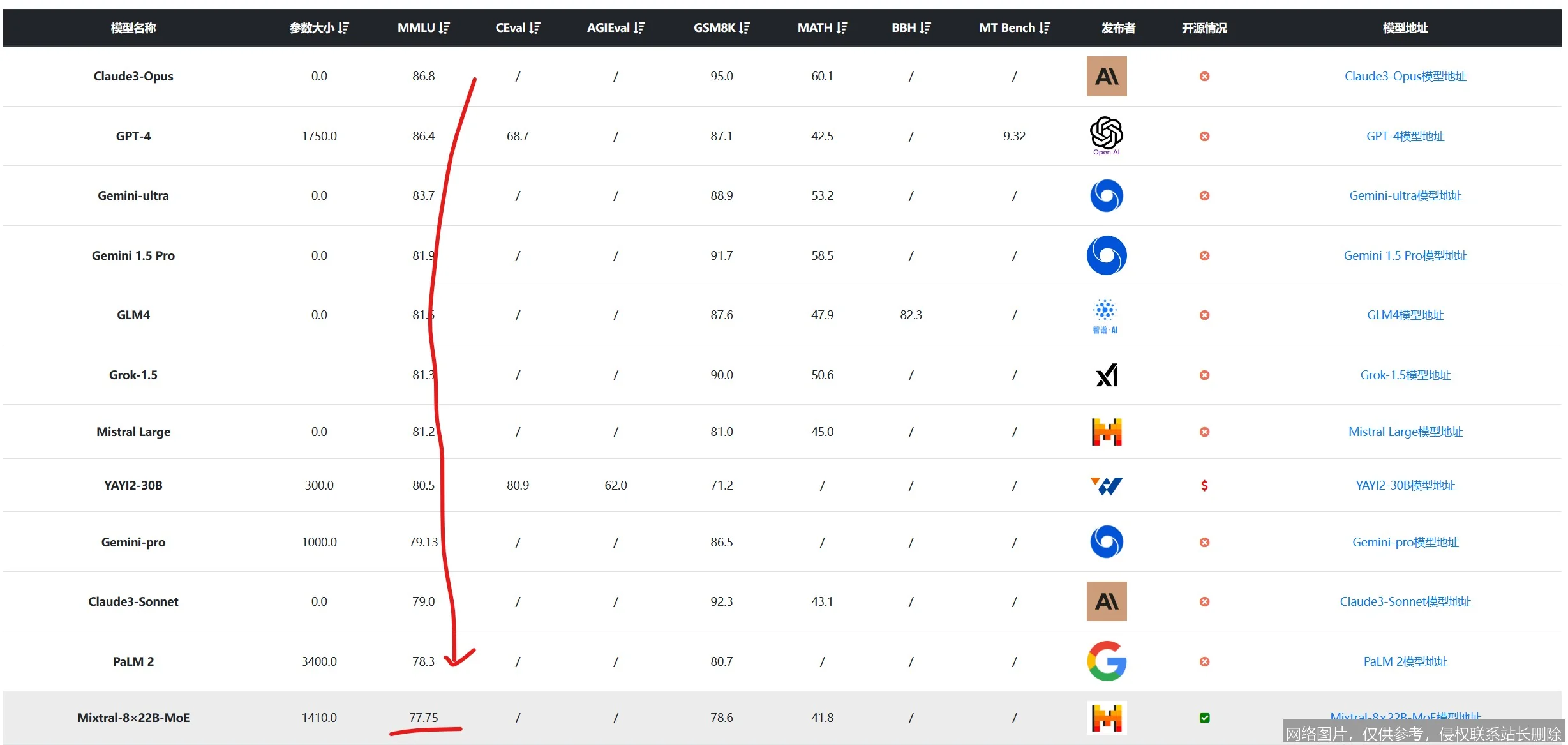

MoE 架构的演进始于 2023 年底 Mistral AI 开源的 Mixtral 8x7B,该模型首次证明稀疏激活可在控制成本的前提下大幅提升模型容量。随后,Qwen-MoE、DeepSpeed-MoE v2 及 Google GShard 等方案相继涌现,逐步解决了动态专家生命周期管理和跨设备调度难题。2025 年,StarMoE 通过层间专家复用将动态路由范围扩展至 1-3 个专家,但仍受限于离散的路由决策。

行业背景显示,随着大模型参数量向万亿级迈进,传统密集模型的算力消耗已成为不可承受之重。正如 DeepSeek-V3 所展示的,利用稀疏性可将算力消耗降至同级别密集模型的十分之一。然而,动态路由带来的通信瓶颈和负载不均问题,长期制约着 MoE 的进一步普及。此次 2026 架构的发布,正是对这一系列痛点的一次系统性回应。

影响评估

此次架构巨变将对 AI 行业格局产生深远影响。首先,它重新定义了大模型的性价比标准,使得中小型企业甚至个人开发者也能负担起以前只有巨头才能驾驭的超大模型推理任务。其次,对于云服务提供商而言,这意味着单位算力的产出效率将显著提升,有望缓解当前全球范围内的 GPU 短缺焦虑。

在市场竞争层面,坚持纯密集模型路线的厂商将面临巨大的成本压力。新架构展示的“用得多、花得少”特性,迫使竞争对手必须加速向稀疏化转型。对于终端用户而言,更低的延迟和更高的响应速度将直接转化为更流畅的交互体验,特别是在实时对话和代码生成等高频场景中。

各方反应

业内专家对此反响热烈。一位资深系统架构师评论道:“从固定 Top-2 到语义感知的连续值路由,这不仅仅是算法的改进,更是计算范式的根本性转变。”开源社区迅速行动,Hugging Face 已宣布将在 Transformers v4.45+ 版本中默认支持相关动态路由逻辑。

硬件厂商方面,NVIDIA 表示其最新的 Blackwell 架构及 Quantum InfiniBand 技术已针对此类细粒度 MoE 通信进行了专项优化,能够充分释放新架构的性能潜力。与此同时,部分专注于类脑计算和存内计算(PIM)的研究团队指出,软件层面的动态路由优化虽已极致,但未来真正的突破或将来自硬件层面的物理可塑性,即通过忆阻器等器件直接模拟生物神经突触的动态调整。

未来展望

展望未来,MoE 架构的演进将不再局限于软件算法的优化。预计在接下来的两年内,随着“硬件层面的可塑性”技术成熟,AI 系统将能够像人脑一样,根据任务需求动态重塑底层电路连接,形成个性化的“硬件捷径”。2026 年下半年,预计将有更多基于新架构的垂直领域模型落地,而在 2027 年,我们或许将见证首个完全基于动态硬件链路的大规模商用 AI 系统的诞生。这一进程将彻底改写人工智能的计算基石。

相关推荐

- 刚刚:2026 成 AI 关键年,大模型竞逐空间智能,全球治理加速落地

- 重磅:2026 AI人才月薪飙至13万,具身智能岗薪资暴涨50%

- 刚刚:OpenAI 完成 1220 亿美元融资,估值飙至 8520 亿创全球纪录

- 刚刚:智谱财报引爆全球!API营收狂飙 60 倍,市值冲破 4000 亿

- 刚刚:Anthropic 绝密报告预警 Claude 逃逸风险,全新智能体 Conway 曝光

- 重磅:2026 中国成全球最大 AI 专利国,开源模型下载破百亿

- 刚刚:OpenAI 发布 GPT-5.4 旗舰模型,推理与代码能力实现史诗级突破

- 重磅:2026 智能体元年爆发,广州布局算电融合,十大赛道重塑产业格局

- 刚刚:智谱发布原生多模态 Coding 基模,2026 智能体工程引爆编程革命

- 刚刚:百度智能云 2026 年增速目标上调至 200%,文心 5.0 领跑全球