视觉语言模型是什么:2026 原理、架构与应用全面解析

一句话定义

视觉语言模型(VLM)是一种融合计算机视觉与自然语言处理能力的多模态人工智能,能同时“看懂”图像并“理解”文字,实现跨模态的深度推理与交互。

技术原理:从“看”到“懂”的神经跃迁

要真正理解视觉语言模型是什么,我们必须深入其技术内核。传统的 AI 系统往往是“单感官”的:计算机视觉(Computer Vision, CV)模型擅长识别图像中的物体,却不懂人类语言;自然语言处理(Natural Language Processing, NLP)模型精通文本生成与逻辑,却对像素世界一无所知。视觉语言模型的诞生,标志着 AI 从“单模态感知”向“多模态认知”的跨越。其核心工作机制可以概括为三个关键步骤:编码(Encoding)、对齐(Alignment)与解码/推理(Decoding/Reasoning)。

1. 核心工作机制:双塔架构与融合策略

目前主流的视觉语言模型架构大多基于“双塔”结构(Two-Tower Architecture),这就像是一个由两位专家组成的团队:一位是“视觉专家”,另一位是“语言专家”。

视觉编码器(Vision Encoder)通常采用经过大规模预训练的 Transformer 变体(如 ViT, Vision Transformer)或卷积神经网络(CNN)。它的任务是将输入的图像切割成一个个小的图块(Patches),并将这些图块转化为高维的向量表示(Embeddings)。这就好比将一幅画拆解成无数个微小的色块,并给每个色块打上数学标签,描述其纹理、形状和色彩特征。

语言编码器(Language Encoder)则通常基于大型语言模型(LLM)的骨干网络,如 LLaMA、Qwen 或 CLIP 的文本端。它负责将用户的文本提示(Prompt)转化为语义向量。这一步确保了模型能够理解问题的语境、指令的意图以及知识的背景。

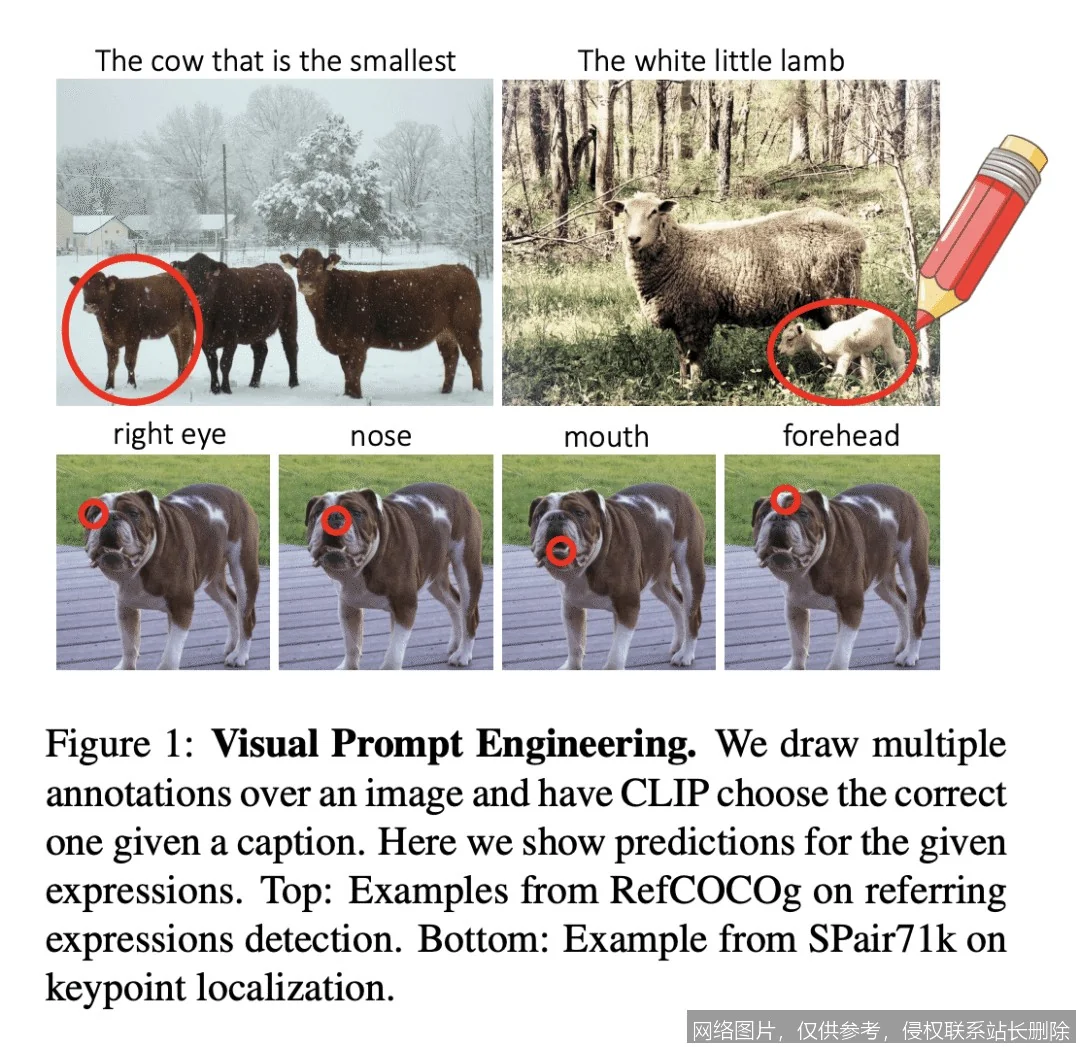

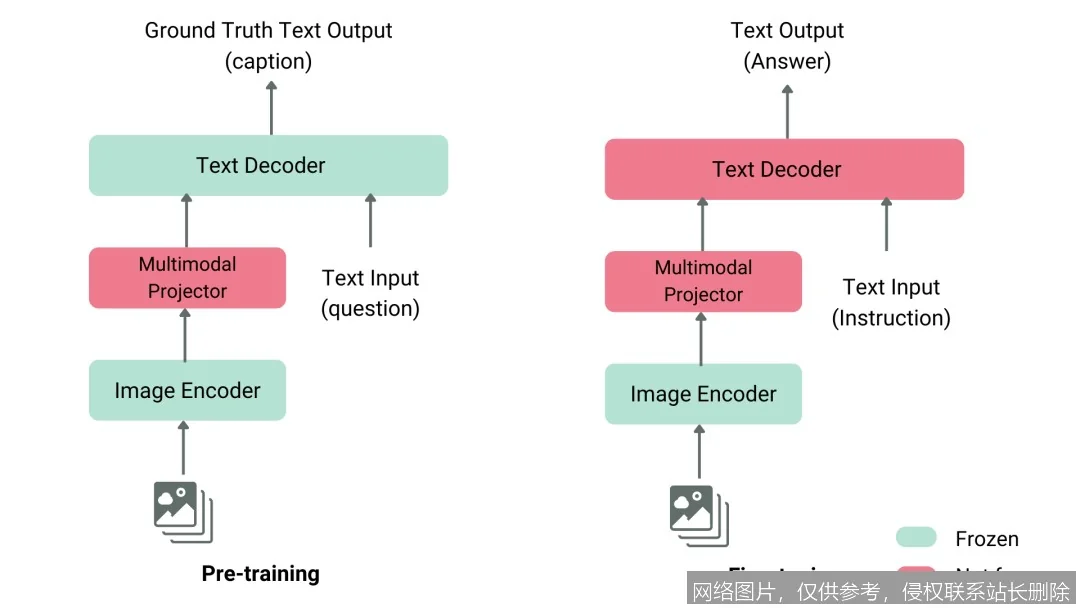

最关键的环节在于模态对齐(Modality Alignment)。在 2026 年的技术视野下,简单的拼接已不足以应对复杂任务。现代 VLM 通过一个称为“投影层”(Projector)或“连接器”(Connector)的中间组件,将视觉向量映射到语言模型的语义空间中。想象一下,视觉专家说的是“图像方言”,语言专家说的是“文本普通话”,投影层就是一个实时的同声传译,它将图像的视觉特征翻译成语言模型能听懂的“视觉令牌”(Visual Tokens)。一旦完成对齐,语言模型就能像处理普通文字一样,基于这些视觉令牌进行自回归生成,输出描述、答案或代码。

2. 关键技术组件解析

构建一个强大的视觉语言模型,离不开以下几个核心技术组件的协同工作:

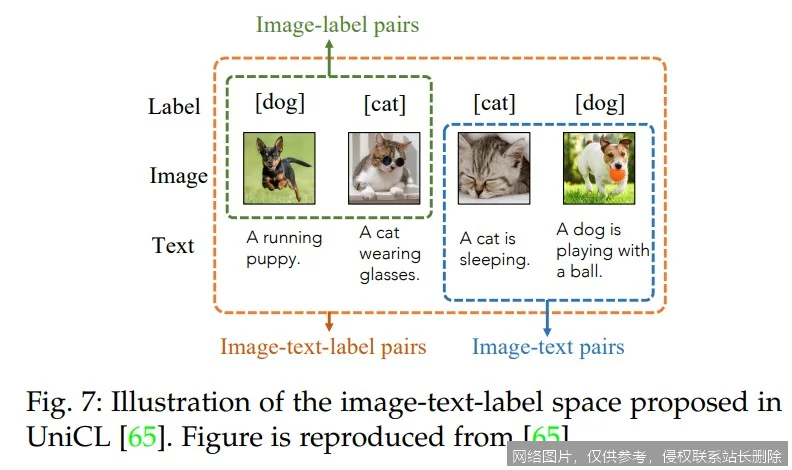

- 对比学习(Contrastive Learning):这是早期模型(如 CLIP)的基石。通过在海量“图像 - 文本”对上进行训练,模型学习拉近匹配对的向量距离,推远不匹配对的距离。这使得模型具备了零样本(Zero-shot)分类能力,即无需专门训练就能识别从未见过的物体类别。

- 指令微调(Instruction Tuning):为了让模型不仅能识别物体,还能回答“图中的人在做什么?”或“请根据这张图写一首诗”这类复杂指令,研究者构建了包含数百万条多模态指令的数据集(如 LLaVA-Instruct)。通过监督微调(SFT),模型学会了遵循人类指令进行多轮对话和逻辑推理。

- 高分辨率动态切片(Dynamic High-Resolution Slicing):针对 2026 年应用场景中对细节的极致追求,现代 VLM 不再将图像压缩为低分辨率缩略图。相反,它们采用动态切片技术,将高清大图切割成多个局部视图,分别编码后再聚合。这使得模型既能把握全局场景,又能看清文档中的微小文字或医学影像中的细微病灶。

3. 与传统方法的对比:从“识别”到“理解”

为了更直观地理解视觉语言模型的革命性,我们可以将其与传统计算机视觉方法进行类比:

| 维度 | 传统计算机视觉 (Traditional CV) | 视觉语言模型 (VLM) |

|---|---|---|

| 核心任务 | 分类、检测、分割(是什么?在哪里?) | 描述、推理、问答、生成(为什么?怎么做?接下来呢?) |

| 输出形式 | 固定的标签列表、边界框坐标 | 开放式的自然语言文本、代码、结构化数据 |

| 知识边界 | 局限于训练集中定义的类别(封闭集) | 依托大语言模型的广阔知识库(开放集) |

| 类比 | 像一个只会指认物体的哑巴观察者 | 像一个博学多才、能讲故事的解说员 |

传统方法像是在做“填空题”,答案必须在预设的选项里;而视觉语言模型是在做“作文题”,它可以根据图像内容,结合外部知识,自由组织语言进行表达。这种从判别式(Discriminative)到生成式(Generative)的转变,正是 2026 年 AI 智能化的核心特征。

核心概念:构建多模态认知的基石

在深入探讨视觉语言模型是什么的过程中,我们会遇到一系列专业术语。理清这些概念及其相互关系,是掌握该技术的关键。

1. 关键术语解释

多模态(Multimodality):指模型能够同时处理和关联两种或多种不同类型的数据输入,最常见的是视觉(图像/视频)和文本。多模态不仅仅是数据的简单叠加,而是不同感官信息之间的互补与增强。

嵌入空间(Embedding Space):这是一个高维的数学空间,所有的图像和文本都被转化为这个空间中的点(向量)。在理想的 VLM 中,语义相似的图像和文本(例如“一只猫的照片”和“一只猫”这个词)在这个空间中的距离非常近。这是模型实现跨模态理解的数学基础。

视觉令牌(Visual Tokens):类似于 NLP 中的单词(Tokens),视觉令牌是将图像离散化后的基本单元。通过将图像划分为网格,每个网格被编码为一个令牌,使得语言模型可以将图像视为一种特殊的“外语”句子来处理。

幻觉(Hallucination):这是当前 VLM 面临的主要挑战之一。指模型生成的描述中包含图像中不存在的物体、属性或关系。例如,图片中明明没有狗,模型却信誓旦旦地说“草地上有一只狗”。这通常源于语言模型的先验知识过强,压倒了视觉证据。

2. 概念关系图谱

理解这些概念的逻辑流向至关重要:

[原始图像] + [文本提示]

↓ (编码 Encoding)

[视觉向量] + [文本向量]

↓ (投影与对齐 Projection & Alignment)

[统一的语义嵌入空间]

↓ (大语言模型推理 LLM Reasoning)

[自然语言回答 / 代码 / 动作指令]

在这个链条中,对齐是桥梁,嵌入空间是土壤,大语言模型是大脑。没有高质量的对齐,视觉信息无法被大脑利用;没有广阔的嵌入空间,模型无法容纳丰富的世界知识。

3. 常见误解澄清

误解一:"VLM 只是给图片加个字幕。”

事实:早期的图像描述(Image Captioning)确实只做这件事。但 2026 年的 VLM 具备复杂的逻辑推理能力。它可以解答数学题(看图列式计算)、分析图表趋势、甚至根据电路图编写代码。它不仅是描述者,更是分析者和决策者。

误解二:“只要数据量够大,VLM 就能完美理解一切。”

事实:数据规模固然重要,但数据的质量和多样性更为关键。如果训练数据中存在偏见(如特定职业只出现男性),模型会继承甚至放大这些偏见。此外,纯粹的堆砌数据无法解决“幻觉”问题,需要引入强化学习(RLHF)和更精细的验证机制。

误解三:"VLM 取代了所有的专用视觉模型。”

事实:虽然 VLM 通用性强,但在某些对实时性、精度要求极高的特定场景(如自动驾驶的毫秒级障碍物检测、工业质检的微米级缺陷识别),专用的轻量级视觉模型依然具有不可替代的优势。未来的趋势是"VLM 作为大脑进行宏观调度,专用小模型作为眼睛执行微观任务”的协同模式。

实际应用:重塑人机交互的新范式

理解了原理与概念后,我们来看视觉语言模型是什么在现实世界中的具体投射。2026 年,VLM 已从实验室走向千行百业,成为基础设施级的技术。

1. 典型应用场景

智能办公与文档处理(Document Intelligence):

企业每天产生海量的扫描文档、发票、合同和图表。传统 OCR(光学字符识别)只能提取文字,丢失排版和逻辑信息。VLM 可以直接“阅读”整份文档,理解表格结构、印章位置及上下文逻辑。用户只需提问:“这份合同中关于违约金的条款是什么?”,模型即可精准定位并总结,甚至自动填入数据库。

具身智能与机器人(Embodied AI & Robotics):

这是 VLM 最具颠覆性的应用领域之一。机器人不再需要程序员为每个动作编写代码。通过搭载 VLM,机器人可以接收自然语言指令,如“把桌子上红色的苹果放进篮子里”。模型会分析摄像头画面,识别物体、判断空间关系、规划抓取路径,并转化为机器人的控制代码。这使得通用家庭服务机器人和商业物流机器人真正成为可能。

辅助医疗与科学发现(Healthcare & Science):

在医疗领域,VLM 可以作为医生的超级助手。它能分析 X 光片、CT 扫描或病理切片,不仅指出异常区域,还能结合患者的电子病历(文本),生成初步的诊断建议和鉴别诊断列表。在科研领域,科学家可以让 VLM 分析显微镜下的细胞变化视频,自动记录实验现象并生成实验报告草稿。

无障碍技术与教育(Accessibility & Education):

对于视障人士,VLM 充当了“第二双眼睛”。通过手机摄像头,用户可以随时询问:“我面前的公交车是几路?”、“这瓶药的保质期是多少?”。在教育领域,学生拍摄一道几何题,VLM 不仅能给出答案,还能像老师一样一步步讲解解题思路,甚至根据学生的错题生成个性化的练习题。

2. 代表性产品与项目案例

- GPT-4o / Gemini Ultra (2026 演进版):作为通用型 VLM 的标杆,它们实现了原生多模态(Native Multimodality),音频、视频、文本和图像在模型内部统一处理,延迟极低,支持实时的视频流对话,广泛应用于个人助理和创意创作。

- LLaVA-Next / Qwen-VL-Max:代表了开源社区的力量。这些模型在特定领域(如中文文档理解、长上下文视频分析)表现卓越,允许企业在私有数据上进行微调,保障了数据隐私,深受金融、法律等行业青睐。

- Figure 01 / Tesla Optimus:这些人形机器人项目深度集成了 VLM 技术,使其能够在非结构化的人类环境中执行复杂的家务和工厂任务,展示了从“感知”到“行动”的闭环能力。

3. 使用门槛和条件

尽管 VLM 功能强大,但其落地应用仍有一定门槛:

- 算力需求:运行高精度的 VLM 通常需要高性能 GPU 集群。虽然量化技术和端侧芯片(On-device AI)的发展降低了门槛,但对于实时视频分析等重负载任务,云端部署仍是主流。

- 数据隐私与安全:由于模型需要“看”到用户上传的图片,涉及敏感信息(如人脸、商业机密)的场景必须建立严格的数据脱敏和本地化处理机制。

- 提示词工程(Prompt Engineering):要获得最佳结果,用户仍需掌握一定的提问技巧。清晰的指令、适当的上下文引导能显著减少模型的幻觉,提升输出质量。

延伸阅读:通往未来智能的阶梯

如果您对视觉语言模型是什么有了初步认识,并希望进一步探索这一前沿领域,以下资源将为您提供进阶的学习路径。

1. 相关概念推荐

为了构建完整的知识体系,建议您同步了解以下相关概念:

- 世界模型(World Models):VLM 的终极进化形态。不仅能理解当前的图像,还能预测未来的状态,模拟物理世界的运行规律,是通向通用人工智能(AGI)的关键。

- 神经符号人工智能(Neuro-symbolic AI):尝试将深度学习(神经网络)的感知能力与符号逻辑的推理能力相结合,旨在解决 VLM 在复杂逻辑推理中的短板。

- 检索增强生成(RAG, Retrieval-Augmented Generation):在多模态场景下的应用,即让 VLM 在回答问题时,先去外部知识库检索相关的图片或文档片段,从而提高准确性和时效性。

2. 进阶学习路径

第一阶段:基础夯实

复习深度学习基础,重点掌握 Transformer 架构、Attention 机制以及 CNN 的基本原理。推荐课程:吴恩达(Andrew Ng)的《Deep Learning Specialization》。

第二阶段:多模态入门

研读经典论文,理解对比学习和双塔架构。必读论文:《Learning Transferable Visual Models From Natural Language Supervision》(CLIP)、《Bootstrapping Language-Image Pre-training for Unified Vision-Language Understanding and Generation》(BLIP)。

第三阶段:实战与前沿

动手复现开源项目(如 LLaVA),学习如何使用 Hugging Face Transformers 库加载和微调 VLM。关注 arXiv 上的最新预印本,特别是关于“高效微调(PEFT)”、“长上下文视频理解”和“具身智能”方向的文献。

3. 推荐资源和文献

- 学术论文库:arXiv.org (cs.CV 和 cs.CL 板块),这里是全球最新研究成果的首发地。

- 开源社区:Hugging Face Model Hub,提供了数千个预训练的 VLM 模型和数据集,是实践的最佳场所。

- 行业报告:Stanford HAI (Human-Centered AI) 发布的年度《AI Index Report》,其中有多模态发展的专项章节,数据详实,观点权威。

- 技术博客:Sebastian Raschka 的博客、Jay Alammar 的可视化图解系列,擅长用直观的图表解释复杂的模型架构。

视觉语言模型不仅仅是一项技术突破,它是机器感知世界方式的一次根本性变革。从 2026 年的视角回望,我们正站在一个新时代的起点:机器不再是冷冰冰的数据处理器,而是能够看懂我们的世界、理解我们的意图、并与我们共同创造的智能伙伴。希望本文能为您打开通往这一奇妙世界的大门。