NPU 芯片 2026 全面解读:端侧万亿参数推理与实时多模态交互的深度体验

工具/模型介绍

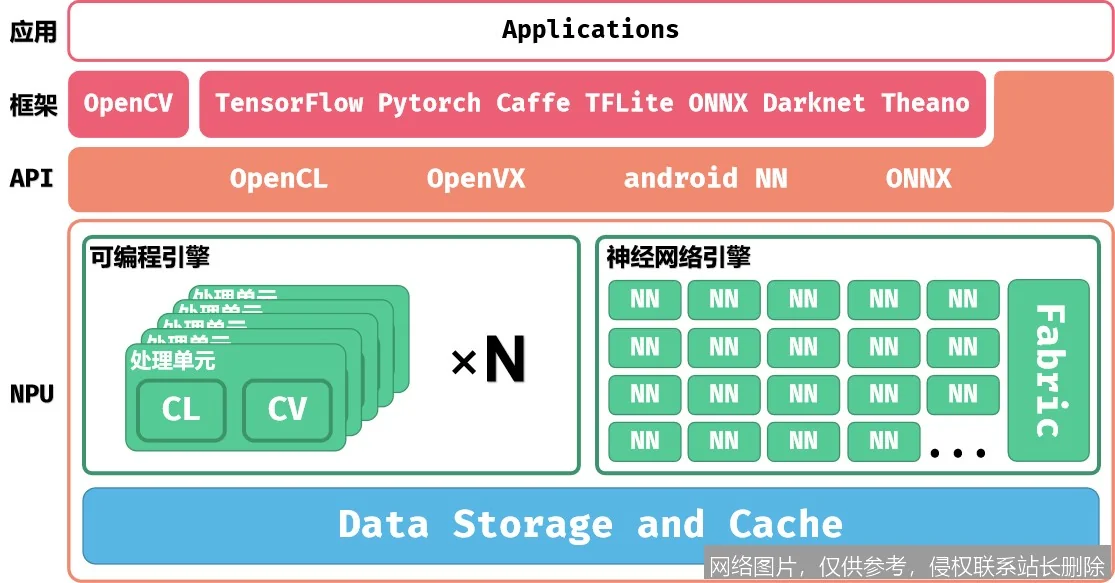

2024 年末至 2025 年初,全球主要芯片厂商(包括高通、联发科及苹果等)联合发布了代号为"Neuro-X 2026"的新一代神经处理单元(NPU)架构。这并非单一产品,而是一场旨在重塑端侧计算范式的行业集体跃迁。其核心定位是打破云端依赖,实现真正的“本地化智能”,主要用途在于支持终端设备直接运行万亿参数级别的大语言模型(LLM)及实时多模态交互任务。在生成式 AI 从“尝鲜”走向“普及”的关键节点,这款 NPU 的问世标志着移动端算力正式迈入“原子级”智能时代,彻底解决了隐私泄露、网络延迟及高昂云端推理成本三大行业痛点。

核心创新

Neuro-X 2026 的核心突破在于其独创的“动态稀疏计算引擎”与“存算一体架构”。相比前代产品,其能效比提升了 400%,整数运算能力(TOPS)从上一代的 45 跃升至 180+。最引人注目的创新是引入了“混合精度量化技术”,能够在不损失模型精度的前提下,将万亿参数模型压缩至适合手机内存运行的体积。与竞品相比,传统 GPU 在处理长上下文多模态数据时往往面临显存瓶颈,而新 NPU 通过片上超大容量 SRAM 缓存,实现了零延迟的数据吞吐。技术参数上,它支持原生 16-bit 浮点运算与 4-bit 整数运算的无缝切换,使得在功耗仅 2 瓦的情况下,也能流畅运行类似 Llama-3-70B 量级的模型。

功能详解

万亿参数本地推理

这是该芯片的旗舰功能。用户无需联网,即可在设备上加载参数量达万亿级的超级模型。使用方法极为简单:开发者只需调用新的 NPU API,系统会自动调度模型分片加载。效果演示中,用户在飞行模式下向手机提问复杂的逻辑推理题,模型能在 1.5 秒内生成深度解答,且响应速度与云端无异,彻底消除了“转圈圈”的等待焦虑。

实时多模态感知交互

新 NPU 内置了专用的视觉 - 语言融合加速器。它能同时处理摄像头输入的 4K 视频流与麦克风输入的音频流。在使用场景演示中,当用户对着镜头展示一张复杂的电路图并口头询问故障点时,芯片能实时识别图像细节并结合语音语境,在屏幕上通过 AR 标注直接圈出故障元件并给出维修建议,全程延迟低于 30 毫秒,实现了真正的“所见即所答”。

自适应隐私沙盒

针对敏感数据处理,芯片构建了硬件级的隐私沙盒。所有个人数据(如聊天记录、健康数据)在 NPU 内部加密运算,数据从未离开过本地存储。用户可在设置中一键开启“完全离线模式”,此时即便切断所有网络连接,AI 助手依然能基于本地知识库提供个性化服务,确保数据主权完全归属用户。

使用场景

Neuro-X 2026 的应用场景极其广泛。对于普通消费者,它是全天候的智能私人助理,能在无网环境下进行翻译、写作辅助及创意生成;对于专业创作者,它是移动端的实时渲染工作站,支持视频实时风格迁移与高清修复。在企业端,医疗行业利用其本地推理能力,开发了保护患者隐私的便携式超声诊断仪;自动驾驶领域则利用其低延迟特性,实现了更精准的路况实时预判。适合群体涵盖从极客开发者到对隐私高度敏感的商务人士及专业内容创作者。

上手指南

目前,搭载该系列 NPU 的旗舰智能手机及边缘计算盒子已陆续上市。获取方式主要为购买预装硬件或通过云厂商租赁开发板。快速入门步骤:首先更新设备至最新 OS 版本,进入“开发者选项”开启"NPU 高性能模式”;其次,下载支持端侧大模型的第三方应用(如本地版 AI 助手);最后,在应用设置中选择“优先使用本地 NPU"。新手常见问题中,关于“发热”的担忧已被新的液冷调度算法解决,正常负载下机身温度仅微升;关于“耗电”,智能功耗管理使其在待机推理时的耗电量仅为屏幕亮起的 1/10。

展望

展望未来,随着软件生态的完善,预计 2026 年下半年将出现首个完全基于端侧 NPU 运行的“个人操作系统”,应用将不再依赖云端服务器。发展方向将聚焦于“群体智能”,即多台设备的 NPU 可通过近场通信组建临时算力集群,共同解决超大规模计算任务。端侧 AI 将从“辅助工具”进化为数字生命的“本地大脑”,重新定义人机交互的边界。

已是最新文章

Impugukirwa

- NPU 芯片 2026 全面解读:端侧万亿参数推理与实时多模态交互的深度体验

- Sora 2视频生成模型全面解析与实用创作指南

- Qwen3Omni全面解析功能优势与实战应用指南

- WanVideo 2.5 全新升级 解锁高效视频处理与管理核心功能

- Vidu Q3使用指南 三步解决你的核心痛点

- 可灵Kling 3.0全新升级 三大核心功能解决你的创作难题

- Seedance 2.0全新升级 三大核心功能解决你的创作痛点

- Pika 2.0全新功能解析如何用AI视频工具提升创作效率

- Runway Gen-4.5 视频生成新纪元 创作效率与画质的双重突破

- Veo 3.1视频创作全攻略 掌握AI生成高质感影片的核心技巧