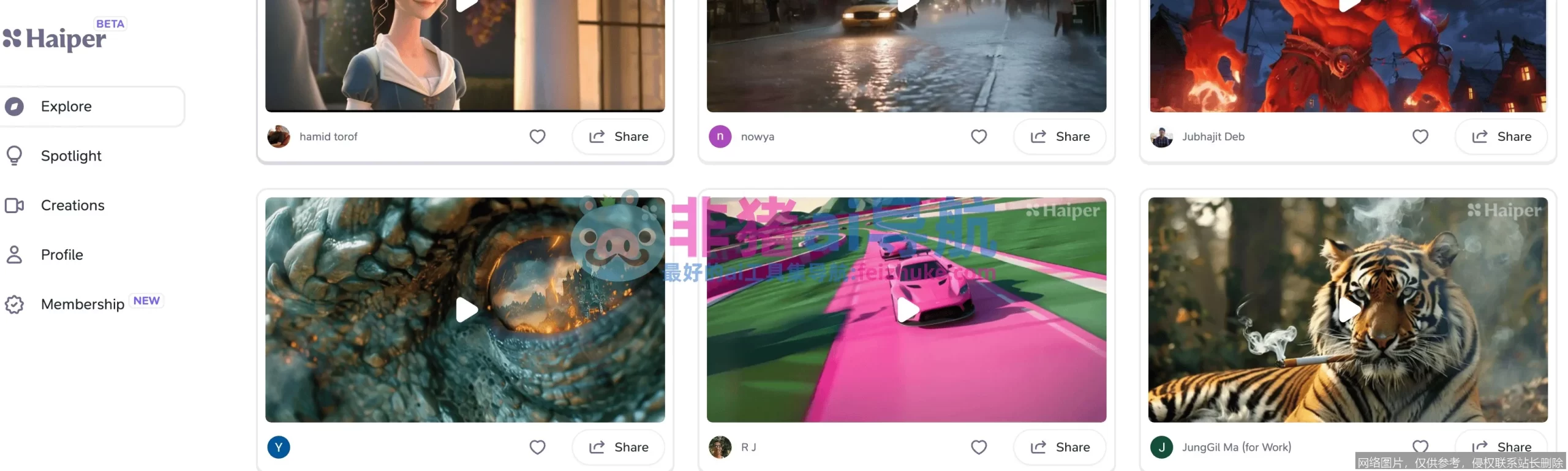

Haiper AI 2026 全面解读:导演视角 +8 秒高清生成的视频创作神器

工具/模型介绍

Haiper AI 是由前 Google DeepMind 核心团队成员创立的初创公司推出的新一代视频生成模型。自发布以来,它迅速在 AI 视频创作领域占据了一席之地,被广泛视为挑战行业巨头(如 Runway Gen-3、Luma Dream Machine)的黑马。该模型的定位非常明确:为创作者提供电影级质感的短视频生成工具,特别强调对物理规律的精准模拟和画面的高保真度。

在 Sora 尚未完全开放的背景下,Haiper AI 的出现填补了市场对“可控且高清”视频生成的迫切需求。它不仅是一个简单的文生视频工具,更试图成为导演手中的数字摄影机,让普通用户也能通过自然语言指令,创造出具有专业光影效果和动态逻辑的视觉内容,极大地降低了高质量视频内容的生产门槛。

核心创新

Haiper AI 的核心突破在于其独特的时空一致性架构。与早期模型常出现的画面闪烁、物体形变不同,Haiper 采用了先进的潜在扩散模型(Latent Diffusion Models)结合改进的时间注意力机制,确保了视频在长达数秒的生成过程中,主体特征和背景环境保持高度稳定。

相比竞品,Haiper 的最大提升体现在"8 秒高清生成”的能力上。大多数同类工具在生成超过 4 秒的视频时,画质往往会急剧下降或出现逻辑崩坏,而 Haiper 能够原生支持 1080p 分辨率下的流畅长镜头。此外,其在流体动力学、光影反射等物理细节的渲染上表现惊人,例如水流的下落轨迹、玻璃的反光变化都符合真实世界的物理规律,这使其在写实风格上独树一帜。

技术参数方面,Haiper 支持高达 24fps 的帧率输出,并在运动幅度控制上提供了更细腻的调节空间,解决了传统模型“动则模糊,静则呆板”的痛点。

功能详解

文生视频(Text-to-Video):导演的剧本具象化

这是 Haiper 最基础也最强大的功能。用户只需输入一段详细的提示词(Prompt),即可生成高质量视频。其创新之处在于对“导演视角”的理解——模型能准确识别镜头语言,如“推镜头”、“低角度拍摄”或“慢动作”。使用者无需掌握复杂的参数,只需描述画面内容和运镜方式,系统便能自动匹配最佳的光影和构图。

图生视频(Image-to-Video):静态画面的动态复活

上传一张静态图片,Haiper 能让其“活”过来。该功能不仅限于让人物眨眼或头发飘动,更能理解图片中的深度信息和物理结构。例如,上传一张风景照,可以指定云层流动的方向和水波的起伏;上传人物肖像,可控制其转头或微笑的幅度。这一功能对于将老照片修复动态化或制作动态海报极具价值。

视频重绘与扩展(Repaint & Extend)

Haiper 允许用户对已有视频的特定区域进行重绘,或者延长视频的时长。用户可以遮罩视频中不满意的物体(如路人、杂物),通过文字指令将其替换或删除,同时保持背景的自然过渡。视频扩展功能则能在不破坏原有风格的前提下,将 4 秒的片段无缝延伸至 8 秒甚至更长,为叙事完整性提供了保障。

使用场景

Haiper AI 的应用场景极为广泛。对于广告营销人员,它可以快速生成产品概念片,无需昂贵的实拍团队;对于独立电影人,它是预演分镜(Pre-viz)的神器,能低成本验证创意构想;对于社交媒体创作者,它能批量生产吸睛的短视频素材。此外,在游戏开发领域,开发者利用其生成动态贴图或过场动画原型,大幅缩短了美术资产的制作周期。

上手指南

目前,Haiper AI 主要通过其官方网站进行访问。用户需注册账号(通常支持邮箱或第三方登录),新注册用户通常会获得一定的免费积分用于体验。

快速入门步骤:

1. 访问官网并登录,进入创作工作台。

2. 选择"Text to Video"或"Image to Video"模式。

3. 在提示词框中输入详细描述(建议使用英文以获得最佳效果,可包含风格、光照、运镜关键词)。

4. 调整时长(推荐先试生成 2-4 秒)和分辨率,点击生成。

5. 预览结果,满意后可下载或尝试延长视频。

新手常见问题:若生成画面手指变形或逻辑混乱,建议简化提示词,聚焦于主体动作;若画质不够清晰,可尝试使用“高清修复”功能或在提示词中加入"4k, highly detailed"等权重词。

展望

随着多模态技术的迭代,预计未来的 Haiper AI 将在“可控性”上迎来更大突破,例如支持更精确的角色一致性(Character Consistency)和多镜头连续叙事能力。长远来看,它有望集成音频生成模块,实现音画同步的一站式创作,真正进化为个人专属的"AI 制片厂”,彻底重塑视频内容的生产范式。

已是最新文章

相关推荐

- Haiper AI 2026 全面解读:导演视角 +8 秒高清生成的视频创作神器

- Kimi K2.5 深度体验:原生多模态 + 百智能体集群的 2026 开源王炸

- Llama 3.1 全面解读:2026 年端侧推理新标杆与工业级微调实战

- Runway Gen-3 Alpha Turbo 2026 深度体验:电影级运控重塑视频创作

- AI 伴侣 2026 全面解读:从全息投影到情感计算,重塑你的数字生活

- InternVL 3.5 深度体验:2026 开源多模态新标杆,推理效率全面升级

- DALL-E 3 全面解读:2026 年语义理解与局部重绘的终极进化

- Cursor 2026 深度体验:独立 Agent 构建软件工厂,三大模式全面解读

- GLM-4.7 深度体验:2026 开源编码与多模态视觉新标杆

- Udio 最新深度体验:2026 授权合作与可视化编辑重塑音乐创作