HumanEval 是什么:代码生成评估基准的原理、演进与 2026 应用详解

HumanEval 是什么:代码生成评估基准的原理、演进与 2026 应用详解

在人工智能飞速发展的今天,大型语言模型(LLM)已经不再仅仅是对话的伙伴,它们正逐渐演变为程序员得力的“结对编程”助手。然而,如何科学、客观地衡量一个 AI 模型写代码的能力?是看它生成的代码行数,还是看它能否通过编译?为了解决这一难题,OpenAI 在 2021 年推出了 HumanEval 基准测试。随着时间推移至 2026 年,HumanEval 已从最初的单一评测集,演变为衡量代码智能体(Coding Agents)核心能力的“黄金标准”。本文将深入剖析 HumanEval 的本质、技术原理、核心概念及其在当下的实际应用。

1. 一句话定义

HumanEval 是一个由 164 道手工编写的编程挑战组成的评估基准,旨在通过单元测试通过率(pass@k)量化大语言模型生成可执行、功能正确代码的能力。

2. 技术原理

要理解 HumanEval 为何能成为行业标杆,我们需要深入其背后的技术机制。与传统基于文本相似度或困惑度(Perplexity)的评估方法不同,HumanEval 采用的是功能性验证(Functional Correctness)范式。这就好比评价一位厨师,不是看他切菜的姿势是否优美(文本流畅度),而是看他做出来的菜是否符合食谱的味道(功能正确性)。

2.1 核心工作机制:从提示到执行的闭环

HumanEval 的评估流程是一个严密的自动化闭环,主要包含以下三个关键步骤:

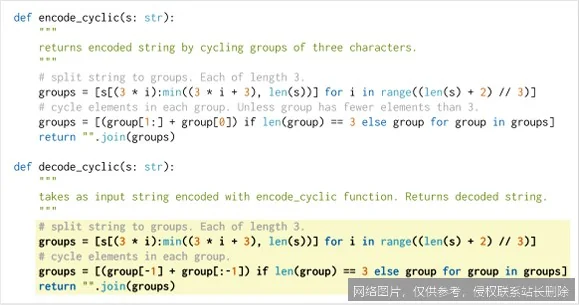

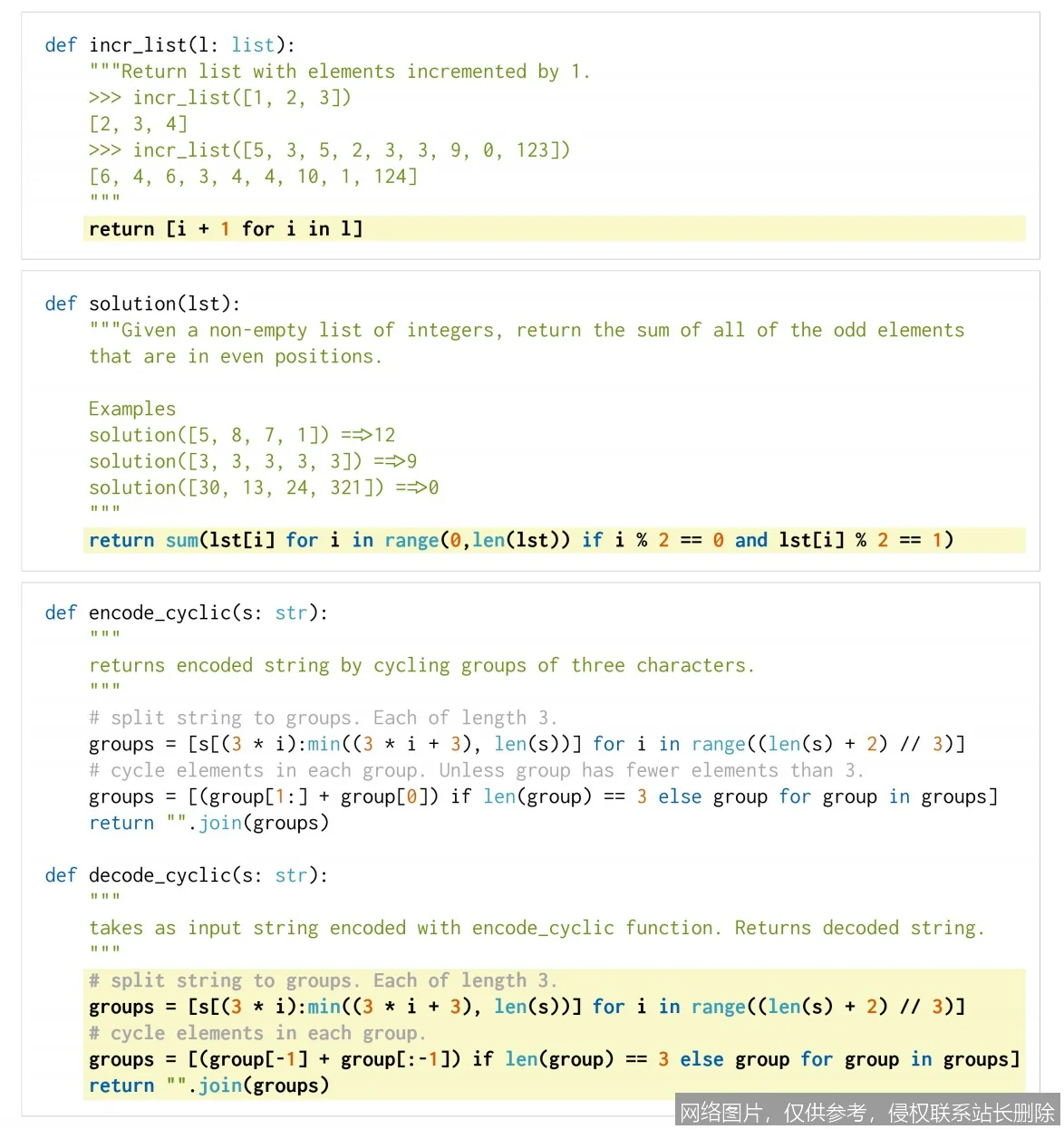

- 问题构建(Problem Formulation):每个测试用例包含一个函数签名(Function Signature)、一段详细的自然语言文档字符串(Docstring)以及一组隐藏的单元测试(Unit Tests)。Docstring 中不仅描述了函数的功能,通常还包含输入输出的示例(Few-shot examples),作为给模型的“提示工程”素材。

- 代码生成(Code Generation):被测模型接收函数签名和 Docstring 作为输入上下文(Context),并尝试补全后续的函数体代码。在这个过程中,模型可以生成多个候选解决方案(通常设置为 k=1, 10, 100 等)。

- 沙箱执行与验证(Sandboxed Execution & Verification):这是 HumanEval 最核心的环节。系统会将模型生成的代码提取出来,放入一个隔离的安全沙箱环境(如 Docker 容器)中,并与预设的单元测试用例进行对接执行。只有当生成的代码通过了所有隐藏的测试用例,该次生成才会被标记为“成功”。

这种机制彻底摒弃了主观判断,将代码质量的评估转化为二元的布尔值结果:通过(Pass)或不通过(Fail)。

2.2 关键技术组件:Pass@k 指标解析

在 HumanEval 中,最关键的度量指标是 pass@k。这是一个概率统计概念,用于评估模型在生成 $k$ 个候选代码样本时,至少有一个样本能通过所有测试的概率。

为什么需要 pass@k 而不是简单的准确率?因为代码生成具有高度的随机性和多样性。有时候模型第一次生成的代码可能有细微的语法错误,但第二次尝试就完美无缺。如果只看第一次生成(pass@1),可能会低估模型的真实潜力。

其数学计算公式如下:

pass@k = E [1 - (C(n-c, k) / C(n, k))] 其中,$n$ 是每个问题生成的总样本数(通常很大,用于估算分布),$c$ 是通过测试的正确样本数。在实际操作中,为了节省算力,通常直接生成 $k$ 个样本,若其中至少有一个通过,则计为 1,否则为 0,最后对所有问题取平均值。

到了 2026 年,随着模型能力的提升,业界不仅关注 pass@1(反映模型的精准度和一次性解决问题的能力),也高度关注 pass@10 或 pass@100(反映模型在配合自动修复、多轮迭代代理时的上限能力)。

2.3 与传统方法的对比

在 HumanEval 出现之前,评估代码模型主要依赖以下几种方法,但它们都存在显著缺陷:

| 评估方法 | 核心逻辑 | 主要缺陷 | HumanEval 的优势 |

|---|---|---|---|

| BLEU / ROUGE | 计算生成代码与参考代码的文本重叠度(N-gram 匹配)。 | 代码具有多解性。不同的变量名、算法实现都能实现相同功能,但文本相似度极低。导致评分与实际功能无关。 | 功能导向:只要逻辑正确,代码风格迥异也能得满分。 |

| 编译通过率 | 仅检查代码是否能通过编译器语法检查。 | 能编译的代码不一定是正确的代码(例如死循环、逻辑错误、边界条件处理失败)。 | 逻辑验证:通过单元测试覆盖边界条件和核心逻辑,确保语义正确。 |

| 人工评审 | 由专家程序员逐行阅读并打分。 | 成本极高,速度慢,且存在主观偏差,难以规模化评估快速迭代的模型。 | 自动化与可扩展:可在几分钟内完成对数千个模型版本的评估,结果可复现。 |

通过对比可以看出,HumanEval 抓住了软件工程的核心——“代码是为了运行并解决具体问题”,从而确立了其作为代码生成领域“图灵测试”的地位。

3. 核心概念

深入理解 HumanEval,需要掌握一系列相关的专业术语和概念。这些概念构成了评估体系的骨架,同时也厘清了常见的认知误区。

3.1 关键术语解释

- Docstring(文档字符串):在 Python 等语言中,位于函数定义下方的字符串,用于描述函数的用途、参数和返回值。在 HumanEval 中,它是模型主要的信息源,模拟了程序员阅读需求文档的场景。

- Assertion(断言):单元测试中的核心语句,用于声明某个条件必须为真。HumanEval 的测试用例主要由一系列断言组成,例如

assert candidate(2) == 4。模型生成的代码必须让所有断言成立。 - Synthetic Data vs. Hand-written Data(合成数据与手写数据):HumanEval 的最大特点在于其 164 个问题全部由人类专家手工编写,而非从 GitHub 等公开仓库爬取后清洗得到的。这有效防止了“数据泄露”(Data Contamination),即模型因为在训练阶段见过原题而“背诵”答案,而非真正学会编程。

- Code Contamination(代码污染):指评估集中的题目意外出现在模型的训练数据中。由于 HumanEval 是闭源发布的(仅发布测试脚本和问题描述,不公开标准答案代码),且题目独特,极大地降低了污染风险,保证了评估的公正性。

- Execution Sandbox(执行沙箱):一个受限的计算环境,用于安全地运行不可信的生成代码。它限制了网络访问、文件系统写入和资源消耗,防止模型生成恶意代码(如删除文件、挖矿)破坏评估服务器。

3.2 概念关系图谱

为了更直观地展示这些概念之间的联系,我们可以构建如下的逻辑关系:

HumanEval 基准 依赖于 手工编写的问题集 以避免 数据污染。每个问题包含 Docstring(输入给模型)和 单元测试(包含断言)。模型基于 Docstring 生成 候选代码。候选代码进入 执行沙箱 与单元测试对接。执行结果决定 Pass/Fail 状态。最终聚合所有问题的状态计算出 pass@k 指标,以此反映模型的 功能正确性。

在这个链条中,手工编写是信度的基石,沙箱执行是安全的保障,而 pass@k是最终的量化标尺。

3.3 常见误解澄清

误解一:"HumanEval 分数高代表模型能开发完整的软件系统。”

澄清:这是一个典型的过度推断。HumanEval 主要评估的是“函数级”的代码生成能力(Function-level completion)。题目通常是独立的算法题或工具函数(如“计算斐波那契数列”、“解析 JSON 字符串”)。它并不评估架构设计、模块交互、长期上下文记忆或复杂调试能力。一个在 HumanEval 上得满分的模型,未必能独立构建一个电商网站。为此,后续出现了如 SWE-bench 等针对任务级(Task-level)的基准作为补充。

误解二:"pass@1 是唯一重要的指标。”

澄清:在 2026 年的视角下,随着 AI 编程助手(Copilot 类工具)的普及,人机协作模式发生了变化。开发者往往会让 AI 生成多个方案供选择,或者让 AI 自主进行多次试错修复。因此,pass@10 甚至 pass@100 反映了模型在“代理模式”(Agent Mode)下的潜力。高分的 pass@1 代表模型像资深专家一样精准,而高分的 pass@100 代表模型拥有广阔的探索空间,适合用作自动化修复工具的后端引擎。

误解三:"HumanEval 只适用于 Python。”

澄清:虽然原始的 HumanEval 数据集是基于 Python 的,但其评估理念和方法论已经被移植到了多种编程语言。社区衍生出了 HumanEval-Java, HumanEval-C++, HumanEval-JS 等版本。此外,Multilingual HumanEval 更是涵盖了数十种语言,用于评估多语言代码模型的能力。

4. 实际应用

自 2021 年发布以来,HumanEval 迅速从一个学术研究工具演变为工业界的标准配置。到了 2026 年,其应用场景更加多元化,深刻影响着模型研发、产品选型乃至软件开发流程。

4.1 典型应用场景

- 大模型预训练与微调的“指南针”:在训练代码专用大模型(Code LLM)时,研发团队会在每个训练 checkpoint(检查点)上运行 HumanEval 评估。通过观察 pass@1 曲线的变化,工程师可以判断模型是否过拟合、学习率是否合适,或者某种新的架构改进(如引入特定的代码注意力机制)是否有效。它是模型迭代过程中最敏感的反馈信号之一。

- 企业级 AI 编程助手的选型依据:当一家科技公司决定引入内部 AI 编程助手时,采购团队不会只听厂商的宣传 PPT。他们会要求厂商提供在 HumanEval(以及 MBPP、SWE-bench 等)上的最新得分报告。对于金融、医疗等对代码准确性要求极高的行业,HumanEval 分数往往是准入的门槛。例如,某银行可能规定,辅助生成核心交易逻辑的模型,其 HumanEval pass@1 必须高于 85%。

- 自动化代码修复(Self-Repair)系统的基准:2026 年流行的“自主智能体”(Autonomous Agents)具备自我纠错能力。系统会先生成代码,运行测试,如果失败,则利用报错信息再次生成,直到通过。这类系统的核心能力评估,高度依赖 HumanEval 的 pass@k (k>1) 指标。它衡量了模型利用反馈信息进行迭代优化的效率。

- 学术研究与论文发表的“硬通货”:在顶级人工智能会议(如 NeurIPS, ICML, ICLR)上,任何关于代码生成的新论文,如果缺少 HumanEval 的对比实验数据,几乎不可能被录用。它成为了该领域事实上的通用语言,使得不同机构、不同架构的模型可以在同一维度上进行公平比较。

4.2 代表性产品/项目案例

案例一:AlphaCode 系列的演进

DeepMind 的 AlphaCode 是最早引起轰动的代码生成模型之一。早期版本通过在海量代码库上训练,并在 HumanEval 和 Codeforces 竞赛题上验证,展示了惊人的竞争力。到了 2026 年,其继任者不仅关注 HumanEval 的通过率,更利用该基准优化其“采样 - 过滤 - 聚类”的策略,实现了在极少样本下的高通过率,证明了大规模推理策略的有效性。

案例二:GitHub Copilot X 的后端优化

作为全球最流行的 AI 编程插件,GitHub Copilot 的背后模型迭代严重依赖 HumanEval。微软团队利用该基准测试不同参数量的模型在特定领域(如 Python 数据处理、JavaScript 前端逻辑)的表现,从而动态调整云端路由策略:简单任务由小模型处理,复杂逻辑由经过 HumanEval 高分验证的大模型处理,以平衡速度与质量。

案例三:开源社区的 StarCoder 与 CodeLlama

Meta 推出的 CodeLlama 系列和 BigCode 项目的 StarCoder,均在发布时详细列出了其在 HumanEval 上的得分。这些数据直接驱动了开源社区的采用率。开发者会根据榜单选择最适合自己技术栈的模型进行本地部署。例如,若团队主要使用 Python,他们会优先选择在 HumanEval-Python 子集上表现最佳的模型版本。

4.3 使用门槛和条件

尽管 HumanEval 应用广泛,但要正确使用它并非没有门槛:

- 计算资源需求:虽然 164 道题数量不多,但如果要进行大规模的 pass@100 评估,或者同时评估几十个模型变体,需要大量的 GPU 资源进行并行推理,以及稳定的 CPU 集群用于沙箱执行。

- 环境配置复杂性:搭建安全的执行沙箱需要一定的 DevOps 能力。必须确保容器隔离性,防止恶意代码逃逸。同时,不同版本的解释器(如 Python 3.8 vs 3.12)可能导致测试结果不一致,需要严格统一环境配置。

- 防作弊机制:随着模型变强,简单的关键词匹配已无法防止作弊。评估方需要确保测试用的 Docstring 和单元测试没有被模型在预训练阶段“死记硬背”。这要求评估者定期更新评估集(如推出 HumanEval+),或对输入进行微小的扰动测试。

- 语言特异性:使用者需明确,Python 的高分不代表其他语言的高分。跨语言评估需要分别部署对应的语言环境和测试集。

5. 延伸阅读

HumanEval 只是代码智能评估宇宙中的一颗明星。为了构建更全面的知识体系,建议读者进一步探索以下内容。

5.1 相关概念推荐

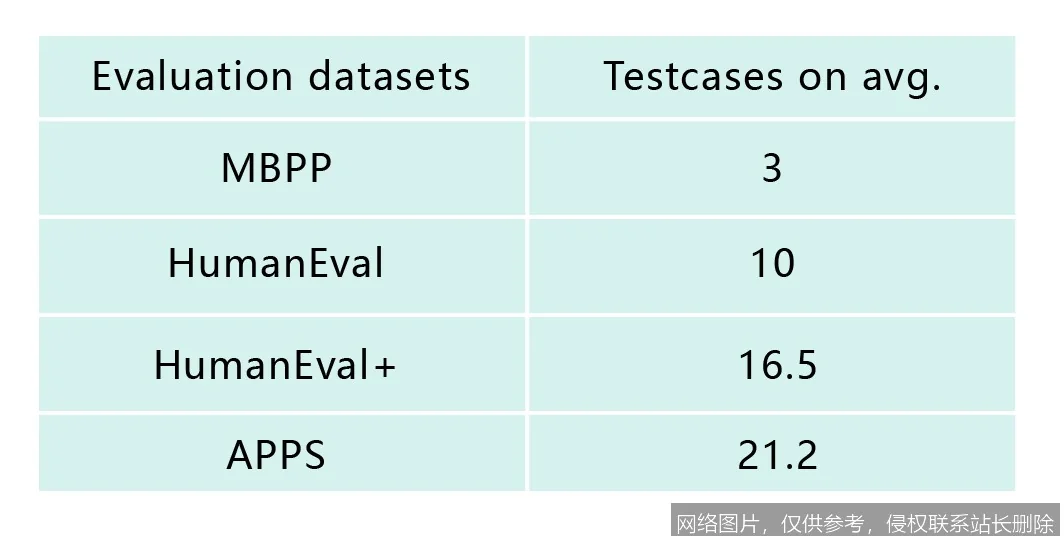

- MBPP (Mostly Basic Python Problems):另一个著名的代码生成基准,包含近 1000 个问题,难度相对基础,更适合评估入门级模型或进行大规模快速筛选。

- SWE-bench (Software Engineering Benchmarks):如果说 HumanEval 是考“填空题”,SWE-bench 就是考“综合大题”。它要求模型解决真实的 GitHub Issue,涉及多文件修改、环境配置和复杂的依赖管理,代表了 2026 年代码评估的前沿方向——从函数级走向工程级。

- LiveCodeBench:为了解决数据污染问题,这类基准赛题来源于最新的编程竞赛(如 LeetCode 周赛),确保模型在训练时从未见过题目,提供实时的能力评估。

- ClassEval:专注于评估模型生成完整类(Class)的能力,考察类内部方法的协同工作和状态管理,弥补了单函数评估的不足。

5.2 进阶学习路径

对于希望深入研究该领域的学习者,建议遵循以下路径:

- 基础阶段:阅读 OpenAI 发布的原始论文《Evaluating Large Language Models Trained on Code》,理解 HumanEval 的设计初衷和初始实验结果。

- 实践阶段:在 GitHub 上克隆

human-eval官方仓库,尝试在本地环境中运行评估脚本,用自己的小模型或调用 API 进行测试,亲手体验“生成 - 执行 - 验证”的全过程。 - 进阶阶段:研究如何通过 Prompt Engineering(提示工程)提升 pass@k 分数,例如引入 Chain-of-Thought(思维链)在代码生成中的应用。

- 前沿阶段:关注 SWE-bench 等新一代基准的论文,思考如何将单元测试的自动化验证扩展到集成测试和端到端系统验证。

5.3 推荐资源和文献

- 原始论文:Chen, M., et al. (2021). "Evaluating Large Language Models Trained on Code." arXiv preprint arXiv:2107.03374. (这是 HumanEval 的奠基之作)

- 官方代码库:GitHub - openai/human-eval (包含数据集和评估脚本的权威来源)

- 综述文章:"A Survey of Large Language Models for Code: Evolution, Benchmarking, and Future Trends" (2024-2026 年间的相关综述,提供了宏观视角)

- 社区榜单:Hugging Face Open LLM Leaderboard (Code 分类) 和 Papers With Code 网站上的 Code Generation 任务板块,这里汇集了全球最新模型的实时排名。

结语:从 2021 年到 2026 年,HumanEval 见证了 AI 代码生成能力从“玩具”到“工具”再到“同事”的跨越。它不仅是一个测试集,更是推动整个行业向更高可靠性、更强逻辑性迈进的引擎。理解 HumanEval,就是理解 AI 如何学会像人类一样思考逻辑、构建世界。在未来,随着评估标准的不断演进,我们有理由相信,AI 将在软件工程的广阔天地中发挥更加不可替代的作用。

已是最新文章