Replicate - 云端AI模型一键运行平台

Replicate:让运行AI模型像调用API一样简单

在人工智能模型日益复杂化的今天,如何让开发者无需深入底层基础设施,就能便捷地部署和运行这些模型,成为了一个关键挑战。成立于2019年的Replicate,正是为解决这一问题而生。公司由曾任职于Google Brain的Ben Firshman和来自GitHub的Andreas Jansson联合创立,其核心产品是一个云端AI模型一键运行平台。该平台旨在将AI模型容器化,并通过简单的API提供调用服务,极大地降低了AI应用开发的门槛。根据其官网信息,Replicate在2022年完成了由Andreessen Horowitz领投的1250万美元A轮融资来源: 官网 (2024-05)。

主要功能与服务

Replicate平台的核心是构建了一个庞大且易于访问的AI模型库与执行引擎。其主要产品线和服务包括:

- Cog开源工具:这是一个用于将机器学习模型打包成标准容器的开源工具。开发者使用Cog可以轻松定义模型环境、依赖和配置,从而确保模型在任何地方都能以相同的方式运行。

- 云端模型市场:平台托管了成千上万个由社区和知名机构(如Meta、Stability AI)发布的预打包模型,涵盖图像生成、语言模型、视频处理、音频分析等多个领域。

- 一键式API:平台上的所有模型都通过统一的REST API暴露。开发者只需几行代码,即可调用最前沿的AI模型,无需关心服务器部署、GPU驱动或依赖冲突。

- 模型托管与缩放:用户可以将自己用Cog打包的私有模型部署到Replicate的云端,平台负责处理所有的运维、扩展和硬件管理工作。

技术特点与创新

Replicate的技术架构围绕标准化和抽象化展开,形成了独特优势。

其首要创新点是通过容器化实现环境一致性。Cog工具将模型代码、系统依赖、Python包乃至预训练的权重文件统一封装,彻底解决了“在我机器上能跑”的经典难题。这使得模型真正成为可移植、可复现的独立单元。

其次,平台实现了极致的开发者体验抽象。它将复杂的GPU资源调度、模型冷启动优化、自动扩缩容等底层工程问题完全隐藏。对于API调用者而言,他们接触的只是一个简单的HTTP端点,按实际使用的计算时间付费,无需预置或管理任何基础设施。

最后,Replicate构建了一个活跃的模型共享社区。任何开发者都可以将自己打包的模型公开发布到平台,供他人使用并从中获得收益分成。这种模式加速了AI技术的传播与应用创新。

应用场景与案例

Replicate的应用场景广泛,尤其适合需要快速集成AI能力但缺乏专职机器学习工程师的团队。

在创意与内容生成领域,许多初创公司利用其上的Stable Diffusion、SDXL等图像模型,快速构建了AI绘画、营销素材生成等应用。在开发工具与自动化方面,开发者可以集成Whisper语音转文本模型为应用添加字幕功能,或使用CodeLLaMA辅助代码生成。

一个典型案例是设计工具公司利用Replicate的API,在产品中无缝添加了“AI扩图”(Outpainting)和背景移除功能,仅用数天就完成了从原型到上线的全过程,而无需自建AI团队处理模型服务化问题。

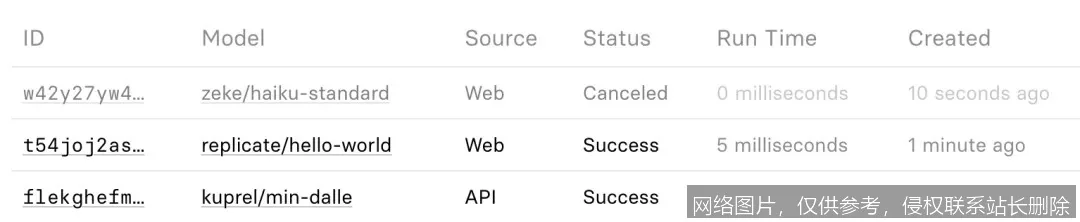

使用方式

使用Replicate非常简单。用户首先需要访问官网注册账号。平台提供免费的初始额度供用户体验。使用流程主要分为三步:一是在官网模型库中浏览并找到所需模型;二是查阅该模型的API文档;三是使用个人API令牌,通过HTTP请求或官方提供的Python/Node.js客户端库调用模型。其定价采用按量计费模式,根据模型运行所需的硬件(CPU/不同级别GPU)和运行时间进行扣费,对于轻量级或间歇性使用的场景成本可控。

竞品对比分析

与同类产品相比,Replicate的定位清晰且独特。相较于Hugging Face,后者更侧重于模型托管、数据集分享和社区讨论,虽然也提供Inference API,但Replicate在模型生产部署的标准化和易用性上更为深入。相较于Amazon SageMaker或Google Vertex AI等全功能机器学习平台,Replicate不提供模型训练等复杂功能,而是专注于“运行”这一单一环节,做到了更轻量、更专注、启动更快。与直接租赁云GPU相比,它提供了更高层次的抽象,避免了运维负担。

当然,这种模式也存在其局限性。对于需要极致定制化、控制底层硬件或处理超大规模私有模型的企业级用户,Replicate的抽象层可能显得灵活性不足。此外,模型运行成本在长时间、高负载场景下可能高于自建基础设施。然而,对于绝大多数旨在快速创新和验证想法的开发者与团队而言,Replicate在效率与成本之间提供了极具吸引力的平衡点。

已是最新文章