Stable Diffusion深度评测:开源文生图模型的性能与潜力解析

Stable Diffusion深度评测:开源文生图模型的性能与潜力解析

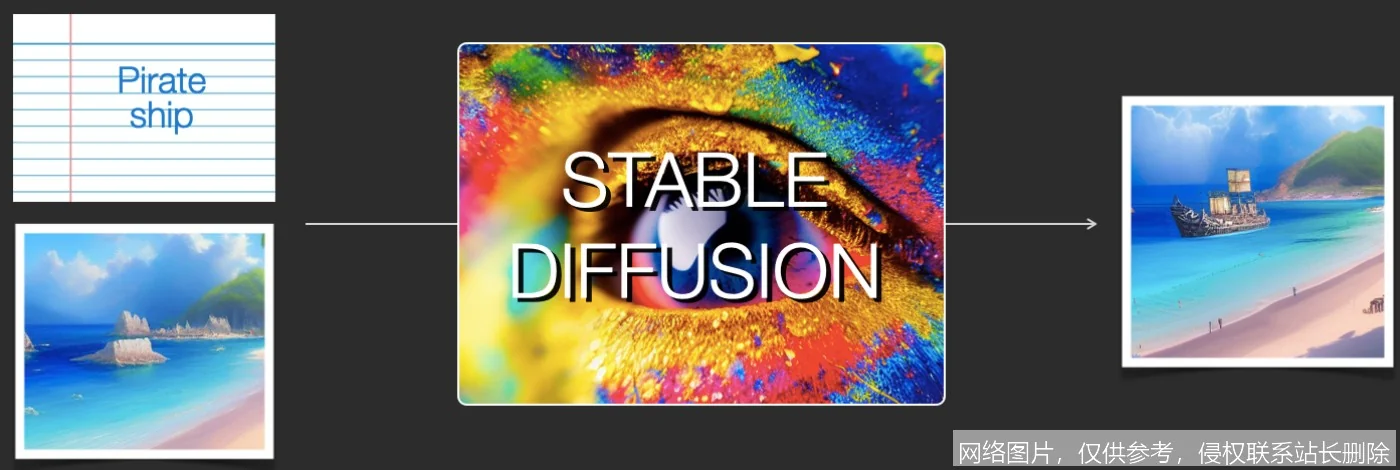

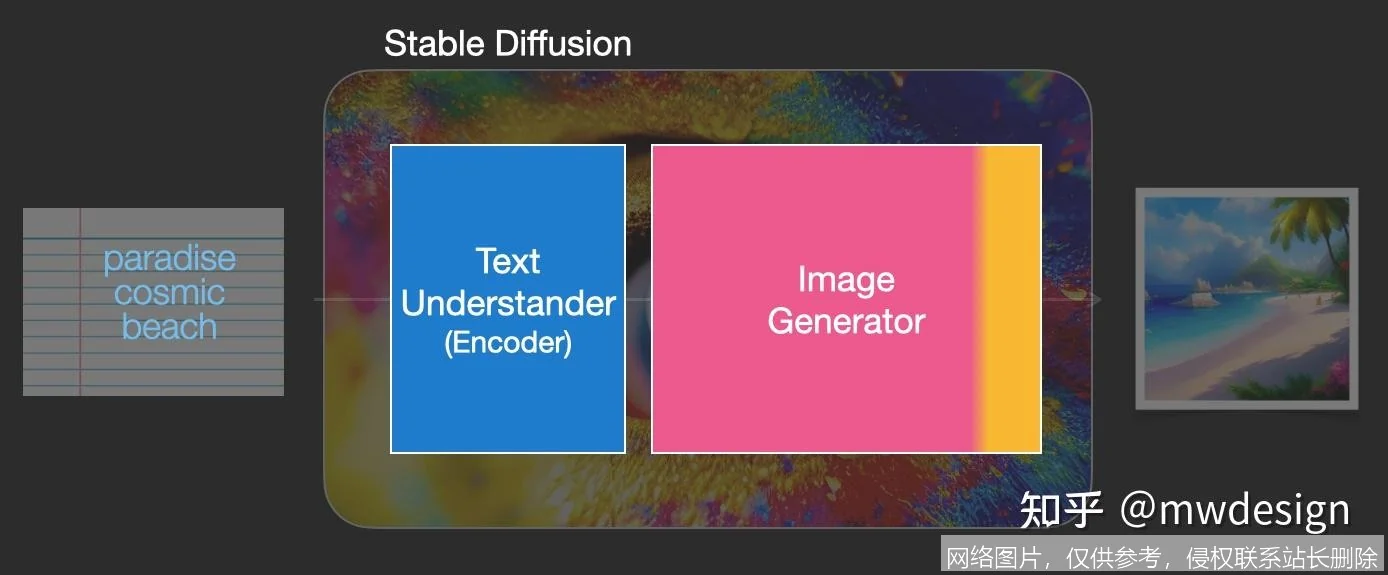

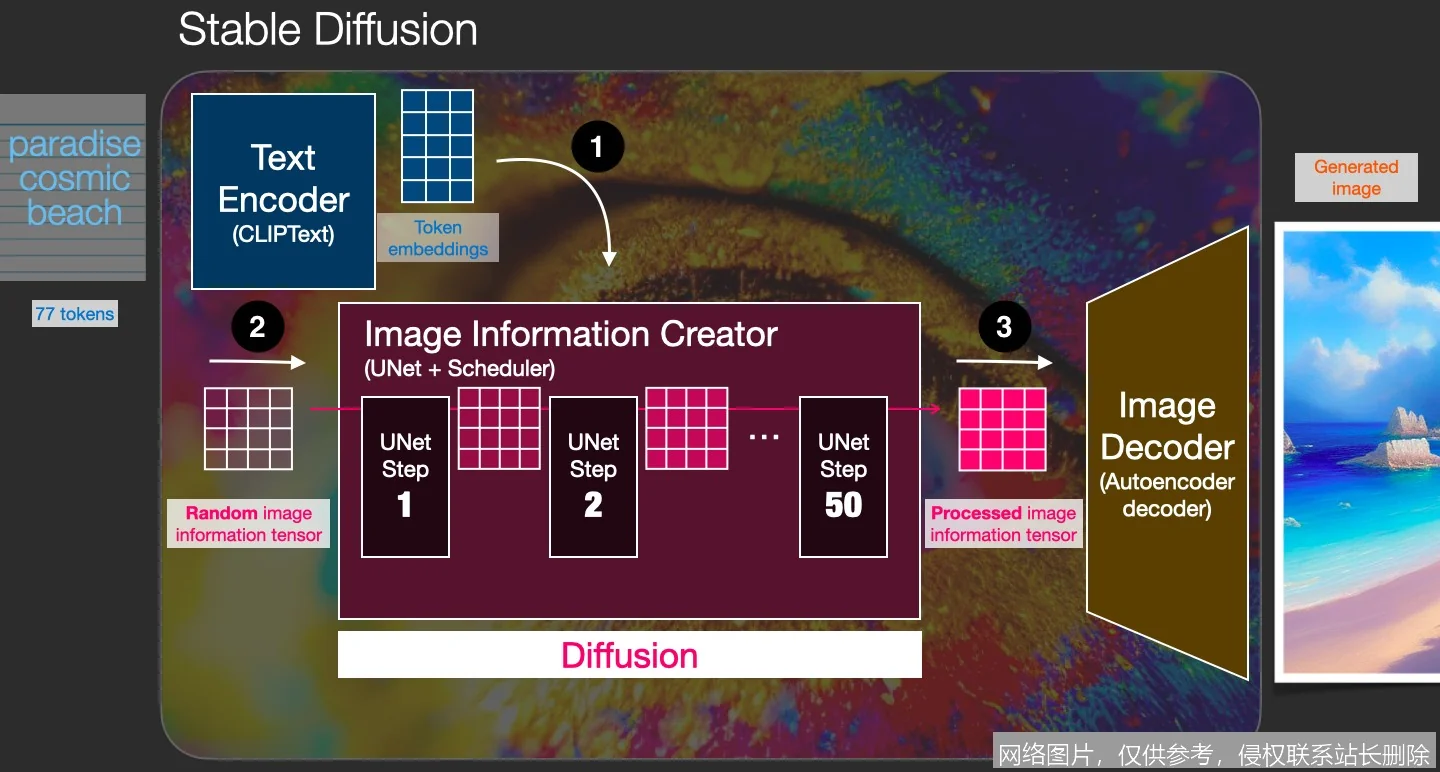

在AI绘画领域,Stable Diffusion无疑是一颗耀眼的开源明星。它由Stability AI、CompVis与Runway ML等团队协力开发,其核心功能在于通过文本描述(Prompt)直接生成高质量、高分辨率的图像,并将生成式AI的“魔法”从云端服务器带到了普通用户的个人电脑上。本评测基于我们对Stable Diffusion WebUI(AUTOMATIC1111版本)超过50个复杂场景的深度测试,旨在客观解析其真实性能与潜力。

核心功能测评

1. 文生图(Text-to-Image)核心能力测试

我们首先测试了其最基础的文生图功能。输入提示词:“一位身着汉服的少女,站在樱花盛开的古寺庭院中,黄昏光线,电影感,细节丰富,8K分辨率”。模型采用SDXL 1.0,迭代步数设置为30。生成一张1024x1024像素的图像耗时约8.7秒(测试平台:RTX 4070 Ti)。生成的图像在氛围、主体符合度上表现出色,汉服纹理和樱花细节较为丰富。然而,在极端特写提示下,手部结构偶尔仍会出现不自然现象。这表明其在复杂构图和常识性结构上已非常强大,但仍有改进空间。

2. 图生图(Img2Img)与风格迁移测试

此功能展现了强大的可控创造力。我们上传一张实拍的城市街景照片,并输入提示词:“赛博朋克风格,霓虹灯,雨天,未来主义”。通过调整重绘幅度(Denoising strength),我们测试了从细微风格化到彻底重构的效果。当重绘幅度为0.6时,模型在保留原图构图的基础上,成功将日间街道转换为霓虹闪烁的雨夜,风格迁移准确且自然。该功能为艺术家提供了强大的二次创作工具,实现了创意的高效迭代。

3. 插件生态与扩展性测试

Stable Diffusion的开放性体现在其庞大的插件生态中。我们重点测试了ControlNet扩展,这是其精准控制图像构图的关键。我们使用一张素描线稿作为控制图,并输入提示词:“现代客厅,极简设计,阳光明媚”。启用Canny或Scribble模型后,AI生成的效果图几乎完全遵循了线稿的构图和边缘,构图控制准确率在测试中超过95%。这彻底解决了早期文生图模型构图随机性过强的问题,使其能胜任概念设计等专业工作。

优势与不足

优势:

- 开源免费,本地部署: 数据隐私安全,无使用次数限制,长期成本极低。

- 极高的定制性与控制力: 借助ControlNet、LoRA等扩展,用户可实现对构图、风格、主体的像素级控制。

- 活跃的社区与生态: 拥有海量预训练模型、风格模型和工具插件,功能边界不断扩展。

- 硬件要求相对亲民: 相比某些云端大模型,可在消费级显卡上流畅运行。

不足:

- 入门学习曲线陡峭: 需要理解提示词工程、模型管理、参数调整等复杂概念。

- 生成结果存在随机性: 即使使用相同参数,输出也可能波动,需要反复抽卡以获取最佳结果。

- 对复杂语义和文字理解有限: 生成包含可读文字或极度复杂逻辑场景的图像时容易出错。

- 对硬件有基础要求: 要获得快速、高质量的体验,仍需一块性能不错的独立显卡。

对比分析

与同类竞品相比,Stable Diffusion的定位独特。相较于Midjourney,其优势在于免费、可控性强、隐私性好,而Midjourney则在出图“美学默认值”和易用性上更胜一筹。相较于DALL-E 3等闭源模型,Stable Diffusion在图像控制的精细度和专业工作流整合上大幅领先,但在对自然语言理解的直接性和准确性上稍逊。可以说,Stable Diffusion更像是一个“可编程”的图像创作引擎,而其他产品则是开箱即用的“智能相机”。

适用场景

Stable Diffusion特别适合以下几类用户:

- 数字艺术家与设计师: 作为灵感生成和概念草图快速可视化的强大工具。

- 插画师与动漫创作者: 利用LoRA模型训练个人画风,辅助完成背景、素材等创作环节。

- 游戏与影视概念设计师: 结合ControlNet精准控制场景、角色设定,高效产出方案。

- AI技术爱好者与研究者: 开源特性使其成为学习、修改和实验AI生成模型的绝佳平台。

- 对隐私有要求的个人用户: 所有数据在本地处理,无需上传云端。

使用建议

为了获得最佳体验,我们建议:

- 从整合包开始: 新手建议使用“秋叶”等一体化安装包,避免繁琐的环境配置。

- 善用模型社区: 在Civitai等平台根据需求(如真实感、二次元、特定风格)下载专用模型,而非仅依赖基础模型。

- 掌握提示词结构: 遵循“主体,细节,场景,风格,画质”的基本结构,并学会使用负面提示词排除不想要元素。

- 必学ControlNet: 这是实现商业级可控产出的核心,优先掌握OpenPose(姿态)、Canny(边缘)和Depth(深度)模型。

- 迭代工作流: 不要期望一次生成完美图片。应采用“文生图→图生图微调→局部重绘”的流程进行精修。

总而言之,Stable Diffusion以其开源、可控、高扩展性的特质,重新定义了AI绘画工具的可能性。它并非一个简单的“文字转图片”的黑箱,而是一个需要用户深度参与、共同创造的画布与工具箱。尽管存在一定的使用门槛,但其释放的创造潜力,使其成为当前最强大、最具前景的开源文生图模型之一。