大模型和小模型有什么区别?

AI问答解惑2026-03-06 03:12:00

大模型和小模型有什么区别?

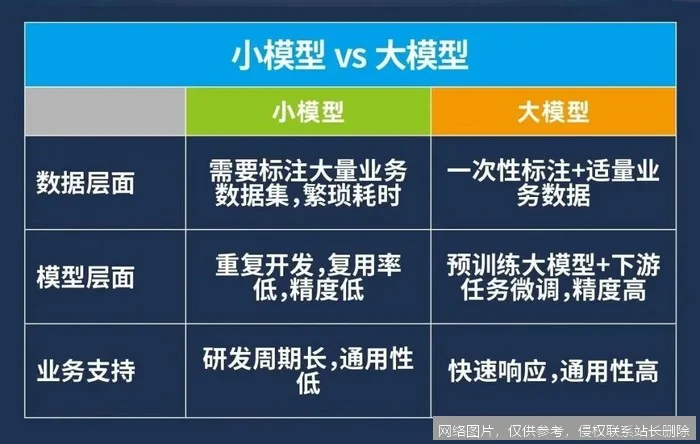

直接回答:大模型与小模型的核心区别在于参数规模、能力范围和应用场景。大模型通常指参数达到百亿、千亿甚至万亿级别的模型,具备强大的通用理解和生成能力;而小模型参数通常在十亿以下,专注于解决特定、有限的任务,追求高效和低成本。

详细解释:为什么是这个答案

这种区别并非简单的“大就是好”,而是代表了两种不同的技术路径和设计哲学。

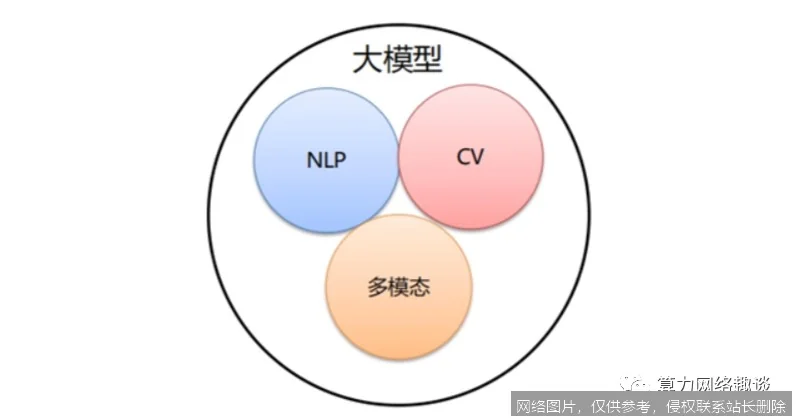

- 大模型(如GPT-4、Claude、文心一言):其“大”主要体现在海量的参数和训练数据上。参数可以理解为模型从数据中学到的“知识”的存储单元。参数规模巨大,使得模型能够捕捉极其复杂和微妙的语言模式、世界知识以及逻辑关系。因此,大模型展现出卓越的“涌现能力”——即在未经专门训练的任务上,也能表现出令人惊讶的推理、创作和解决复杂问题的能力。它们像一个“通才”,通过一个统一的模型应对千变万化的需求。

- 小模型(如用于特定分类、翻译或客服的专用模型):其设计目标是“专精”。通过使用相对较少的参数,并在一个高质量、领域特定的数据集上进行训练,小模型可以在其专注的任务上达到甚至超越大模型的精度。它的优势在于速度快、部署成本低(对算力要求小)、数据隐私可控,且推理结果稳定可预测。它是一个“专家”,但在其专业领域之外能力有限。

延伸说明:相关背景和原理

这一分野的背后是深度学习领域的“缩放定律”观察:随着模型参数、数据量和计算力的同步规模化增加,模型性能会以可预测的方式提升。这驱动了近年来大模型的军备竞赛。

然而,大模型的成功也带来了挑战:

- 计算与能耗:训练和运行大模型需要巨大的算力集群和电力消耗。

- 部署门槛:将千亿参数模型部署到终端设备或普通服务器几乎不可能。

- 特定任务效率:用“大炮打蚊子”可能造成资源浪费。

因此,当前的技术趋势并非二者选一,而是走向协同:

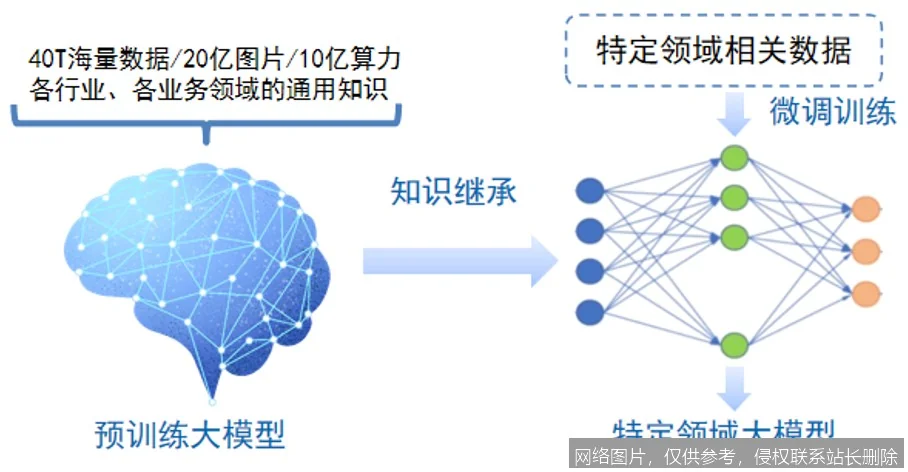

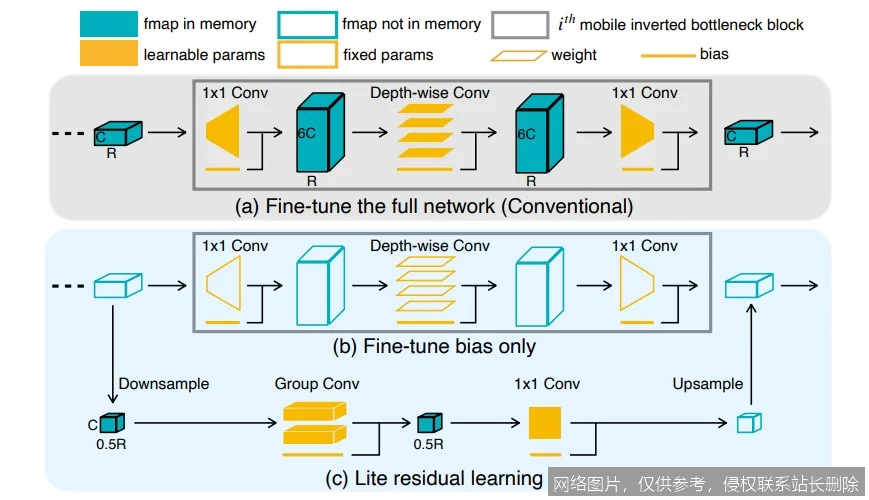

- 大模型小型化:通过模型压缩(如知识蒸馏、剪枝、量化)技术,将大模型的知识“提炼”到小模型中,在保持大部分性能的同时大幅降低部署成本。

- 小模型协作化:采用混合专家系统,将多个小专家模型(MoE)组合起来,在推理时动态激活相关专家,实现接近大模型的能力,但计算成本更低。

- 大模型作为基础:利用大模型的通用能力进行提示工程或生成训练数据,再用来高效训练高质量的小型专用模型。

常见误区:纠正错误理解

- 误区一:大模型在所有任务上都比小模型好。

错误。在特定、定义明确的任务上(如特定领域的意图识别、工业缺陷检测),专门训练的小模型往往在精度、速度和稳定性上优于通用大模型。 - 误区二:参数数量直接等于模型智能水平。

错误。参数数量是基础,但模型性能还取决于训练数据的质量、算法的创新(如更好的注意力机制、训练目标)以及架构设计。一个优化良好的百亿参数模型,其表现可能优于一个训练不佳的千亿参数模型。 - 误区三:未来只会剩下大模型。

错误。应用场景是多样化的。在手机、物联网设备、实时系统、对成本敏感的企业应用中,小模型因其效率优势将长期存在并蓬勃发展。未来的生态将是“基础大模型+垂直小模型”共存的格局。

总结要点:一句话核心结论

大模型是能力广泛的“通才”,追求通用人工智能的边界;小模型是成本高效的“专家”,致力于在特定场景下提供最优解;二者并非取代关系,而是互补协同,共同构成现代AI应用落地的完整图景。

上一篇

AI创业成功率为何普遍偏低?

相关推荐

- AI访问不了怎么办?2026 年国内直连最新方案,3 步解决无法连接难题

- 2026 年餐饮 AI 怎么用才赚钱?3 大落地场景帮老板降本增效

- Fine-tuning 是什么?2026 年最新微调全解,3 步让大模型懂你业务

- Pika 怎么用才不崩?2026 最新关键帧控动效 +3 个避坑指南

- AI 问答未来发展趋势如何?2026 年从“陪聊”到“办事”的 3 大真相

- 2026 年选开源还是闭源 AI?如何避开厂商锁定实现降本增效?

- Sora 2026 年怎么用?注册受限怎么解?国内平替 + 官方教程一次讲透

- AI教育辅导会不会废掉孩子思考力?2026年人机协同的 3 个关键策略

- AI次数用完了怎么办?2026年3个免费替代方案让效率翻倍

- AI 翻译准确吗?2026 年实测揭秘:为何法律场景仍翻车,3 招让准确率飙升